LTX-2.3 ComfyUI 配置指南:两阶段流水线、显存优化与 Gemma 编码器

在 ComfyUI 中配置 LTX-2.3:检查点放置、Gemma 3 12B 编码器设置、两阶段生成流水线,以及面向消费级 GPU 的低显存解决方案。

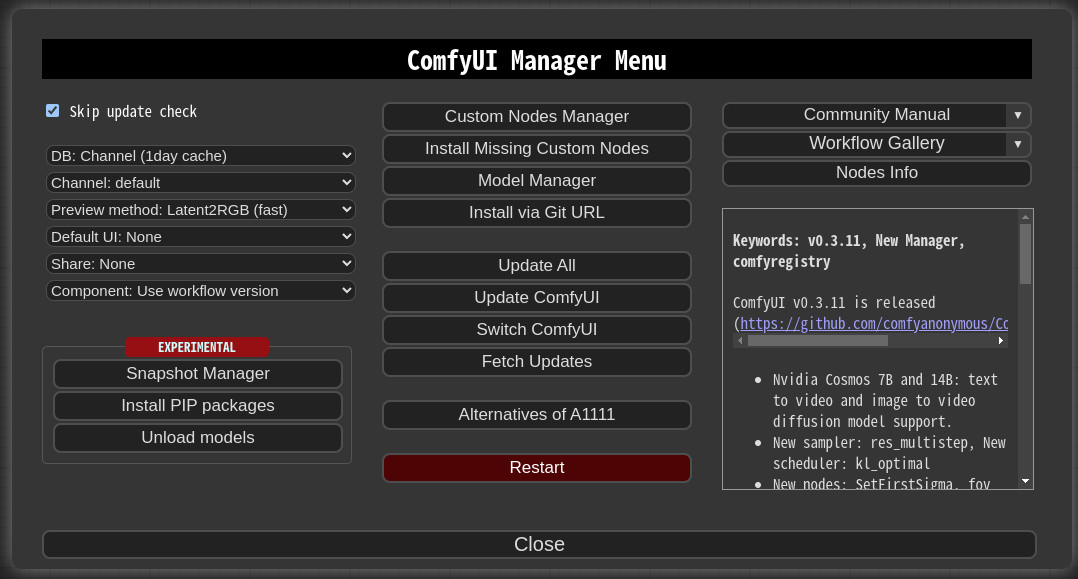

嘿,大家好。我是 Dora。说实话,我当初并没有计划切换。我在 ComfyUI 里的 LTX-2 工作流运行得好好的,我也不喜欢”为了新而新”。但上周(2026 年 3 月),我不断看到关于 LTX-2.3 的简短说明:更好的连贯性、新的文本编码器(Gemma 3 12B),以及两阶段流程——据说能在不消耗大量显存的情况下生成更清晰的图像。

于是我找了个安静的早晨,把工作流迁移过去了。 下面是实际发生的变化、我遇到的坑,以及那些让工作变得更轻松的地方。如果你是来找安装步骤的:文章里有,但更有价值的部分是我在一天天搭建 LTX-2.3 ComfyUI 工作流 过程中注意到的那些取舍。

LTX-2.3 在 ComfyUI 中有何不同(对比 LTX-2 配置)

LTX-2.3 ComfyUI 的感觉更像是朝着稳定性迈进了一步,而不是一次跨越。该模型需要 Gemma 3 12B 作为文本编码器,推荐的路径是两阶段流程:先以半分辨率生成以保证基础连贯性,再用 LTX 专用上采样器对潜变量进行放大。实际使用中,这改变了两件事:

- 在适中的步数下,提示词的表现更加一致。在第一阶段保持 25–35 步时,我注意到细节”糊掉”的情况明显减少。

- 只要我遵守阶段边界、不强行一次性生成全分辨率,显存占用的波动比我预想的要小得多。

我也发现旧版 LTX-2 节点大多能用,但 LTX-2.3 更倾向于使用自己的采样器和潜变量上采样节点。光换检查点是不够的。这也是我最初踩坑的地方。

所需文件与文件夹结构

以下是我在几次失败尝试后确定的配置。没什么花哨的:这是让那些红色报错框消失所需的最低配置。

检查点选项(dev / fp8 / distilled + distilled LoRA)

- dev:适合摸索尝试。稍微重一些,但我发现在提示词发散时它更宽容。

- fp8:显存占用更低。在我的 12GB 显卡上,fp8 让我在解码时能保持批次大小为 1 而不出现 OOM。质量略有下降,但对社交媒体或营销素材来说没什么大问题。

- distilled + distilled LoRA:在我的测试中,对于产品类风格的画面输出最干净,但你需要记得实际加载 LoRA 并设置权重(0.6–0.8 对我有效)。如果不激活 LoRA,效果看起来更接近 dev 版本。

所有检查点存放在 ComfyUI/models/checkpoints。我把 LoRA 放在 ComfyUI/models/loras,并用与基础检查点相同的文件名前缀命名,方便快速找到对应的组合。

Gemma 3 12B 文本编码器:下载与放置

LTX-2.3 需要 Gemma 3 12B 文本编码器。根据你使用的节点组合,你可以选择 PyTorch 权重或 GGUF 文件(用于基于 llama.cpp 的节点)。我两种都试过。

- PyTorch 方式:放在 ComfyUI/models/clip(部分节点会在此自动检测)。如果你的节点要求不同的文件夹,按其文档来,不要强行对抗。

- GGUF 方式:放在 ComfyUI/models/llm(或节点指定的 text_encoders 文件夹)。Q4_K_M 是我的甜蜜点:Q3 省内存更多,但在长提示词中会损失一些细节。

如果不确定,打开节点的”?”帮助或 README。文件夹名称很重要。

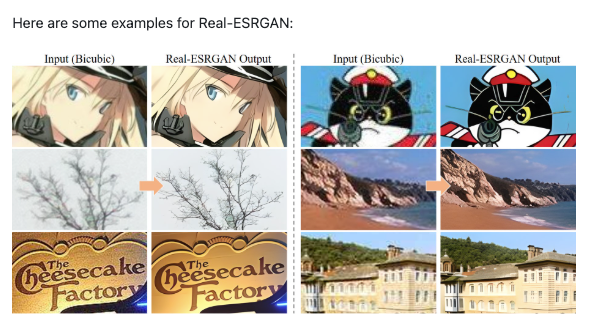

上采样模型:何时需要引入

如果你使用的是 LTX 潜变量上采样器,就不需要额外的图像上采样器。话虽如此,我还是在 ComfyUI/models/upscale_models 里保留了一个 4x ESRGAN 和一个 SDXL x2 潜变量上采样器,用于非 LTX 图像。对于 LTX-2.3,内置的 LTXVLatentUpsampler 在边缘和文字类形状上的表现比 ESRGAN 更好。

两阶段流程详解

我一直试图跳过第一阶段。那是个错误。两阶段路径最终反而更容易理解,对显存也更友好。

第一阶段:以半分辨率建立基础连贯性

我以目标尺寸的一半生成(例如,最终 1280×768 的目标对应 640×384)。这个阶段确定构图和主体细节。25–35 步,CFG 适中(4–6),批次大小为 1。如果有问题,比如手部、布局、色调偏差,在这里修复代价更小。

我注意到:简化提示词并最多使用一两个风格锚点时,“漂移”现象明显减少。LTX-2.3 似乎更偏好简洁聚焦的语言。

第二阶段:用 LTXVLatentUpsampler 进行潜变量放大以提升清晰度

然后我将第一阶段的潜变量输入 LTXVLatentUpsampler。这一步在不破坏构图的情况下锐化边缘、恢复精细细节。我通常在上采样时运行 15–20 步。这不是魔法橡皮擦:如果基础就是错的,上采样器只会让错误更清晰。

Dev + Distilled LoRA vs Full Distilled:如何选择

- Dev + Distilled LoRA:这是我在探索某种风格时的默认选择。灵活性稍强。我将 LoRA 强度设在 0.7 左右,如果纹理感觉过拟合就微调。

- Full Distilled:当我需要批量输出快速、一致的结果时使用。它对提示词更挑剔,但节省脑力,每次运行的意外更少。

如果感觉卡住了,可以试试第一阶段用 dev(更宽松),第二阶段用 distilled(更精准)。这个组合曾经救了我一组情绪感人像系列。

Gemma 3 12B 编码器配置:显存管理

Gemma 3 12B 是我原本最担心的地方。实际上还好,只是需要一些约束。

在显存紧张时将编码器卸载至 CPU/内存

在 12GB 显卡上,我在文本处理阶段将 Gemma 编码器卸载到 CPU。这让每次运行多花了几秒,但阻止了第一阶段的 OOM。如果你的节点支持 混合设备加载,可以将注意力层放在 GPU,其余部分放在 CPU。感受是:不会更快,但更平稳——没有在构思中途崩溃的情况。

—novram 参数及其他启动修复方案

如果你在启动 ComfyUI 时使用命令行参数,--novram 有助于平滑模型切换时的内存峰值。我还做了以下几点:

- 在测试运行之间,对大模型禁用”保持加载”选项。

- 在小型自定义初始化脚本中设置

torch.set_grad_enabled(False)(如果你的环境允许),以避免无用的梯度计算。 - 使用更小的安全余量:当我知道会叠加 LoRA 时,选用 16-bit 或 fp8 检查点。

消费级 GPU 的低显存策略(12GB / 16GB / 24GB)

以下是我在三台不同机器上(RTX 3060 12GB、4070 12GB 和 4090 24GB)都验证有效的方案:

GGUF 量化模型:Q3 vs Q4 的取舍

- Q3:内存占用最低,加载最快,但我损失了提示词的细节感知,描述性词汇更容易出现重复。

- Q4:稍微重一些,连贯性明显更好。这是我在 12–16GB 显卡上的首选。24GB 以上,我通常不量化,或在有 Q5 时使用 Q5。

VAE 卸载以减少内存峰值

解码阶段是我最常遇到 OOM 的地方。将 VAE 卸载到 CPU,或使用更轻量的 VAE,可以减少第二阶段末尾的内存峰值。在 12GB 显卡上,即使前面的节点支持批处理,我也会将最终解码设置为单张图像(不批量),这样更省心。

其他小技巧:

- 第一阶段保持较低分辨率:留到后面再放大。

- 避免叠加多种引导技巧。一次只用一个 CFG,一个 LoRA。

首次运行常见报错及修复方案

我遇到了那些常见的红色报错框。以下是真正有效的修复方法。

加载后提示节点缺失

如果 ComfyUI 找不到 LTX-2.3 节点,请更新你的 自定义节点仓库 并重启。部分 LTX 节点还需要较新版本的 ComfyUI 核心。我曾通过删除节点的缓存文件夹并让它在启动时重建来修复一个顽固的报错。

解码时 OOM

两个方法立竿见影:将检查点切换为 fp8,或将 VAE 卸载到 CPU。同时将最后阶段的批次大小降至 1。如果还是崩溃,将目标分辨率减半,让外部图像上采样器来收尾。

Gemma 编码器崩溃

这通常意味着文件夹路径不对,或者节点不兼容该量化文件。我从节点 README 中指定的来源重新下载了 Gemma 3 12B,验证了校验和,并将其放在节点期望的位置(clip vs llm)。Q4 可以正常加载:Q3 有时在我的 4070 上加载失败,直到我更新到最新的 llama.cpp 构建版本。

常见问题

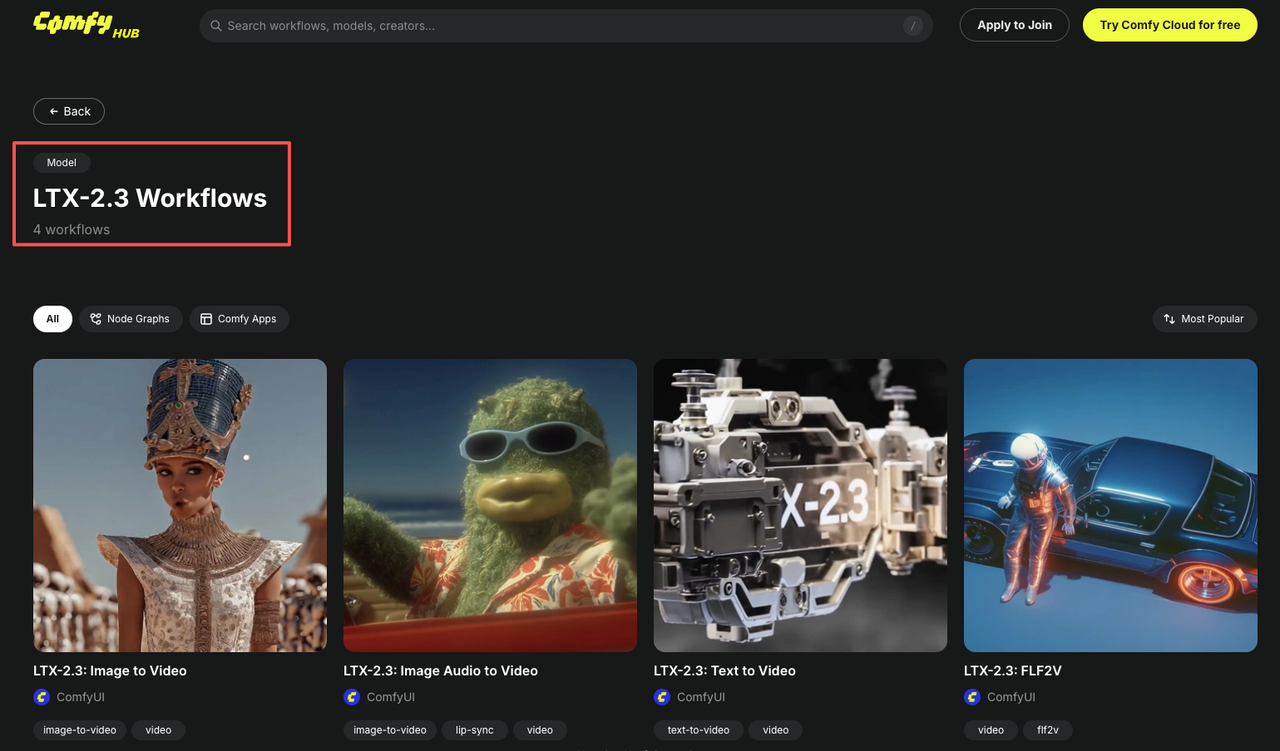

LTX-2.3 的 ComfyUI 节点需要单独安装吗?

通常需要。光更新模型是不够的。拉取最新的 LTX 节点仓库并重启 ComfyUI,使其注册新的采样器和潜变量上采样器。

我能在 LTX-2.3 检查点上使用现有的 LTX-2 工作流吗?

部分可以。我能复用整体布局,但必须替换成 LTX-2.3 的采样器和 LTXVLatentUpsampler,并将提示词指向 Gemma 3 12B。完成这些之后,大多数控制参数的行为都正常了。

在 ComfyUI 中运行 LTX-2.3 的最低显存要求是多少?

在 12GB 显存上,使用 fp8 或 GGUF Q4 编码器、第一阶段半分辨率以及 VAE 卸载,我可以跑出可用的单张图像结果。16GB 会更流畅。24GB 下,你可以留在 PyTorch 并运行得更快。

两阶段流程比单阶段快还是慢?

实际耗时可能差不多,但感觉更轻松。我花在重复生成全分辨率失败结果上的时间少了。第一阶段确定创意,第二阶段打磨细节。对于 12GB 显卡来说,这也是”能正常创作”和”频繁崩溃”之间的区别。

我对 LTX-2.3 ComfyUI 最终的感受不是”兴奋”,而更像是”如释重负”。图像更快地呈现出我想要的样子,工作流也不再和显存”打架”了。我会继续使用两阶段路径。它安静,它管用。

相关文章: