GPT-5.4开发者指南:泄露信号对AI工作流意味着什么

快速模式、视觉升级与编程智能体信号——GPT-5.4泄露信息对AI基础设施构建者意味着什么。

你好,我是 Dora。我并没有计划追踪 GPT‑5.4。只是在 agent 工作流中,我一次次撞上那些小小的停顿——长到足以让我切换到邮件页面,然后忘记自己原本在做什么。当一个模型承诺”快速模式”和全分辨率视觉时,我的耳朵就竖起来了——不是因为我想要最新的东西,而是因为我想减少那些微小的中断。

这篇文章写给 GPT 5.4 的开发者,或者更准确地说,写给那些正在考虑是否要围绕它构建应用、以及如何构建的开发者。我不是来推销这个模型的。我是来分享它可能在哪里减少摩擦、在哪里可能不会,以及应该朝哪个方向构建,让今天的工作能撑过明天的版本更新说明。

为什么开发者密切关注 GPT-5.4

模型即基础设施的转变

我注意到一个缓慢但真实的转变:模型越来越不像”产品”,而更像你用来路由任务的基础设施。 一年前,我把每个模型当成一种人格。现在我把它们看作高速公路上的车道:高精度车道、快速车道和廉价车道,我努力在它们之间顺畅切换。

如果 GPT‑5.4 稳定了一种双车道模式(快速/慢速,或快速/思考),它就会推动我们围绕路由而非单一押注来设计 agent。这听起来很抽象,直到你在调试一个 12 步的任务时才意识到:第 3 步只需要一个快速分类,但第 8 步需要仔细的思维链推理。我目前在系统里手动拼接这种逻辑,很脆弱。如果基础设施把它内置进来,我们出错的地方就会少很多。

我对版本号不感冒——我关心的是一个版本是否能让我减少步骤或删掉胶水代码。GPT‑5.4,如果它朝着那些线索所指的方向发展,可能就是这样一个版本。

为什么小版本更新很重要

小版本号的更新看起来无聊,但它们让团队免于重构。当模型在保持接口稳定的同时改善延迟或视觉保真度时,我不需要重新培训用户(或我自己)。价值体现在这些地方:更少的重试、更简洁的提示词、更短的超时时间。

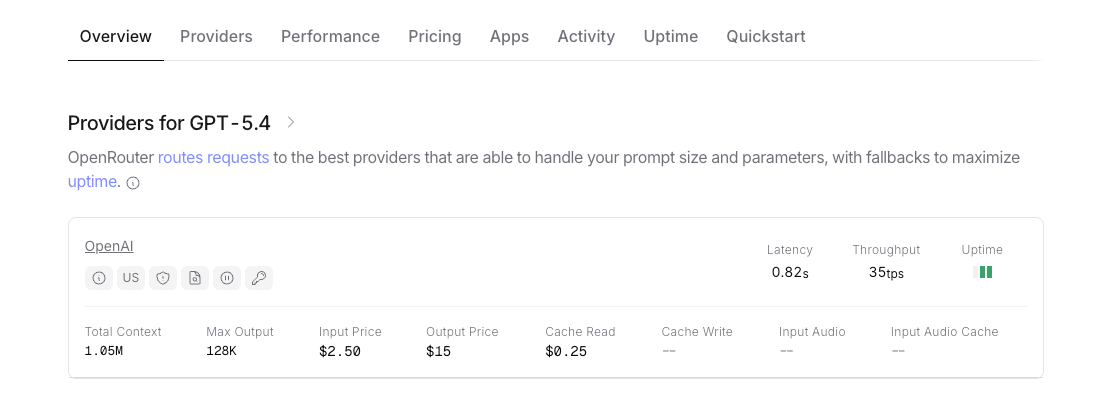

我关注 OpenAI API 文档和模型页面上的结构变化,而不是那些口号。如果 GPT‑5.4 能以更合理的默认值和更清晰的系统行为插入现有端点,那就是一个胜利。更少的代码变动,更可预测的日志。对于任何在生产环境中维护 agent 的人来说,可预测性每天都胜过新奇性。

快速模式——它如何改变 Agent 工作流

多步骤 Agent 中的当前推理成本

在过去一个月里,我使用当前一代模型运行的典型多步骤 agent(规划 → 检索 → 调用工具 → 总结)需要 8–15 次模型调用。每次调用消耗两样东西:token 和注意力。token 可以预算。注意力是让你精力耗尽的东西——那些小小的等待、局部重试、以及你不确定是否卡住了的时刻。

对我来说,一个常见的内部工具解析任务端到端平均需要 20–45 秒。大部分时间不是在做复杂推理:而是轻量级的检查和格式化。如果 GPT‑5.4 的快速模式能在保持足够精度的同时削减这些轻量步骤的延迟,就会改变整个运行的形态。大量微小等待组成的长尾会被削减。这在纸面上看起来不够戏剧化,但在日常工作中感受会更好。

双模式推理与路由逻辑

我在观察的是:“快速模式”究竟只是一个更小的模型,还是真正在一个边界内将模型与思考者配对。如果 API 暴露出清晰的提示——比如一个参数或工具级别的路由规则——我就可以集中决策:分类用快速,综合用完整。不再在每个 agent 步骤中写定制化的分支。

在用今天模型进行的测试中,我通过检查步骤意图和置信度,原型化了双路由行为。这很笨拙,但有效:已知模式走快速路由,不确定性高时走深度路由。GPT-5.4 如果 API 不自动路由,可能也会这样做。如果它确实自动路由,工作就转变为编写合理的护栏和日志,这样你就能看到模型何时过度使用慢速车道。

无论如何,逻辑才是关键。如果你无法判断何时使用了”快速”功能,那它就没有帮助。比起魔法,我更想要一个简单的参数和良好的追踪。

工具调用循环的影响

这是日常最重要的地方:工具循环。 当一个 agent 连续三次调用你的计算器、数据库或浏览器时,开销会叠加。如果快速模式降低了意图解析和函数参数构建的往返成本,就能压缩这个循环。这为真正需要推理的步骤释放了预算。

但有一个陷阱:如果快速通道误路由了哪怕 5–10% 的调用,你就要用重试和护栏来偿还。我的经验法则很简单:衡量每分钟完成的总循环数,而不是单次调用延迟。如果这个数字在开启快速模式后上升,就保留它。如果下降(更多重试、更多纠正),就对该流程关闭它。不是关于速度,而是关于可靠的吞吐量。

全分辨率视觉——真实世界的使用场景

截图转代码流水线

我有一个小型截图转组件的流水线,用于内部工具。现在,低分辨率视觉会错过细微的间距或状态提示(悬停 vs 激活)。全分辨率视觉,如果是真实的且 token 成本合理,会改变这一点。模型可以看到那 1 像素的边框和表示层级感的微妙阴影。

在实践中,我会这样连接:高分辨率通道标记原子 UI 元素,然后使用快速纯文本通道利用组件库映射来组装代码。两次通道,各司其职。回报不是**“设计到代码”的魔法,而是更少的手动纠错**。在一个简单的仪表盘上,这可能为我节省 10–15 分钟以及几次返回 Figma 的往返。

UI 调试工作流

一个不起眼但很有用的场景:bug 复现。我经常收到截图,其中错误提示框被截掉一半,或有模态框叠加。高分辨率视觉帮助模型推断 z-index 和布局层叠,而无需我用文字描述。模型可以指出:提示框的关闭按钮与导航栏重叠,可能是 CSS 层叠问题。我还是需要验证,但从更接近修复方案的起点出发是一种解脱。

对团队来说,它可以融入分诊流程:粘贴截图,获取可能的原因列表,加上要检查的选择器。没什么神奇的,只是一个更紧凑的循环。

设计资产解读

设计师交给我的导出文件,在截止日期压力下命名规范总会有所漂移——这很常见。全分辨率视觉加上设计系统的上下文可以恢复秩序。模型可以将视觉 token(间距、圆角、色彩对比)映射到最接近的设计系统变量。

限制依然存在。模型不会了解你团队的品味。但它可以做枯燥的部分:“这 12 个图标是 20px,这 3 个是 16px:可能存在不一致。“这不是什么值得上头条的事,但它是那种在一个迭代周期内积少成多的小精确性。

上下文中的编程 Agent 信号

为什么泄漏出现在 Codex 仓库中

你可能已经见过一些线索——提交记录中引用了 agent 信号,或者配置文件里有无法解释的路由标志。我不过度解读泄漏,但它们与开发者的需求相吻合:更清晰地知道模型何时在规划、执行或反思。早期的 Codex 时代仓库经常在客户端用启发式方法伪造这些。这就是配置文件泄漏的原因:逻辑不得不存在于模型之外。

如果 GPT‑5.4 暴露出更坚实的状态信号(哪怕是”规划中”和”执行中”这样简单的信号),开发者就可以同步 UI 和日志,而无需从文本中解析模糊感知。

多文件编辑潜力

多文件编辑是编程 agent 崩溃的地方。现在,我分块上下文,请求一个计划,然后在循环中用 linter 应用 diff。这个方法有效,直到失效——通常是当 agent 忘记了一个小文件,或者在执行途中重命名了某个东西。更好的原生支持应该是这样的:提出一个带文件映射的提交,按文件包含原因说明,让我逐文件接受更改。

即便没有新的原语,GPT‑5.4 改进的推理能力(如果它确实实现了)加上更严格的消息要求——“给我补丁集,不要散文”——也可以减少踩坑。我曾尝试强制使用补丁格式并拒绝其他任何形式,效果有些枯燥,但确实有帮助。

代码仓库导航改进

上下文窗口变大了,但导航仍然重要。我在 2026 年跑过的最顺畅的编程会话,使用了一个快速索引器来构建符号映射和依赖图,然后只输入相关切片。如果 GPT‑5.4 能更好地读取这些映射——交叉引用表、符号摘要——我们就可以传递更薄、更精准的上下文。

一个值得关注的实用信号:agent 请求已经看过的文件的频率。重复次数越少,通常意味着它正在构建更好的工作集。我会记录这个。如果你还没有,现在就开始:这是一个容易跨版本追踪趋势的指标。

开发者现在应该朝哪个方向构建

模型无关的架构模式

我尽量把模型藏在一个窄端口后面。一个代理决定路由:工具保持无状态且在日志中可见:提示词存放在带测试的版本化文件中。这样,如果 GPT‑5.4 让快速模式物有所值,我可以切换车道,而无需重新接线。

两个对我来说经久耐用的模式:

- 带严格校验器的类型化工具 schema。减少猜测,减少错误调用。

- 追踪优先设计。每个 agent 步骤都写入一个我可以重放的紧凑追踪。当模型更新改变了行为,我可以对比新旧运行的差异。

这两者都不华丽。但正是它们在模型迭代时让发布不至于停摆。

监控模型发布渠道

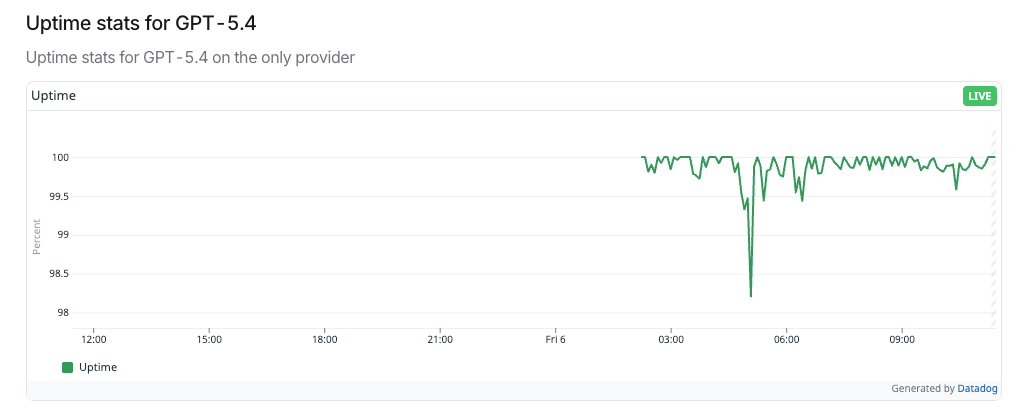

即使你不追求快速迭代,也要关注这些渠道。我订阅了模型页面,并会快速浏览模型列表和发布说明。我每次更新标记三件事:延迟提示、token 定价,以及任何新的系统级开关(模式、路由、安全行为)。然后我重新运行一个小型基准测试集——10–20 条代表我真实工作流的追踪记录。

这需要一个小时。它之后能节省好几天。如果 GPT‑5.4 分阶段推出(通常如此),你会先在追踪记录中看到边界情况,而不是在支持工单里。这就是监控的意义:在它变成火灾之前,平静地捕捉到漂移。

状态免责声明

我写这篇文章没有受到任何赞助。我目前也没有在生产环境中押注 GPT‑5.4。这里的笔记来自相邻实验以及在早期模型更新中持续有效的模式。如果官方文档明确了模式或视觉细节,我会附上链接并更新。在此之前,请把这当作田野笔记——希望有用,但仅供参考。

最后还有一件事我仍在思考:如果快速模式让那些安静的部分更快了,我们是会更少注意到它们,还是只是少了些担忧?两种结果我都能接受。