開発者向けGPT-5.4:リークされたシグナルがAIワークフローに意味すること

高速モード、ビジョン機能の強化、コーディングエージェントのシグナル——GPT-5.4のリーク情報がAIインフラ構築者にとって何を意味するかを解説します。

こんにちは、Doraです。GPT‑5.4を追いかけるつもりはありませんでした。ただ、エージェントワークフロー内で小さな速度の壁に何度もぶつかり続けていました。メールタブに切り替えるほどの長い待ち時間、そして何をしていたか忘れてしまうあの感覚。モデルが「Fast Mode」とフル解像度ビジョンを約束すると、耳が立ちます。最新のものが欲しいからではなく、あの小さな中断を減らしたいからです。

この記事はgpt 5.4 developers向け、より正確には、それを中心に構築するかどうか、またどのように構築するかを判断している開発者向けです。モデルを売り込みに来たわけではありません。摩擦を減らせる可能性がある場所、おそらく減らせない場所、そして今日の作業が明日のリリースノートを乗り越えられるよう、何に向けて構築すべきかを共有したいのです。

開発者がGPT-5.4を注視している理由

インフラとしてのモデルへのシフト

緩やかだが確実なシフトに気づいています。モデルは「製品」というより、タスクをルーティングするユーティリティに近い存在になりつつあります。 1年前、私は各モデルをひとつの個性として扱っていました。今は高速道路のレーンのように扱っています。高精度レーン、高速レーン、低コストレーン、そしてそれらの間をスムーズに行き来しようとしています。

GPT‑5.4がデュアルレーンパターン(fast/slowまたはfast/think)を安定させれば、単一の賭けではなくルーティングを中心にエージェントを設計するよう促されます。12ステップのタスクをデバッグしているときに、ステップ3はクイック分類が必要なだけで、ステップ8は慎重なchain-of-thoughtが必要だと気づくまでは抽象的に聞こえます。私は現在のシステムでこのロジックを手作業でつなぎ合わせています。脆弱です。インフラがそれを組み込んでくれれば、つまずく箇所が減ります。

バージョン番号には感銘を受けません。リリースがステップを削減したり、グルーコードを取り除いたりできるかどうかが重要です。GPT‑5.4が示唆されている方向に向かっているなら、そのひとつになれるかもしれません。

インクリメンタルリリースが重要な理由

小さなバージョンアップは退屈に見えますが、チームの大規模な作り直しを防いでくれます。モデルがインターフェースを維持しながらレイテンシやビジョンの精度を向上させる場合、ユーザー(や自分自身)を再教育する必要はありません。その価値は次のような場所に現れます。リトライの減少、プロンプトの簡潔化、タイムアウトの短縮。

OpenAI APIドキュメントとモデルページをスローガンよりも構造の変化に注目して見ています。GPT‑5.4が既存のエンドポイントにより合理的なデフォルトと明確なシステム動作でスロットインできれば、それは勝利です。コードの変動が少なく、ログがより予測可能になります。本番環境でエージェントを維持している人にとって、予測可能性は目新しさに毎日勝ります。

Fast Mode — エージェントワークフローへの影響

マルチステップエージェントにおける現在の推論コスト

先月の現行世代モデルでの実行では、典型的なマルチステップエージェント(計画 → 取得 → ツール呼び出し → 要約)は8〜15回のモデル呼び出しを必要とします。各呼び出しには2つのコストがかかります。トークンと注意です。トークンは予算を組めます。注意は消耗するもので、小さな待ち時間、部分的なリトライ、スタックしているのか疑問に思う瞬間です。

私の場合、一般的な内部ツール解決タスクのエンドツーエンドの平均時間は20〜45秒です。そのほとんどは重い推論ではありません。軽量なチェックとフォーマットです。GPT‑5.4のFast Modeがこれらの軽いステップのレイテンシを十分な精度を維持しながら削減できれば、実行全体の形が変わります。小さな待ち時間の長いテールが削ぎ落とされます。紙の上では劇的に見えませんが、日常業務ではより良く感じられます。

デュアルモード推論とルーティングロジック

私が注目しているのは、「Fast Mode」が単に小さなモデルなのか、それとも本当に1つの境界内でthinkerと組み合わされたモデルなのかということです。APIがクリーンなヒント、例えばパラメーターやツールレベルのルーティングルールを公開してくれれば、分類には高速、合成には完全と決定を一元化できます。エージェントの各ステップに独自のフォークを設ける必要はありません。

現在のモデルでのテストでは、ステップの意図と確信度をチェックしてデュアルルート動作をプロトタイプ化しました。不格好ですが機能します。既知のパターンにはクイックルート、不確実性が高い場合はディープルート。APIが自動ルーティングしない場合、GPT-5.4もおそらく同じことをするでしょう。自動ルーティングする場合、仕事はまともなガードレールとロギングを書くことにシフトします。モデルが遅いレーンを使いすぎるタイミングを確認できるようにするためです。

どちらにせよ、ロジックが重要です。「Fast」という機能名は、いつ使われるかわからなければ役に立ちません。マジックよりもプレーンなパラメーターと適切なトレースを選びます。

ツール呼び出しループへの影響

日常的に重要なのはここです。ツールループ。 エージェントが電卓、データベース、ブラウザを連続して3回呼び出すと、オーバーヘッドが積み重なります。Fast Modeが意図解析と関数引数構築のラウンドトリップコストを削減すれば、ループが縮小します。それにより、実際に推論が必要なステップのためのバジェットが確保されます。

ただし落とし穴があります。高速パスが呼び出しの5〜10%でも誤ルーティングすれば、リトライとガードレールでコストを払い戻すことになります。私の経験則はシンプルです。呼び出しごとのレイテンシではなく、1分あたりに完了した総ループ数を測定します。Fast Modeをオンにしてその数が上がれば、維持します。下がれば(リトライが増え、修正が増える)、そのフローではオフにします。スピードではなく、信頼性の高いスループットが重要です。

フル解像度ビジョン — 実世界のユースケース

スクリーンショットからコードへのパイプライン

内部ツール向けの小さなスクリーンショット→コンポーネントパイプラインを運用しています。今日、低解像度ビジョンは微細なスペーシングや状態のヒント(ホバーとアクティブの違いなど)を見逃します。フル解像度ビジョンが現実的で合理的なトークンコストでアクセス可能なら、これが変わります。モデルは1ピクセルの境界線と、エレベーションを示す微妙な影を確認できます。

実際には次のように配線します。高解像度パスでアトミックなUI要素にラベルを付け、次にライブラリマップを使用してコードを組み立てるための高速テキストのみのパス。それぞれが得意なことをする2つのパス。見返りは「デザインからコードへ」のマジックではなく、手動修正の削減です。シンプルなダッシュボードでは、10〜15分と Figmaへの数回の往復を節約できるかもしれません。

UIデバッグワークフロー

静かながら有用なケース:バグの再現。エラートーストが半分切れていたり、モーダルオーバーレイがあるスクリーンショットをよく受け取ります。高解像度ビジョンは、私が言葉で説明しなくても、モデルがz-indexとレイアウトのスタッキングについて推論するのに役立ちます。モデルはこう指摘できます。トーストの閉じるボタンがナビゲーションと重なっています。おそらくCSSのスタッキング問題です。私はまだ確認しますが、修正に近いところから始められるのは助かります。

チームにとっては、トリアージに組み込める可能性があります。スクリーンショットを貼り付けると、原因候補リストと検査すべきセレクターが返ってきます。魔法ではありません。ただ、より密なループです。

デザインアセットの解釈

デザイナーは締め切りのプレッシャーの下でドリフトした命名規則のエクスポートを渡してきます。よくあることです。フル解像度ビジョンとデザインシステムに関するコンテキストを組み合わせることで、秩序を回復できます。モデルはビジュアルトークン(スペーシング、半径、カラーコントラスト)を最も近いデザインシステム変数にマッピングできます。

制限はまだあります。モデルはあなたのチームの好みを知りません。しかし退屈な部分はできます。「これら12個のアイコンは20px、この3つは16px:不一致の可能性があります。」見出しには値しませんが、スプリントを通じて積み重なる小さな正確さがそれです。

コンテキスト内のコーディングエージェントシグナル

CodexリポジトリにリークがあったWhy

ヒントを見たことがあるでしょう。エージェントシグナルを参照するコミット、または不明なルーティングフラグを持つ設定ファイル。リークについて深読みはしませんが、開発者が必要としているものと一致しています。モデルが計画、実行、または反省しているときについてのより明確なシグナルです。以前のCodex時代のリポジトリはクライアント内のヒューリスティックでこれを偽っていました。だからこそ設定がリークしました。ロジックはモデルの外に存在しなければなりませんでした。

GPT‑5.4がより確固としたステートシグナル(「計画中」対「実行中」のようなシンプルなものでも)を公開すれば、コーダーはテキストから雰囲気を解析せずにUIとロギングを同期できます。

マルチファイル編集の可能性

マルチファイル編集はコーディングエージェントが崩壊する場所です。今日、私はコンテキストをチャンク化し、計画を求め、次にループ内でリンターを使ってdiffを適用します。通常はうまくいきますが、エージェントが小さなファイルを忘れたり、途中で何かをリネームしたりするときに失敗します。より良いネイティブサポートは次のようになります。ファイルマップ付きのコミットを提案し、ファイルごとの根拠を含め、ファイルごとの変更を受け入れられるようにする。

新しいプリミティブがなくても、GPT‑5.4の改善された推論(実現すれば)と厳格なメッセージ「散文ではなくパッチセットを見せてください」は、落とし穴を減らせるかもしれません。パッチフォーマットを強制し、それ以外は拒否することで成功を収めてきました。退屈です。助かります。

リポジトリナビゲーションの改善

コンテキストウィンドウは大きくなりましたが、ナビゲーションはまだ重要です。2026年に経験した最良のコーディング実行は、シンボルマップと依存関係グラフを構築する高速インデクサーを使用し、関連するスライスのみをフィードするものでした。GPT‑5.4がこれらのマップ、クロスリファレンステーブル、シンボルサマリーをより上手く読めれば、より薄くて鋭いコンテキストを渡せます。

注目すべき実用的なシグナルの1つ:エージェントがすでに見たファイルを要求する頻度。繰り返しが少ないほど、通常はより良いワーキングセットを構築していることを意味します。私はそれをログに記録しています。まだしていなければ、今始めてください。リリース間でトレンドを追うのが簡単なメトリクスです。

今すぐ開発者が向かうべき方向

モデル非依存のアーキテクチャパターン

私はモデルを狭いポートの後ろに置くようにしています。ブローカーがルーティングを決定し、ツールはステートレスでログに見えるようにし、プロンプトはテスト付きのバージョン管理されたファイルに存在します。そうすれば、GPT‑5.4がFast Modeを価値あるものにしても、すべてを再配線せずにレーンを切り替えられます。

私にとって時代を超えた2つのパターン:

- 厳格なバリデーターを持つ型付きツールスキーマ。推測が少なくなり、不正な呼び出しが減ります。

- トレースファーストデザイン。すべてのエージェントステップが再生できるコンパクトなトレースを書きます。モデルのアップデートで動作が変わったとき、古い実行と新しい実行を差分比較できます。

どちらも派手ではありません。どちらもモデルが変わったときに出荷を止めずに済むものです。

モデルリリースチャンネルのモニタリング

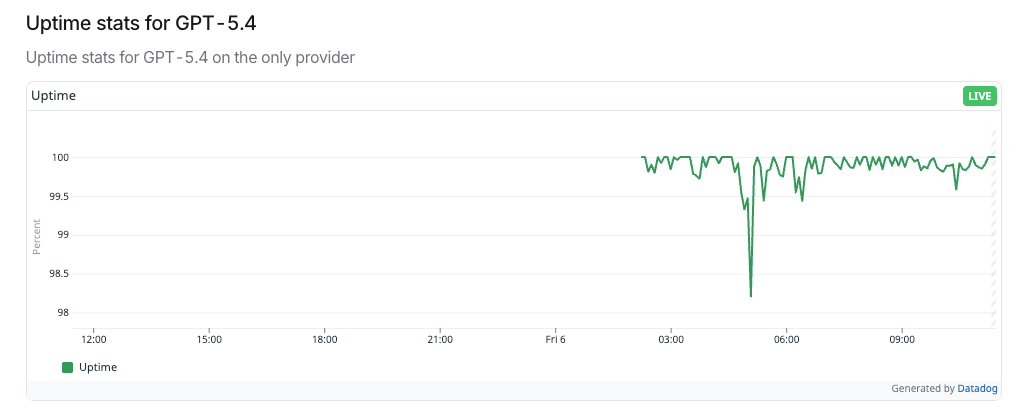

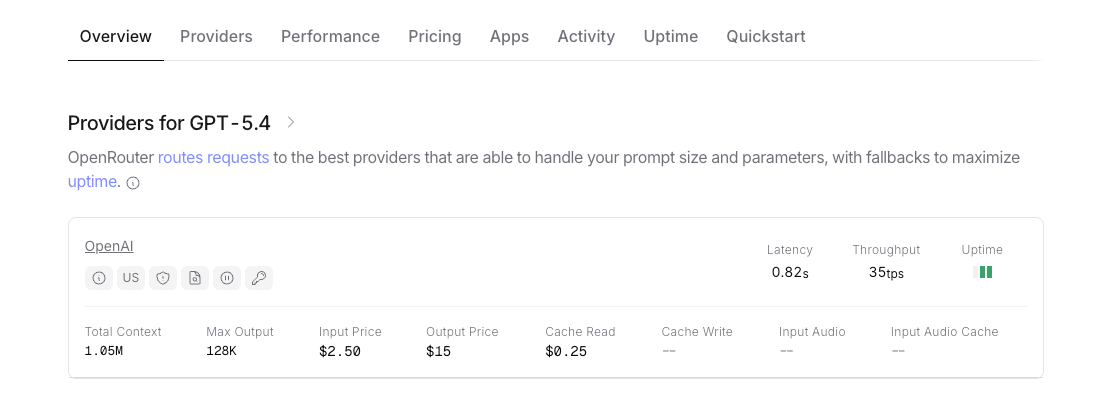

素早く動かなくても、チャンネルは監視してください。私はモデルページを購読し、モデルリストとリリースノートをざっと確認しています。アップデートごとに3つのことをマークします。レイテンシのヒント、トークン価格、新しいシステムレベルのスイッチ(モード、ルーティング、安全動作)。次に、実際のワークフローを表す小さなベンチマークセット(10〜20トレース)を再実行します。

1時間かかります。後で数日を節約します。GPT‑5.4が段階的にロールアウトされれば(通常そうです)、サポートチケットではなくトレースでエッジケースを最初に見ることになります。それがモニタリングの目的です。ドリフトを冷静にキャッチする、火事になる前に。

ステータスに関する免責事項

これを書くためのスポンサーはいません。GPT‑5.4への本番ベットもまだしていません。ここでのメモは隣接した実験と以前のモデルアップデート全体で保持されたパターンから来ています。公式ドキュメントがモードやビジョンの詳細を明確にしたら、リンクして調整します。それまでは、これをフィールドノートとして扱ってください。役立つと思いますが、暫定的なものです。

まだ考え続けていること:Fast Modeが静かな部分を速くするなら、私たちはあまり気づかなくなるのか、それとも単に心配が減るのか。どちらでも構いません。