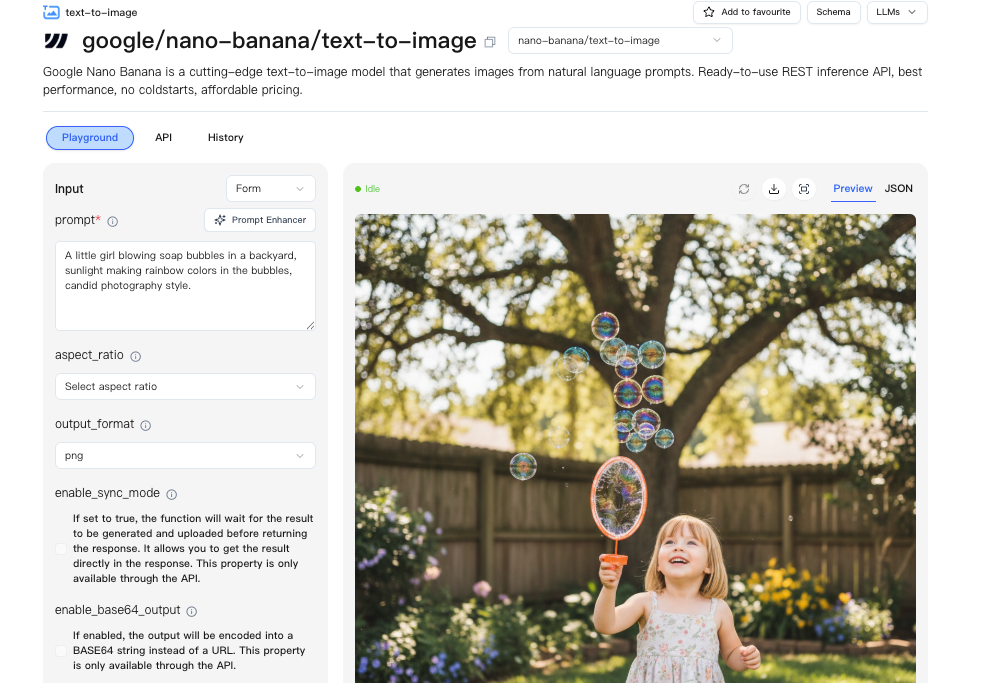

API Nano Banana Pro sur WaveSpeed : Comment l'appeler + Notes tarifaires

Vous avez déjà regardé la documentation de l’API Nano Banana Pro sur WaveSpeed et pensé « Qu’est-ce que je suis censé faire maintenant ? » Vous n’êtes pas seul. Je m’appelle Dora, j’ai personnellement testé des dizaines d’APIs, et j’ai eu ma part de points de terminaison non documentés et de courriers électroniques de facturation surprise. Dans ce guide, je vous guide pas à pas sur la façon d’appeler proprement l’API Nano Banana Pro et d’éviter les pièges tarifaires qui peuvent déstabiliser le budget de votre projet.

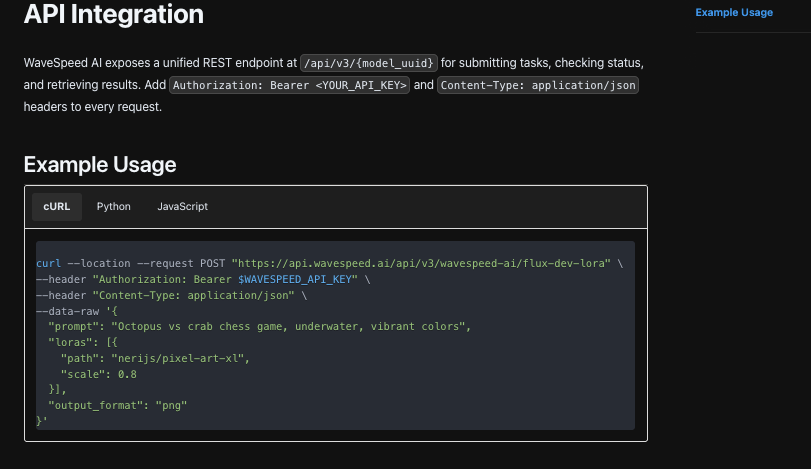

Endpoint / flux

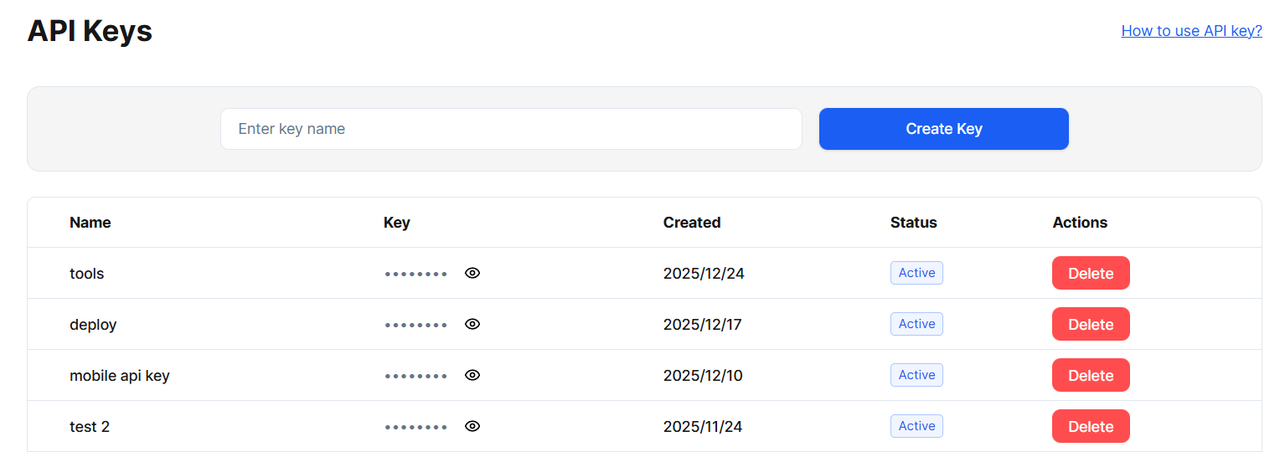

Je n’ai pas changé toute ma pile. J’ai enveloppé Nano Banana Pro derrière un petit service adaptateur, pour pouvoir basculer entre les fournisseurs sans arracher le code. Le tableau de bord de WaveSpeed a rendu cela plus facile que prévu. Un point de terminaison, une authentification cohérente et une vue de quota simple qui n’exigeait pas de chercher.

Mon flux ressemblait à ceci :

- Un petit préprocesseur a nettoyé les entrées (mise en minuscules du jargon, suppression des espaces supplémentaires, unification des horodatages de fuseau horaire).

- J’ai envoyé des demandes au point de terminaison Nano Banana Pro avec une instruction système stable et un petit ensemble d’exemples.

- J’ai mis en cache les invites stables et les réponses courantes. Rien de sophistiqué, juste un cache TTL local et la mise en cache des réponses propre de WaveSpeed pour les charges identiques.

- J’ai stocké des traces : hachage des invites, paramètres, latence, nombre de jetons et codes d’erreur le cas échéant.

Ce qui a aidé le plus était la prévisibilité. Le point de terminaison n’a pas tenté de faire un routage intelligent de ma part. Si j’ai demandé Nano Banana Pro, je l’ai obtenu. Pendant mes exécutions, la latence médiane s’est maintenue autour d’une plage stable, et la variance n’a pas grimpé pendant les heures de travail américaines autant que prévu. Pas parfait, mais plus calme que ma ligne de base.

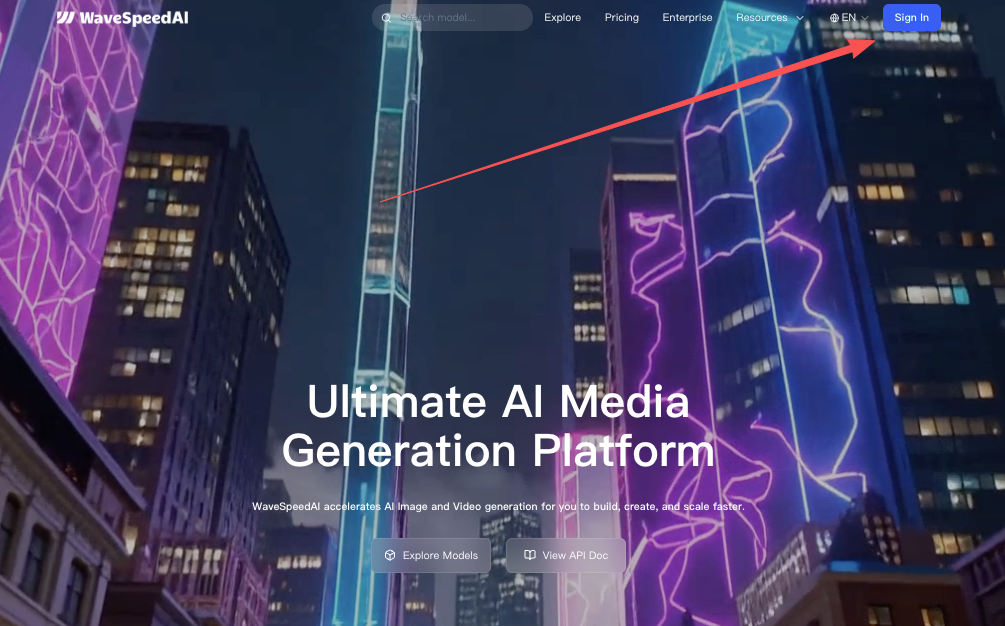

Si vous accordez plus d’importance au routage stable et à l’utilisation transparente qu’à la chasse à l’article le moins cher, essayez notre Wavespeed. Nous nous concentrons sur les points de terminaison prévisibles, l’authentification propre et la visibilité de l’utilisation qui ne nécessite pas de deviner.

Si vous accordez plus d’importance au routage stable et à l’utilisation transparente qu’à la chasse à l’article le moins cher, essayez notre Wavespeed. Nous nous concentrons sur les points de terminaison prévisibles, l’authentification propre et la visibilité de l’utilisation qui ne nécessite pas de deviner.

Un petit problème : l’option de diffusion en continu a fonctionné, mais dans mon utilisation, elle n’a pas réduit suffisamment la latence perçue pour que cela compte. Pour les textes courts, la diffusion en continu semblait être une cérémonie supplémentaire. Pour les résumés plus longs, c’était agréable mais pas nécessaire. Je l’ai laissé désactivé pour tout sauf les sessions d’examen manuel.

Paramètres clés

J’essaie de ne pas modifier les commandes sauf s’il y a une raison. Quelques-unes ont réellement compté ici.

- Sélection du modèle : Nano Banana Pro est restée cohérente pendant ma période de test (à partir de janvier 2026). Aucun échange surprise. Cette stabilité est la raison principale pour laquelle j’ai continué.

- Température : Pour l’étiquetage et la classification, je l’ai laissée près de zéro. Cela a réduit l’incohérence. Pour la synthèse de résumé avec un peu de synthèse, 0,3 à 0,4 m’a donné une formulation plus fluide sans dériver du cadre.

- Jetons max : J’ai défini des plafonds stricts pour les tâches courtes pour éviter les résultats gonflés. Pour les résumés longs, j’ai donné des limites généreuses et j’ai compté sur un nombre de caractères dur en post.

- Instruction système : Une courte instruction simple a battu les longs blocs de politique. J’ai utilisé une phrase pour définir le rôle, plus une petite rubrique pour « ne pas déduire, montrer les preuves en cas d’incertitude ». Plus j’en ajoutais, plus cela se couvrait.

- Top-p vs. température : J’ai gardé top-p fixé à 1,0 tout en poussant la température. Mélanger les deux rendait les différences plus difficiles à tracer.

Ce qui m’a surpris, c’est la sensibilité du modèle au placement des exemples. Deux exemples concrets juste après l’instruction ont fonctionné mieux que cinq mélangés tout au long. Quand j’ai déplacé les exemples à la très fin, la qualité a baissé sur les cas limites. L’API n’a pas imposé de format, mais la cohérence a payé : les mêmes noms de champs, le même ordre, la même ponctuation.

Commandes de qualité

Au-delà de la température et des plafonds de jetons, quelques coups ont changé la sensation des résultats :

- Les courtes amorces battent les longues politiques. Une intention d’une ligne + deux exemples produisirent moins d’explications excessives qu’une page de conseils.

- Les invites de preuve ont aidé. Demander « citer la phrase qui a déclenché cette balise » a considérablement réduit l’étiquetage imaginatif. Cela a aussi rendu l’assurance qualité plus calme parce que je pouvais repérer rapidement les hallucinations.

- Contraintes souples > contraintes dures. Dire « viser 3-5 puces » a mieux fonctionné que « exactement 4 puces ». Le modèle a respecté les limites sans devenir nerveux.

- Encadrement déterministe : J’ai ajouté un peu de structure à la fin, « Retour : libellé, confiance (0-1), preuve (texte) ». Cela a gardé les résultats soignés sans ressembler à une prison de schéma.

La qualité a baissé dans deux cas : les entrées OCR désordonnées et l’argot du domaine. La solution n’était pas une invitation plus intelligente. C’était juste une minuscule pré-étape : supprimer les caractères inutiles, unifier les traits d’union et lister les termes inconnus en haut comme « termes vus ». Une fois que j’ai fait cela, le modèle a arrêté de deviner des étiquettes bizarres. Cela ne m’a pas économisé du temps le premier jour, mais au quatrième passage, j’ai remarqué que je ne relisais plus autant. Moins d’effort mental compte.

Considérations tarifaires

Je n’ai pas poursuivi l’article le moins cher. Je voulais des dépenses prévisibles pour une production prévisible.

Je n’ai pas poursuivi l’article le moins cher. Je voulais des dépenses prévisibles pour une production prévisible.

Au cours de mes tests, Nano Banana Pro s’est classé dans la gamme moyenne pour le coût par mille jetons sur WaveSpeed. L’avantage tranquille était une utilisation de jetons plus cohérente. Parce que le modèle n’a pas bavardé avec la bonne forme d’invite, j’ai vu moins de pics surprise. Ma longueur de résultat moyenne pour les résumés s’est stabilisée après avoir ajouté la contrainte de puces souples.

Deux petites habitudes ont réduit les coûts sans nuire à la qualité :

- Mise en cache des invites pour les instructions récurrentes et les exemples (WaveSpeed a fait une partie : mon adaptateur a fait le reste pour que les demandes identiques court-circuitent).

- Sorties précoces pour les cas sans fonctionnement. Si l’entrée est trop courte ou manifestement non pertinente, ignorez l’appel et retournez une valeur par défaut. Cela semble évident, mais j’ai tendance à l’oublier jusqu’à ce que je voie la facture.

Si vous faites face à des charges instables, le modèle de paiement à l’utilisation avait du sens pour moi. Si votre utilisation est stable et lourde, vous pourriez envisager des crédits engagés, mais seulement après un mois de chiffres réels. Je ne m’engagerais pas d’avance sur la base d’une intuition.

Conseils de lots

J’ai exécuté deux lots hebdomadaires pendant l’essai. Quelques modèles ont aidé :

- Taille de lot petite et stable. Je me suis installé sur des chunks de 50 éléments. La concurrence était modeste (10-12). Le débit était correct et la gestion des erreurs restait saine.

- Budget de nouvelle tentative avec retrait. Une tentative rapide pour les problèmes transitoires, puis un retrait plus long, puis stationnez l’élément. Pas de boucles infinies.

- Jetons d’idempotence. Même entrée, même hachage, même clé de demande. Si une nouvelle tentative a atterri, je n’ai pas payé deux fois ou double-connecté.

- Pré-validation. J’ai rejeté les entrées manquant de champs obligatoires avant d’envoyer quoi que ce soit à l’API. Ennuyeux, mais cela a économisé du temps.

Le frottement était la transparence des limites de débit. Le tableau de bord de WaveSpeed a montré clairement l’utilisation, mais les plafonds par minute se sentaient un peu opaques pendant le pic. J’ai résolu ce problème en ajoutant un garde de moyenne mobile dans mon adaptateur et en traitant les 429 comme des signaux, pas des erreurs. Après cela, les lots ont fonctionné sans drame.

Gestion des erreurs

J’ai gardé la gestion des erreurs simple et observable, en suivant les meilleures pratiques de gestion des erreurs de l’API REST.

- Délais d’attente : J’ai défini un délai d’attente client conservateur. Si une demande durait longtemps, je l’ai marquée pour une voie de nouvelle tentative plus lente. Les demandes longues se sont souvent terminées à la nouvelle tentative : la clé n’était pas de boucher la voie rapide.

- 4xx vs 5xx : 4xx a été garé pour examen manuel sauf si c’était une limite de débit. 5xx a obtenu une courte rafale de nouvelle tentative. Cela a évité de brûler des cycles sur de mauvaises entrées.

- Garde-fous dans les résultats : J’ai demandé au modèle d’inclure toujours un score de confiance. Quand le score a baissé sous 0,6, j’ai envoyé l’élément à une file d’attente d’examen humain. Simple triage, moins de regrets.

- Enregistrement : J’ai enregistré l’invite brute et la réponse uniquement pour les cas marqués, pas tout. La confidentialité est restée plus propre et mes journaux étaient plus petits.

Il y avait quelques vrais ratés du modèle, des étiquettes confiantes mais fausses sur le sarcasme. Je n’ai pas essayé de me sortir de cela en invitant. J’ai ajouté une vérification du sarcasme comme une passe légère séparée et seulement ensuite appliqué le baliseur principal. Deux étapes, moins de désordre.

Logique de charge utile d’exemple (explication sans code)

Voici la forme de ce que j’ai envoyé, en langage clair.

- Rôle système : une phrase sur le travail. Par exemple, « Vous êtes un classificateur prudent qui étiquète la copie marketing avec un petit ensemble d’étiquettes et pointe vers les mots qui ont conduit à la décision ».

- Contexte : un petit glossaire pour tous les termes bizarres, plus deux exemples nets, un propre, un délicat.

- Instruction : ce qu’il faut retourner et dans quel ordre (libellé, confiance, preuve), et la contrainte de ton (brève, pas de langage de couverture).

- Entrée : le texte brut, non modifié sauf pour le nettoyage des espaces.

- Limites : une longueur maximale demandée pour la preuve et un plafond sur le nombre d’étiquettes.

Du côté de l’adaptateur, j’ai généré un hachage stable à partir du rôle système + exemples + instruction. Si ce hachage correspondait à une demande précédente avec la même entrée, j’ai vérifié le cache. Sinon, j’ai appelé le point de terminaison Nano Banana Pro de WaveSpeed avec la température et les plafonds de jetons définis pour la charge de travail. J’ai analysé la sortie par clés, pas par position, donc les petits changements de formulation n’ont rien cassé.

Si la réponse manquait d’une clé obligatoire, je n’ai pas demandé au modèle de se corriger en place. J’ai réémis l’invite avec un court rappel : « Retournez les trois clés uniquement ». Une nouvelle tentative max. Après cela, c’est allé à la file d’attente d’examen. Cela a empêché le système de se boucler dans un charabia.

Si la réponse manquait d’une clé obligatoire, je n’ai pas demandé au modèle de se corriger en place. J’ai réémis l’invite avec un court rappel : « Retournez les trois clés uniquement ». Une nouvelle tentative max. Après cela, c’est allé à la file d’attente d’examen. Cela a empêché le système de se boucler dans un charabia.