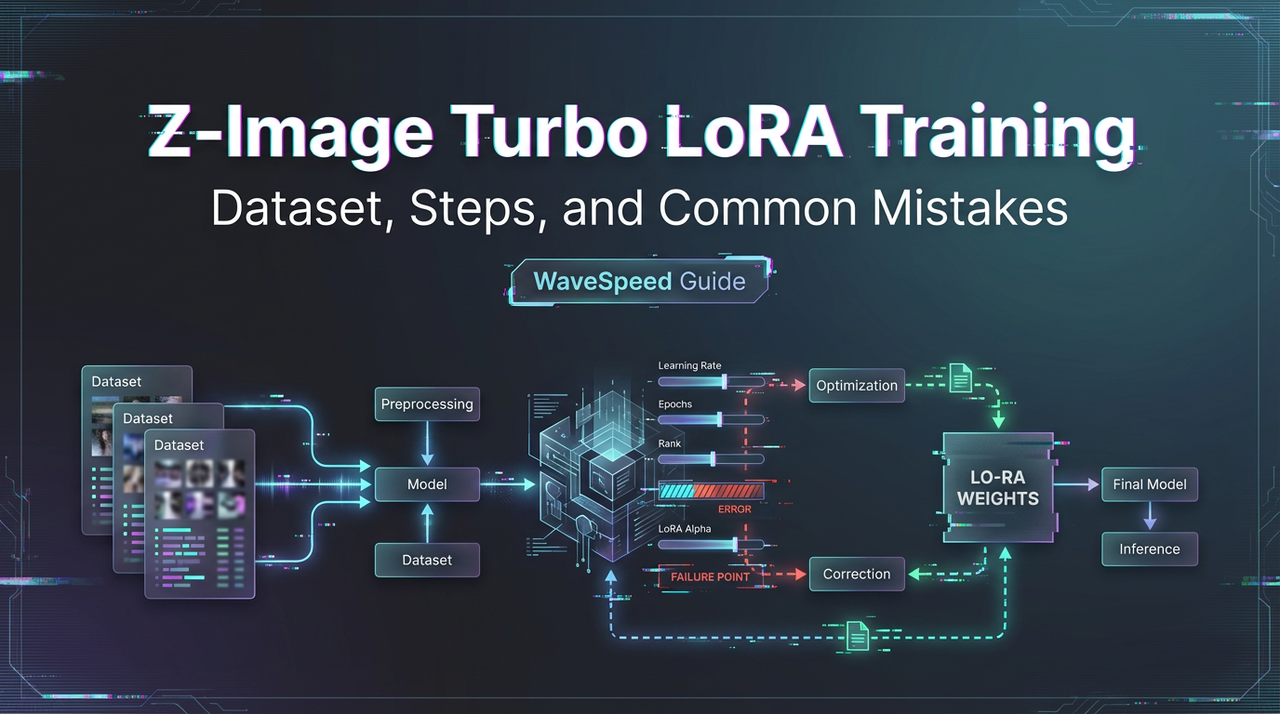

Entraîner une LoRA Z-Image Turbo sur WaveSpeed : Dataset, Étapes et Erreurs Courantes

Salut, mon ami. Je m’appelle Dora.

La semaine dernière, je voulais un petit style cohérent pour une série d’images d’en-tête. Les images de banque de données se sentaient mal, et l’ajustement manuel des prompts continuait à dériver. Alors j’ai essayé quelque chose que j’évitais depuis longtemps : un LoRA rapide sur Z-Image Turbo à l’intérieur de WaveSpeed. Je m’attendais à des paramètres compliqués et beaucoup d’essais-erreurs. Ce que j’ai obtenu était plus simple que je ne le pensais, pas sans effort, juste soigné.

Voici comment j’ai entraîné un LoRA Z-Image Turbo sur WaveSpeed sur deux soirées en janvier 2026, ce qui a fonctionné, ce qui n’a pas fonctionné, et les paramètres que je réutiliserai. Ce n’est pas un guide pour extraire chaque dernier pour cent. C’est une ligne de base stable qui a gardé mon esprit clair et les résultats prévisibles.

Voici comment j’ai entraîné un LoRA Z-Image Turbo sur WaveSpeed sur deux soirées en janvier 2026, ce qui a fonctionné, ce qui n’a pas fonctionné, et les paramètres que je réutiliserai. Ce n’est pas un guide pour extraire chaque dernier pour cent. C’est une ligne de base stable qui a gardé mon esprit clair et les résultats prévisibles.

Règles d’ensemble de données

Ce que j’ai collecté

Je l’ai gardé petit : 45 images pour un style visuel défini (assorti, lignes épurées, texture de papier douce). J’ai eu de bons résultats entre 30 et 120 images. Moins de 20 tends à surapprentissage : au-delà de 150, vous entraînez davantage un réglage fin qu’un LoRA, et l’avantage de vitesse de Z-Image Turbo commence à s’aplatir.

La diversité bat la quantité

J’ai divisé l’ensemble :

- 70 % d’images de « look de base » (le style que je veux enseigner),

- 30 % de variété de contexte (différents objets/arrière-plans pour que le LoRA ne lie pas le style à une scène).

Les angles, l’éclairage et les rapports d’aspect variaient. J’ai évité les quasi-doublons (pas trois coups du même objet avec un décalage de 5°).

Taille et format

- Résolution : 768px sur le côté court. Les modèles Turbo gèrent 1024, mais 768 a gardé l’entraînement plus léger et réduit les artefacts dans mes tests.

- Format : PNG ou JPEG haute qualité. J’ai supprimé les métadonnées. Les profils intégrés volumineux confondaient parfois légèrement la couleur.

- Recadrage : J’ai recadré pour garder le sujet dominant mais pas centré à chaque fois. La symétrie rend les modèles complaisant.

Conseils de légende

J’ai essayé deux passes : d’abord l’étiquetage automatique, puis des éditions légères. Les légendes automatiques m’ont amené à 70 %. Les 30 derniers pour cent importaient.

Gardez les légendes courtes et cohérentes

- 1–2 phrases ou une liste de tags compacte.

- Mentionnez le jeton de style (plus de détails sur les jetons ci-dessous) plus un mot de classe.

- Ne décrivez pas tout. Nommez uniquement ce qui est stable et important.

Exemple que j’ai utilisé :

- « soka-style, illustration minimaliste d’une tasse en céramique sur un bureau, texture de papier doux, palette assorti. »

- « soka-style, plante simple dans un pot en argile, contre-jour, espace négatif propre. »

Les mots de classe aident

Si vous enseignez un style, utilisez des mots de classe (illustration, photo, portrait, vue de produit). Si vous enseignez un objet/personnage, utilisez ce qu’il est (tasse, sac à dos, planificateur). Cela aide le LoRA à se généraliser. Sans mots de classe, mes premières exécutions ont fait en sorte que le LoRA s’accroche aux mises en page.

Ne pas surapprendre avec des adjectifs

J’ai supprimé les adjectifs répétés après la deuxième passe. Si chaque légende dit « chaud, confortable, doux », le modèle se verrouille sur cette ambiance même quand vous ne la voulez pas. J’ai gardé un adjectif pour le ton.

Signaux négatifs

J’ai ajouté un négatif léger dans quelques légendes où cela importait vraiment : « pas d’ombres dures ». Pas partout, juste où le contraste était mauvais dans l’image brute. Trop de négatifs l’ont rendu têtu lors de l’inférence.

Petite note : j’ai essayé d’aller sans légende pour cinq images comme test. Les résultats sont devenus un peu plus bruyants. Pas terrible, mais je ne sauterais pas les légendes si la cohérence importe.

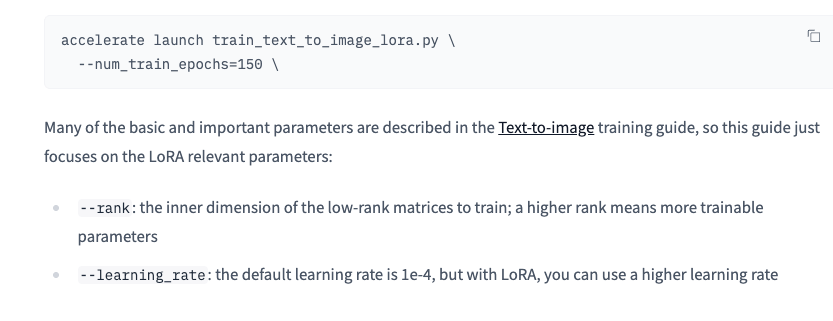

Paramètres d’entraînement de base

Voici les paramètres qui m’ont donné des résultats stables sur WaveSpeed avec Z-Image Turbo. J’ai exécuté trois entraînements courts (environ 18–22 minutes chacun sur le GPU par défaut dans mon espace de travail). Vos temps peuvent différer.

Paramètres de base que j’ai réutilisés

- Base : Z-Image Turbo (dernière version en janvier 2026)

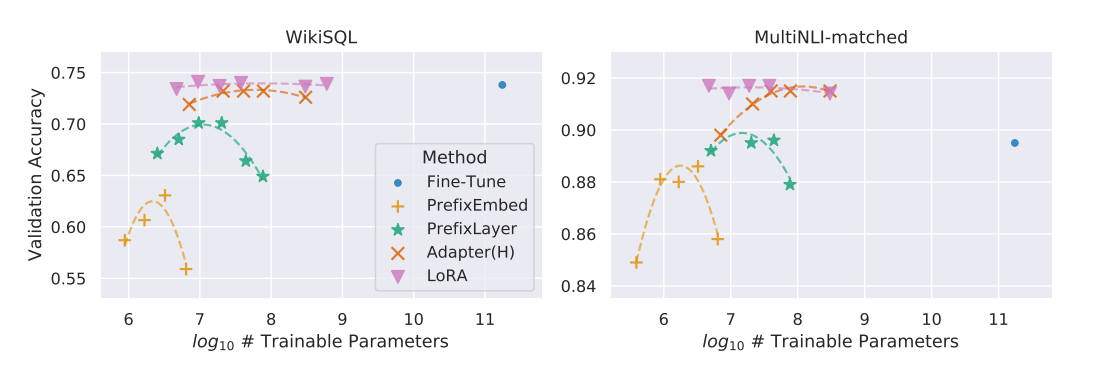

- Rang LoRA (dim) : 16 pour un style subtil : 32 quand le style a besoin de plus de punch. Je me suis installé à 16.

- Alpha : rang de correspondance (16) ou moitié (8). Je l’ai assorti.

- Taux d’apprentissage : 1e-4 pour commencer. 2e-4 si le style ne colle pas. 1e-3 trop cuit rapidement dans mes tests. La documentation d’entraînement LoRA de Hugging Face recommande de commencer par 1e-4 pour la plupart des modèles de diffusion stables.

- Taille du lot : 2–4. J’ai utilisé 4 pour garder les étapes raisonnables.

- Époque/étapes : Viser 1–2 passages complets sur les données. Pour 45 images × 10 répétitions ÷ lot 4 ≈ 112 étapes par époque. J’ai entraîné 2 époques (≈224 étapes). Plus de 3 époques ont commencé à mémoriser les arrière-plans.

- Planificateur : Cosinus ou constant avec échauffement. J’ai utilisé le cosinus avec 5 % d’échauffement.

- Précision : bfloat16 si disponible. C’était correct ici.

Images de régularisation

Avec les LoRA de style, je n’ajoute pas toujours de régularisation. Pour les objets ou les personnages, j’ajoute 50–100 images de classe (simple « tasse », « portrait ») pour garder l’anatomie et les formes honnêtes. Sur Turbo, cela a notablement réduit les feuilles bizarres en forme de mains dans les photos de plantes.

Points de contrôle et sauvegarde

J’ai activé la sauvegarde tous les 50–80 étapes. Cela m’a permis de revenir au moment le plus savoureux, qui pour mon ensemble était autour de l’étape 180. Les étapes ultérieures semblaient plus propres mais moins flexibles dans les prompts.

Si vous voulez une vérification rapide de la santé mentale : faites un premier passage de 60–90 étapes. Ce ne sera pas parfait, mais cela vous dira si votre ensemble de données enseigne la bonne leçon.

Mots de déclenchement

J’ai utilisé un jeton unique pour ancrer le style : « soka-style ». Vous pourriez utiliser quelque chose comme « kavli-ark » ou « mivva ». Court, inventé, et peu susceptible de entrer en collision avec des mots réels.

Comment j’ai écrit les légendes

- Commencez les légendes avec le jeton une fois : « soka-style, illustration minimaliste … »

- Ajoutez un mot de classe : illustration, photo, rendu, peu importe ce qui correspond.

- Gardez-le cohérent dans l’ensemble du dataset.

Comment j’ai fait les prompts

- Positif : « une photo de produit d’une tasse en céramique sur un bureau en bois, soka-style, texture de papier doux, couleurs assorties »

- Négatif : « ombres dures, grain lourd, filigrane de texte, aberration chromatique »

Quand éviter les mots de déclenchement

Si vous entraînez un objet très spécifique (une bouteille de marque, une mascotte), utilisez un jeton + mot de classe (« mivva-bottle ») dans les légendes, mais vous n’avez pas besoin de forcer le jeton dans chaque prompt d’inférence. Dans mes tests, Turbo respectait la distribution d’entraînement : parfois le mot de classe seul suffisait. Le jeton aidait quand la scène devenait complexe.

Une bizarrerie : empiler deux jetons de style a confus le modèle (« soka-style, nova-style »). J’ai obtenu un mélange trouble. Un jeton à la fois était plus propre.

Images de validation

La validation m’a sauvé de chasser des fantômes.

Graines fixes et une petite grille

J’ai défini trois prompts qui m’importent et je les ai gardés fixes entre les exécutions :

- « une tasse en céramique sur un bureau, soka-style, texture de papier doux, couleurs assorties »

- « une plante feuillue près d’une fenêtre, soka-style, contre-jour, arrière-plan propre »

- « un planificateur et un stylo, soka-style, vu de dessus, ombres douces »

- Graine : fixe (j’ai utilisé 12345). Une graine par prompt.

- Étapes : 20–28 pour Turbo. Au-delà de 30, le début sur-aiguisé.

- CFG : 3.5–6. J’aimais 4.5 pour l’équilibre.

- Échantillonneur : DPM++ 2M Karras ou une bonne variante d’Euler. Les deux se sont bien comportés.

- Taille : 768×768 pour la parité avec la culture d’entraînement.

J’ai aussi rendu le même ensemble une fois sans le jeton pour voir si le style était trop dominant. Dans ma deuxième exécution, les tasses avaient toujours l’air « papier » sans le jeton, un indice que j’avais poussé le style trop loin. La réduction du poids du LoRA à 0,6 l’a corrigé.

Si vous le pouvez, gardez un panneau de validation léger ouvert pendant l’entraînement. Regarder les mêmes trois prompts se mettre à jour est plus calme que d’examiner des échantillons aléatoires.

Correctifs

Voici ce qui s’est mal passé et ce qui l’a corrigé.

Surapprendre des arrière-plans

- Symptôme : la texture de papier identique apparaît dans des scènes non apparentées.

- Correctif : réduire les répétitions par image (de 10 à 6), ajouter 6–10 arrière-plans neutres, réduire le poids du LoRA à l’inférence (0.6–0.75).

Dérive de couleur vers le beige

- Symptôme : tout se réchauffe comme un filtre en fin d’après-midi.

- Correctif : supprimez les adjectifs répétitifs « chaud/doux/confortable » dans les légendes : ajoutez 6 images plus froides : définissez la variété de balance des blancs dans l’ensemble : ajoutez « tons excessivement chauds » au négatif.

Prompts fragiles

- Symptôme : de petits changements de prompt font s’effondrer la composition.

- Correctif : augmentez la variété de l’ensemble de données dans les types d’objets et les mises en page : entraînez avec un LR légèrement inférieur (1e-4 au lieu de 2e-4) : essayez le rang 32 si le style est complexe.

Publier et réutiliser

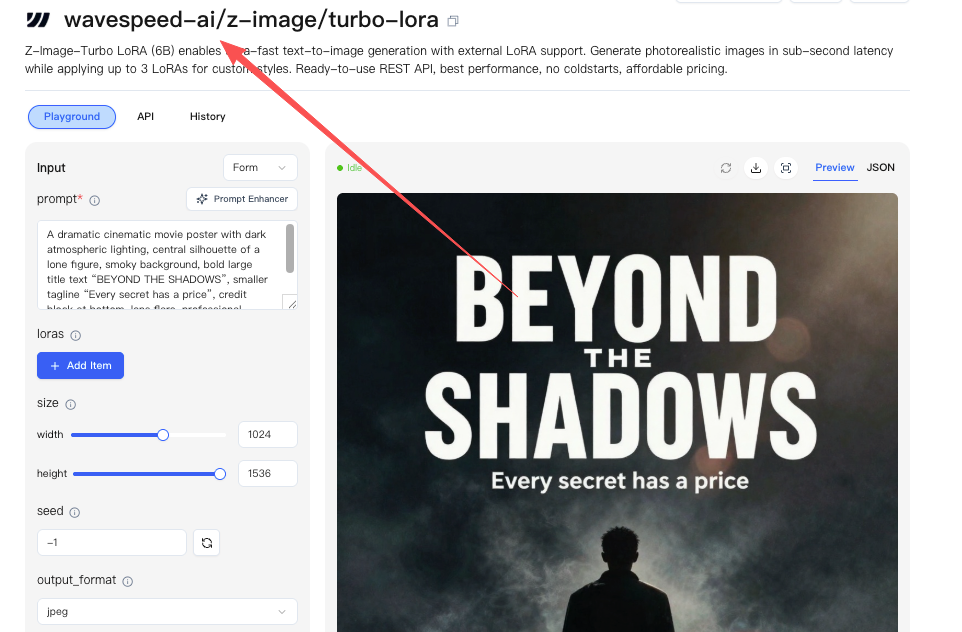

L’entraînement de ce LoRA était gérable en grande partie parce que nous avons construit WaveSpeed pour éliminer les parties ennuyeuses du processus. Au lieu de câbler des scripts ou de surveiller des GPU, je pouvais télécharger un petit ensemble de données, exécuter des entraînements LoRA Turbo courts, comparer les points de contrôle et réutiliser le modèle dans tous les projets sans casser mon flux.

Si vous êtes fatigué de la dérive de style, du surapprentissage ou de la perte de suivi de « la bonne exécution ».

→ Entraînez un LoRA Z-Image Turbo sur WaveSpeed

Quand la troisième exécution s’est sentie stable, j’ai publié le LoRA à l’intérieur de WaveSpeed avec une simple fiche modèle :

Quand la troisième exécution s’est sentie stable, j’ai publié le LoRA à l’intérieur de WaveSpeed avec une simple fiche modèle :

- À quoi ça sert : style de texture de papier subtil, palette assorti, formes épurées.

- À quoi ça ne sert pas : portraits photoréalistes, produits à haut brillant, superpositions de texte lourd.

- Paramètres qui ont fonctionné : poids 0.6–0.85, CFG ~4.5, 20–26 étapes, sortie 768.

- Deux bons prompts et une mise en garde.

- Notes de version : entraîné en janvier 2026, rang 16, LR 1e-4, ~224 étapes.

J’ai gardé la licence simple et j’ai ajouté trois images de validation. Le moi futur remerciera le moi passé pour les spécificités.

Réutiliser

- Empilage : j’aurais pu empiler ce LoRA de style avec un LoRA d’objet séparé, mais j’ai gardé seulement un style à la fois. Si vous devez empiler, gardez le poids combiné sous 1.0.

- Fusion : je ne l’ai pas cuit dans un point de contrôle. Tout l’intérêt était la flexibilité.

- Équipes : j’ai partagé le lien LoRA et les trois prompts de validation fixes. Cela a réduit les allers-retours d’examen. Les gens regardaient la même référence.

Si vous êtes nouveau sur WaveSpeed ou Z-Image Turbo, les docs officiels valent le coup d’être parcourus avant votre première exécution, surtout leurs notes sur le taux d’apprentissage et le rang. Je les ai parcourus après ma première passe et j’aurais aimé l’avoir fait plus tôt.

Vous aussi, avez-vous juré sur tout ce qui est sacré que vous « entraînieriez juste un petit LoRA », pour découvrir deux nuits plus tard que chaque image sporte un « filtre beige éternel » ou un « arrière-plan de texture forcée papier » ?

Vite, versez vos 45 images dans WaveSpeed et essayez Z-Image Turbo LoRA. Ensuite, revenez et dites-moi : cela a-t-il sauvé votre cohérence d’en-tête, ou a-t-il fait que tous vos objets se sont développé des « tentacules texturées mystérieuses » ?