WAN 2.7: Nuevas Funciones, Acceso a API y Ruta de Actualización

WAN 2.7 es la gran actualización de Alibaba: control de primer/último fotograma, I2V de 9 cuadrículas, referencia de voz y edición por instrucciones. Lo que los desarrolladores necesitan saber.

Hola a todos. ¡Soy Dora! He estado siguiendo de cerca la familia de modelos Wan desde la versión 2.1, principalmente porque una vez que un modelo comienza a ganar tracción open-source en pipelines de producción, tiende a avanzar más rápido que la cobertura informativa. WAN 2.7 todavía está llegando — con lanzamiento planificado dentro de marzo de 2026 — así que esto no es una reseña de lanzamiento. Es una lista de verificación previa al vuelo para equipos que ya ejecutan la versión 2.5 y necesitan decidir si redirigir su infraestructura o esperar.

Sin hype. Solo lo que está confirmado, lo que aún es difuso, y… lo que significa para tu cola de builds. Si todavía estás mapeando dónde encajan modelos como Wan en un stack de producción, este desglose de cómo se utilizan las herramientas de generación de video con IA en flujos de trabajo reales ayuda a fundamentar la decisión antes de profundizar en las especificaciones.

WAN 2.7 en 60 Segundos (La Versión Corta)

Si estás evaluando desde una perspectiva de producto o ingeniería: WAN 2.7 se perfila como una expansión funcional más que un salto de calidad puro. El titular no es “mejor video” — es “más superficies de control.” Las mejoras abarcan calidad visual, generación de audio y dinámica de movimiento, pero las adiciones más interesantes son estructurales: control de primer/último fotograma, I2V multi-entrada en cuadrícula 9, referencia de sujeto más voz e edición basada en instrucciones.

La diferencia respecto a 2.5 no es una resolución principal. Es el número de entradas de anclaje que el modelo ahora acepta en una sola llamada.

Novedades en WAN 2.7

Control de Video por Primer y Último Fotograma

El enfoque de primer y último fotograma permite a los usuarios definir tanto el inicio como el final de un video mediante dos imágenes, con el modelo generando automáticamente el contenido intermedio. Esto existía como modelo independiente en versiones anteriores de la serie Wan (véase Wan2.1-FLF2V-14B), pero la versión 2.7 lo integra dentro del modelo en lugar de como un checkpoint separado.

Para equipos de producción: esto importa más cuando tienes fotogramas clave definidos — una toma de producto en reposo, una toma de producto en movimiento — y deseas que el modelo interpole la transición sin una pasada de animación manual completa. Es determinista en los extremos. Lo que ocurre en el medio sigue siendo estocástico, pero tus barreras de composición están ahí.

I2V en Cuadrícula de 9 Imágenes (Multi-Entrada 3×3)

WAN 2.7 admite un enfoque de síntesis en cuadrícula 3×3, lo que significa que se pueden enviar hasta nueve imágenes de referencia como entrada estructurada para una sola tarea de generación de video. Esto es significativamente diferente del I2V de fotograma único.

La aplicación práctica: si estás generando contenido con consistencia de personaje a través de diferentes ángulos o condiciones de iluminación, ahora puedes proporcionar una cuadrícula de referencia… en lugar de un único ancla. Si estás comparando cómo diferentes herramientas manejan la consistencia de múltiples referencias, esta guía sobre las mejores herramientas de intercambio de caras en video con soporte de múltiples caras y múltiples entradas muestra dónde las soluciones actuales aún tienen dificultades. Reduce el factor de suerte en un solo intento que hace que los trabajos por lotes de I2V sean costosos de verificar en cuanto a calidad. Confirma la estructura exacta de parámetros de la API en el lanzamiento — el esquema de endpoint para entradas de cuadrícula no ha sido publicado formalmente al momento de escribir esto.

Referencia de Sujeto + Voz

WAN 2.7 te permite combinar una referencia visual de sujeto con una referencia de voz para generar videos donde tanto la apariencia como la voz del personaje son consistentes con tus entradas. Esta es una extensión de lo que Wan 2.6 introdujo con su modelo R2V — que permitía a los usuarios cargar un video de referencia de personaje con apariencia y voz, utilizando indicaciones de texto para generar nuevas escenas vívidas protagonizadas por ese mismo personaje.

En la versión 2.7, la expectativa es que esto se integre más estrechamente en lugar de ser un endpoint de modelo separado. Para equipos que construyen contenido de formato corto centrado en personajes o pipelines de localización,… esta es la función con el ROI de producción más claro — siempre que el manejo de referencias de voz sea estable bajo llamadas por lotes repetidas. Como contexto, aquí es también donde los pipelines actuales de intercambio de caras en video con IA comienzan a fallar a escala, especialmente cuando se requiere consistencia tanto de identidad como de voz.

Edición de Video Basada en Instrucciones

WAN 2.7 admite la edición de videos existentes mediante instrucciones en lenguaje natural — cambiando fondos, modificando la iluminación o alterando la vestimenta de un personaje describiendo el cambio y dejando que el modelo se encargue del resto.

Este es un cambio significativo de la generación a la edición. Para equipos de producto que ejecutan bucles de corrección en postproducción, abre una alternativa más ligera al trabajo manual de rotoscopia y composición para cambios pequeños. La incógnita clave es cómo el modelo maneja la consistencia temporal en clips más largos cuando las ediciones afectan elementos adyacentes al movimiento (ropa en un sujeto en movimiento, por ejemplo). Ahí es donde herramientas similares han degradado históricamente.

La documentación oficial de Alibaba Cloud Model Studio ya cubre endpoints de edición relacionados en la línea actual de Wan, lo que proporciona una base para el patrón de API que probablemente verás en la versión 2.7.

Recreación / Replicación de Video [Necesita Verificación]

Esta función — recrear o replicar videos existentes con cambios de estilo o sujeto preservando la estructura de movimiento — ha aparecido en resúmenes de terceros de WAN 2.7. No ha sido confirmada de forma independiente en la documentación oficial de Alibaba al momento de escribir esto. No construyas dependencias de flujo de trabajo en esta capacidad hasta que las notas de lanzamiento formales de Alibaba la confirmen. Márcala como exploratoria si estás definiendo el alcance de un proyecto de actualización ahora.

Lo Que Permanece Igual (Continuidad de Arquitectura desde 2.6)

La arquitectura DiT (Diffusion Transformer) subyacente continúa. La serie Wan utiliza un componente Transformer basado en la arquitectura mainstream de video DiT, empleando un mecanismo de Atención Completa para capturar con precisión las dependencias espaciotemporales de largo alcance, garantizando alta consistencia temporal y espacial.

Esto importa para los equipos que ejecutan inferencia local: el perfil de memoria GPU y el enfoque de cuantización no cambiarán drásticamente. Si tu stack de inferencia 2.6 está optimizado (operaciones FP8, fragmentación multi-GPU), esa inversión se mantiene. No esperes una arquitectura de implementación completamente nueva.

Acceso a la API y Disponibilidad — Lo Confirmado y lo Pendiente

Rutas de Acceso Oficiales (DashScope / Wan.video)

Los dos canales oficiales confirmados para versiones anteriores de Wan han sido la plataforma DashScope de Alibaba Cloud — que gestiona el aprovisionamiento de claves API y el acceso al modelo — y Wan.video para flujos de trabajo orientados a creadores. Se espera que ambos incluyan la versión 2.7 en el lanzamiento, aunque la disponibilidad regional (particularmente para cuentas internacionales versus China continental) debe confirmarse en el lanzamiento.

La clave API de DashScope se carga desde la variable de entorno DASHSCOPE_API_KEY, con los usuarios internacionales apuntando a dashscope-intl.aliyuncs.com — el mismo patrón casi con certeza se aplicará para la versión 2.7 dada la infraestructura establecida.

Disponibilidad de API de Terceros

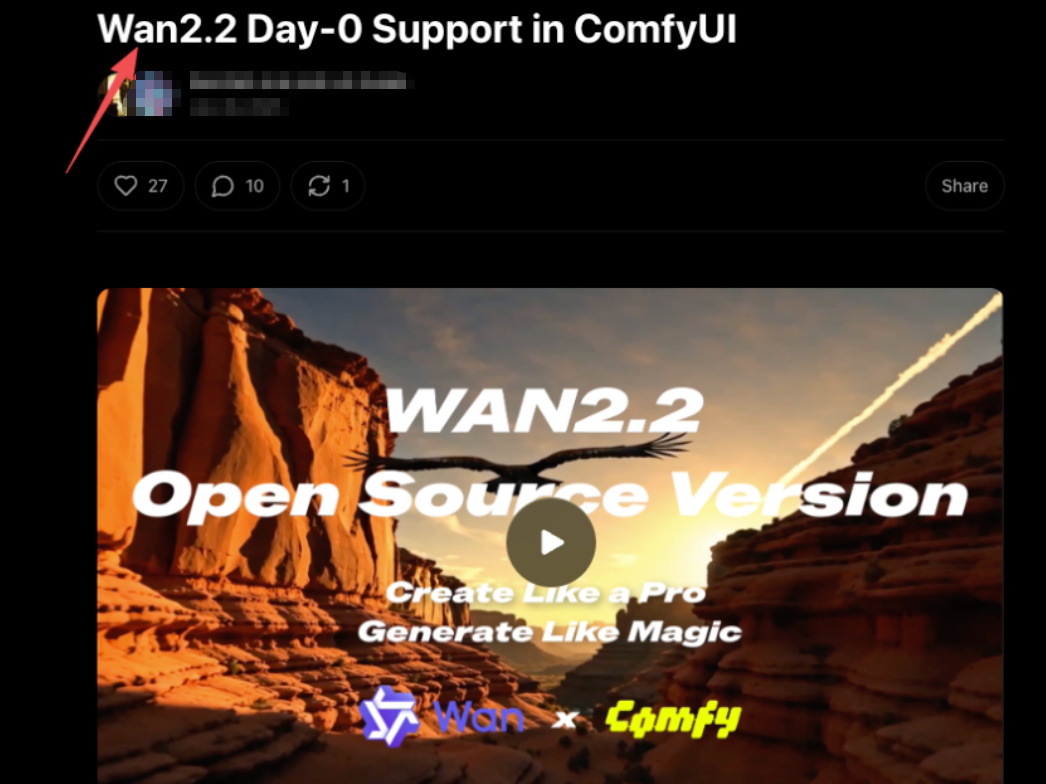

Al momento de escribir esto, WAN 2.7 aún no está confirmado en agregadores de API de terceros. Basándose en el patrón desde la versión 2.2 en adelante — donde el soporte nativo de ComfyUI llegó el día del lanzamiento para los pesos del modelo open-source — se espera que las integraciones de la comunidad sigan rápidamente si la versión 2.7 se lanza con pesos públicos.

Si la versión 2.7 se lanza como open-source en sí mismo no está confirmado. Véase las preguntas frecuentes a continuación.

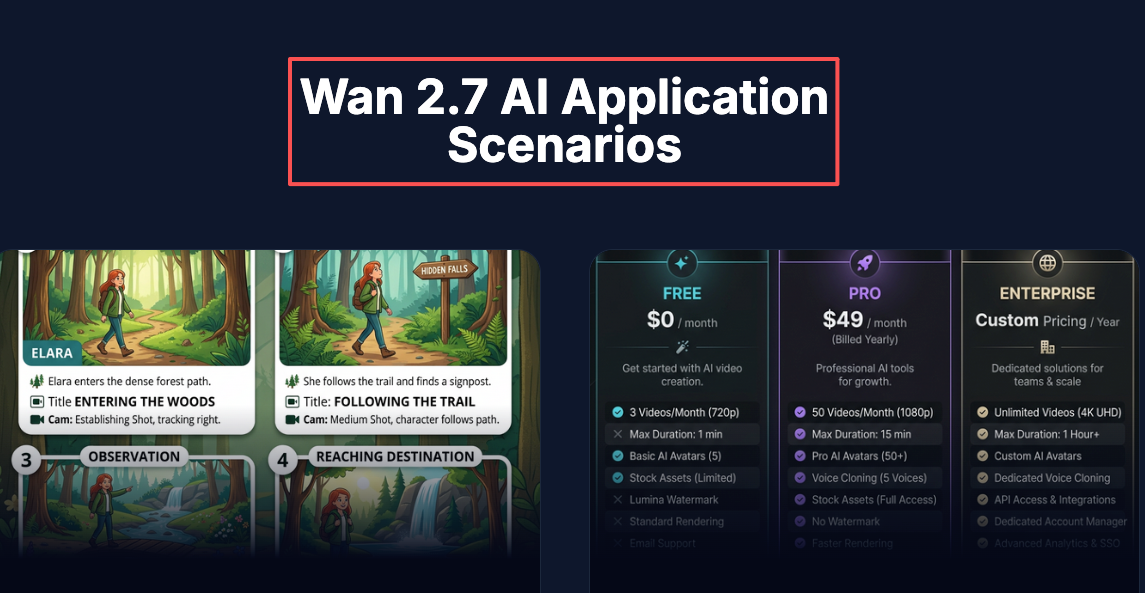

Quién Debería Priorizar WAN 2.7 Ahora Mismo

Equipos que Hacen Producción de Video con Muchas Referencias

Si tu pipeline ya depende de la consistencia de personajes a través de tomas — y has estado compensando con múltiples pasadas de generación o soluciones alternativas con ControlNet — la referencia de sujeto + voz y la entrada de cuadrícula de múltiples fotogramas son las dos funciones que más directamente reducen esa carga. Vale la pena evaluar una actualización.

Desarrolladores que Necesitan I2V con Múltiples Entradas

El I2V de imagen única funciona hasta que necesitas consistencia. La entrada de cuadrícula de 9 imágenes cambia significativamente la superficie de referencia. Si has estado agrupando soluciones alternativas para simular esto, la versión 2.7 puede consolidar múltiples llamadas a la API en una sola.

Equipos Creativos que Pueden Esperar con WAN 2.5

Si tus flujos de trabajo con la versión 2.5 son estables y las nuevas funciones no se corresponden con cuellos de botella activos en producción, no hay urgencia. El modelo todavía está lanzándose. Deja que las primeras dos semanas de retroalimentación de la comunidad saquen a la luz los casos extremos antes de replantear cualquier cosa.

Preguntas Frecuentes

- ¿Cuándo estará WAN 2.7 disponible oficialmente a través de la API? El lanzamiento está planificado dentro de marzo de 2026. La fecha exacta de disponibilidad de la API por región: aún no confirmada.

- ¿Es WAN 2.7 open-source como WAN 2.2? Sin confirmar. Wan 2.2 se lanzó bajo Apache 2.0, lo que habilitó el uso comercial y la integración con ComfyUI. Si la versión 2.7 sigue la misma licencia no ha sido declarado en los materiales previos al lanzamiento.

- ¿WAN 2.7 es compatible con ComfyUI? Aún no hay integración confirmada. Dado los lanzamientos anteriores — Wan 2.1 y 2.2 ambos tuvieron soporte de ComfyUI en el día del lanzamiento o cerca de él — se puede asumir que los nodos de la comunidad seguirán rápidamente si los pesos del modelo son públicos.

- ¿Cuál es el precio en comparación con WAN 2.5? No se ha anunciado ningún precio. La serie de modelos Wan típicamente se factura por segundo o por video a través de DashScope. Consulta los precios de Alibaba Cloud Model Studio en el lanzamiento para tarifas actualizadas.

- ¿Puedo acceder a WAN 2.7 desde proveedores de API de terceros hoy? Todavía no. El modelo no ha sido lanzado. Monitorea el GitHub oficial de Wan y la documentación de DashScope para confirmar el lanzamiento, luego verifica el soporte de las plataformas desde allí.

Qué Observar Después del Lanzamiento

Algunas cosas que vale la pena seguir mientras la versión 2.7 se estabiliza en las primeras semanas:

— Consistencia temporal en ediciones por instrucciones: La edición basada en instrucciones es la función que más probablemente se comporte de manera diferente en la práctica versus el encuadre de vista previa. Observa de cerca los resultados de la comunidad.

— Lanzamiento de pesos open-source: Si los pesos se publican públicamente, espera flujos de trabajo de ComfyUI, integración con Diffusers y variantes cuantizadas en cuestión de días. Si no, la API de DashScope sigue siendo la ruta de acceso principal — y la latencia regional se convierte en una variable real del flujo de trabajo.

— Estado de la función de recreación de video: Esta necesita una fuente oficial. No la incluyas en ninguna especificación hasta que Alibaba la confirme explícitamente.