Guía de la API LTX-2.3: 7 endpoints, opciones de acceso y uso en producción

LTX-2.3 ofrece 7 endpoints: texto a video, imagen a video, audio a video, extensión y retoma (variantes estándar y rápida). Esta guía cubre cada modo y las opciones de acceso a la API gestionada.

Hola, soy Dora. Una pequeña molestia me llevó a explorar la API de LTX-2.3 la semana pasada: seguía reconstruyendo a mano las mismas tomas explicativas de 6 a 10 segundos. Nada dramático, solo el tedio de hacerlo una y otra vez. Había visto menciones de variantes “rápidas” y endpoints de “retoma” circulando por ahí, así que reservé algunas mañanas en marzo de 2026 para probar la API de ltx-2.3 en trabajo real. Sin fanfarrias. Solo un puñado de prompts, algunas maquetas de productos y una intro de podcast a la que le había tenido demasiado cariño.

Lo que sigue no es un recorrido por las funciones. Es cómo se comportaron los endpoints de la API ltx-2.3 para mí, qué aceleró el trabajo y dónde todavía se notan los límites.

Los 7 Endpoints de LTX-2.3 de un Vistazo

Este es el mapa mental que terminé usando después de una semana de pruebas. Lo clave que noté: estos no son “funciones” separadas — son controles dentro de una secuencia. Con frecuencia esbozaba con text-to-video rápido, fijaba los prompts y luego cambiaba al estándar, o iniciaba un clip de image-to-video y lo extendía para ajustar el tiempo. La plataforma expone todo esto a través de un diseño REST API estándar, lo que evitó que el flujo de trabajo se fragmentara entre pestañas.

- Text-to-Video (estándar): el pase de calidad. Más lento, mejor consistencia de movimiento, texturas más limpias. Lo usaba cuando la toma importaba y podía esperar.

- Text-to-Video (rápido): el explorador. Lecturas rápidas sobre encuadre e ideas de movimiento, útil para dar forma a los prompts e idear en lote.

- Image-to-Video: anima un fotograma estático. Si quería que un logo “respire” en pantalla o que una maqueta cobre vida, esto era suficiente sin desviarse demasiado.

- Audio-to-Video: condiciona el movimiento con una pista de audio. No es magia de sincronización labial — más bien es como darle al modelo un metrónomo.

- Extend-Video: añade más segundos al final. La continuidad es aceptable si los prompts y semillas son estables.

- Retake-Video: regenera un segmento manteniendo las restricciones. Útil para corregir una mano temblorosa o un movimiento de cámara extraño sin empezar de cero.

- System/Utility: monitoreo de trabajos. No es glamoroso, pero es necesario.

Text-to-Video: Ventajas y Desventajas entre Variante Estándar y Rápida

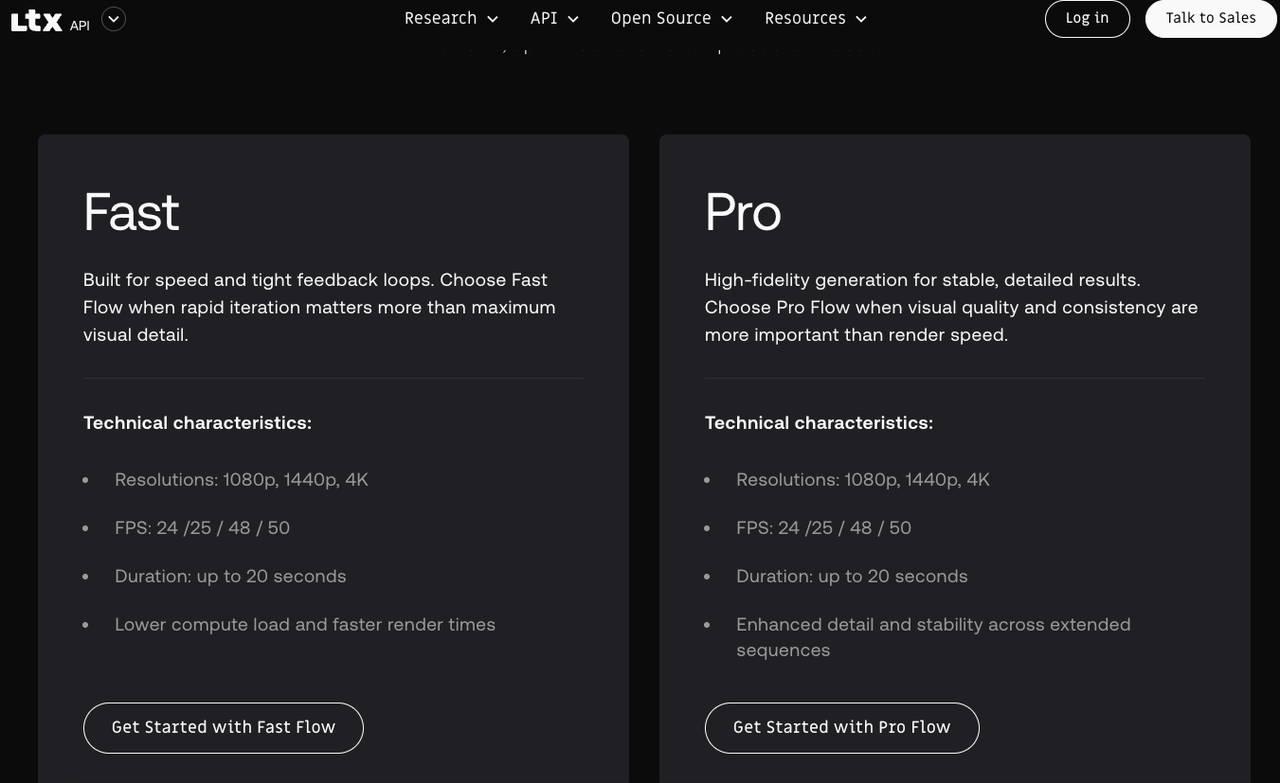

Estuve alternando entre las dos constantemente. La diferencia es simple sobre el papel — velocidad vs calidad — pero se manifiesta en detalles que importan cuando estás entregando trabajo.

- La variante rápida corría 2–4× más rápido por clip en hosts administrados. Genial para bocetos y para elegir una dirección — no tan buena para texturas finas o tipografía pequeña.

- La estándar redujo los “bordes derretidos” en manos y el parpadeo de micro-movimiento, y mantuvo la dirección de iluminación de forma más consistente entre fotogramas.

- En prompts complejos (multitudes, agua, follaje), la estándar manejó mejor el ruido temporal. La rápida a veces se veía bien a primera vista, pero resultaba “agitada” al cortarla junto a metraje real.

La verdad sin adornos: ahorré más tiempo cambiando de variante en el momento adecuado que ajustando cualquier configuración individual.

Parámetros Clave y Guía de Prompts

Algunos parámetros realmente marcaron la diferencia:

- Duración y fotogramas: Más corto es mejor. 4–8s a 16–24 fps fue el punto óptimo para un movimiento estable y tiempos de cola razonables.

- Semilla: Fíjala una vez que una dirección se sienta correcta. Las semillas hicieron las retomas y extensiones mucho menos caóticas.

- Guidance/CFG: Más bajo (4–6) dejaba respirar al modelo; más alto (7–9) cerraba el estilo pero aumentaba la uniformidad entre fotogramas.

- Indicaciones negativas: Apúntalas al movimiento, no solo a los visuales — “evitar zoom rápido,” “sin cámara giratoria,” “trípode estable.” Esto redujo los movimientos bruscos más que describir objetos.

La estructura de prompt que funcionó de forma confiable: una oración para escena y sujeto, una para cámara y movimiento, una para luz y textura. Dejé de acumular adjetivos en exceso cuando noté que compiten entre sí.

Image-to-Video: Especificaciones de Entrada y Riesgos de Artefactos

Lo usé principalmente para animar imágenes fijas —maquetas de UI, fotogramas hero de productos, marcas simples. El sistema prefería fuentes limpias: PNGs nítidos, sin compresión excesiva. El formato cuadrado o casi cuadrado funcionó mejor.

- Las indicaciones de cámara suaves (“paralaje sutil, leve movimiento de mano”) creaban vida sin destrozar la imagen.

- Mantén las capas de texto grandes — los rótulos de UI pequeños se volvían ilegibles en movimiento. Integré el texto crítico como superposiciones en posproducción.

- El arte lineal fino parpadeaba en los bordes. Un ligero desenfoque previo al procesamiento ayudó.

- Los logos se mantenían legibles si evitaba rotaciones rápidas. Para las revelaciones, dejé que el modelo hiciera una inclinación de 10–15°, y luego cortaba.

Si aparece un artefacto en los fotogramas 1–2, generalmente persiste. Regenera con una nueva semilla antes de intentar corregirlo en posproducción.

Audio-to-Video: Cómo Funciona Realmente el Condicionamiento

Entré esperando sincronización labial. Eso no es lo que hace este endpoint. Piensa en ritmo, energía y señales amplias de movimiento. Con pistas de batería, el modelo captaba los tiempos fuertes como suaves empujes de cámara. Con audio ambiental, se ralentizaba — menos agitación, más deriva.

En la práctica, traté el audio como un mapa de tempo. Para una cama ambiental de 20s, corté dos clips de 8s y uno de 4s, cada uno condicionado con la misma pista, y elegí el mejor para la continuidad. Incluso los zumbidos de baja frecuencia moldeaban el movimiento — si no quieres que la cámara “respire” en cada golpe de bajo, agrega “sin pulso rítmico de cámara” como prompt negativo.

Donde ayudó: camas de foley, ritmo musical para b-roll, correspondencia de tono. Donde no ayudó: sincronización labial, edición precisa de tiempos o escenas de diálogo.

Extend y Retake: Construir Secuencias más Largas o Corregidas

Estos dos son victorias silenciosas. Encadené dos clips de 6s en una toma de 12s extendiendo el final del primer clip con el mismo prompt, semilla y notas de cámara. El empalme no fue perfecto, pero el punto de corte quedó bien oculto bajo una pausa en la banda sonora. Si el primer fotograma de tu extensión se ve mal — detente ahí. Los malos comienzos raramente se recuperan.

Retake corrigió un paneo rápido que se coló en los últimos 2s de un clip que por lo demás estaba bien. Mantuve la guía negativa sobre el movimiento, no el contenido, y necesité entre 1 y 3 intentos en promedio. Ambos endpoints se benefician de la disciplina: fija la semilla, la duración y el lenguaje de cámara antes de perseguir micro-correcciones.

API Administrada vs Autoalojada: Ventajas y Desventajas

Probé un host administrado (interfaz estilo fal.ai) y una máquina local durante un día. La API administrada gana cuando necesitas diez variantes rápido y no quieres lidiar con controladores — pero los límites de velocidad y los costos por minuto se acumulan en ejecuciones largas. El autoalojamiento ofrece menor costo marginal y control total del procesamiento por lotes, al precio de la fricción de configuración y los dolores de cabeza con los controladores.

Una heurística simple: una docena de clips exploratorios cortos — gana el administrado. Cientos de segundos con prompts fijos — el autoalojamiento empieza a ser rentable.

Para el hardware, 24 GB de VRAM fue el mínimo cómodo para clips de 8–10s a 768p en marzo de 2026. La documentación del toolkit CUDA 12.x cubre los requisitos de controladores si estás configurando una máquina de inferencia local — fijé los controladores para evitar ralentizaciones inesperadas.

Errores Comunes de la API y Cómo Solucionarlos

- Dimensiones incorrectas: Algunos endpoints requieren dimensiones divisibles por 16. Si un trabajo falla instantáneamente, reduce al múltiplo de 16 más cercano.

- Prompts demasiado largos: Los hosts administrados recortan o agotan el tiempo en cargas JSON muy largas. Mueve las listas de estilo a frases más cortas; usa las negativas con moderación.

- Deriva de semilla entre endpoints: Cambiar de text-to-video a extend-video a veces ignoraba la semilla si olvidaba pasarla. Registra la semilla y el cfg con cada solicitud.

- Ráfagas de límite de velocidad: Escalone los envíos en lote con 200–300 ms de diferencia o usa los encabezados de concurrencia recomendados por el proveedor.

Preguntas Frecuentes

¿Cuál es la duración máxima de clip por llamada a la API?

La mayoría de los hosts administrados limitan a 4–10s a frecuencias de fotogramas comunes para mantener las colas manejables. En autoalojamiento, llegué a ~12–16s antes de que la calidad bajara. Para duraciones mayores, encadena extensiones con semillas compartidas.

¿Cuánto difiere la calidad entre las variantes rápida y estándar?

Es notable, pero no es una diferencia abismal. La rápida te da el 70–80% del aspecto en una fracción del tiempo. Si un clip va a estar junto a metraje real, termina con la estándar.

¿Se pueden aplicar adaptadores LoRA a través de la API administrada?

Depende del host. Algunos exponen presets de modelo o adaptadores de estilo; otros los mantienen tal como están. El hub de modelos de Hugging Face es el mejor lugar para verificar los slots de adaptadores disponibles y los ajustes de la comunidad antes de comprometerte con un proveedor. En local, tienes más libertad — pero también más formas de romper las cosas.

¿Qué hay de ejecutar múltiples modalidades desde una sola clave de API?

La mayoría de las plataformas multimodelo facturan por crédito y cubren los endpoints de imagen y video bajo la misma clave. Vale la pena revisar la página de precios del proveedor antes de empezar — la Especificación OpenAPI es una referencia útil para entender cómo la documentación de API bien estructurada debe presentar la cobertura de endpoints y el comportamiento de facturación.

Una Nota sobre los Estándares de Calidad de Video

Algo que vale la pena tener en mente: “alta calidad” significa cosas diferentes en contextos distintos. Para b-roll destinado a redes sociales, el modo rápido suele ser suficiente. Para cualquier cosa cortada junto a material de transmisión o cine, ayuda entender qué códecs y ciencia del color requiere la entrega final. La biblioteca de estándares SMPTE es una lectura árida, pero las especificaciones base para frecuencia de fotogramas, profundidad de bits y espacio de color son relevantes si vas a entregar clips a un colorista o una casa de posproducción.

Terminaré con una pequeña observación: cuanto más traté estos endpoints como partes de un sistema — disciplina de semillas, ejecuciones cortas, lenguaje de cámara constante — menos tuve que luchar con ellos después. No es magia. Pero unas pocas reglas simples hicieron que el trabajo se sintiera más ligero.

Artículos Anteriores:

- Obtén un inicio rápido paso a paso para integrar WAN 2.7 en tu flujo de trabajo de API

- Compara WAN 2.7 vs WAN 2.6 para entender las ventajas reales de la actualización

- Aprende cómo funciona la edición de video basada en instrucciones en pipelines de producción reales

- Descubre cómo el control del primer y último fotograma mejora la consistencia en la generación de video

- Explora cómo los escaladores de video con IA mejoran la calidad de salida después de la generación