Erschließen Sie Next-Gen-Videenerstellung mit Alibaba WAN 2.6 auf WaveSpeedAI

Da AI-Videogenerierung sich in rasantem Tempo weiterentwickelt, hebt sich WAN 2.6, das Modell von Alibaba, als eine der fortschrittlichsten Open-Source-Lösungen hervor, die heute verfügbar sind. Jetzt auf WaveSpeedAI verfügbar, ermöglicht WAN 2.6 Kreativen stärkere Erzählfähigkeiten, intelligentere referenzgesteuerte Generierung und längere, ausdrucksvollere Outputs.

In diesem Artikel heben wir die drei Kernfunktionen hervor, die WAN 2.6 definieren, und erklären, warum sie für moderne Kreative und Entwickler wichtig sind.

Funktion 1: Multi-Shot-Narativgenerierung

Die meisten Open-Source-Videomodelle generieren einen einzelnen kontinuierlichen Clip, dem oft Struktur oder Konsistenz fehlt. WAN 2.6 führt einen großen Durchbruch mit seiner Fähigkeit ein, Multi-Shot-Narrative direkt aus einfachen Prompts zu generieren.

Das Modell kann:

- einen Prompt intelligent in mehrere Kameraeinstellungen aufteilen

- visuelle Konsistenz über Aufnahmen hinweg bewahren

- wichtige Elemente wie Charakteraussehen, Umgebung, Beleuchtung und Farbe erhalten

- kinematografisches, kohärentes Storytelling ohne manuelle Szenenkontrolle produzieren

Dies macht WAN 2.6 ideal für Kreative, die ausdrucksvollere, narrative reichhaltige Videoausgaben ohne Feinabstimmung jedes Segments möchten.

Funktion 2: Referenzgesteuerte Videogenerierung

WAN 2.6 unterstützt videogesteuerte Generierung, die es Benutzern ermöglicht, das Modell mit einem Eingabevideo zu lenken.

Es kann extrahieren:

- Charakteraussehen und Gesichtszüge

- Kleidung, Stil und visuelle Details

- Sprachmerkmale, falls zutreffend

Es unterstützt:

- Menschen oder Objekte als Hauptcharakter

- einzelne Person Referenzgenerierung

- zwei Personen Co-Creation-Szenarien

Diese Fähigkeit eröffnet viele praktische Anwendungen:

- identitätskonsistente Influencer-Inhalte

- Produktdemonstrationvideos mit stabiler Erscheinung

- Animation von Objekten, Spielzeugen oder stilisierten Charakteren

- charaktergesteuerte Geschichtenerstellung mit visueller Kontinuität

Auf WaveSpeedAI wird dieser Workflow mit unserem optimierten Referenz-Upload- und identitätserhaltenden Generierungs-Pipeline noch reibungsloser.

reference1:

reference2:

Endergebnis: (“character1 is eating dinner with character 2 in a restaurant”)

Funktion 3: 15-Sekunden-Langvideogenerierung

Viele Open-Source-Modelle sind darauf beschränkt, sehr kurze Videos zu produzieren, typischerweise nur 2–5 Sekunden, was die Narrativtiefe einschränkt. WAN 2.6 durchbricht diese Schranke durch Unterstützung von Videos bis zu 15 Sekunden Länge.

Die längere Dauer ermöglicht:

- vollständigere Story-Arcs

- reichhaltigere zeitliche und räumliche Inhalte

- sanftere Actionsequenzen

- Multi-Shot-Übergänge innerhalb einer einzelnen Generierung

Diese erweiterte Kapazität macht WAN 2.6 für kinematografische Clips, Anzeigenkonzepte, kurze Geschichtenerstellung, Produktpräsentationen und kreative Prototypen geeignet.

Mit WaveSpeedAIs optimierter Infrastruktur bleiben auch die längsten Ausgaben stabil, kohärent und hochwertig.

Pro-Tipps: Erhalten Sie die besten Ergebnisse mit WAN 2.6 auf WaveSpeedAI

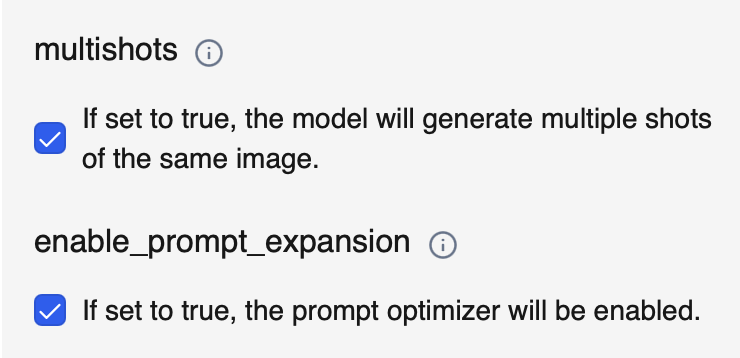

1. Aktivieren Sie “multishots” für reichhaltigere Geschichtenerzählung

Das Aktivieren von multishots ermöglicht es dem Modell, automatisch mehrere Aufnahmen basierend auf Ihrem Prompt zu generieren. Dies steigert die Narrativtiefe, verbessert die Szenenvariationen und schafft kinematografischere Sequenzen, ohne dass komplexes Prompt-Engineering erforderlich ist.

Verwenden Sie dies, wenn Sie möchten: Multi-Szenen-Geschichtenerstellung, dynamische Perspektiven oder mehr kinematografische Variation.

2. Verwenden Sie “enable_prompt_expansion” für detailliertere Ausgaben

Wenn enable_prompt_expansion aktiviert ist, erweitert unser System Ihren Input-Prompt durch Hinzufügen relevanter beschreibender Details. Dies hilft dem Modell, Ihre Absicht besser zu verstehen und polierter, kohärenter und visuell reichhaltigere Ergebnisse zu produzieren.

Verwenden Sie dies, wenn Sie möchten: klarere Kompositionen, stärkere Stilkonsistenz, oder wenn Sie das Gefühl haben, dass Ihr Prompt zu einfach ist.

Abschließende Gedanken

Alibaba WAN 2.6 bringt kraftvolle Fortschritte zur Open-Source-Videogenerierung, von Multi-Shot-Storytelling bis referenzgesteuerte Erstellung und erweiterte 15-Sekunden-Videos. Mit WaveSpeedAI’s optimiertem Workflow werden diese Fähigkeiten noch zugänglicher und effektiver für Kreative.

Besuchen Sie unsere Plattform, um WAN 2.6 selbst auszuprobieren und Ihre Ideen mit Leichtigkeit in atemberaubende KI-generierte Videos umzuwandeln.