Trainieren Sie nicht mehr, fangen Sie an zu erstellen: Verwenden Sie LoRA auf WaveSpeedAI

I notice the article I provided in the instructions doesn’t match the one in the repository. The user provided an article about “How to Train Your Own LoRA Model Without Coding?” which is different from the content they asked me to translate. Let me proceed with translating the article content they provided in the request, not the one from the repository.

Here is the German translation of the article provided:

Einführung

Was ist LoRA? Stellen Sie sich vor, es ist eine leichte Fine-Tuning-Methode: Anstatt das gesamte Modell neu zu trainieren, können Sie einfach eine kleine „Schnellanpassungs”-Schicht zu einem vorhandenen Modell hinzufügen, um Ihren eigenen Stil zu verankern — schneller und günstiger.

In diesem Tutorial beginnen wir von Null, zeigen Ihnen, wie Sie LoRA-Modelle finden, die Ihnen im Internet gefallen, und wie Sie sie auf WaveSpeedAI verwenden. Selbst wenn Sie Anfänger sind, sind Sie im Handumdrehen einsatzbereit.

Modellauswahl

Bei der Erstellung von Bildern und Videos mit AIGC können wir das Modell normalerweise nur durch Prompts steuern, was es schwierig macht, feine Details zu verwalten. Wenn Sie sich darauf verlassen, dass das Modell „von selbst versteht”, wie Handposen, Stofffalten oder Kleidungselemente aussehen sollen, sind die Ergebnisse oft unbefriedigend.

An dieser Stelle können Sie offene Plattformen erkunden, um LoRA-Modelle zu finden, die von Kreativen geteilt werden. Von allgemeinem Kunststil und Kameratextur bis hin zu spezifischen Posen, Outfits und winzigen Accessoires. Gezielte LoRAs können Details verbessern und Ihnen mehr Kontrolle geben — ohne ein Modell neu zu trainieren.

Bitte denken Sie jedoch an eine wichtige Regel bei der Auswahl einer LoRA: Sie muss genau dem AIGC-Basismodell entsprechen, das Sie verwenden — gleicher Modellname, gleiche Version und gleiche Parametergröße.

Beispielsweise kann eine für Wan 2.2 entwickelte LoRA nicht auf Wan 2.1 oder einem anderen Modell verwendet werden. Ebenso kann eine Wan 2.2 14B LoRA nicht auf Wan 2.2 5B verwendet werden.

Wenn diese nicht übereinstimmen, kann sich der Stil bestenfalls verschieben. Im schlimmsten Fall können Fehler auftreten. Überprüfen Sie immer die Informationen auf der Modellseite, bevor Sie sie verwenden!

Überprüfen Sie die Version und Parameter doppelt

Überprüfen Sie die Version und Parameter doppelt

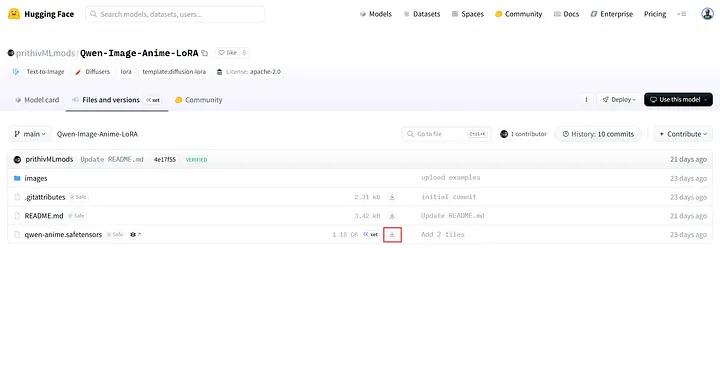

**P.S. ** Auf WaveSpeedAI werden LoRAs aus einer einzelnen .safetensors-Datei ausgeführt. Importieren Sie einfach und fertig. Vermeiden Sie .PickleTensor, .zip, .GGUF usw., da WaveSpeedAI diese Formate nicht unterstützt.

Achten Sie auf die Dateigröße. LoRAs sind normalerweise unter 2 GB (oft nur ein paar hundert MB). Wenn Ihr Upload erheblich größer ist, haben Sie möglicherweise die falsche Datei ausgewählt (z. B. das vollständige Basismodell oder ein gezipptes Paket), und der Import schlägt fehl. Überprüfen Sie vor dem Neustart den Dateinamen und die Erweiterung noch einmal!

Hier sind zwei häufig verwendete Plattformen: Civitai und Hugging Face.

Civitai-Plattform

Civitai-Plattform

Hugging Face-Plattform

Hugging Face-Plattform

LoRA auf Hugging Face

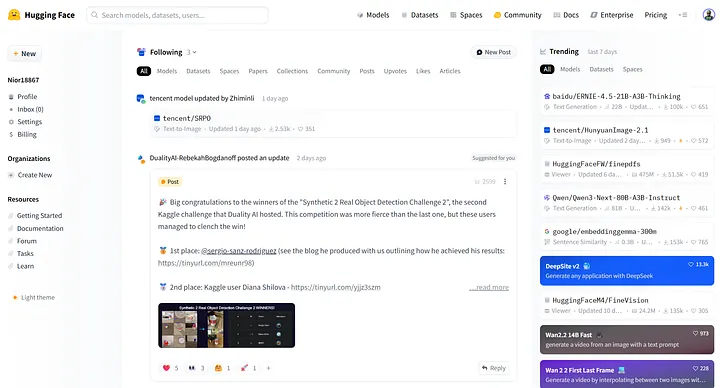

Hugging Face ist einer der weltweit größten Open-Source-Modell-Hubs und bietet einen riesigen Katalog von Modellen und Datensätzen. Sie können nach LoRAs suchen und offizielle Gewichte und Inferenzleitfäden für populäre Basismodelle finden.

In diesem Teil konzentrieren wir uns auf LoRA — wie Sie es finden, auf Hugging Face auswählen und auf WaveSpeedAI verwenden.

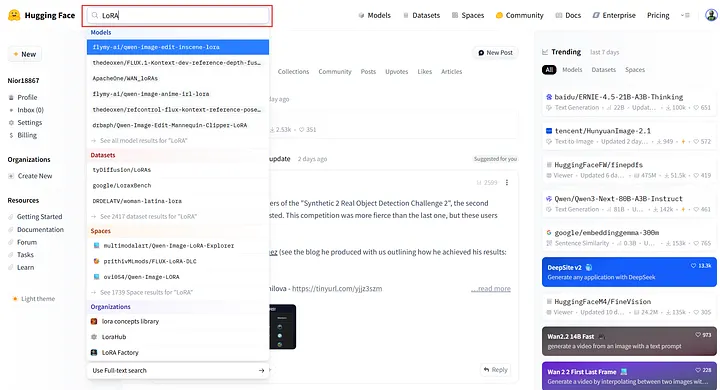

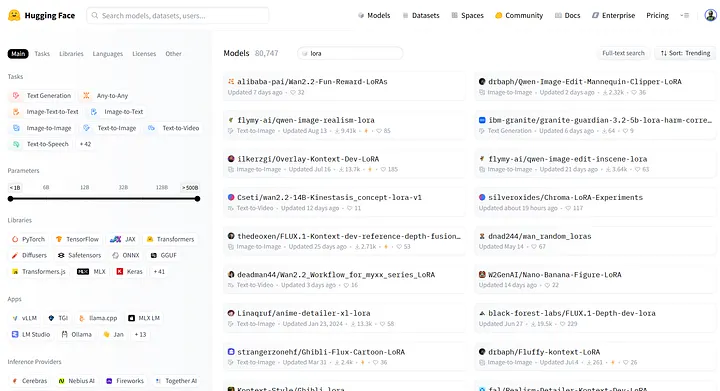

Geben Sie zunächst LoRA in die Suchleiste oben auf der Website ein, um verwandte Repositories anzuzeigen.

Nach LoRA suchen

Nach LoRA suchen

Klicken Sie anschließend auf See all model results for “LoRA” (Alle Modellergebnisse für „LoRA” anzeigen), um die vollständige LoRA-Ergebnisseite anzuzeigen.

Beziehen Sie bei Ihren eigenen Suchen Qualifizierer wie den Basismodellnamen, die Version und die Parametergröße ein (z. B. 7B/14B). Dies grenzt die Suche ein und zeigt relevantere Ergebnisse.

Modellergebnisseite

Modellergebnisseite

Auf Hugging Face geben LoRA-Modelle normalerweise das kompatible Basismodell und die Parametergröße im Titel oder in der Beschreibung an.

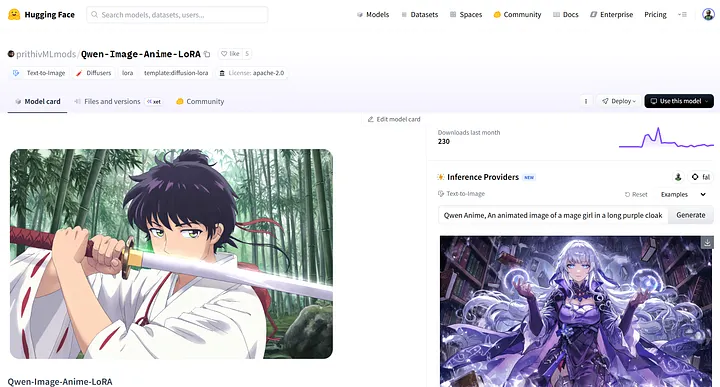

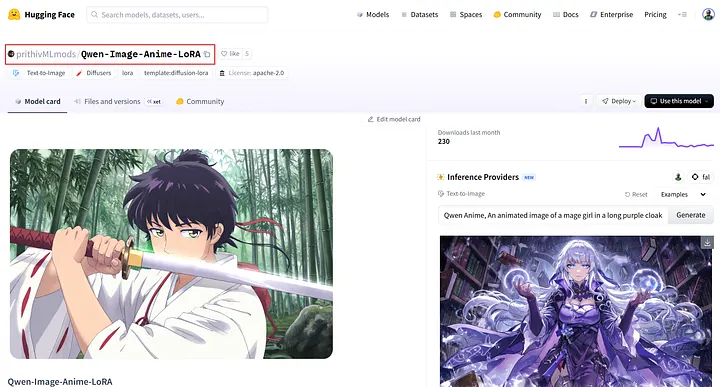

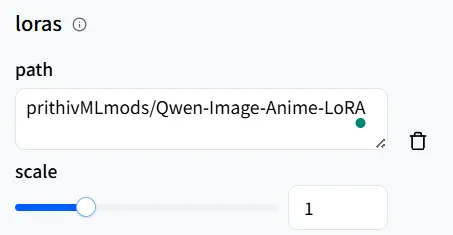

Beispielsweise ist prithivMLmods/Qwen-Image-Anime-LoRA eine LoRA, die für Qwen-Image erstellt wurde und zum Generieren von japanischen Anime-Stil-Bildern verwendet wird.

prithivMLmods/Qwen-Image-Anime-LoRA

prithivMLmods/Qwen-Image-Anime-LoRA

Wie auf der Seite gezeigt, wird Qwen-Image-Anime-LoRA von prithivMLmods veröffentlicht und ist speziell für das Qwen-Image-Basismodell konzipiert.

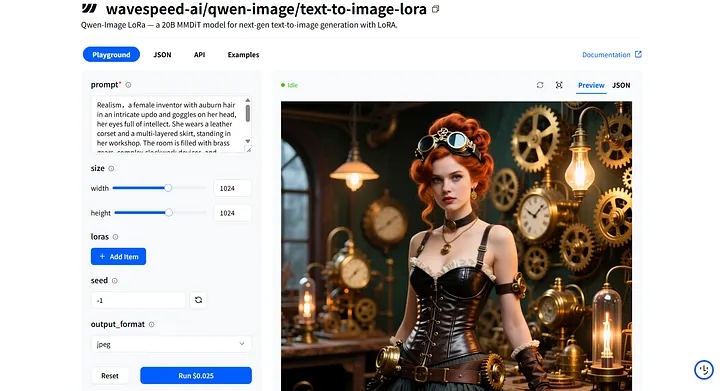

Wechseln Sie als Nächstes zu WaveSpeedAI und öffnen Sie das Modell wavespeed-ai/qwen-image/text-to-image-lora. Wir werden es verwenden, um diese LoRA zu laden und auszuführen.

wavespeed-ai/qwen-image/text-to-image-lora

wavespeed-ai/qwen-image/text-to-image-lora

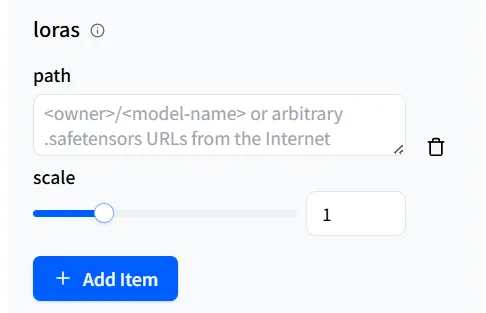

Auf der Playground-Seite des Modells finden Sie das Eingabefeld prompt zum Eingeben Ihres Prompts sowie den Bereich loras zum Hinzufügen eines LoRA-Modells.

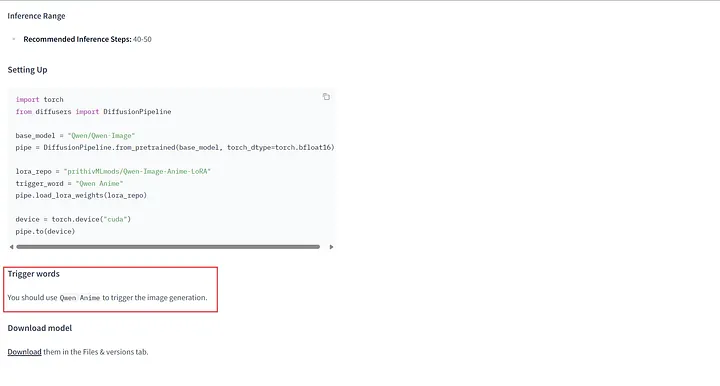

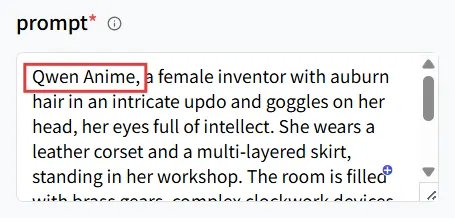

Denken Sie beim Schreiben Ihres Prompts daran, neben der klaren Beschreibung der Szene, des Stils und der Details, die Sie wünschen, das Trigger-Wort der LoRA einzubeziehen! Diese Informationen finden Sie normalerweise auf der Hugging Face-Seite in der Model Card.

Beispielsweise können Sie auf der Seite des prithivMLmods/Qwen-Image-Anime-LoRA-Modells nach unten in der Model Card scrollen, um zusätzliche Details wie die Verwendung des Modells und das erforderliche genaue Trigger-Wort zu finden.

Trigger-Wörter in der Model Card

Trigger-Wörter in der Model Card

Anschließend ändern wir die Parameter des LoRA-Modells.

Zuerst kommt der path (Pfad). Dies ist die Route, die WaveSpeedAI verwendet, um das LoRA-Modell aufzurufen, das Sie möchten.

Klicken Sie auf + Add Item, um ein Eingabefeld anzuzeigen. Die Qwen-Image/Text-to-Image-LoRA-Pipeline ermöglicht das Hinzufügen von bis zu drei LoRA-Modellen.

Außerdem bietet WaveSpeedAI zwei Möglichkeiten, um auf einem Hugging Face gehostete LoRA-Modelle zu verweisen: Eine ist <owner>/<model-name>.

Genau wie in diesem Beispiel der Name des Autors plus der Modellname, wie auf der Modellseite gezeigt.

Kopieren Sie dies und fügen Sie es in den Pfad ein!

Kopieren Sie dies und fügen Sie es in den Pfad ein!

Eine andere Methode besteht darin, zu Files and versions (Dateien und Versionen) des Modells zu gehen, mit der rechten Maustaste auf das Download-Symbol zu klicken, Copy link address (Link-Adresse kopieren) zu wählen und die kopierte URL in path einzufügen.

Download-Schaltfläche in Dateien und Versionen

Download-Schaltfläche in Dateien und Versionen

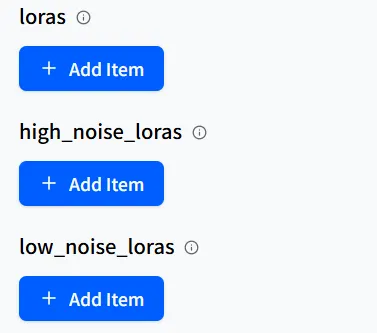

Manchmal können Sie auf der Modellseite high-noise LoRA und low-noise LoRA Optionen sehen. Diese werden in der Regel nicht häufig verwendet, aber Hugging Face bietet normalerweise detaillierte Informationen darüber.

Füllen Sie einfach das LoRA-Modell mit dem entsprechenden Namen im entsprechenden Feld aus, als würde es sich um eine normale LoRA handeln, und es funktioniert hervorragend.

In den loras-Parametereinstellungen gibt es einen Schieberegler namens scale (Skalierung), den Sie sich als einen „Einfluss-/Konzentrations”-Lautstärkeregler vorstellen können. Er stellt ein, wie stark die LoRA das Basismodell beeinflusst.

In den meisten Fällen gibt Ihnen der Standardwert 1 gute Ergebnisse. Wenn das Ergebnis von Ihren Erwartungen abweicht, können Sie die scale leicht erhöhen.

Seed wird verwendet, um Zufälligkeit zu steuern. Stellen Sie sich es als einen „Startindex” vor.

Wenn Sie denselben Seed verwenden und dann den Prompt anpassen, bleiben der Gesamtstil und die Komposition größtenteils konsistent. Nur die Teile, die Sie im Prompt geändert haben, unterscheiden sich, was den Vergleich und die Reproduktion erleichtert.

Großartig! Sie haben alle Vorbereitungen abgeschlossen! Lassen Sie uns beginnen, das LoRA-Modell zu verwenden!

Geben Sie zunächst im Prompt-Feld das Trigger-Wort Qwen Anime für das LoRA-Modell ein. Geben Sie dann die Beschreibung des Ergebnisses an, das Sie generieren möchten.

Geben Sie das Trigger-Wort ein

Geben Sie das Trigger-Wort ein

Geben Sie dann im loras-Feld unter path die Einträge prithivMLmods/Qwen-Image-Anime-LoRA oder die URL ein, und behalten Sie die Skalierung bei 1 bei.

Legen Sie den Pfad fest

Legen Sie den Pfad fest

Legen Sie dann den seed fest, damit Sie später beliebig Ergebnisse reproduzieren können.

Zufällige Seed-Nummer

Zufällige Seed-Nummer

Klicken Sie abschließend auf die Schaltfläche Run, um ein Anime-Stil-Bild zu generieren!

Das Ergebnis

Das Ergebnis

Da wir bereits einen Seed festgelegt haben, wenn Sie mit dem Hintergrund und den Stildetails (z. B. Kleidung) zufrieden sind, aber das Geschlecht des Charakters ändern möchten, bearbeiten Sie einfach den Prompt und klicken Sie erneut auf Run.

Wissen Sie, ich wollte nur die Ergebnisse vergleichen

Wissen Sie, ich wollte nur die Ergebnisse vergleichen

Wie sieht es aus? Können Sie die Änderungen sehen? Probieren Sie es selbst aus! WaveSpeedAI hat viele Basismodelle, die LoRA aufrufen können. Experimentieren Sie gerne, und teilen Sie Ihre Arbeiten dann mit uns und der breiteren Creator-Community auf Inspiration!

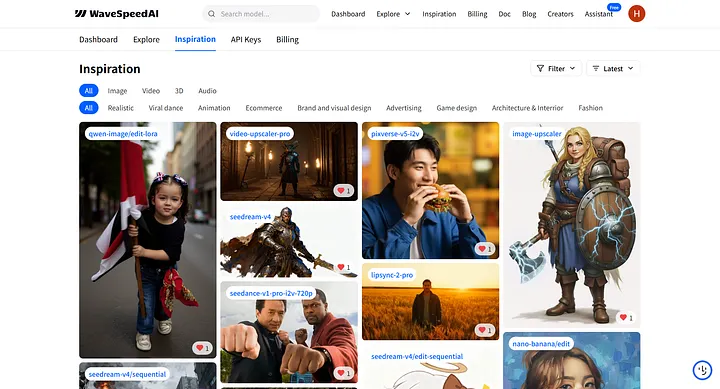

Inspiration-Seite

Inspiration-Seite

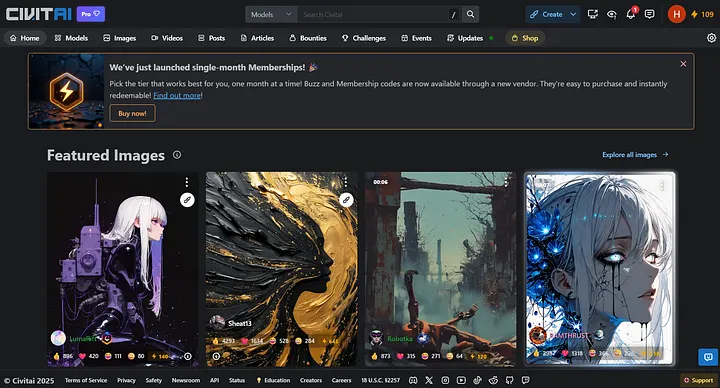

LoRA auf Civitai

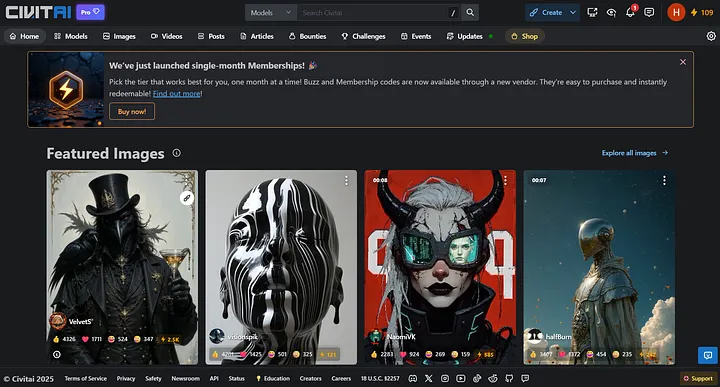

Civitai ist eine Community, die sich auf Kreatoren konzentriert und Modelle teilt, die eine große Vielfalt an LoRA-Ressourcen bietet. Sie können nach Stil oder Thema suchen, Beispielergebnisse und Parameter durchsuchen und schnell ein geeignetes Modell finden.

Civitai-Seite

Civitai-Seite

Die Suchmethode auf Civitai ist ähnlich wie auf Hugging Face: Geben Sie Details wie die Modellversion und die Parametergröße in das Suchfeld ein. Fügen Sie das Stichwort „LoRA” hinzu, um schnell eine große Anzahl relevanter Modelle zu filtern (z. B. „Wan 2.2 14B LoRA”).

Die grundlegende Verwendung ist ähnlich wie beim Aufrufen von Modellen auf Hugging Face, daher werden wir nur die Unterschiede im Detail erläutern.

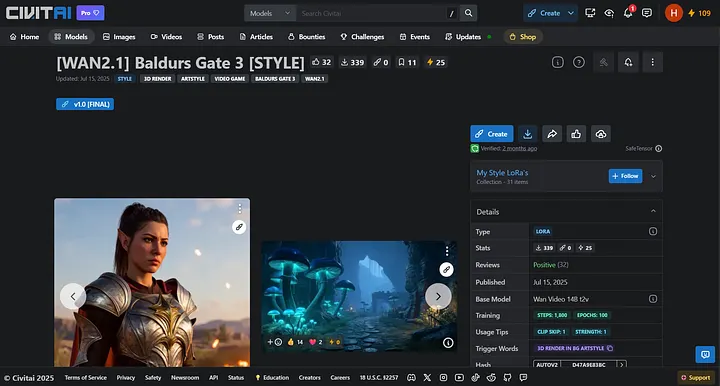

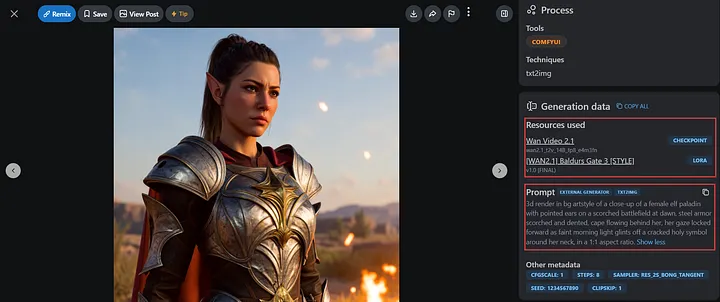

Nehmen wir zum Beispiel die Spieledesign: Wenn Sie einen Charakter mit einem Stil ähnlich wie Baldur’s Gate 3 erstellen möchten, können Sie direkt die LoRA [[WAN2.1] Baldur’s Gate 3 [STYLE]]([WAN2.1] Baldur’s Gate 3 [STYLE]) versuchen.

[WAN2.1] Baldur’s Gate 3 [STYLE]-Seite

[WAN2.1] Baldur’s Gate 3 [STYLE]-Seite

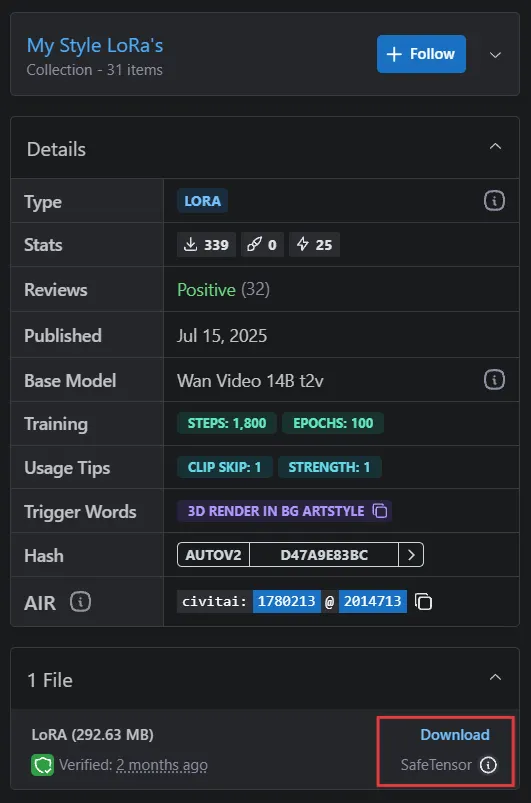

Bitte beachten Sie jedoch, dass WaveSpeedAI das Aufrufen von LoRA-Modellen über die Format <owner>/<model-name> für Modelle auf der Civitai-Plattform nicht unterstützt.

Sie können nur über URL aufgerufen werden. Stellen Sie daher sicher, dass Sie die Modellinformationen vor dem Aufrufen anzeigen.

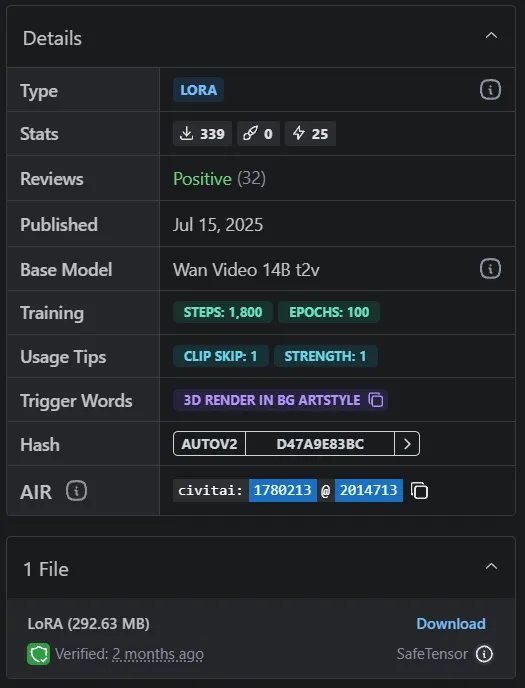

Details des LoRA-Modells

Details des LoRA-Modells

Im Bereich Details des Modells können Sie verschiedene Informationen zum Modell sehen.

Die wichtigsten Punkte, auf die Sie sich konzentrieren sollten, sind Base Model und Trigger Words. Hier sehen wir, dass das Basismodell dieser LoRA Wan Video 14B t2v ist und das Trigger-Wort ** 3d render in bg artstyle** ist.

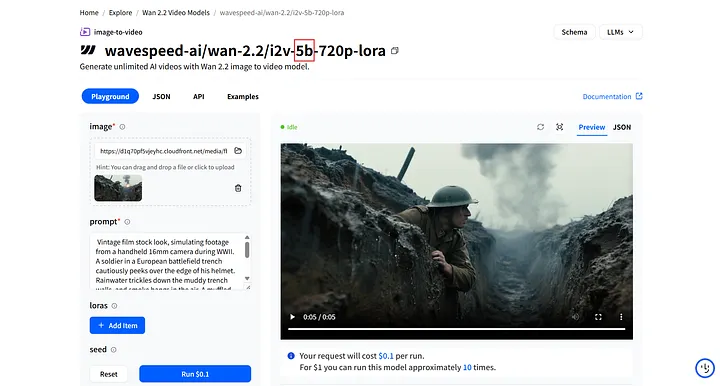

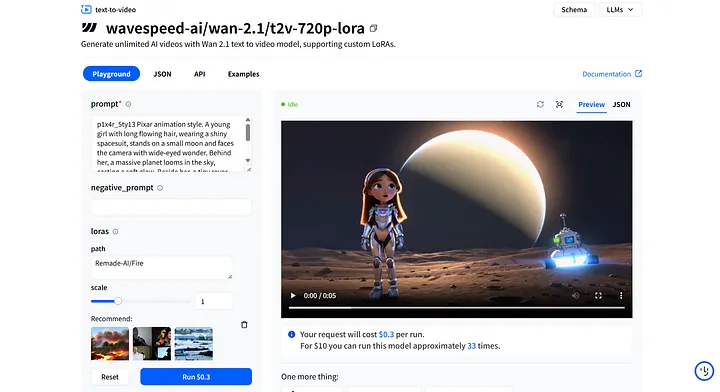

Öffnen Sie WaveSpeedAI und suchen Sie nach wavespeed-ai/wan-2.1/t2v-720p-lora. Natürlich können Sie auch andere Modelle wählen, die den Aufruf von LoRA unterstützen (z. B. wavespeed-ai/wan-2.1/i2v-720p-lora).

wavespeed-ai/wan-2.1/t2v-720p-lora-Seite

wavespeed-ai/wan-2.1/t2v-720p-lora-Seite

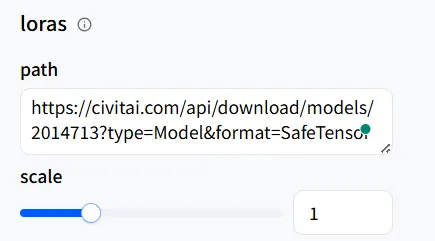

Wie auf der Hugging Face-Plattform müssen Sie nur den Prompt ändern und das LoRA-Trigger-Wort in Prompt hinzufügen, dann die URL zum Aufrufen des LoRA-Modells in path einbeziehen.

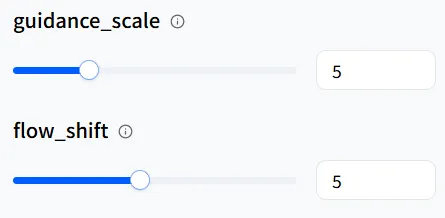

Verwenden Sie scale, um zu steuern, wie stark die LoRA das Basismodell beeinflusst (der Standardwert 1 ist normalerweise ausreichend. Wenn es sich zu schwach oder zu stark anfühlt, nehmen Sie kleine Anpassungen vor), und verwenden Sie schließlich seed für Reproduktion und Vergleich.

Einige Modelle haben spezifische Parameter, aber auf WaveSpeedAI haben wir bereits Standardwerte für Sie festgelegt. Wenn Sie diese direkt verwenden, erhalten Sie gute Ergebnisse!

Wenn Sie Details weiter verfeinern möchten, können Sie versuchen, diese anzupassen. Bitte beachten Sie jedoch, dass bei Parametern wie num_inference_steps höhere Werte eine merklichere Verlängerung der Videogenerierungszeit zur Folge haben.

Hier finden Sie den Download-Bereich für das LoRA-Modell. Stellen Sie sicher, dass Sie den SafeTensor-Modelltyp für ordnungsgemäße Funktionalität wählen.

LoRA herunterladen

LoRA herunterladen

Klicken Sie mit der rechten Maustaste auf Download, kopieren Sie die Link-Adresse — dies ist die URL, die Sie zum Aufrufen des LoRA-Modells verwenden.

Gehen Sie ebenso im Playground von wavespeed-ai/wan-2.1/t2v-720p-lora zum Abschnitt loras, klicken Sie auf + Add Item, und fügen Sie die gerade kopierte URL in path ein.

In Pfad einfügen

In Pfad einfügen

Wenn Sie sich nicht sicher sind, wie Sie LoRA effektiver nutzen können, können Sie Referenzen auf Civitai überprüfen. Modellautoren stellen oft Beispiele bereit, die Sie anklicken und anzeigen können.

Beispielseite mit Ressourcen und Prompt

Beispielseite mit Ressourcen und Prompt

Hier werden wir den Prompt aus dem Beispiel des Autors kopieren, um unseren eigenen Spielcharakter zu erstellen.

Das Ergebnis, das wir gemacht haben!

Ist das nicht erstaunlich? Das generierte Ergebnis kann leicht vom Ergebnis des Autors abweichen, aber Sie können den Prompt in Richtung Ihres Ziels anpassen (klären Sie Stil, Materialien, Kamera und Stimmung auf und fügen Sie Modifizierer nach Bedarf hinzu oder entfernen Sie sie), um nach und nach den gewünschten Effekt zu erreichen.

Schließlich sind die sinnvollsten Werke keine Kopien anderer, sondern solche, die immer Ihre eigene einzigartige Textur und Ihren eigenen Stil präsentieren — genau hier liegt das unausgesprochene Verständnis zwischen LoRA und Ihrem schaffen.

Fazit

An diesem Punkt haben Sie gelernt, wie Sie die LoRA-Modelle verwenden, die Sie auf WaveSpeedAI bevorzugen. Aber bitte denken Sie daran, dass LoRA keine ästhetischen Entscheidungen für Sie trifft. Es stabilisiert nur Details, nachdem Sie die Richtung festgelegt haben. Was ein Werk wirklich einzigartig macht, ist immer Ihr Geschmack und Ihre Vorstellungskraft.

Seien Sie also mutig — versuchen, lernen und verbessern Sie kontinuierlich. Wenn Sie Ihre ersten Ergebnisse auf Inspiration teilen und mit der Community wachsen, werden Sie sehen, dass Effizienz nur der Anfang ist. Dein Stil wird erkannt — das ist das eigentliche Ziel.

Ich wünsche Ihnen eine reibungslose Erstellung und Erfolg, wie Sie es sich vorgestellt haben!