Inworld TTS 1.5 ist jetzt live auf WaveSpeedAI (Max + Mini)

WaveSpeedAI unterstützt jetzt Inworld TTS 1.5, eine produktionsreife Echtzeit-Text-zu-Sprache-Engine, die für niedrige Latenz, hohe Ausdrucksstärke und Skalierbarkeit entwickelt wurde.

WaveSpeedAI unterstützt jetzt Inworld TTS 1.5, eine produktionsreife Echtzeit-Text-to-Speech-Engine, die für geringe Latenz, hohe Ausdrucksstärke und Skalierbarkeit entwickelt wurde.

Wenn Sie Sprachagenten, Echtzeit-Assistenten, Spieler-NPC-Dialoge oder andere interaktive Sprach-UX entwickeln, bei denen jede Millisekunde zählt, geht es bei dieser Integration um eine Sache: eine reaktionsschnelle, natürliche Spracherfahrung zu liefern – ohne Abstriche bei Zuverlässigkeit oder Kosten im großen Maßstab.

Co-Marketing-Hinweis: Wir werden ab Dienstag, dem 10. Februar 2026 (Dienstag, 2:00 Uhr) eine gemeinsame Promotion mit Inworld durchführen – wenn Sie also Echtzeit-Sprache für Ihr Produkt evaluieren, ist dies die beste Woche, um es von Anfang bis Ende auszuprobieren.

Warum das wichtig ist: erstklassige Qualität + Echtzeit-Latenz

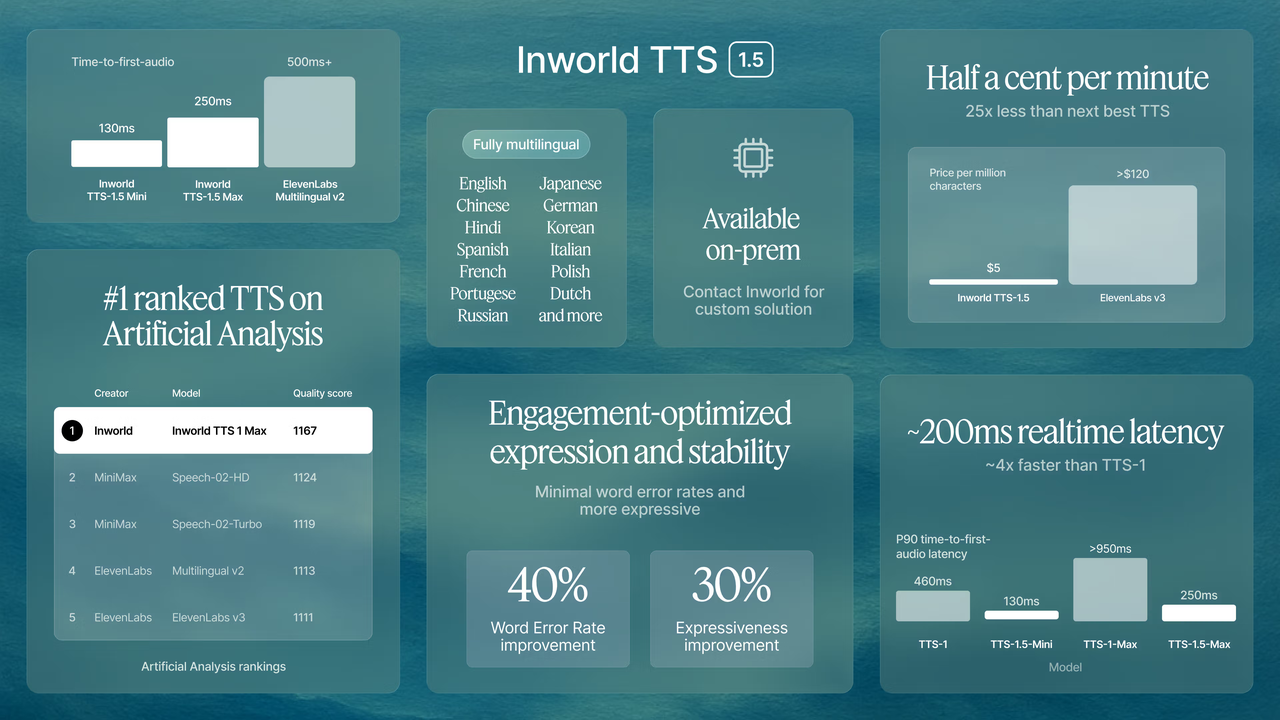

Inworldsdie neueste TTS-Linie positioniert sich rund um messbare Drittanbieter-Benchmarks – insbesondere unabhängige Leaderboard-Performance und Echtzeit-Reaktionsfähigkeit.

- Erstplatzierungssignal (Qualität): Inworld TTS ist auf Artificial Analysis’ TTS-Vergleichen an der Spitze gelistet, die Qualität (ELO) zusammen mit Geschwindigkeit und Preis verfolgen.

- Echtzeit-Streaming: Inworld hebt Echtzeit-Streaming via WebSocket hervor, mit Modellvarianten, die auf unterschiedliche Latenz-/Qualitätskompromisse abzielen.

Kurz gesagt: Entwickler wollen nicht nur „gute Stimmen” – sie wollen gute Stimmen, die sofort reagieren und unter Last nicht zusammenbrechen.

Max vs. Mini: Welches Modell sollten Sie wählen?

WaveSpeedAI bietet zwei Produktionsoptionen:

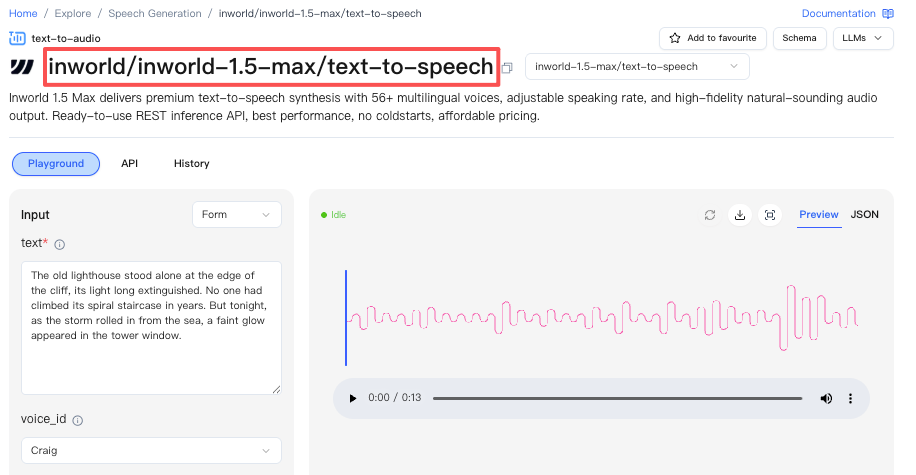

TTS 1.5 Max (empfohlen für die meisten Apps)

Wählen Sie Max, wenn Ihre Priorität die beste Gesamtstimmqualität, Stabilität und Ausdrucksstärke ist, während die Latenz im Echtzeit-Bereich bleibt (Inworld beschreibt eine Leistung der ~200-ms-Klasse für Max).

Typischer Einsatz:

- Sprachagenten, bei denen Natürlichkeit entscheidend ist

- Kundensupport / Enterprise-UX

- Content-Narration, bei der ein „menschlicher” Ton überzeugt

WaveSpeedAI-Endpunkt: https://wavespeed.ai/models/inworld/inworld-1.5-max/text-to-speech

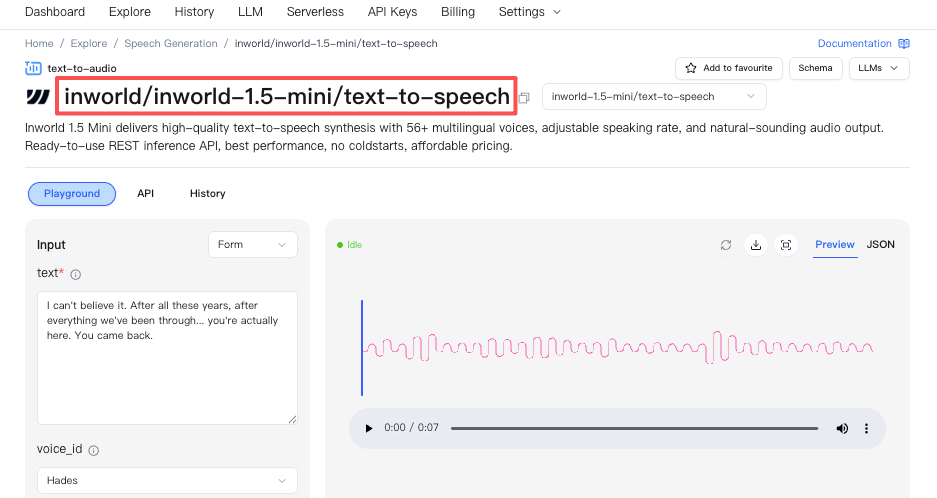

TTS 1.5 Mini (wenn Latenz der wichtigste KPI ist)

Wählen Sie Mini, wenn Ihre Priorität ultrageringe Latenz für sofortigen Sprecherwechsel ist (Inworld beschreibt <120 ms P90-Latenz für Mini).

Typischer Einsatz:

- Echtzeit-NPC-Dialog in Spielen

- Live-Avatare / Streaming-Interaktionen

- Jedes Produkt, bei dem Reaktionszeit wichtiger ist als Klangtreue

WaveSpeedAI-Endpunkt: https://wavespeed.ai/models/inworld/inworld-1.5-mini/text-to-speech

Was Sie jetzt bauen können (echte Anwendungsfälle)

Hier sind die Muster, bei denen Teams am schnellsten liefern:

Echtzeit-Sprachagenten (S2S / Sprecherwechsel) Synthese mit geringer Latenz und Streaming sorgt dafür, dass sich das Gespräch „lebendig” anfühlt – besonders wenn Sie es mit einem LLM und einer unterbrechbaren Audio-Pipeline kombinieren.

Sprach-Copiloten im Kundensupport Wenn Sie einheitlichen Ton, hohe Verständlichkeit und Kostenkontrolle benötigen, darf die „Sprachschicht” nicht zum Engpass werden. Inworld bietet außerdem Voice-Cloning-Optionen für gebrandete oder individuell angepasste Stimmen.

Spiele & interaktive Charaktere Kurze Antworten, viel Parallelität und unvorhersehbare Spitzen – hier ist die Infrastruktur genauso wichtig wie das Modell.

Schnellstart: Inworld TTS 1.5 auf WaveSpeedAI aufrufen

Verwenden Sie die Modell-Endpunkte direkt:

Implementierungstipps (produktionsorientiert):

- Bevorzugen Sie WebSocket-Streaming, wenn Sie Echtzeit-Wiedergabe und engen Sprecherwechsel benötigen.

- Wenn Sie einen Sprachagenten entwickeln, planen Sie für Unterbrechungen (Barge-in) und partielle Audio-Wiedergabe, anstatt auf die vollständige Wellenform zu warten.

- Wenn Sie Alignment-Funktionen wie Zeitstempel / Audio-Markierungen benötigen, planen Sie Ihre Client-Wiedergabeschicht so, dass diese Signale verarbeitet werden (ideal für Karaoke-ähnliches Highlighting, Untertitel oder UI-Synchronisation).

FAQ

Unterstützen Sie WebSocket-Streaming? Ja – Inworld positioniert TTS 1.5 für Echtzeit-Streaming via WebSocket, und das ist der empfohlene Weg für interaktive Sprach-UX.

Wie viele Sprachen werden unterstützt? Inworld bewirbt mehrsprachige Unterstützung; WaveSpeedAI stellt die Modelle bereit, sodass Sie mehrsprachige Erlebnisse über dieselbe Integrationsoberfläche erstellen können. (Welche Sprachen genau unterstützt werden, hängt vom ausgewählten Modell/Version ab.)

Ist Voice Cloning verfügbar? Inworld bietet Voice-Cloning-Funktionen an (mit verschiedenen Stufen/Abläufen je nach Cloning-Typ).