Z-Image LoRA: Was es bedeutet und wann man es braucht (Anfängerfreundlich)

Hallo zusammen, ich bin Dora. Letzte Woche hatte ich nicht geplant, etwas zu trainieren. Ich wollte nur einen konsistenten kleinen Helfer – eine illustrierte Figur, die in der Ecke meiner Screenshots sitzt. Mit Prompts bin ich der Lösung nahekommen, bin aber dann wieder abgedriftet. Augenbrauen haben sich verändert. Farben sind verrutscht. Am Dienstag (13. Januar 2026) habe ich nach ein paar knappen Versuchen Z-Image LoRA ausprobiert. Ich rechnete mit einem komplizierten Prozess. Es war eher wie ein kurzer Flur.

Das ist kein Siegeszug. Es war nicht sofort möglich. Aber die Einrichtung hat so viel Reibung abgebaut, dass ich aufgehört habe, über Einstellungen nachzudenken und angefangen habe, über meine Bilder nachzudenken. Hier ist, was funktioniert hat, was nicht, und wann man wahrscheinlich gar keine LoRA braucht.

Z-Image LoRA in einer Minute

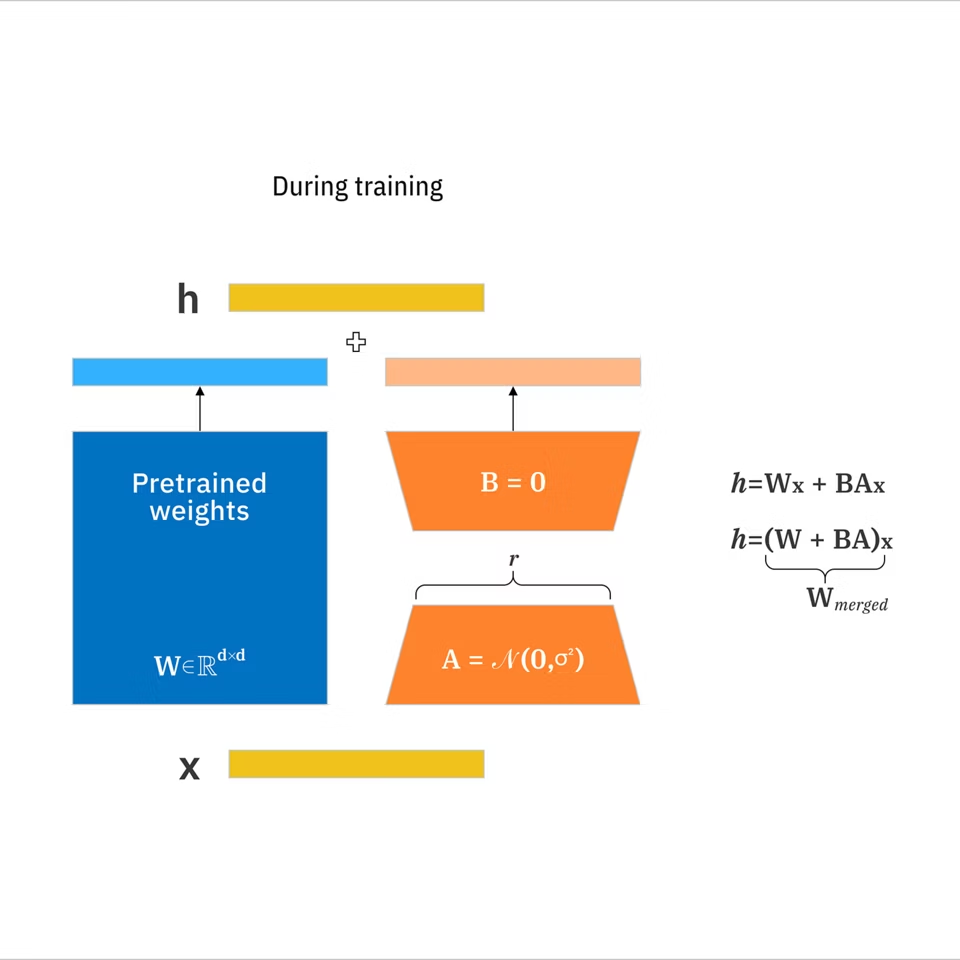

Eine LoRA (Low-Rank Adaptation) ist ein kleines Add-on, das man auf einem Basis-Bildmodell trainiert, um es in Richtung eines bestimmten Stils oder Motivs zu schieben, ohne das gesamte Modell neu zu trainieren.

Was Z-Image LoRA (anfängerfreundlich) gut macht:

Was Z-Image LoRA (anfängerfreundlich) gut macht:

- Versteckt die komplizierten Regler. Du wählst immer noch ein paar Grundlagen (Bilder, Beschriftungen, Ziel), aber die Standardwerte sind sinnvoll.

- Trainiert schnell genug zum Iterieren. Mein erster Durchlauf (10 Bilder) dauerte etwa 12–18 Minuten auf einer mittelklassigen GPU.

- Lädt sich wie eine Ebene. Du schaltest sie in deinem Generierungstool an und promptest normal weiter, plus ein optionales Trigger-Wort.

Was du bekommst: eine winzige Datei, die das Modell bei Bedarf zur Konsistenz, zu Logos, zu Charakteren oder einem weichen Aquarellstil lenkt, ohne dich festzulegen. Wenn du sie nicht einschaltest, verhält sich das Basismodell wie gewohnt.

Wann du KEINE LoRA brauchst

Ich sage das mit Liebe: Viele von uns greifen zu schnell zum Training. Ein paar Fälle, wo ich es nicht versuche:

- Das Basismodell ist bereits nah dran. Wenn ein kurzer Prompt mit einem Referenzbild dir 8 von 10 verwertbaren Ergebnissen gibt, bist du fertig. Ein IP-Adapter oder ein Bild-Prompt könnte ausreichen.

- Du brauchst Variation, keine Konsistenz. Wenn jede Ausgabe wandern soll, kann eine LoRA zu viel steuern.

- Einmalige Visuals. Für ein einzelnes Banner verwende ich lieber fünf zusätzliche Minuten zum Prompting statt ein Training aufzusetzen.

- Die Beschränkung liegt in der Komposition, nicht in der Identität. Tools wie ControlNet oder Pose-Guidance formen das Layout, ohne dem Modell ein neues Konzept beizubringen.

Ein schneller Test, den ich verwende: Wenn ein einfacher Seed-Sweep und 2–3 Prompt-Anpassungen das Element, das mir wichtig ist (gleicher Charakter, gleiche Logo-Proportionen) über fünf Bilder hinweg nicht halten können, dann erwäge ich eine LoRA. Sonst halte ich es einfach.

Wann LoRA hilft

Ich habe den Unterschied diese Woche (Januar 2026) am deutlichsten in zwei Situationen gespürt:

- Ein kleines Maskottchen, das ich über Dokumentationen hinweg wiederverwenden wollte. Prompts haben die Augen und die Hemdfarbe immer durcheinander gebracht. Nach einer kurzen LoRA stabilisierten sich diese, und ich konnte mich auf Posen und Hintergründe konzentrieren.

- Eine weiche Bleistifttextur für Diagramme. Ich könnte „Bleistiftskizze” prompen, aber die Schattierung änderte sich jedes Mal. Eine 15-Bilder-Stil-LoRA gab mir eine stabile Linienqualität, ohne den Inhalt festzulegen.

Signale, dass eine LoRA wahrscheinlich hilft:

- Du brauchst das gleiche Motiv über viele Szenen hinweg.

- Eine bestimmte Kunsttextur ist wichtig (Schraffur, Risografie-Punkte, dicke Gouache-Kanten) und driftet immer wieder ab.

- Du möchtest Prompt-Akrobatik reduzieren. Nach dem Training sank meine Prompt-Länge von 80–100 Token auf 30–40. Der mentale Aufwand ist stärker gesunken als die Zeit.

Was mich überraschte, war, wie unaufdringlich die Auswirkung war. Keine dramatischen Vorher-/Nachher-Vergleiche. Nur weniger Neuversuche, weniger „Fastentreffer”.

Datenanforderungen

Ich hielt dies einfach und es funktionierte besser als erwartet. Ein paar Notizen aus zwei kurzen Durchläufen letzte Woche:

Ich hielt dies einfach und es funktionierte besser als erwartet. Ein paar Notizen aus zwei kurzen Durchläufen letzte Woche:

Menge

- Charakter/Motiv: 8–20 Bilder können ausreichen, wenn sie abwechslungsreich sind (Winkel, Beleuchtung, kleine Änderungen der Kleidung). Ich habe 12 verwendet.

- Stil/Textur: 10–30 Bilder, die den gleichen Look haben, aber unterschiedlichen Inhalt. Ich habe 15 verwendet.

Qualität

- Auflösung: Füttere Bilder, die ungefähr deiner Generierungsgröße entsprechen. Wenn du mit 1024 generieren möchtest, trainiere nicht mit winzigen 256er-Ausschnitten.

- Vielfalt schlägt Menge: Fünf Kopien der gleichen Pose lehren das Modell sehr wenig und schieben es in Richtung Überanpassung.

- Saubere Hintergründe helfen bei Charakteren: Geschäftige Szenen verwischen das Signal.

Beschriftungen

- Kurz und buchstäblich: „Ein kleines blaues Maskottchen mit runden Augen, rotes Hemd”, „Bleistiftskizze, Schraffur, weicher Schatten”.

- Sei konsistent mit der Benennung. Wenn du einen einzigartigen Namen für einen Charakter erfindest (wie „mori-kiko”), verwende ihn in jeder Beschriftung, damit du ihn später triggern kannst.

- Du kannst mit Auto-Beschriftungen beginnen und diese dann leicht bereinigen. Ich habe Adjektive gestrichen, die nicht die Kernidee widerspiegelten.

Prozess, den ich verwendet habe

- 12 Motiv-Fotos (Vorder-/Dreiviertel-/Seitenlage), neutrale Hintergründe.

- 15 Stil-Frames aus meinen eigenen Diagrammen, gleiche Papiertextur.

- Ein Durchlauf, Standard-Rank, leichte Regularisierung. Trainingszeit: ~16 Minuten auf einer gemieteten A10G. Einrichtung: ~10 Minuten. Der zweite Durchlauf brauchte 20 % weniger Schritte und funktionierte immer noch gut.

Wenn du dir nur eine Sache merken sollst: Weniger, klarere Bilder schlagen große, chaotische Ordner.

Stil vs. Charakter LoRA

Früher habe ich diese zusammengefasst. Sie verhalten sich unterschiedlich.

Charakter/Motiv LoRA

- Ziel: Eine spezifische Identität lehren (eine Person, Maskottchen, Produkt).

- Daten: Konsistentes Motiv, unterschiedliche Kontexte: Nahaufnahmen des Gesichts, wenn Gesichtsidentität wichtig ist.

- Prompts: Halte den Trigger-Namen plus eine kurze Beschreibung. Lass die LoRA die Identität übernehmen: Du steuerst Pose/Szenario.

- Risiken: Überanpassung an Kleidung oder Hintergründe. Mische sie.

Stil/Textur LoRA

- Ziel: Eine Oberflächenqualität lehren (Linienwerk, Palette, Pinselstrich, Körnung).

- Daten: Viele verschiedene Motive, ein Stil.

- Prompts: Kein Trigger-Name nötig, aber ein einfacher Marker hilft („Sketchline-Stil”).

- Risiken: Stil schluckt Inhalt. Wenn alles in die gleiche matschige Malerei wird, reduziere die Stärke.

Stärke und Mischen

- Die meisten Tools stellen ein LoRA-Gewicht zur Verfügung. Ich gehe selten über 0,8 für Charaktere oder 0,6 für Stile. Kleine Lenker zählen.

- Du kannst zwei LoRAs stapeln (eine Stil, eine Charakter). Meine besten Ergebnisse hatte ich, wenn eine dominiert und die andere unter 0,4 blieb.

Ich habe gelernt, Charakter-LoRA als „Wer” und Stil-LoRA als „Wie” zu denken. Einfach, aber es verhindert, dass ich die falsche Sache blame.

Häufige Mythen

Ein paar Aussagen, auf die ich oft treffe, und was ich tatsächlich gesehen habe:

- „Du brauchst Hunderte von Bildern.” Ich habe einen brauchbaren Charakter mit 12 trainiert. Mehr hilft, aber nur, wenn sie abwechslungsreich und sauber sind.

- „Es dauert Stunden.” Mit einer bescheidenen GPU und einem Anfänger-Preset landeten meine Durchläufe unter 20 Minuten. Schwere, benutzerdefinierte Configs können länger dauern.

- „LoRA ersetzt Prompt-Engineering.” Es reduziert Fiddling, entfernt es aber nicht. Ich prompte immer noch für Komposition, Beleuchtung und Stimmung.

- „Eine LoRA passt zu allen Modellen.” Nicht immer. Eine LoRA, die auf einer Basis trainiert wurde, kann sich auf ein Schwestermodell okay übertragen, aber die Ergebnisse verschieben sich. Ich behandle sie als verwandt, nicht als austauschbar.

- „Höhere Stärke = besser.” Nach einem gewissen Punkt kollabieren Bilder in Gleichförmigkeit. Wenn Details verschmieren, fahre das Gewicht herunter.

- „Auto-Beschriftungen sind unbearbeitet in Ordnung.” Sie sind ein guter Anfang. Ich habe immer noch seltsame Adjektive getrimmt („ominös”, „cinematisch”), die nicht Teil des Konzepts waren.

Nichts davon ist Zauberei. Es sind kleine, wiederholbare Anpassungen, die sich zusammensetzen.

Kurzes Glossar

- LoRA: Ein kompakter Satz gelernter Gewichtsaktualisierungen, der ein großes Modell an ein Zielkonzept anpasst, ohne alles neu zu trainieren. Nach IBMs LoRA-Dokumentation kann dies die trainierbaren Parameter um bis zu 10.000 Mal im Vergleich zum vollständigen Fine-Tuning reduzieren.

- Basismodell: Die Grundlage, von der aus du generierst (was du lädst, bevor du LoRAs hinzufügst).

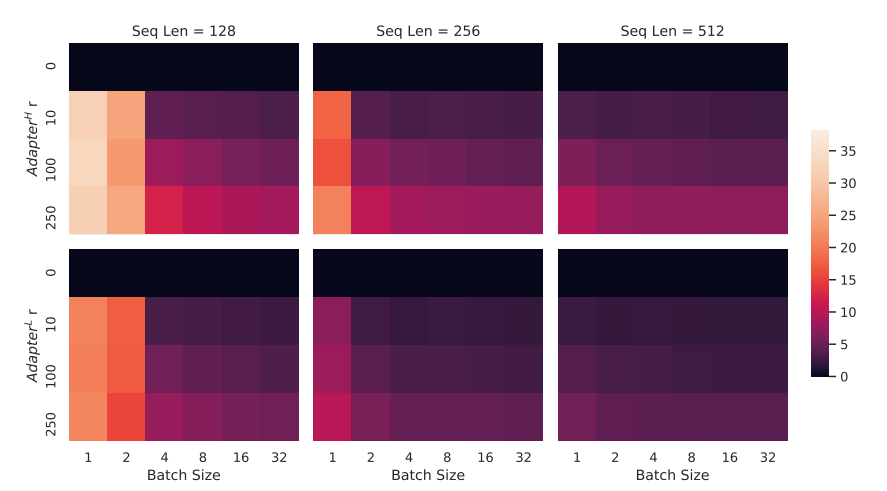

- Rank (r): Eine Einstellung, die steuert, wie aussagekräftig die LoRA ist. Ein höherer Rang kann mehr Nuancen erfassen, kann aber überanpassen und die Größe aufblähen.

- Gewicht/Stärke: Wie stark die LoRA die Generierung zur Inferenzzeit beeinflusst.

- Trigger-Wort: Ein eindeutiges Token, das du in Prompts verwendest, um eine Motiv-LoRA zu aufzurufen (z. B. der erfundene Name, den du in Beschriftungen verwendet hast).

- Überanpassung: Wenn das Modell Trainingsbilder auswendig lernt und aufhört zu generalisieren. Zeigt sich als Duplikate.

- Regularisierung: Techniken oder zusätzliche Daten, um Überanpassung zu verhindern.

- UNet/Text-Encoder: Teile des Modells, die Bilder und Text verarbeiten. Einige Trainings aktualisieren beide: Anfänger-Presets berühren oft die Bildseite stärker.

- Beschriftung: Der Text, der mit jedem Trainingsbild gekoppelt ist.

- Checkpoint: Ein gespeicherter Zustand eines Modells oder einer LoRA.

Wenn dir einige davon unklar sind, kannst du immer noch trainieren. Das Anfänger-Preset soll dich aus Schwierigkeiten heraushalten.

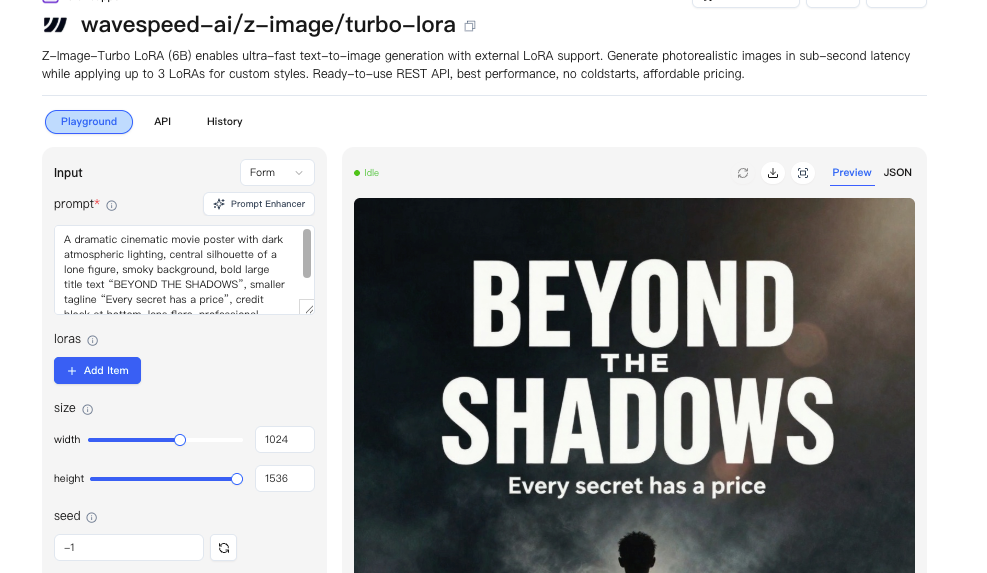

Nächste Schritte auf WaveSpeed

Ich habe den anfängerfreundlichen Weg auf WaveSpeed verwendet, um Z-Image LoRA ohne Einstellungsjagd auszuführen. Der Ablauf war ruhig:

- Wähle ein Basismodell.

- Gib 8–20 Bilder und kurze Beschriftungen ein.

- Wähle „Stil” oder „Charakter”.

- Starte das Training und mache Tee.

- Lade die LoRA zur Generierung und versuche zwei Gewichte (0,4 und 0,8), um die Spannweite zu erfühlen.

Was am meisten half, war, den ersten Durchlauf als Skizze zu behandeln. Ich suchte nach zwei Dingen: Hielt sich die Identität über fünf Prompts, und behielt der Stil seine Textur, ohne Inhalte zu verschlingen? Wenn einer fehlschlug, passte ich den Datensatz an, nicht nur die Regler.

Wenn du mit den gleichen Beschränkungen umgehst, abweichende Charaktere, wandernde Texturen, es lohnt sich, einen Blick zu werfen. Dies hat für mich funktioniert: Deine Erfolgsquote kann variieren.

Dies ist genau das, warum wir WaveSpeed gebaut haben. Wenn Charaktere abdriften, Stile wackeln und Prompts zu Akrobatik werden, wollten wir einen ruhigeren Weg zur Konsistenz, ohne zu viel zu engineern. Auf WaveSpeed führen wir Z-Image LoRA mit einem anfängerfreundlichen Ablauf aus – klare Standardwerte, schnelle Iteration und gerade genug Kontrolle, um Identitäten und Texturen stabil zu halten, sodass du weniger Zeit mit Wiederversuchen und mehr Zeit damit verbringst, tatsächlich Bilder zu machen.

→ Eine einfache LoRA auf WaveSpeed trainieren

Eine kleine Notiz, die ich mir für mich selbst aufbewahre: Je weniger Worte ich im Prompt kämpfe, desto mehr Aufmerksamkeit habe ich für das Bild vor mir. Das ist der Teil, den ich nicht automatisieren möchte.

Eine kleine Notiz, die ich mir für mich selbst aufbewahre: Je weniger Worte ich im Prompt kämpfe, desto mehr Aufmerksamkeit habe ich für das Bild vor mir. Das ist der Teil, den ich nicht automatisieren möchte.