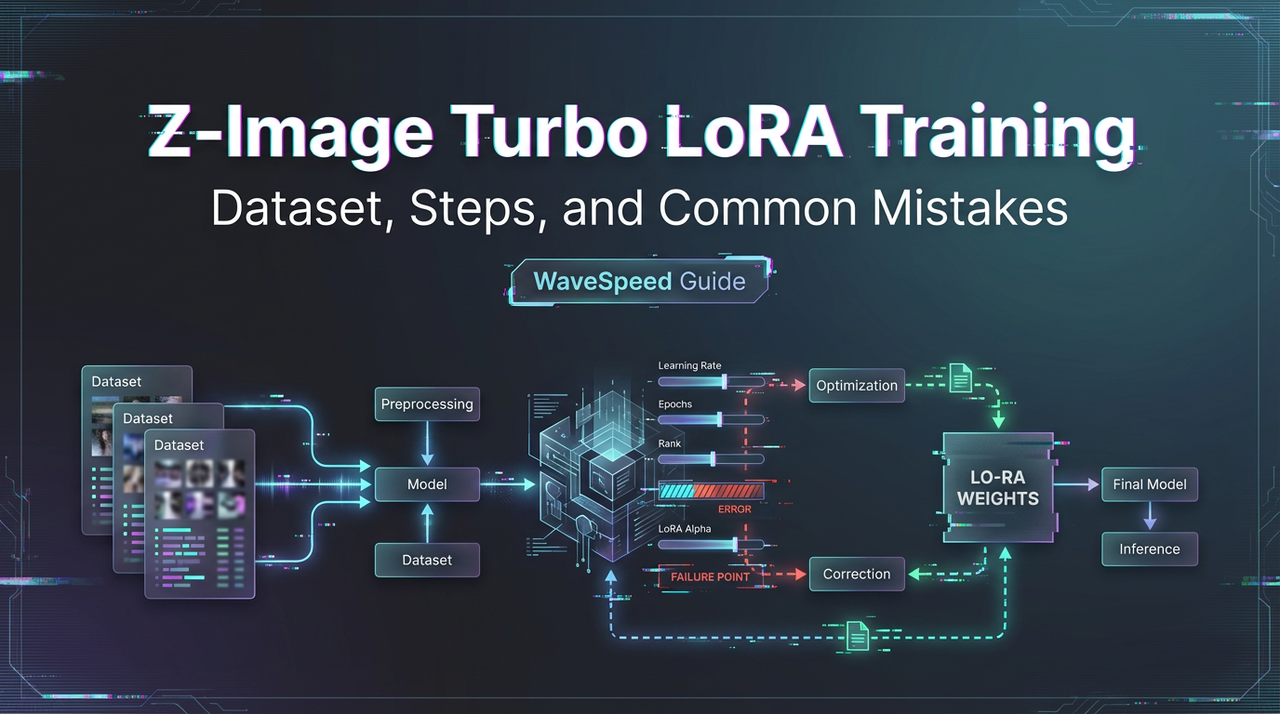

Z-Image Turbo LoRA auf WaveSpeed trainieren: Datensatz, Schritte und häufige Fehler

I’ll translate this article to German for you.

Hey, Kumpel. Ich bin Dora.

Letzte Woche wollte ich einen kleinen, konsistenten Stil für eine Reihe von Header-Bildern. Stock-Fotos wirkten falsch, und das manuelle Abstimmen von Prompts driftete ständig ab. Also versuchte ich etwas, das ich lange vermieden habe: ein schnelles LoRA auf Z-Image Turbo in WaveSpeed. Ich erwartete fummelige Einstellungen und viel Ausprobieren. Was ich bekam, war einfacher als gedacht, nicht mühelos, einfach ordentlich.

Hier ist, wie ich in zwei Januarnächten 2026 ein Z-Image Turbo LoRA auf WaveSpeed trainiert habe, was funktionierte, was nicht, und welche Einstellungen ich wiederverwenden werde. Es ist kein Ratgeber, um das letzte Prozent herauszuquetschen. Es ist eine solide Grundlage, die meinen Kopf klar hielt und die Ergebnisse vorhersehbar machte.

Hier ist, wie ich in zwei Januarnächten 2026 ein Z-Image Turbo LoRA auf WaveSpeed trainiert habe, was funktionierte, was nicht, und welche Einstellungen ich wiederverwenden werde. Es ist kein Ratgeber, um das letzte Prozent herauszuquetschen. Es ist eine solide Grundlage, die meinen Kopf klar hielt und die Ergebnisse vorhersehbar machte.

Datensatz-Regeln

Was ich gesammelt habe

Ich hielt es klein: 45 Bilder für einen definierten visuellen Stil (gedämpft, saubere Linien, sanfte Papiertextur). Ich hatte gute Ergebnisse zwischen 30–120 Bildern. Unter 20 neigt zum Überlernen: Jenseits von 150 trainierst du eher ein Fine-Tune als ein LoRA, und Z-Image Turbos Geschwindigkeitsvorteil beginnt sich abzuflachen.

Vielfalt schlägt Menge

Ich teilte den Satz auf:

- 70% „Kern-Look”-Bilder (der Stil, den ich lehren will),

- 30% Kontext-Vielfalt (verschiedene Objekte/Hintergründe, damit das LoRA den Stil nicht an eine Szene bindet).

Winkel, Beleuchtung und Seitenverhältnisse variierten. Ich vermied fast-Duplikate (nicht drei Aufnahmen desselben Objekts aus einer 5°-Verschiebung).

Größe und Format

- Auflösung: 768px auf der kurzen Seite. Turbo-Modelle verarbeiten 1024, aber 768 hielt das Training leichter und reduzierte Artefakte in meinen Tests.

- Format: PNG oder hochqualitatives JPEG. Ich entfernte Metadaten. Große eingebettete Profile verworrten manchmal die Farbe leicht.

- Zuschnitt: Ich schnitt zu, um das Motiv dominant, aber nicht immer zentriert zu halten. Symmetrie macht Modelle träge.

Beschriftungs-Tipps

Ich probierte zwei Durchgänge: erst Auto-Tagging, dann leichte Bearbeitung. Auto-Beschriftungen brachten mich 70% dort hin. Die letzten 30% waren wichtig.

Beschriftungen kurz und konsistent halten

- 1–2 Sätze oder eine kompakte Tag-Liste.

- Erwähne das Style-Token (mehr zu Tokens weiter unten) plus ein Klassenwort.

- Beschreibe nicht alles. Benenne nur, was stabil und wichtig ist.

Beispiel, das ich verwendete:

- „soka-style, minimalistischen Illustration einer Keramiktasse auf einem Schreibtisch, sanfte Papiertextur, gedämpfte Palette.”

- „soka-style, einfache Pflanze in einem Tontopf, seitliches Licht, sauberer negativer Raum.”

Klassenworte helfen

Wenn du einen Stil lehrst, verwende Klassenworte (Illustration, Foto, Porträt, Produktfoto). Wenn du ein Objekt/eine Figur lehrst, verwende, was es ist (Tasse, Rucksack, Planer). Dies hilft dem LoRA zu verallgemeinern. Ohne Klassenworte haftete mein frühes LoRA an Layouts.

Nicht mit Adjektiven überlernen

Ich entfernte wiederholte Adjektive nach dem zweiten Durchgang. Wenn jede Beschriftung „warm, gemütlich, sanft” sagt, sperrt sich das Modell auf diese Stimmung, auch wenn du sie nicht willst. Ich behielt ein Adjektiv für den Ton.

Negative Signale

Ich fügte eine leichte Negation in einigen Beschriftungen hinzu, wo sie wirklich wichtig war: „keine harten Schatten.” Nicht überall, nur wo der Kontrast im Rohbild falsch war. Zu viele Negativtexte machten es bei der Inferenz stur.

Kleine Notiz: Ich versuchte für fünf Bilder als Test beschriftungsfrei zu gehen. Die Ergebnisse wurden ein wenig lauter. Nicht schrecklich, aber ich würde Beschriftungen nicht überspringen, wenn Konsistenz wichtig ist.

Trainingsparameter-Grundlage

Diese sind die Einstellungen, die mir mit Z-Image Turbo auf WaveSpeed konstante Ergebnisse gaben. Ich führte drei kurze Trainings durch (etwa 18–22 Minuten je nach Standard-GPU in meinem Workspace). Deine Zeiten können unterschiedlich sein.

Kern-Einstellungen, die ich wiederverwendete

- Basis: Z-Image Turbo (neueste Stand Januar 2026)

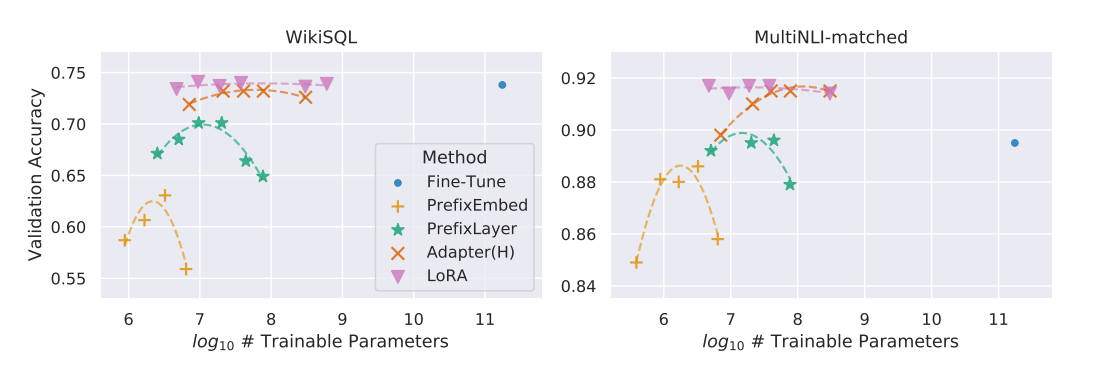

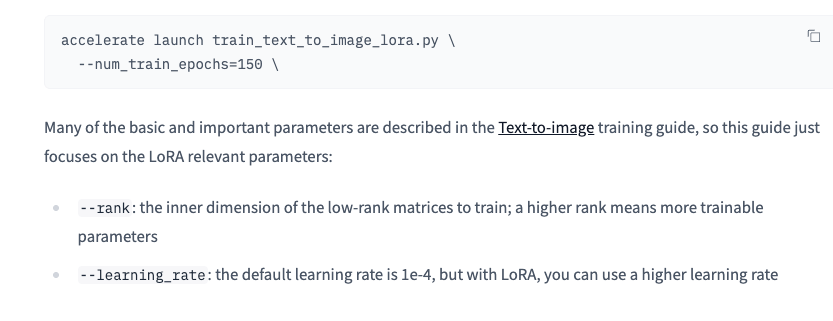

- LoRA-Rang (dim): 16 für subtilen Stil: 32, wenn der Stil mehr Kraft braucht. Ich blieb bei 16.

- Alpha: Rang abgleichen (16) oder Hälfte (8). Ich stimmte es ab.

- Lernrate: 1e-4 zum Starten. 2e-4, wenn der Stil nicht haftet. 1e-3 überkochtschnell in meinen Tests. Hugging Faces LoRA-Trainings-Dokumentation empfiehlt, mit 1e-4 für die meisten stabilen Diffusionsmodelle zu beginnen.

- Batch-Größe: 2–4. Ich verwendete 4, um die Schritte angemessen zu halten.

- Epochen/Schritte: Ziele 1–2 vollständige Durchgänge über die Daten. Für 45 Bilder × 10 Wiederholungen ÷ Batch 4 ≈ 112 Schritte pro Epoche. Ich trainierte 2 Epochen (≈224 Schritte). Mehr als 3 Epochen begannen Hintergründe zu memorieren.

- Scheduler: Cosine oder konstant mit Aufwärmung. Ich verwendete Cosine mit 5% Aufwärmung.

- Genauigkeit: bfloat16, wenn verfügbar. Es war hier in Ordnung.

Regularisierungsbilder

Bei Style-LoRAs füge ich nicht immer Regularisierung hinzu. Für Objekte oder Zeichen füge ich 50–100 Klassen-Bilder hinzu (einfach „Tasse”, „Porträt”), um Anatomie und Formen ehrlich zu halten. Auf Turbo reduzierte dies merklich seltsame handähnliche Blätter in Pflanzenschüssen.

Kontrollpunkte und Speicherung

Ich aktivierte das Speichern alle 50–80 Schritte. Es ließ mich zum süßesten Punkt zurückrollen, was für mein Set um Schritt 180 war. Spätere Schritte sahen sauberer aus, aber weniger flexibel in den Prompts.

Wenn du einen schnellen Sanity-Check möchtest: mache einen 60–90-Schritte-Lauf zuerst. Er wird nicht perfekt sein, aber er sagt dir, ob dein Datensatz die richtige Lektion lehrt.

Auslöserworte

Ich verwendete ein eindeutiges Token, um den Stil zu verankern: „soka-style”. Du könntest etwas wie „kavli-ark” oder „mivva” verwenden. Kurz, erfunden und wahrscheinlich nicht mit echten Wörtern kollidierend.

Wie ich Beschriftungen schrieb

- Starten Sie Beschriftungen mit dem Token einmal: „soka-style, minimalistischen Illustration…”

- Fügen Sie ein Klassenwort hinzu: Illustration, Foto, Render, was immer passt.

- Halten Sie es über den Datensatz hinweg konsistent.

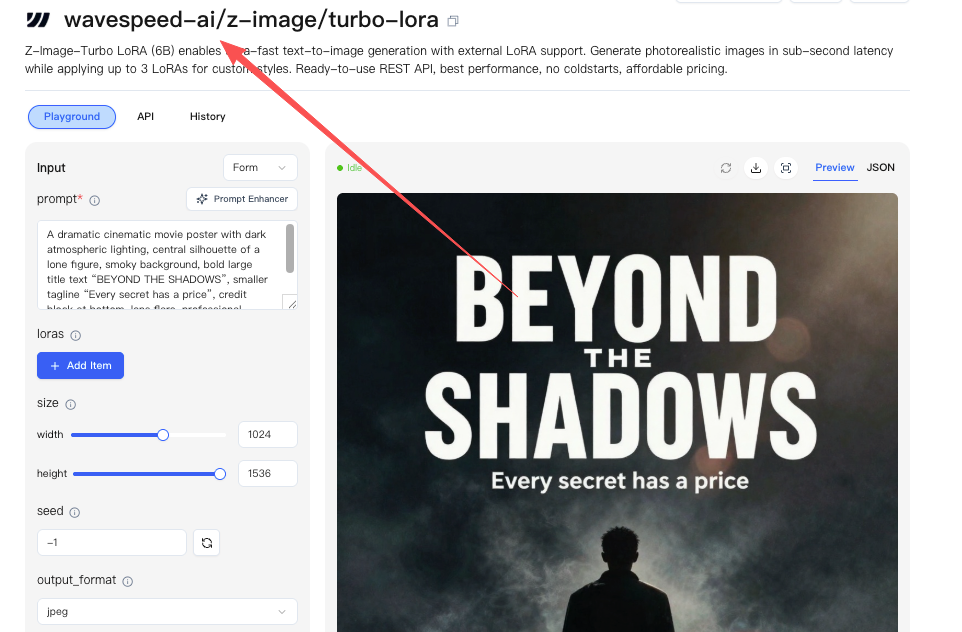

Wie ich promptete

- Positiv: „ein Produktfoto einer Keramiktasse auf einem Holzschreibtisch, soka-style, sanfte Papiertextur, gedämpfte Farben”

- Negativ: „harte Schatten, starkes Körnung, Text-Wasserzeichen, chromatische Aberration”

Wann man Auslöserworte vermeiden sollte

Wenn du ein sehr spezifisches Objekt trainierst (eine Markenflasche, ein Maskottchen), verwende ein Token + Klassenwort („mivva-bottle”) in Beschriftungen, aber du musst das Token nicht in jeden Inferenz-Prompt erzwingen. In meinen Tests respektierte Turbo die Trainingsverteilung: manchmal war das Klassenwort allein genug. Das Token half, wenn die Szene komplex wurde.

Eine Seltsamkeit: Zwei Style-Tokens zu stapeln verworrte das Modell („soka-style, nova-style”). Ich bekam eine trübe Mischung. Ein Token auf einmal war sauberer.

Validierungsbilder

Validierung rettete mich davor, Gespenstern hinterherzujagen.

Feste Seeds und ein kleines Gitter

Ich setzte drei Prompts, um die ich mich kümmere, und hielt sie über Läufe hinweg fest:

- „eine Keramiktasse auf einem Schreibtisch, soka-style, sanfte Papiertextur, gedämpfte Farben”

- „eine Laubpflanze am Fenster, soka-style, seitliches Licht, sauberer Hintergrund”

- „ein Planer und Stift, soka-style, Top-Down, sanfte Schatten”

- Seed: fest (Ich verwendete 12345). Ein Seed pro Prompt.

- Schritte: 20–28 für Turbo. Jenseits von 30 begann zu überschärfen.

- CFG: 3.5–6. Ich mochte 4.5 zum Ausgleich.

- Sampler: DPM++ 2M Karras oder ein anständiger Euler-Variante. Beide verhielten sich.

- Größe: 768×768 zur Parität mit Trainings-Zuschnitt.

Ich renderte auch denselben Satz einmal ohne das Token, um zu sehen, ob der Stil zu dominant war. In meinem zweiten Lauf sahen Tassen ohne das Token immer noch „papierig” aus, ein Hinweis, dass ich den Stil zu hart gepusht hatte. Dialinging-LoRA-Gewicht auf 0,6 fixte es.

Wenn du kannst, halte ein leichtes Validierungspanel offen während du trainierst. Die gleichen drei Prompts zu beobachten, die sich aktualisieren, ist ruhiger als zufällige Stichproben ins Auge zu fassen.

Fixes

Hier ist, was schief ging und was es fixte.

Überlernen Hintergründe

- Symptom: identische Papiertextur erscheint in unabhängigen Szenen.

- Fix: reduziere Wiederholungen pro Bild (von 10 auf 6), füge 6–10 neutrale Hintergründe hinzu, senke LoRA-Gewicht bei der Inferenz (0.6–0.75).

Farbdrift zu Beige

- Symptom: alles wärmt sich wie ein spätnachmittags-Filter auf.

- Fix: entferne wiederholte „warm/sanft/gemütlich”-Adjektive in Beschriftungen: füge 6 kühlere-getönte Bilder hinzu: setze Weißabgleich-Vielfalt in den Datensatz: füge „übermäßig warme Töne” zur Negation hinzu.

Brüchige Prompts

- Symptom: kleine Prompt-Veränderungen brechen die Komposition zusammen.

- Fix: erhöhe Datensatz-Vielfalt in Objekttypen und Layouts: trainiere mit einer leicht niedriger LR (1e-4 statt 2e-4): versuche Rang 32, wenn der Stil komplex ist.

Veröffentlichen & Wiederverwenden

Das Trainieren dieses LoRA war größtenteils zu bewältigen, weil wir WaveSpeed gebaut haben, um die lästigen Teile des Prozesses zu entfernen. Anstatt Skripte zu verdrahten oder GPUs zu betreuen, konnte ich einen kleinen Datensatz hochladen, kurze Turbo-LoRA-Trainings durchführen, Checkpoints vergleichen und das Modell über Projekte hinweg wiederverwenden, ohne meinen Fluss zu unterbrechen.

Wenn du müde von Stildrift, Überlernen oder dem Verlieren der Spur des „guten Laufs” bist,

→ Trainiere ein Z-Image Turbo LoRA auf WaveSpeed

Als der dritte Lauf sich steady anfühlte, veröffentlichte ich das LoRA in WaveSpeed mit einer einfachen Modellkarte:

Als der dritte Lauf sich steady anfühlte, veröffentlichte ich das LoRA in WaveSpeed mit einer einfachen Modellkarte:

- Wofür es ist: subtiler Papiertextur-Stil, gedämpfte Palette, saubere Formen.

- Wofür es nicht ist: fotorealistische Porträts, hochglänzende Produkte, schwere Text-Overlays.

- Einstellungen, die funktionierten: Gewicht 0.6–0.85, CFG ~4.5, 20–26 Schritte, 768 Ausgabe.

- Zwei gute Prompts und eine Vorsichtsmaßnahme.

- Versions-Notizen: trainiert Januar 2026, Rang 16, LR 1e-4, ~224 Schritte.

Ich hielt die Lizenz einfach und fügte drei Validierungsbilder hinzu. Zukünftiges Ich wird vergangenes Ich für die Spezifikationen danken.

Wiederverwenden

- Stapeln: Ich könnte dieses Style-LoRA mit einem separaten Objekts-LoRA stapeln, aber ich hielt nur einen Stil auf einmal. Wenn du stapeln musst, halten das kombinierte Gewicht unter 1.0.

- Mergen: Ich buk es nicht in einen Checkpoint. Der ganze Punkt war Flexibilität.

- Teams: Ich teilte den LoRA-Link und die drei festen Validierungs-Prompts. Es reduzierte die Überprüfung hin und her. Leute schauten auf die gleiche Referenz.

Wenn du neu bei WaveSpeed oder Z-Image Turbo bist, sind die offiziellen Dokumente es wert, vor deinem ersten Lauf überflogen zu werden, besonders ihre Notizen zu Lernrate und Rang. Ich überflog sie nach meinem ersten Durchgang und wünschte mir, ich hätte es früher getan.

Hast du auch geschworen und herunter, dass du „nur ein kleines LoRA trainieren” würdest, nur um zwei Nächte später zu finden, dass jedes Bild einen „ewigen Beige-Filter” oder „erzwungenen Papiertextur-Hintergrund” sported?

Schnell, kippe deine 45 Bilder in WaveSpeed und versuche Z-Image Turbo LoRA. Dann komm zurück und sag mir: hat es deine Header-Konsistenz gerettet, oder hat es all deine Objekte dazu gebracht, „mysteriöse strukturierte Tentakel” auszusprießen?