WAN 2.7 指令式影片編輯指南

WAN 2.7 新增指令式影片編輯功能。了解它是什麼、可以編輯哪些內容、如何融入生產流程,以及開發者需要了解的重點。

大家好,我是 Dora。我使用 AI 影片工具已有一段時間,當我第一次聽說 WAN 2.7 的指令式編輯功能時,並沒有立刻被說服這會帶來多大改變。用文字指令編輯影片聽起來像是那種在展示時看起來很厲害、但真正用起來卻讓人失望的功能。

我承認,我錯了一部分。

WAN 2.7 中指令式影片編輯的意義

你拿一段現有的影片片段,寫下你想要修改的內容,模型就會調整那個特定元素,同時保持其他所有部分不變。不是重新生成,而是編輯。

與標準文字生成影片的差異

文字生成影片從零開始。你寫一段提示詞,然後得到生成的結果。

指令式編輯則從已有的內容開始。片段已在那裡,時間軸已確定好。你要求模型更改某一部分——替換背景、調整光線、重新為服裝上色——而不觸動其餘部分。

WaveSpeedAI 的分析指出,這在實際操作上有重要意義:以前需要從頭重新生成片段的迭代流程,現在可以作為輕量級編輯來處理。因為夾克顏色不對就重新生成,感覺很浪費。只編輯夾克才是正確做法。

與影片重製的差異

重製是採用參考影片的動作結構,並將其應用到新的主體或風格上。這是動作轉移。

指令式編輯則是修改。原始片段保持不變,只有你指定的元素會改變。

模型接收的輸入內容

兩樣東西:來源影片(最長 15 秒,解析度最高 1080P)和一段自然語言指令。

令我驚訝的是:不需要遮罩,不需要圖層隔離。只需片段和一個句子。

指令式編輯能做什麼,不能做什麼

支援的編輯類別

根據測試以及 Dzine 的平台文件,指令式編輯可處理:

- 背景替換(室內換室外、晴天換雨天)

- 光線調整(黃金時段換成藍調時段)

- 物件層級調整(更換衣服顏色、增加道具)

- 風格修改(寫實轉插畫)

這些功能之所以有效,是因為它們屬於有界的變更。模型知道什麼是背景、光線會產生什麼效果。

指令式編輯難以應付的情況

複雜的空間重新排列效果不佳。「將角色移到左側」沒有產生乾淨的結果,角色要麼紋絲不動,要麼構圖出現奇怪的偏移。

包含大量身份識別細節的場景——特定的臉部表情、精細的標誌細節——也難以編輯。模型可以改變光線,但在更改表情或年齡時,難以維持精確的面部特徵。

物理變化的結果則參差不齊。「讓水流得更快」有時奏效,有時看起來很卡頓。

編輯粒度

所有編輯都在提示詞層級進行。你描述要改變的內容,模型推斷這適用於哪個部分。目前尚無物件層級的精準定位。

我學會了寫非常具體的指令。「將夾克改成紅色」比「讓服裝變成更溫暖的色調」效果更好。

設計有效的編輯指令

好的編輯指令具備哪些特質

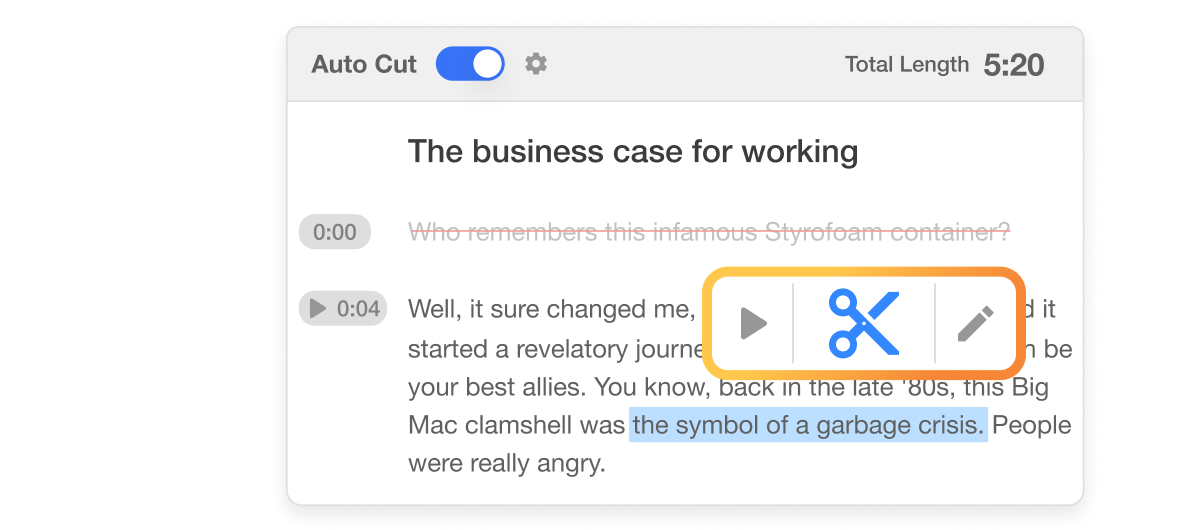

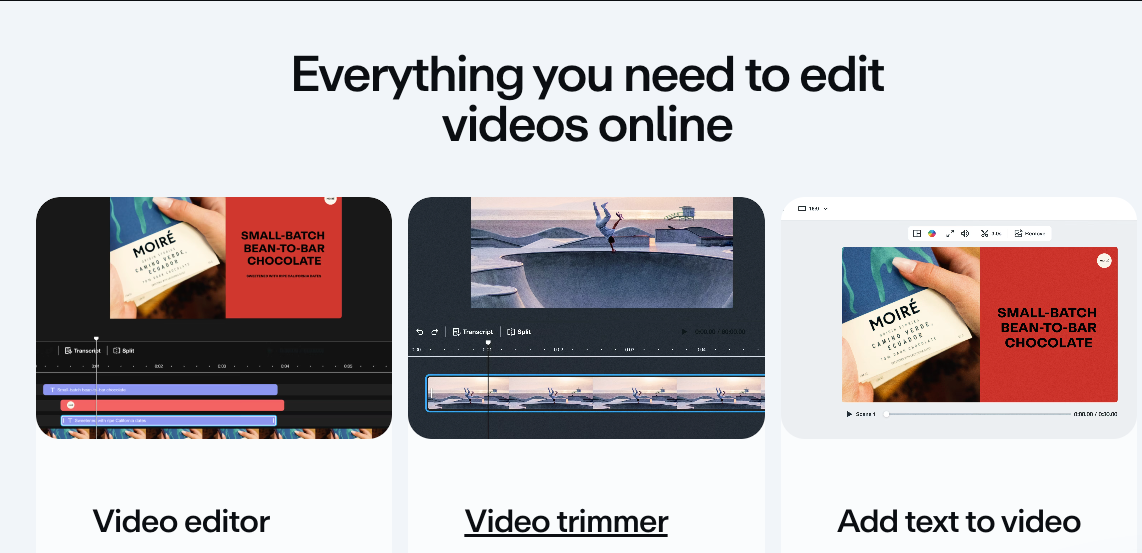

好的指令要具體、有方向性且有界。這種做法與 Descript 等工具背後的理念相呼應——你可以直接編輯文字來剪輯影片,不需要任何遮罩或圖層隔離。

「將天空改為陰天並帶有烏雲」效果一致且穩定。它明確指出了改變什麼、變成什麼樣子,並加入了細節。

「讓它看起來更有戲劇感」則不行。太模糊了,模型每次的解讀都不同。

壞的指令是什麼樣的

與來源片段矛盾的指令會悄無聲息地失敗。在以角色為主的鏡頭上下「從場景中移除那個人」,要麼被忽略,要麼產生破損的畫面。

包含多個相互衝突元素的指令也會出問題。「將夾克改成藍色,背景換成森林,並加入雨」一次嘗試了三個編輯。一個指令只做一個編輯效果更好。 這種清晰的提示模式——說明改變什麼,描述目標狀態——與 Visla 文字式影片編輯的最佳實踐相符,即透過直接編輯逐字稿來精修素材。

提示詞模式

有效的模式如下:

- 說明改變什麼

- 描述目標狀態

- 控制在 15 個字以內

「將城市背景替換為山景」——主體明確,目標清晰,結果乾淨。

輸入要求

來源影片規格

來源影片:2 至 15 秒,解析度最高 1080P。我測試了 1080P 的 5 秒片段和 720P 的 10 秒片段,兩者均能正常運作。

參考對齊

如果你的來源影片有嚴重的動態模糊、快速剪切或極端曝光,編輯結果會下降。模型需要清晰的畫面。

快速平移的鏡頭在替換背景時產生了模糊的結果。靜態或緩慢移動的鏡頭則產生了乾淨的編輯效果。

指令式編輯在製作流程中的定位

我原本沒有預期會將它作為主要工具,只以為是個新奇功能。但它不是。

生成後的精修迴圈

在使用標準文字生成影片後,我通常能得到 80% 我想要的結果。動作對了,構圖對了,但色彩分級感覺不對,或者背景與要求不符。

在指令式編輯出現之前,這意味著需要用調整後的提示詞重新生成,然後祈禱能成功。命中率:大概 40%。 每次重新生成需要 60 到 90 秒,我通常要燒掉三四次嘗試才能得到可用的成果。

現在我只需生成一次,然後編輯那個不對的特定元素。命中率接近 70%,迭代速度也更快。不再需要三次完整重新生成(每次 90 秒,共 4.5 分鐘),而是一次生成加上一次編輯(大約共 2.5 分鐘)。多個專案累積下來,節省的時間相當可觀。

無需完整重新生成的風格迭代

我透過生成一段角色在城市街道行走的基礎片段來測試,然後用指令編輯創建三個風格變體:

- 「轉換為賽博龐克霓虹美學」

- 「改為水彩畫風格」

- 「改成黑白電影黑色風格」

這三個編輯都保留了原始的動作和構圖,只有視覺風格改變了。角色的行走循環保持一致,鏡頭移動也沒有改變。

這對於客戶簡報非常有用——你可以展示多個概念選項,而無需將整個場景重新生成三遍。對於 A/B 測試廣告素材、無需消耗大量生成額度也同樣有用。

我也嘗試了用重新生成來替代編輯的相同工作流程——將風格關鍵字寫入三個不同的提示詞。其中兩個返回時動作時間略有不同,破壞了比較的一致性。而編輯方式讓所有內容都保持可比較性,除了我正在測試的風格變數。

成本比較:編輯 vs. 重新生成

根據 WaveSpeedAI 的成本分析,指令式編輯的成本結構可能與標準生成不同,但目前尚未公布確切定價。

從工作流程角度來看,即使編輯每秒的成本與生成相同,實際上仍然更便宜,因為你不會丟棄失敗的嘗試。一次生成加上一次精準編輯,勝過三次完整重新生成。

計算方式:如果生成 1080P 內容的成本為每秒 $0.12(WAN 2.6 來自 PiAPI 的定價),一段 5 秒的片段需要 $0.60。三次重新生成需要 $1.80。一次生成加上一次編輯——即使編輯成本同樣是 $0.60——總共只需 $1.20。僅僅透過減少浪費,就能節省 33%。

如果編輯比生成便宜(考慮到編輯是修改現有畫面而非從頭創建,這似乎很有可能),節省的比例還會更高。

API 存取的影響

獨立端點還是參數標誌?

WaveSpeedAI 的分析顯示,指令式編輯可能需要新的有效載荷欄位——可能是 edit_instruction 參數,以及可能的獨立端點。

我正在等待正式的 API 文件,然後再進行生產環境整合。

Token 與運算成本

多輸入推斷比單輸入生成更耗費資源。指令式編輯需要同時處理來源影片和編輯指令,意味著更高的運算成本。

請相應地規劃預算,但在定價正式上線之前不要敲定預測數字。

非同步任務的考量

所有 WAN 操作均為非同步執行。提交請求,獲得任務 ID,輪詢直到完成。

根據我的測試,5 秒 1080P 編輯的預期等待時間為 30 秒至 2 分鐘。

常見問題

指令式編輯在 WaveSpeed API 上線時就能使用嗎?

WAN 2.7 將於 2026 年 3 月內上線。 API 對指令式編輯的支援尚未確認。WaveSpeedAI 通常在正式發布後數天內新增端點。

用於編輯的來源影片最長可以多長?

最長 15 秒,解析度 1080P。 較短的片段(2-5 秒)處理速度更快,編輯結果也更乾淨。

編輯是否會保留原始音訊? 取決於編輯類型。 背景更換會保留音訊。改變視覺美學的風格調整有時會影響同步性。建議針對具體情況逐一測試。

相關文章: