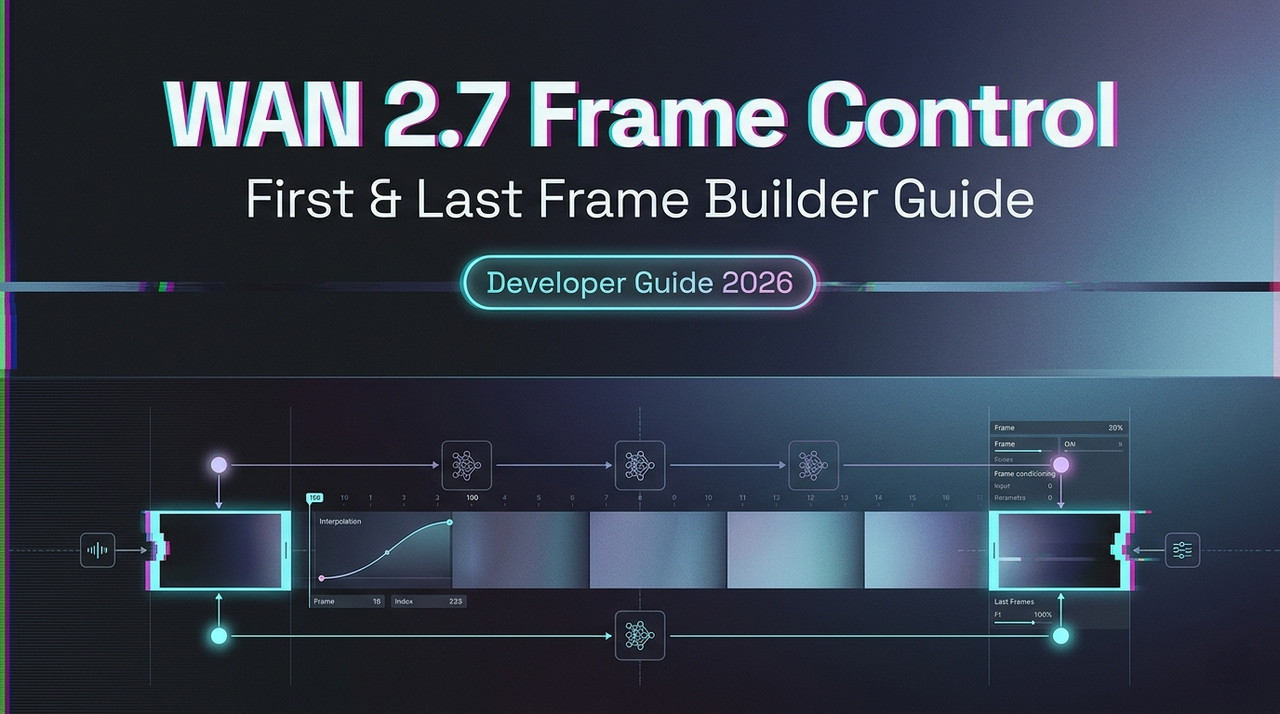

WAN 2.7 首尾幀控制:開發者指南

如何使用 WAN 2.7 的首尾幀控制功能實現可預測的影片生成——輸入準備、API 參數與生產工作流程技巧。

嘿,各位,Dora 來了。我一直看到團隊把首幀/尾幀控制描述成「你只需要上傳兩張圖片」。這就像把非同步任務佇列描述成「你只需要等待」一樣。機制本身並不難——但輸入設計決策才是大多數生產工作流程悄悄崩潰的地方。

本指南適合需要可重複輸出的開發者,而不是只需要一個偶爾成功的演示。

首幀與尾幀控制實際上做了什麼

它解決的問題 vs 標準圖生視頻

標準圖生視頻(I2V)鎖定開場幀,然後模型即興發揮。結果就是社群常說的「漂移」——主體、相機位置或光線逐漸偏離你心中預設的目標狀態。對於需要固定終點的產品演示或敘事序列來說,後期修正成本很高。

WAN 的 FLF2V 方案 採用了額外的控制調整機制:首幀和尾幀被視為控制條件,兩張圖片的語義特徵都被注入生成過程。這樣可以在模型動態轉換之間保持風格、內容和結構的一致性。

生成過程中如何使用兩個幀

模型並非簡單地對像素值進行插值。它使用 CLIP 語義特徵和交叉注意力機制來保持視頻穩定——這種設計已被證明能夠減少視頻抖動,相較於單錨點方法表現更優。你的首幀定義初始狀態;你的尾幀約束目標終點。兩者之間的動作路徑是推斷出來的,而非指定的,這既是其強大之處,也是主要的失敗模式。

模型如何推斷兩幀之間的路徑

你的文字提示指導轉換如何發生——而不只是是否發生。如果你的提示說「產品緩慢旋轉並露出正面」,這個動作描述就會塑造推斷出的路徑。沒有提示,模型仍會嘗試合理的轉換,但你對方向變化、相機移動或節奏的控制將大幅減少。

輸入準備

圖片規格要求

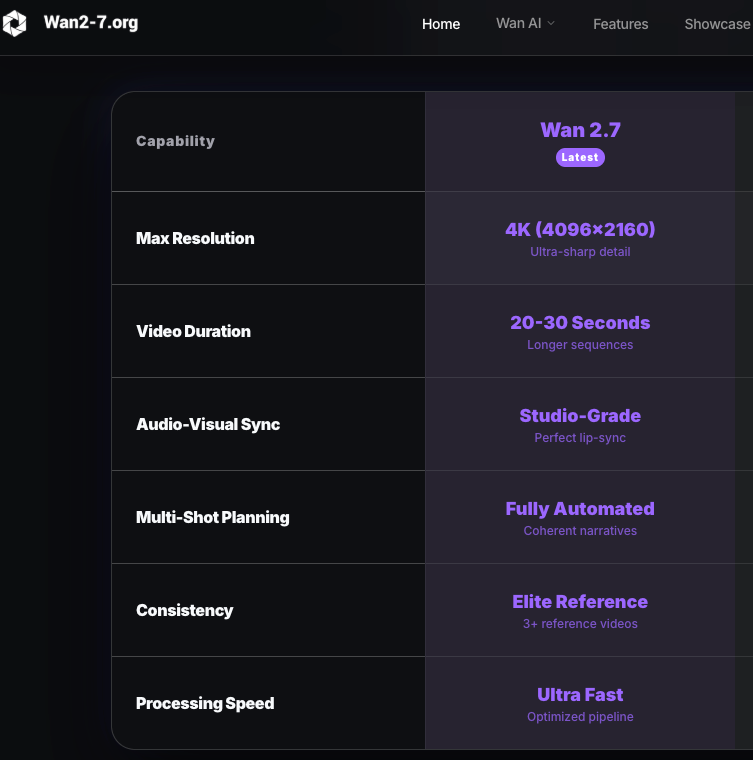

模型會盡可能使用你首幀的長寬比作為目標輸出。對於 3:4 輸入(750×1000),720P 輸出設定將產生約 816×1104 的尺寸——並非精確的 3:4。如果你需要精確比例,請計劃在後期進行裁切或加黑邊。對於 WAN 系列而言,720p(1280×720 或等效直向)是推薦的高品質輸出解析度;以較小解析度運行是測試迭代的有效策略,但不適用於最終成品。

格式:PNG 或高品質 JPEG。 避免以壓縮縮圖作為首/尾幀——壓縮偽影會引入噪點,模型會將其解讀為有意為之的視覺資訊。

有效的幀配對策略

最強的配對共享三點:一致的光源方向、匹配的景深特徵,以及在兩個位置空間上都合理的主體。 在漫射攝影棚光線下拍攝的產品照,配上以略微不同角度呈現相同產品的尾幀,效果很好。如果光線設置相似,包裝照配生活化主圖也能奏效。

對於敘事序列,將這對幀視為定義一個動詞:開啟→關閉、之前→之後、組裝中→完成。語義關係越清晰,推斷出的路徑就越連貫。

什麼是糟糕的幀配對

三個常見原因:

光線方向不一致。 如果你的首幀主光源在左側 45°,而你的尾幀是以頂光拍攝的,模型將嘗試在兩個不同的陰影環境之間過渡。結果通常是中途出現光源跳躍,看起來像渲染錯誤。

空間不匹配。 寬景建立鏡頭配上緊密特寫,會強迫模型自創相機移動。有時這是刻意為之的;但通常不是。除非你明確提示縮放或拉遠,否則保持焦距大致一致。

景深線索衝突。 首幀有散景,尾幀一切清晰對焦——模型會將此解讀為景深變化並嘗試為其製作動畫。這並不總是錯的,但很少是你的本意。

API 實作

以下反映了 WAN 系列的 FLF2V 文件模式。在投入生產前,請在 阿里雲模型工作室文件 中驗證當前的參數名稱和端點路徑。WAN 2.7 API 的具體資訊應在發佈時確認。

有效載荷結構

核心模式涉及兩個圖片輸入——通過公開 URL 或本地文件路徑——作為 first_frame_url 和 last_frame_url 傳遞,以及文字提示和解析度設定。

Python 請求模式(偽代碼)

# 發佈時請驗證模型名稱和端點——名稱會因版本而異

import os

from dashscope import VideoSynthesis

response = VideoSynthesis.async_call(

model="wan2.x-flf2v-<verify-at-launch>", # 確認確切的模型字符串

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="固定相機。從第一張圖片開始,在最後一張圖片結束。[描述動作]",

negative_prompt="閃爍, 扭曲, 模糊",

resolution="720P", # 驗證接受的值

# seed 參數:一旦有好的結果就鎖定它

)

task_id = response.output.task_id較長任務的非同步處理

圖生視頻生成任務通常需要 1–5 分鐘。API 採用兩步非同步模式:提交任務,獲取任務 ID,然後輪詢結果。從一開始就將輪詢機制構建到你的流程中。即使是測試調用也不要假設同步行為——在簡單實作中,逾時會悄無聲息地丟棄結果。

生產工作流程:草稿到最終版本的方法

第一步——建立參考配對並運行測試

從單一配對開始。在端到端看到一個輸出之前不要批量處理。使用你的目標內容——而非佔位符庫存圖片——因為空間和光線特徵需要代表你實際的素材庫。

第二步——在批量處理前驗證動作路徑

以 0.5 倍速完整觀看一遍。 注意:中途抖動、主體身份在剪輯 50–70% 附近漂移(大多數偽影集中在此處),以及光線不連續。如果你看到任何這些問題,在修改提示之前先修正輸入配對。

第三步——鎖定最佳種子值以保持一致性

一旦獲得乾淨的輸出,記錄種子值。FLF2V 模型接受可選提示來引導中間動作和轉換邏輯。鎖定的種子加上鎖定的提示,為你提供一個可重現的生成單元,可應用於相似的輸入配對。這就是讓批量生產變得可預測而非隨機的關鍵。

第四步——擴展至批量生成

將批次結構化為:一個作為品質錨點的標準「測試配對」,然後是從相同受控拍攝設置生成的變體配對。WAN FLF2V 的 Hugging Face 模型頁面 記錄了為在 API 調用旁運行本地推斷的團隊提供的開放權重版本。

這個功能適用的場景(以及不適用的場景)

最適合: 終點很重要的產品演示序列(包裝照→功能展示)、具有明確前後狀態的敘事連續鏡頭、需要在系列多個剪輯中保持空間穩定性的受控相機路徑。

不理想的場景: 方向急劇變化的高度動態動作(模型會將其平滑化,往往失去戲劇張力)、首尾幀沒有清晰語義關係的模糊空間過渡,或需要精確幀時間的場景——模型控制節奏,而不是你。

常見失敗模式與修正方法

中途動作偽影。 通常由輸入配對中的空間不匹配引起。模型在早期就「確定」插值路徑,不一致性會在中間點附近浮現。修正方法:在更改提示之前,收緊幀之間的關係。

幀風格不一致。 如果你的首幀是風格化渲染圖,而尾幀是照片,模型將嘗試混合視覺風格。這很少產生乾淨的輸出。匹配圖片處理方式——都是渲染圖、都是照片、都是插圖。

模型忽略尾幀。 當提示描述的動作邏輯上無法在你的尾幀終止時會發生這種情況。當提示與幀產生衝突時,模型優先考慮提示連貫性而非幀的遵從。將你的提示寫成要到達尾幀,而不只是從首幀出發。

常見問題

- 我可以在文生視頻中使用首/尾幀,還是只能在圖生視頻中使用? FLF2V 模式是 I2V 的擴展。兩個幀輸入都是必需的。標準 T2V 在設計上不接受尾幀約束。

- 哪種圖片格式最適合幀輸入? PNG 適合任何需要乾淨邊緣或透明度處理的內容。高品質 JPEG(>90 品質)適合攝影。如果你的平台尚未確認支援,請避免使用 WebP。

- 這比標準 I2V 費用更高嗎? 定價取決於解析度——720p 的每次生成費用約為 480p 的兩倍。FLF2V 本身在文件定價中沒有額外附加費,但請與你的特定平台確認。

- 如何處理需要急劇方向變化的動作? 將序列分解為多個剪輯,以中間幀作為端點。在後期串連它們,而不是試圖讓單次生成處理不連續的動作。

- 我可以將此與 9 宮格輸入模式結合嗎? 這些是獨立的輸入模式。WAN 2.7 支援首/尾幀控制和 9 宮格圖生視頻作為不同的功能。它們目前無法在單次調用中結合使用——如果這點有所改變,請在發佈時驗證。

結論

首/尾幀控制有趣的設計空間不在於 API 調用——而在於輸入配對。那才是真正的生產槓桿所在,也是大多數團隊投入不足的地方。一個設計良好、具有清晰語義關係的幀配對,將始終勝過配上錯誤輸入的完美提示。

對於構建批量流程的團隊:將你的輸入配對庫視為一等資產,而非事後才想到的東西。一旦你有了鎖定的種子和經過驗證的配對格式,生成這一側就會變得例行化。如果你也在 API 調用旁運行本地推斷,ComfyUI 社群在 WAN FLF2V 工作流程配置 中有詳細的文件——值得一讀,以了解幀條件實際運作方式的節點層面洞察。

我一直在思考這裡有個安靜的道理:約束本身就是功能。給模型一個目標終點,迫使你精確知道自己真正想要什麼。這不是限制——而是一種紀律,往往比開放式生成產生更好的輸出。

繼續探索 AI 視頻工作流程: