WAN 2.7:新功能、API 存取與升級路徑

WAN 2.7 是阿里巴巴的重大升級:首尾幀控制、九宮格圖生影片、語音參考以及指令編輯。開發者必知重點。

大家好,我是 Dora!自 2.1 版本起,我便持續關注 Wan 模型系列,主要是因為一旦某個模型在生產流程中獲得開源社群的廣泛採用,其發展速度往往會超過相關報導的更新速度。WAN 2.7 目前仍在推進中——預計於 2026 年 3 月內發布——因此這並非一篇正式的發布評測,而是針對已在使用 2.5 版本的團隊所整理的一份「升級前確認清單」,協助你判斷是否需要調整基礎架構或暫緩行動。

沒有炒作,只有已確認的資訊、尚待釐清的部分,以及……這對你的建構排程意味著什麼。如果你仍在評估 Wan 這類模型在生產環境中的實際定位,這份關於 AI 影片生成工具在實際工作流程中應用方式的解析 能幫助你在深入規格細節之前,先建立正確的決策基礎。

WAN 2.7 六十秒速覽(精簡版)

從產品或工程角度評估:WAN 2.7 更像是功能性的擴展,而非單純的品質飛躍。 重點不在於「影片更好看」,而在於「提供更多控制介面」。改進涵蓋畫面品質、音訊生成與動態表現,但更值得關注的是結構性新增功能:首尾幀控制、9 宮格多輸入 I2V、人物加語音參考,以及基於指令的影片編輯。

與 2.5 版本的差距並非主要體現在解析度上,而在於模型在單次呼叫中所能接受的錨定輸入數量。

WAN 2.7 新功能一覽

首幀與尾幀影片控制

首尾幀方法允許使用者以兩張圖片分別定義影片的開頭與結尾,由模型自動生成中間的過渡內容。這項功能在早期 Wan 系列版本中曾以獨立模型的形式存在(參見 Wan2.1-FLF2V-14B),但 2.7 版將其整合至模型本身,不再作為獨立的模型檢查點。

對於生產團隊而言:當你擁有明確的關鍵幀時,此功能最能發揮價值——例如靜止狀態的產品圖與運動狀態的產品圖——你可以讓模型自動插值補間過渡,無需進行完整的手動動畫製作。端點是確定性的,中間過程仍具隨機性,但你的構圖邊界得到了保障。

9 宮格圖像轉影片(3×3 多輸入)

WAN 2.7 支援 3×3 宮格合成方式,意即單次影片生成任務最多可提交九張參考圖像作為結構化輸入。這與單幀 I2V 有本質上的不同。

實際應用場景:若你需要在不同角度或光線條件下生成角色一致的內容,現在可以提供參考宮格……而非單一錨定圖像。若你想了解不同工具如何處理多參考一致性的問題,這份關於**支援多人臉與多輸入的最佳影片換臉工具指南** 揭示了現有解決方案仍面臨的挑戰。此功能大幅降低了讓 I2V 批次作業品質難以控制的「一次性運氣」因素。請在發布時確認確切的 API 參數結構——截至本文撰寫時,宮格輸入的端點架構尚未正式公布。

人物加語音參考

WAN 2.7 允許你將視覺人物參考與語音參考結合,生成外觀與聲音均與輸入保持一致的角色影片。這是 Wan 2.6 R2V 模型所引入功能的延伸——該模型允許使用者上傳包含外觀與聲音的角色參考影片,並透過文字提示生成以同一角色為主角的全新場景。

在 2.7 版本中,預期這項功能將更緊密地整合至模型中,而非以獨立的模型端點形式存在。對於打造角色驅動短片內容或本地化流程的團隊而言,……這是生產投資回報率最為明確的功能——前提是語音參考處理在反覆批次呼叫下能保持穩定。就背景而言,這也是目前AI 影片換臉流程在規模化時開始崩潰的環節,尤其是在同時需要身份與語音一致性的情況下。

基於指令的影片編輯

WAN 2.7 支援使用自然語言指令對現有影片進行編輯——更換背景、調整光線,或透過描述變更來修改角色服裝,由模型處理其餘細節。

這是從生成到編輯的重要轉變。對於需要進行後期製作修正循環的產品團隊而言,它提供了一種更輕量的替代方案,可用於小幅修改,無需手動進行遮罩和合成工作。主要未知因素在於:當編輯影響到與動態相關的元素時(例如移動中人物的服裝),模型如何處理較長片段的時間一致性。這正是類似工具在歷史上表現退化的環節。

阿里雲模型工作室的官方文件已涵蓋當前 Wan 系列的相關編輯端點,可作為你在 2.7 版本中所見 API 模式的基準參考。

影片重建/複製功能〔待確認〕

這項功能——在保留動態結構的同時,以風格或人物變化重建或複製現有影片——已出現在 WAN 2.7 的第三方摘要中。截至本文撰寫時,此功能尚未在阿里巴巴官方文件中得到獨立確認。 在阿里巴巴的正式發布說明確認此功能之前,請勿在工作流程中建立對此功能的依賴。若你目前正在規劃升級項目,請將其標記為探索性功能。

保持不變的部分(來自 2.6 的架構延續性)

底層 DiT(擴散 Transformer)架構持續沿用。Wan 系列採用基於主流影片 DiT 架構的 Transformer 元件,運用完整注意力機制(Full Attention)精確捕捉長程時空依賴性,確保高度的時間與空間一致性。

對於執行本地推理的團隊而言,這一點至關重要:GPU 記憶體配置與量化方法不會有大幅變動。 若你的 2.6 推理堆疊已完成優化(FP8 運算、多 GPU 分片),這些投資將得以延續。無需預期會有全新的部署架構。

API 存取與可用性——已確認與待定事項

官方存取管道(DashScope / Wan.video)

先前 Wan 版本的兩個已確認官方管道分別是阿里雲的 DashScope 平台(負責 API 金鑰配置與模型存取)以及面向創作者工作流程的 Wan.video。兩者預計在發布時均會支援 2.7 版本,但區域可用性(特別是國際帳號與中國大陸帳號之間的差異)應在發布時確認。

DashScope API 金鑰從 DASHSCOPE_API_KEY 環境變數載入,國際使用者指向 dashscope-intl.aliyuncs.com——考慮到既有基礎設施,2.7 版幾乎可以確定沿用相同模式。

第三方 API 可用性

截至本文撰寫時,WAN 2.7 尚未在第三方 API 聚合平台上獲得確認。根據 2.2 版本以來的慣例——Wan 2.1 和 2.2 均在開源模型權重發布當天支援 ComfyUI 原生整合——若 2.7 附帶公開權重發布,預計社群整合將迅速跟進。

2.7 是否以開源形式發布本身尚未確認,詳見下方常見問題。

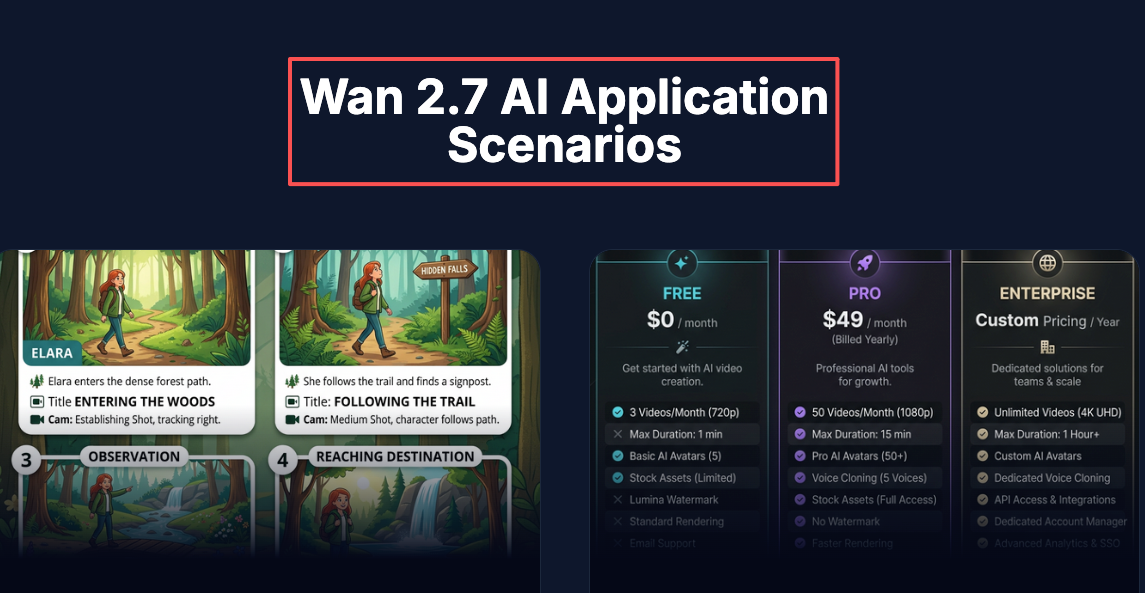

哪些團隊應優先關注 WAN 2.7

從事大量參考素材影片製作的團隊

若你的流程已依賴跨鏡頭的角色一致性——且你一直在透過多次生成或 ControlNet 變通方案加以補償——人物加語音參考以及多幀宮格輸入這兩項功能最能直接降低此類負擔。值得評估升級計劃。

需要多輸入 I2V 的開發者

單圖像 I2V 在不需要一致性時尚可應付,但 9 宮格輸入顯著擴大了參考範圍。若你一直在批次使用變通方案來模擬此功能,2.7 版或許能將多次 API 呼叫整合為一次。

可等待 WAN 2.5 的創意團隊

若你的 2.5 工作流程穩定運行,且新功能無法對應現有的生產瓶頸,則沒有急迫升級的必要。模型仍在推出中,不妨等社群反饋在前兩週內揭露邊緣案例,再考慮重新調整任何架構。

常見問題

- WAN 2.7 何時正式開放 API 存取? 發布計劃於 2026 年 3 月內進行。各區域確切的 API 可用日期:尚未確認。

- WAN 2.7 是否像 WAN 2.2 一樣開源? 尚未確認。Wan 2.2 依照 Apache 2.0 授權發布,允許商業使用及 ComfyUI 整合。2.7 是否沿用相同授權,在預發布資料中尚未明確說明。

- WAN 2.7 是否支援 ComfyUI? 目前尚無確認的整合資訊。考慮到先前版本的慣例——Wan 2.1 和 2.2 均在發布當天或前後支援 ComfyUI——若模型權重公開,預計社群節點將迅速跟進。

- 與 WAN 2.5 相比,定價如何? 尚未公布任何定價資訊。Wan 模型系列通常透過 DashScope 按秒或按影片計費。請於發布時查閱阿里雲模型工作室的最新定價。

- 今天是否可以透過第三方 API 供應商存取 WAN 2.7? 尚不行。模型尚未發布。請監控 Wan 官方 GitHub 和 DashScope 文件以確認發布資訊,再從那裡確認平台支援情況。

發布後需持續關注的事項

以下幾點值得在 2.7 發布後的前幾週持續追蹤:

——指令編輯的時間一致性:基於指令的編輯是最可能在實際表現與預覽呈現之間出現差異的功能。請密切關注社群輸出成果。

——開源權重發布:若權重公開發布,預計數日內便會出現 ComfyUI 工作流程、Diffusers 整合及量化變體。若未公開,DashScope API 將繼續是主要存取途徑——區域延遲將成為真實的工作流程變數。

——影片重建功能狀態:這項功能需要官方來源確認。在阿里巴巴明確確認之前,請勿將其納入任何規格計劃。