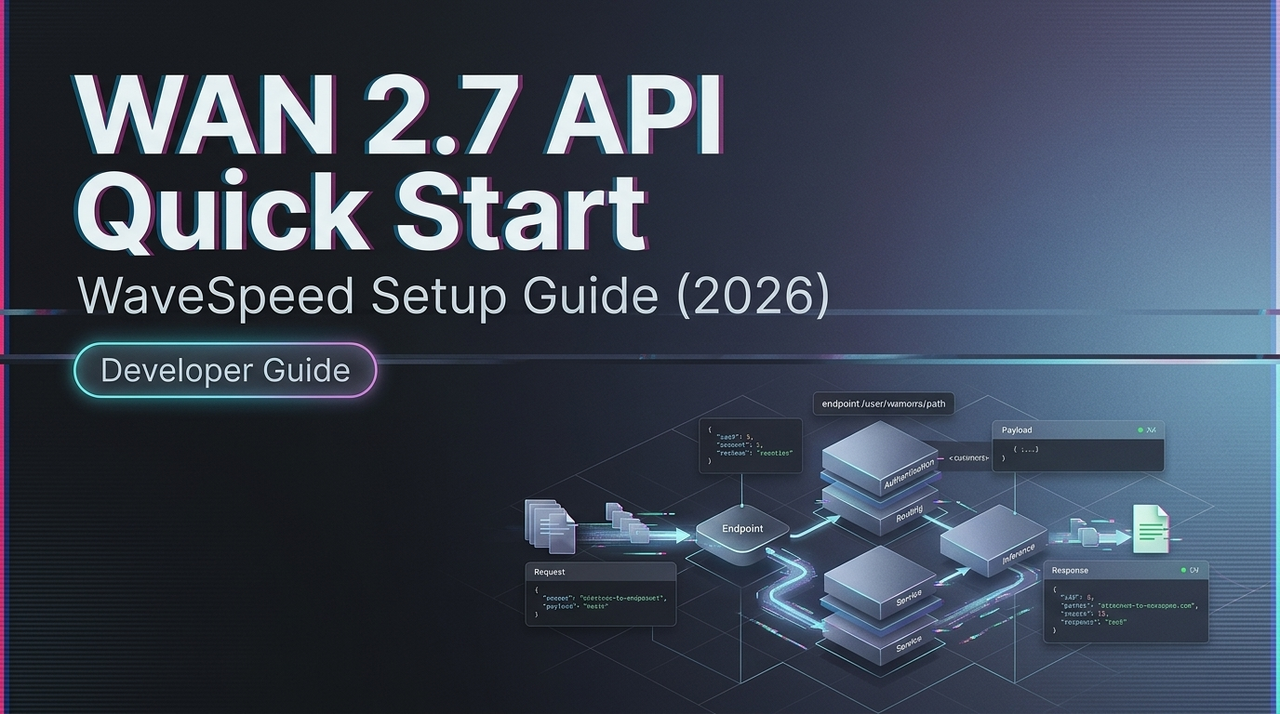

WAN 2.7 在WaveSpeed的API快速入門(2026)

透過WaveSpeed API快速啟動WAN 2.7:驗證、模型ID、核心參數,以及文字生成影片、圖片生成影片和首/末幀任務的首次請求模式。

嗨,大家好,我是 Dora。我一直在拖這件事。WAN 2.7 已經發布了。 我有個專案需要用到它,卻一直告訴自己「等局勢穩定後再接入」。這通常是錯誤的直覺。一旦搞清楚版本命名,API 介面其實相當直觀——大部分摩擦來自於早期做出的一兩個決定,這些決定會悄悄影響後續所有事情。

這不是功能展示文章,而是我在第一天實際需要的東西。

WAN 2.7 平台上手:模型 ID 與可用性

在寫第一行程式碼之前,我花了十分鐘確認模型字串。這聽起來很基本,但 WAN 的命名模式容易讓人踩坑——wan2.5-i2v、wan2.6-i2v、wan2.7-flf2v——使用過時的 ID 會返回乾淨的 404,完全沒有任何有用的錯誤訊息。

模型目錄是第一個要確認的地方。 前往影片生成區塊,按版本 2.7 篩選,然後複製精確的模型 ID 字串。不要憑記憶手動輸入。

可用時機也很重要。WAN 2.7 於 2026 年 3 月推出,帶來一套有意義的新功能——首尾幀控制、3×3 網格圖片轉影片合成、最多五個影片參考,以及基於指令的編輯。根據阿里雲模型工作室影片生成概覽,新版 WAN 的託管推論端點通常在官方發布後數日內上線——但不一定是同一天,因此在開發時間敏感的功能之前,請先確認平台狀態頁面。

認證與 API 金鑰設定

這部分很快。你的 API 金鑰以 Bearer token 的形式放在 Authorization 標頭中。 基礎 URL 對應你在帳號設定時選擇的區域——新加坡、維吉尼亞州,或中國大陸部署的北京。跨區域呼叫會失敗,而且不會有明顯提示,只會出現認證錯誤,如果你沒有預料到,可能會白白浪費二十分鐘。

Authorization: Bearer YOUR_API_KEY

Content-Type: application/json我從一開始就養成的習慣:將 API 金鑰存放在環境變數中,絕不寫死在程式碼裡,即使是本地測試腳本也不例外。洩漏的金鑰會帶來你不想要的帳單驚喜。

基礎 URL 結構遵循 IETF RFC 9110(HTTP 語義) 中定義的標準 REST 慣例。如果你曾使用過任何現代 AI API,這一切都會感覺熟悉——JSON 進,JSON 出,狀態碼行為符合預期。

核心請求參數

這裡我建議你稍微放慢腳步。必填參數很少——模型 ID、提示詞、輸入類型——但可選參數對輸出品質的影響超乎預期。

必填:

model— 精確的模型字串,從目錄中確認prompt— 文字描述;對於影片來說,具體性比長度更重要- 輸入:I2V 使用

image_url,純文字使用 T2V

可選但實際上很重要:

resolution— 接受"480P"、"720P"、"1080P";WAN 2.7 支援原生 1080P 輸出,最長 15 秒duration— 2 至 15 秒;片段越長,費用越高,處理時間也越長seed— 一旦找到好的輸出就鎖定它。 這是唯一能讓你的結果在多次執行中保持可重現的參數negative_prompt— 用於抑制閃爍、模糊和動態失真

WAN 2.7 特定參數(請在官方文件發布後確認):

first_frame_url+last_frame_url— 用於 FLF2V(首尾幀)模式image_grid— 用於更豐富 I2V 構圖的 9 宮格輸入結構edit_instruction— 對現有影片進行自然語言編輯

後三個是 2.7 的新功能。參數名稱可能在預覽版和正式版之間有所調整。官方 API 參考文件是權威來源——使用預發布的參數名稱開發,風險自負。

第一個請求範式

文字轉影片(最簡版)

response = VideoSynthesis.async_call(

model="wan2.7-t2v", # 請在發布時確認精確字串

prompt="A slow dolly shot through a foggy pine forest at dawn.",

resolution="720P",

duration=5,

seed=42

)

task_id = response.output.task_id標準圖片轉影片

response = VideoSynthesis.async_call(

model="wan2.7-i2v",

img_url="https://your-cdn.com/input.jpg",

prompt="Camera holds still. Subject turns slowly toward light.",

resolution="720P",

duration=5

)首幀 + 尾幀(FLF2V)

這是 WAN 2.7 能做到而舊版無法輕鬆實現的功能。你定義開頭和結尾的幀;模型會推斷出中間的動態。這不是傳統意義上的動畫——而是從兩個語義端點進行的結構化推論。

response = VideoSynthesis.async_call(

model="wan2.7-flf2v", # 請在發布時確認精確字串

first_frame_url="https://your-cdn.com/start.png",

last_frame_url="https://your-cdn.com/end.png",

prompt="Fixed camera. Smooth transition. Natural lighting.",

resolution="720P",

seed=99

)幀對的品質比提示詞更重要。 一對具有清晰空間關係的匹配良好的幀,其表現會穩定優於對不匹配輸入幀使用精緻提示詞的結果。我已經測試了足夠多的次數,可以有把握地這樣說。關於開源版本如何處理幀條件的參考資料,Hugging Face WAN 模型倉庫 詳細記錄了架構——即使你只是在呼叫託管 API,這也很有用。

9 宮格圖片轉影片

9 宮格輸入讓你可以傳入一個 3×3 排列的靜態圖片作為單次生成的構圖參考。請在發布時確認精確的 payload 結構——該參數可能接受九個圖片 URL 的陣列,但任何預發布文件都應視為暫定資訊。

非同步任務處理:提交 → 輪詢 → 結果

影片生成永遠不是同步的。 即使是短片,每個任務預計需要 1–5 分鐘。模式始終相同:提交 → 取得 task_id → 輪詢 → 取得結果 URL。

import time

def poll_for_result(task_id, interval=15, timeout=600):

elapsed = 0

while elapsed < timeout:

result = VideoSynthesis.fetch(task_id)

status = result.output.task_status

if status == "SUCCEEDED":

return result.output.video_url

if status == "FAILED":

raise Exception(f"Task failed: {result}")

time.sleep(interval)

elapsed += interval

raise TimeoutError("Job exceeded timeout")輪詢間隔:15 秒 是阿里巴巴自家 API 參考文件針對 Wan 圖片轉影片端點的建議值。不要輪詢得更頻繁——這不會加速任何事情,反而會耗盡你的速率限制。

任務狀態轉換:PENDING → RUNNING → SUCCEEDED 或 FAILED。結果 URL 在生成後 24 小時內有效。請立即下載並儲存——如果錯過這個時間窗口,task_id 也會在 24 小時後過期,後續查詢會返回 UNKNOWN。我在第一次批次執行時就以這種尷尬的方式學到了這個教訓。

錯誤處理

你最常遇到的錯誤:

| 錯誤 | 可能原因 | 解決方法 |

|---|---|---|

| 模型 404 | 模型 ID 錯誤或過時 | 從目錄確認精確字串 |

| 輸入 400 | 圖片格式被拒絕或 URL 無法存取 | 使用公開的 HTTPS URL;確認格式 |

| 429 Too Many Requests | 觸及速率限制 | 指數退避加抖動 |

| UNKNOWN 任務狀態 | task_id 已過期(24 小時窗口) | 盡早輪詢;立即下載結果 |

針對 429 錯誤:退避、加入抖動、不要在緊密迴圈中重試。MDN HTTP 文件中關於 Retry-After 標頭行為的說明 解釋了標準模式——回應標頭通常會告訴你確切的重試時機。

WAN 2.7 的影片任務速率限制 與圖片生成限制是分開發布的。高解析度或較長時長的任務通常計入並發任務限制,而不僅僅是每分鐘請求限制。請根據你的帳號等級文件進行確認。

費用估算

撰寫本文時,WAN 2.7 的定價尚未確定。根據 WAN 模型系列的一貫規律,費用在三個維度上擴展:

- 解析度 — 每秒輸出,1080P 的費用明顯高於 720P

- 時長 — 按生成影片的秒數計費

- 輸入複雜度 — 多參考輸入可能有倍率;請在發布時確認

粗略估算公式:

estimated cost = duration (seconds) × resolution multiplier × unit price per second在執行批次任務之前,先用你計劃使用的每種解析度和時長組合測試一個片段。一旦官方 WAN 2.7 費率公布,阿里雲模型工作室的計費概覽將提供每秒單位費用。影片生成費用的增長速度比圖片生成快得多——解析度是最大的槓桿。

常見問題

WAN 2.7 是否與阿里巴巴官方發布同一天提供?

不一定。託管 API 端點通常在開源發布後數日內上線,有時是同一天,有時晚一週。請直接監控平台更新日誌。WAN 模型的 GitHub 倉庫歷來是阿里巴巴團隊最先記錄新開源發布 schema 變更的地方。

WAN 2.5 的 API 呼叫是否與 WAN 2.7 相容?

標準的 T2V 和單圖片 I2V payload 在結構上應該是相容的——2.7 的新功能看起來是附加性的,而非破壞性的。話雖如此,你需要更新模型 ID 字串,而且任何使用 2.5 特定參數的程式碼都應在視為可直接替換之前進行測試。9 宮格和 FLF2V 模式則需要全新的 payload 結構。

WAN 2.7 影片任務的速率限制是多少?

請在執行時根據你的帳號等級確認。作為一個可行的預設值:以穩定的節奏排隊提交任務,而不是爆發式提交。使用指數退避處理 429。記錄每個回應中的 request_id——當出現問題需要追蹤時,這是最有用的欄位。

這裡的機制並不複雜。真正耗時的是建立良好的輸入資產——幀對、參考圖片,以及既具體又不過於死板的提示詞。一旦這些穩定下來,API 這端就會變成例行公事。

官方 WAN 2.7 參數文件正式發布、並且我有機會完整測試 9 宮格格式之後,我會更新這篇文章。那是我最感興趣的部分。

相關文章: