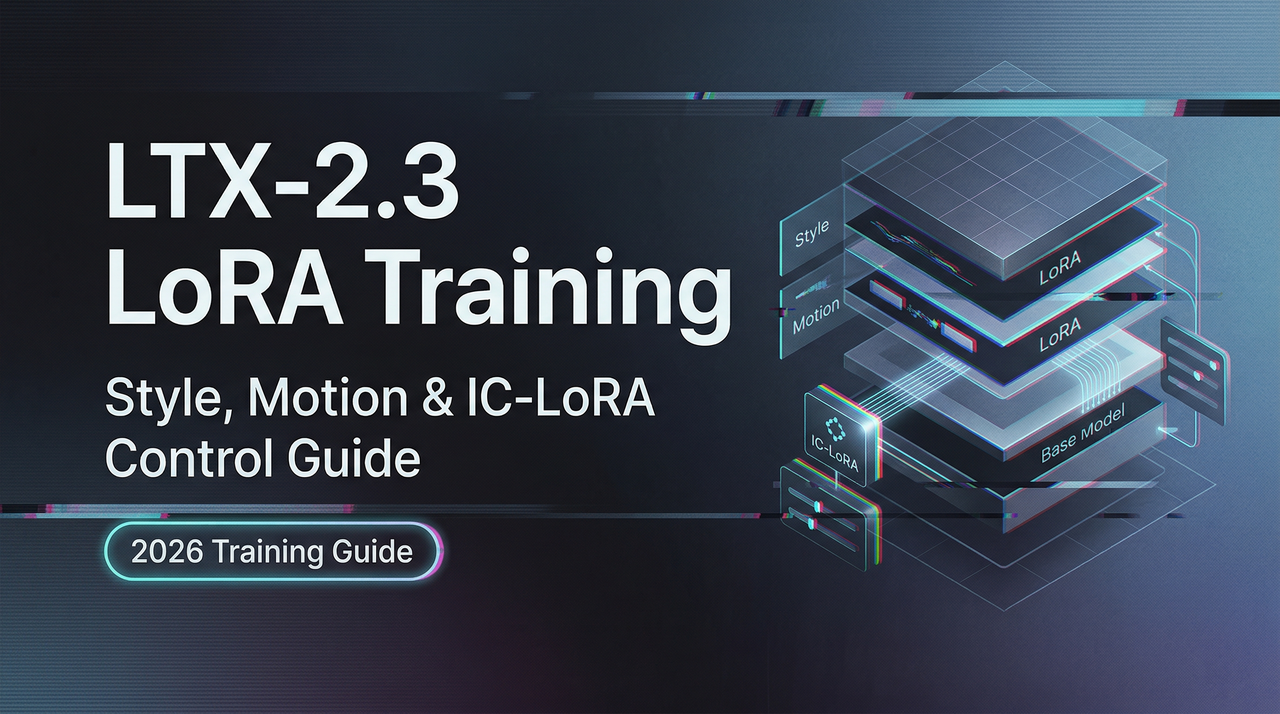

LTX-2.3 LoRA 訓練指南:風格、動作與 IC-LoRA 控制(2026)

使用官方 ltx-trainer 在 LTX-2.3 上訓練自定義 LoRA。涵蓋風格 LoRA、IC-LoRA 結構控制、rank 設定、資料集準備及常見訓練失敗問題。

嘿,朋友,我是 Dora。

我原本沒打算花一週時間訓練 LoRA。我只是需要一個產品展示影片來呈現特定的動作模式,但文字提示詞的效果不盡理想。這個小小的挫折讓我走上了 LTX-2.3 訓練之路,而我的發現讓我感到驚訝——不是因為它有多革命性,而是因為一旦你知道哪些設定真正重要,它就會靜靜地發揮出實際效用。

這篇文章並非全面性的參考指南,而是我在 2026 年 3 月測試風格、動作和 IC-LoRA 控制工作流程時所學到的東西。

LTX-2.3 官方訓練器包含什麼

LTX-2 GitHub 儲存庫以 monorepo 結構組織,包含三個套件:用於模型實作的 ltx-core、用於生成工作流程的 ltx-pipelines,以及用於 LoRA 和 IC-LoRA 微調的 ltx-trainer。寬度和高度設定必須能被 32 整除,幀數必須遵循 8n+1 規則——也就是 1、9、17、25 幀,以此類推。

我在第一次訓練時忽略了這一點。訓練器報錯,我手動補齊了幀數,然後它就正常運作了。這是個小限制,但值得提前了解。

三種 LoRA 類型及其使用時機

風格 LoRA(外觀、質感、色彩)

風格 LoRA 教導 LTX-2.3 視覺美感——色彩分級、質感處理、燈光氛圍。我用具有一致白色背景和柔和陰影的產品攝影訓練了一個。對於角色或風格 LoRA,通常 20-50 張圖片就足以獲得紮實的效果,但對於高度特定的主題,我有時會用到 80-120 張圖片。

純圖片資料集在這裡完全適用。我的前幾個 LoRA 使用靜態幀而非影片片段——這樣更容易整理,模型學習識別特徵時也不需要處理動作。

動作 / 特效 LoRA(移動、變換)

動作 LoRA 專注於事物如何移動,而非它們的外觀。鏡頭平移、物體旋轉、變換序列。這些需要短而連貫的影片片段,而非靜態圖片。我用 15 秒的一致構圖片段測試了一個鏡頭推進動作 LoRA,模型成功在不同主題中捕捉到了運動模式。

訓練動作感覺比風格更不穩定,需要更多重試,結果也更不一致。

IC-LoRA(結構控制:深度、姿勢、Canny 邊緣)

IC-LoRA 有所不同。它不是教模型新的美學或動作,而是根據參考信號——深度圖、姿勢骨架、邊緣偵測——來條件化生成。IC-LoRA 能夠在推理時根據參考影片幀對影片生成進行條件化,在文字轉影片基礎模型之上實現精細的影片對影片控制。

我使用深度 IC-LoRA 在完全改變視覺內容的同時鎖定鏡頭運動。官方 IC-LoRA 指南對三種控制模式有詳細說明:Canny 用於邊緣保留,Depth 用於鏡頭和空間幾何,Pose 用於人體動作轉移。

資料集準備規則

幀數限制(8n+1 規則)

幀數必須符合 8 的倍數加 1。這不是一個軟性建議——如果你的片段是 10 幀或 15 幀,訓練器會報錯或在內部自動補齊。我在上傳前將資料集批次處理為 17 幀(2 × 8 + 1),訓練順利進行。

解析度整除性(32px 規則)

寬度和高度必須能被 32 整除。我在將一批影片調整為 1024×576 後才學到這一點,訓練器悄悄地將其補齊為 1024×608。最好提前正確調整尺寸。

影片與圖片資料集:各自的使用時機

純圖片資料集對 LTX-2.3 LoRA 訓練是有效的。這比過早強制學習動作要容易得多,尤其是對於識別或風格 LoRA。我每個專案都從靜態圖片開始,驗證外觀效果,如果動作很重要,再加入短影片片段。

對於動作密集的工作,短而連貫的片段仍然優於長的多場景片段。

基準訓練設定

Rank 32 作為正確預設值及何時提高

對於 LTX-2.3,rank 32 是正確的預設值。它通常提供足夠的容量,而不會讓 LoRA 過早變得僵化。我在一個複雜的風格 LoRA 上測試了 rank 64,幾乎沒有看到改善——額外的容量沒有幫助,因為我的資料集不夠大或多樣化,無法填滿它。

學習率起點及何時調整

對於 LTX-2.3 LoRA 訓練,1e-4 是正確的起始點。這是那些「枯燥的答案就是正確答案」的情況之一。我前四個 LoRA 都沒有調整學習率,它們全部都收斂得很乾淨。

步數:如何知道何時提前停止

許多使用者在沒有先檢查 checkpoint 250、500 或 750 是否已經效果良好的情況下,就直接跳到高步數,白白浪費了時間。我在 checkpoint 500 進行採樣,如果 LoRA 效果已經很好,我就在那裡停下來。如果 LoRA 在 checkpoint 750 或 1000 時已經效果很好,繼續推進只會讓它變得更脆弱。

過擬合的表現是模型記憶訓練資料而非泛化。驗證樣本開始看起來與訓練幀完全相同。

IC-LoRA:深度、姿勢和邊緣控制

IC-LoRA 與標準風格 LoRA 的差異

IC-LoRA 將動作與視覺風格分離。你用文字和風格 LoRA 控制外觀,用結構化引導控制運動。LTX-2.3 IC-LoRA 聯合控制模型在單一適配器中支援多種控制信號——深度、姿勢、邊緣。

我在一個產品旋轉序列上運行了深度 IC-LoRA。鏡頭路徑被鎖定在參考深度圖上,但視覺內容根據我的提示詞完全改變了。

ComfyUI IC-LoRA 工作流程整合

RunComfy LTX 2.3 IC-LoRA 工作流程自動處理深度、姿勢和邊緣提取。載入一個參考片段,選擇控制模式,寫一個以風格為主的提示詞,模型會單獨處理動作。

我最初忽略了一個細節:提示詞要專注於外觀,因為 IC-LoRA 負責處理動作和結構。在 IC-LoRA 控制動作的同時試圖在提示詞中描述鏡頭運動會造成衝突。

常見訓練失敗及解決方法

LoRA 滲透到所有內容(DOP 解決方案)

DOP(提示詞遺棄,Dropout of Prompts)是當 LoRA 開始滲透到所有內容時值得使用的第一個進階選項。我訓練了一個產品風格 LoRA,它在相似物品上效果很好,但開始影響不相關的主題。添加 caption dropout 幫助 LoRA 更好地泛化。

高步數下的過擬合

不要把更多步數視為通用的品質提升。我將一個動作 LoRA 訓練到 2,000 步,發現它開始重現確切的訓練幀,而不是學習底層模式。回滾到了 checkpoint 750。

Caption Dropout 與 Cache Text Embeddings 的衝突

如果使用了 caption dropout,Cache Text Embeddings 應該保持關閉。這是為數不多的幾個小設定之一,如果使用不當會悄悄讓訓練效果變差。我曾同時啟用兩者,得到了不一致的結果——模型無法決定是依賴快取的嵌入還是處理缺失的 caption。

部署前驗證你的 LoRA

在宣告 LoRA 完成之前,我會進行三項驗證測試:使用相同提示詞有無 LoRA 的效果對比,確認它增加了我期望的效果;使用不同提示詞來檢查泛化能力;以及測試訓練集之外的邊緣案例。如果 LoRA 只在與訓練 caption 非常接近的提示詞上有效,那它就過擬合了。

常見問題

我可以在 A100 或更小的 GPU 上訓練 LoRA 嗎?

LTX-2.3 訓練官方針對配備 80GB+ VRAM 的 Nvidia H100 GPU,雖然配備梯度檢查點和降低解析度後較低 VRAM 的設置也可以運作。我自己沒有測試過 A100 訓練,但官方訓練器文檔將其列為推薦的硬體基準。

在 H100 上訓練一個風格 LoRA 需要多長時間?

根據實際報告,在單張 4090 上,中等規模資料集的每個 LoRA 大約需要 3-5 小時,包括驗證和小幅重啟。H100 應該更快,但我沒有直接的數據。

LTX-2 的 LoRA 無需重新訓練就能在 LTX-2.3 上使用嗎?

不能。LTX-2.3 搭載了一個完全重新設計的 VAE,以更高品質的資料訓練,文字連接器架構也發生了變化。來自 LTX-2 的舊 LoRA 無法乾淨地遷移——我測試過,出現了視覺偽影。

IC-LoRA 可以與風格 LoRA 組合使用嗎?

可以。你可以同時疊加最多三個 LoRA 適配器,將自訂美學與結構控制融合。我在 IC-LoRA 載入器之前運行了一個風格 LoRA,並將其權重保持在適中水平,以便 IC-LoRA 能夠維持幾何形狀和時序。

LoRA 訓練可以通過雲端平台使用嗎?

可以。RunComfy AI Toolkit 和 fal.ai 都提供基於瀏覽器的訓練,無需管理 GPU 基礎設施。上傳你的資料集,配置參數,完成後下載 LoRA。

為 LTX-2.3 訓練 LoRA 並不神奇。 這只是資料集準備、基準設定,以及知道何時提前停止。8n+1 幀規則和 32px 整除限制一開始感覺很任意,但它們只是模型的幾何要求。順應它們,而不是繞過它們。

讓我出乎意料的不是複雜性——而是我在第一次運行時,堅持使用 rank 32 和 1e-4 學習率而不是調整每個參數,所節省的大量時間。

延伸閱讀: