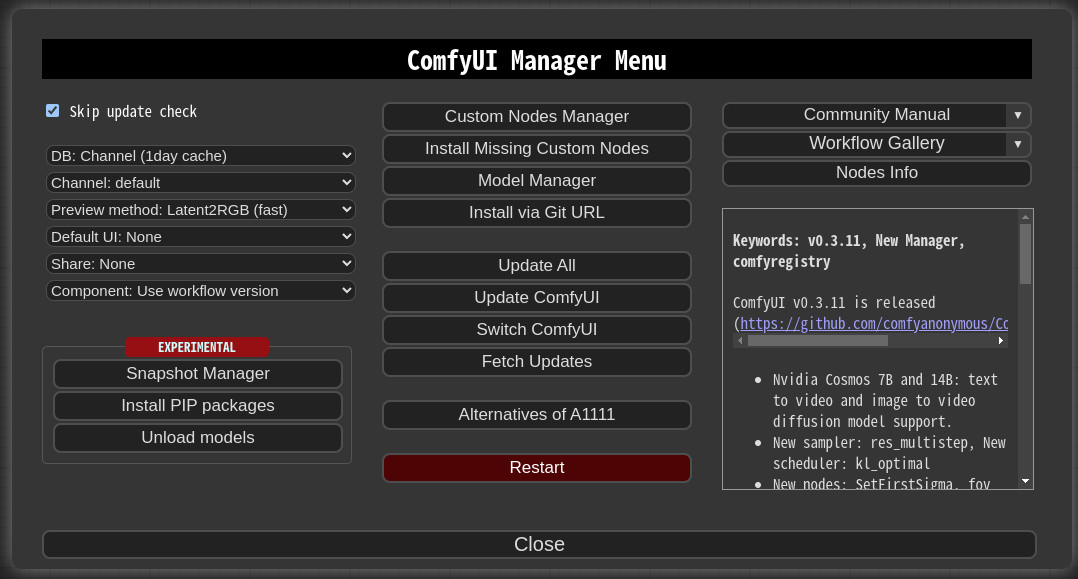

LTX-2.3 ComfyUI 設定指南:兩階段流程、VRAM 修復與 Gemma 編碼器

在 ComfyUI 中設定 LTX-2.3:檢查點放置、Gemma 3 12B 編碼器配置、兩階段生成流程,以及適用於消費級 GPU 的低 VRAM 策略。

嗨,大家好,我是 Dora。說真的,我當初並沒有打算換版本。我在 ComfyUI 裡的 LTX-2 設定運行得好好的,我也不是那種「新的就換」的人。但上週(2026 年 3 月),我一直看到關於 LTX-2.3 的小筆記:更佳的連貫性、全新的文字編碼器(Gemma 3 12B),以及兩階段路徑,承諾能讓畫面更銳利,同時不會把 VRAM 榨乾。

我選了個安靜的早晨,把工作流程遷移過去。 以下是我實際發現的變化、遇到的問題,以及讓工作感覺更輕鬆的部分。如果你只是在找安裝步驟:文章裡有,但真正有用的是我在一天天建構 LTX-2.3 ComfyUI 工作流程 時注意到的取捨。

LTX-2.3 在 ComfyUI 中有什麼不同(對比 LTX-2 設定)

LTX-2.3 ComfyUI 感覺更像是朝著穩定性的微幅改進,而非跨越式的飛躍。模型以 Gemma 3 12B 作為文字編碼器,建議採用兩階段管線:先以半解析度生成基礎構圖,再用 LTX 專用的上採樣器放大潛空間。實際操作上,這對我改變了兩件事:

- 在適中的步數下,提示詞的呈現更加一致。在第一階段控制在 25–35 步以內時,「模糊」細節明顯減少。

- VRAM 的峰值波動比我預期的小,前提是要尊重階段邊界,不要試圖一次強行跑完全解析度。

我也發現舊的 LTX-2 節點大多還能用,但 LTX-2.3 更偏好使用自己的採樣器與潛空間上採樣器節點。光換掉 checkpoint 是不夠的,這也是我最初踩坑的地方。

必要檔案與資料夾結構

以下是我在幾次失敗嘗試後確定的設定,沒什麼花俏的——就是讓紅色錯誤框消失的最低需求。

Checkpoint 選項(dev / fp8 / distilled + distilled LoRA)

- dev:適合探索嘗試。稍微吃更多資源,但我發現提示詞跑偏時它比較包容。

- fp8:更節省 VRAM。在我的 12GB 顯卡上,fp8 讓我能在解碼時維持批次大小為 1 而不發生 OOM。畫質略有下降,但對社群媒體或行銷素材來說並不明顯。

- distilled + distilled LoRA:在我的測試中,商品類拍攝的輸出最乾淨,但要記得實際載入 LoRA 並設定權重(0.6–0.8 對我來說有效)。沒有啟用 LoRA 的話,結果會更接近 dev 版本。

所有 checkpoint 放在 ComfyUI/models/checkpoints。我把 LoRA 放在 ComfyUI/models/loras,並用與基礎 checkpoint 相同的主檔名命名,方便快速找到配對。

Gemma 3 12B 文字編碼器:下載與放置

LTX-2.3 需要 Gemma 3 12B 文字編碼器。根據你的節點組合,你會使用 PyTorch 權重或 GGUF 檔案(用於 llama.cpp 支援的節點)。兩種我都試過。

- PyTorch 路線:放在 ComfyUI/models/clip(部分節點會自動偵測此位置)。如果節點要求不同資料夾,按照文件說明來,不要硬撐。

- GGUF 路線:放在 ComfyUI/models/llm(或節點專屬的 text_encoders 資料夾)。Q4_K_M 是我的甜蜜點:Q3 更省記憶體,但長提示詞的細緻度會有損失。

如有疑問,打開節點的「?」說明或 README。資料夾名稱很重要。

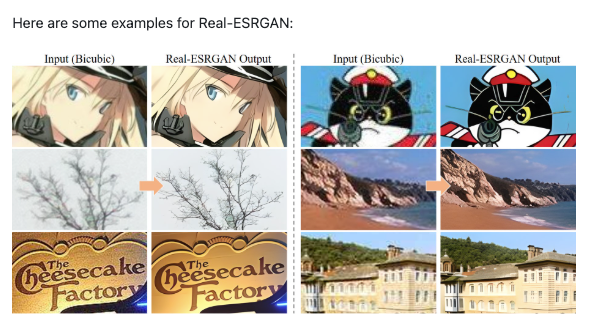

上採樣器模型:何時需要

如果你使用的是 LTX 潛空間上採樣器,就不需要外部圖像上採樣器。話雖如此,我還是在 ComfyUI/models/upscale_models 裡保留了一個 4x ESRGAN 和 SDXL x2 潛空間上採樣器,用於非 LTX 圖像。對 LTX-2.3 而言,內建的 LTXVLatentUpsampler 在邊緣和類文字形狀方面的表現優於 ESRGAN。

兩階段管線詳解

我一直想跳過第一階段,那是個錯誤。兩階段路徑最終反而更易於理解,對 VRAM 也更友善。

第一階段:以半解析度建立基礎構圖

我以目標尺寸的一半生成(例如,最終輸出 1280×768,就先跑 640×384)。這個階段確定構圖與主體細節。25–35 步,CFG 適中(4–6),批次大小 1。如果有問題——手部、佈局、色偏——在這裡修正成本最低。

我注意到:簡化提示詞並最多使用一兩個風格錨點時,「飄移」現象明顯減少。LTX-2.3 似乎偏好聚焦的語言。

第二階段:用 LTXVLatentUpsampler 提升銳利度

接著將第一階段的潛空間傳入 LTXVLatentUpsampler。這會銳化邊緣並恢復精細細節,同時不會重新生成構圖。上採樣通常跑 15–20 步。它不是魔法橡皮擦:如果基礎有問題,上採樣器只是讓問題更清晰而已。

Dev + Distilled LoRA vs 完整 Distilled:該選哪個

- Dev + Distilled LoRA:探索風格時我的預設選擇。彈性稍高。我把 LoRA 強度設在 0.7 左右,視紋理是否過擬合再微調。

- 完整 Distilled:需要批次快速且一致輸出時使用。對提示詞要求更嚴,但省心——每次跑的驚喜更少。

如果卡關了,可以試試第一階段用 dev(較寬鬆),第二階段用 distilled(較嚴格)。這個組合替我救了一組情緒肖像系列。

Gemma 3 12B 編碼器設定:VRAM 管理

Gemma 3 12B 是我預期會最頭痛的地方。實際上並不糟,只是需要一些護欄。

在 VRAM 吃緊時將編碼器卸載至 CPU/RAM

在 12GB 顯卡上,我在文字處理階段將 Gemma 編碼器卸載到 CPU。每次跑多了幾秒,但停止了第一階段的 OOM 問題。如果你的節點支援 混合裝置載入,可以把注意力層設為 GPU,其餘設為 CPU。感受是:不快,但平穩——不再在靈感迸發時硬崩潰。

—novram 旗標與其他啟動修正

如果你用命令列旗標啟動 ComfyUI,—novram 有助於平滑模型切換時的記憶體峰值。我還做了以下幾點:

- 在測試跑與跑之間,對大型模型停用「保持載入」。

- 在小型自訂初始化中設定 torch.set_grad_enabled(False)(如果你的設定允許),避免無謂的梯度計算。

- 使用更保守的備援方案:當我知道要堆疊 LoRA 時,改用 16-bit 或 fp8 checkpoint。

消費級 GPU 的低 VRAM 策略(12GB / 16GB / 24GB)

以下是我在三台機器(RTX 3060 12GB、4070 12GB 和 4090 24GB)上測試有效的方法:

GGUF 量化模型:Q3 與 Q4 的取捨

- Q3:記憶體最低,載入最快,但提示詞細緻度有損,描述詞重複率增加。

- Q4:稍微吃更多記憶體,連貫性明顯更好。12–16GB 顯卡的首選。24GB 的話,我不量化,或有 Q5 就用 Q5。

VAE 卸載以減少記憶體峰值

解碼是我最常遇到 OOM 的環節。將 VAE 卸載至 CPU 或使用更輕量的 VAE 能降低第二階段末端的峰值。在 12GB 上,即使前面的節點有批次處理,最終解碼我也設為單張圖像——少了不少麻煩。

其他小技巧:

- 第一階段保持適中的解析度,稍後再上採樣。

- 避免堆疊多種引導技巧。一次只用一個 CFG、一個 LoRA。

常見初次執行錯誤與修正

我遇到了常見的紅色框。以下是真正有效的修正方法。

載入後出現缺少節點錯誤

如果 ComfyUI 找不到 LTX-2.3 節點,更新你的 custom-nodes repo 並重啟。部分 LTX 節點還需要較新版本的 ComfyUI 核心。我曾透過刪除節點的快取資料夾並讓它在啟動時重建來修復一個頑固錯誤。

解碼時 OOM

兩個即時有效的方法:將 checkpoint 切換為 fp8,或將 VAE 卸載至 CPU。同時將最後階段的批次降為 1。如果仍然崩潰,將目標解析度減半,讓外部圖像上採樣器完成後續工作。

Gemma 編碼器崩潰

這通常代表資料夾路徑不符,或量化檔案不被節點接受。我從節點 README 中列出的來源重新下載 Gemma 3 12B,驗證校驗碼,並放置在節點預期的位置(clip 或 llm)。Q4 可以正常運作;Q3 在我的 4070 上有時載入失敗,直到我更新到最新的 llama.cpp 支援版本後才解決。

常見問題

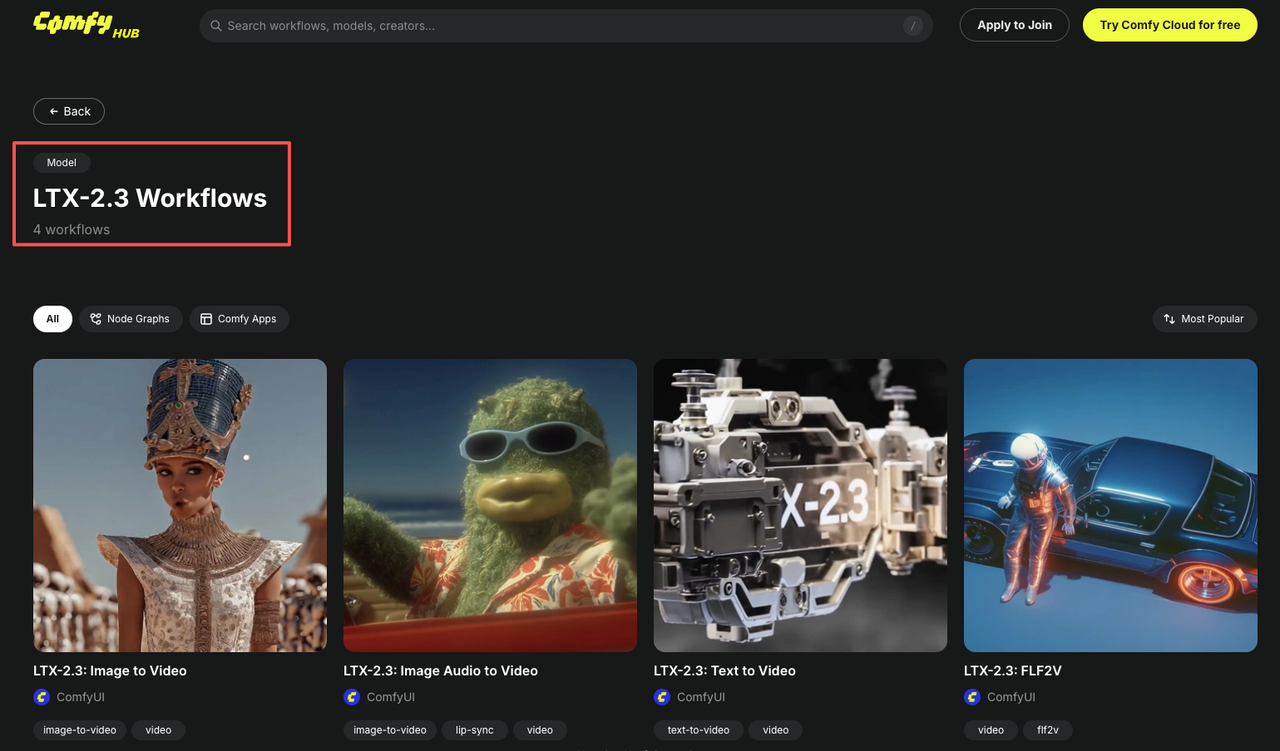

LTX-2.3 的 ComfyUI 節點需要另外安裝嗎?

通常需要。光更新模型是不夠的。拉取最新的 LTX 節點 repo 並重啟 ComfyUI,讓它註冊新的採樣器和潛空間上採樣器。

我能用現有的 LTX-2 工作流程搭配 LTX-2.3 checkpoint 嗎?

部分可以。佈局可以沿用,但我必須換入 LTX-2.3 採樣器和 LTXVLatentUpsampler,並將提示詞指向 Gemma 3 12B。完成這些之後,大多數控制項的行為都正常。

在 ComfyUI 中執行 LTX-2.3 的最低 VRAM 需求是多少?

在 12GB 上,使用 fp8 或 GGUF Q4 的編碼器、第一階段以半解析度跑、VAE 卸載,我能跑出可用的單張圖像。16GB 會更流暢。24GB 的話,可以直接用 PyTorch 並跑得更快。

兩階段管線比單階段快還是慢?

實際時鐘時間可能差不多,但感覺更輕鬆。我花在重跑全解析度失誤的時間少多了。第一階段確立想法,第二階段清理細節。對 12GB 顯卡而言,這也是能創作與不斷崩潰的差別。

我最終對 LTX-2.3 ComfyUI 並沒有感到「興奮」,更像是如釋重負。圖片更快呈現出我想要的樣子,工作流程也不再和 VRAM 起衝突。我會繼續保留兩階段路徑,它安靜,它有效。

相關文章: