通過WaveSpeed API訪問GLM-4.7-Flash

嘿各位,我是Dora。這個想法源於一個小煩惱:又是一個項目、又是一個API金鑰,還有另一個SDK,它對令牌和重試有自己的想法。我想試試GLM-4.7-Flash,因為人們一直在提它在日常草稿和快速研究中的速度。但我不想只是為了執行幾個測試就重新配置我的技術棧。

所以我嘗試了一條更安靜的路:透過WaveSpeed API存取GLM-4.7-Flash。相同的用戶端模式、一個金鑰、模型切換。我在2026年1月測試了這個,跨越幾個指令碼並做了筆記。這都不是什麼戲劇性的事。但它確實讓我的日常工作輕鬆了一點。老實說,那就是標準——輕鬆優於繁瑣。

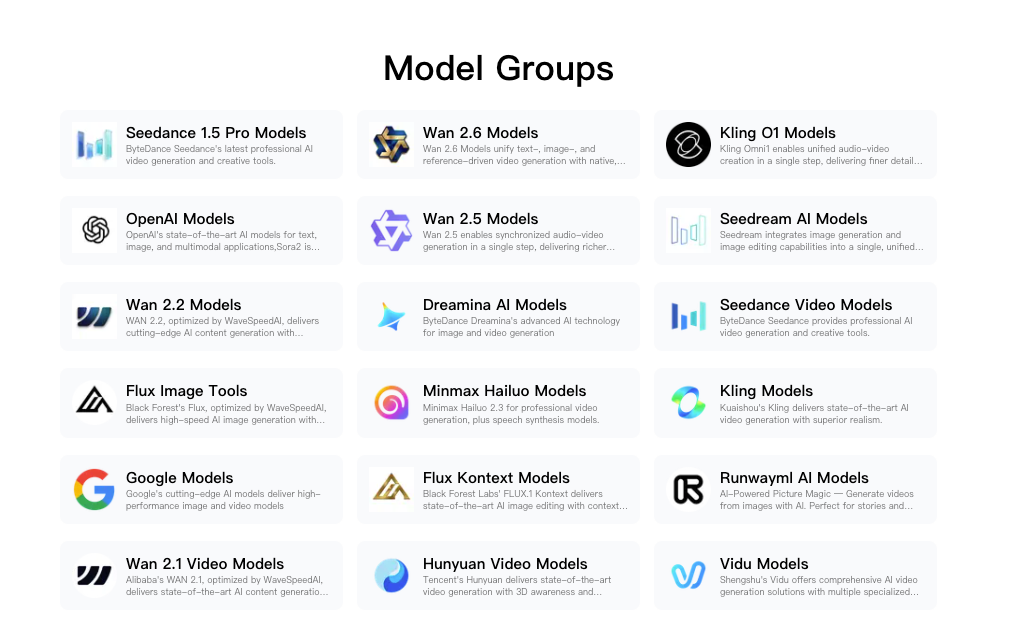

為什麼使用WaveSpeed

我不會聲稱WaveSpeed是魔法。它更像是一個可靠的適配器抽屜:不令人興奮,但當你想繼續工作時,你會伸手去拿的東西。

對我而言重要的不是模型數量,而是摩擦力的缺乏。我可以將相同的程式碼指向不同的模型,交換一行,然後繼續。就是這樣,沒有戲劇。

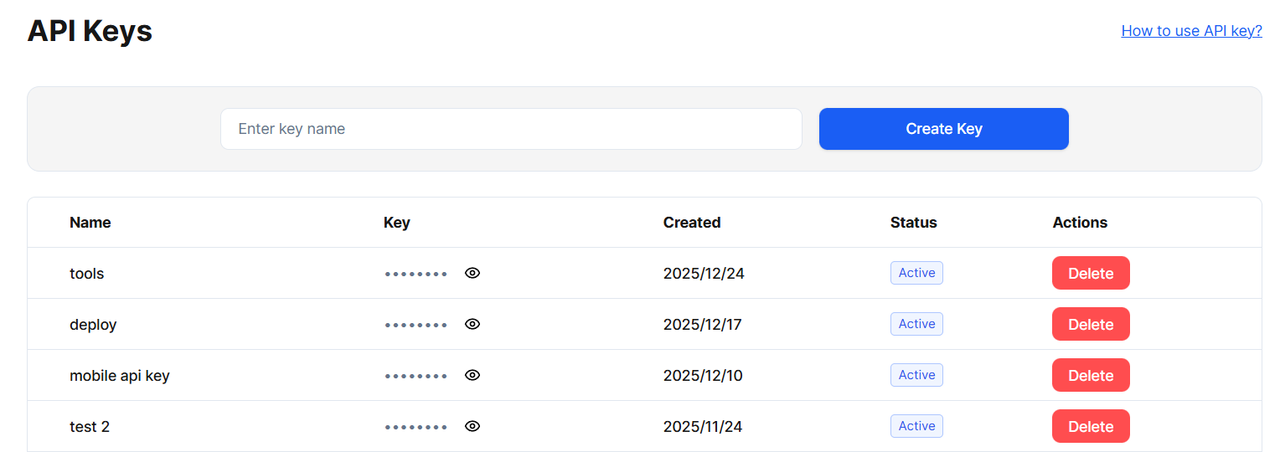

一個API金鑰、600+個模型

我真正的勝利是心理上的。我不需要在提供商儀表板間搜索以輪換金鑰或限制支出。一個金鑰在我的秘密管理器中,我就可以路由到GLM-4.7-Flash進行快速草稿,然後在提示需要更深入時跳轉到更強大的模型。我仍然設定每個項目的限制,但開銷下降了。

實際上:我保留了現有的環境變數(在我的情況下是WAVESPEED_API_KEY),只改變了模型名稱。這個小決定——保持名稱對齊,不要過於聰明——讓我避免了破壞CI。

不用切換SDK

我保留了我已經使用的OpenAI相容用戶端。沒有新的方法名稱,沒有重新學習流式傳輸標誌。如果你已經在聊天完成、流式傳輸和工具呼叫周圍構建了小型實用程式,它們大多會轉移。我喜歡WaveSpeed在返回令牌之前不要求我採納它的世界觀這一點。

我注意到兩個注意事項:

- 模型名稱在提供商之間各不相同。我在提交程式碼之前在官方WaveSpeed文件中再次檢查確切的識別碼。

- 提供商特定的功能(如特殊的回應格式或函式呼叫怪癖)仍然可能有所不同。保留一個小適配器文件,其中你標準化有效載荷。我的是60行,每週都能派上用場。

快速入門程式碼

我使用了WaveSpeed公開的OpenAI式端點。如果你的程式碼已經使用聊天完成API,這應該會感到熟悉。唯一真正的改變是基礎URL和模型名稱。

我在2026年1月12-15日用小批量提示測試了這個。短提示在我的連線上不到一秒鐘就開始流式傳輸。顯然,你的里程數會因網路、提示大小和伺服器負載而異。

直接替換範例

這是我使用的形狀。檢查官方WaveSpeed文件以獲取最新的模型識別碼(我看到它被列為glm-4.7-flash)。

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])我發現有用的小提示:

- 如果你的應用流式傳輸令牌,請沿用相同的SSE解析:WaveSpeed的流標誌在我的測試中表現符合預期。

- 當我不確定模型負載時,我將每個請求的超時設定得略高於平時。

- 在回應中記錄模型名稱。當輸出漂移並且你需要確認運行的內容時,未來的你會感謝你。

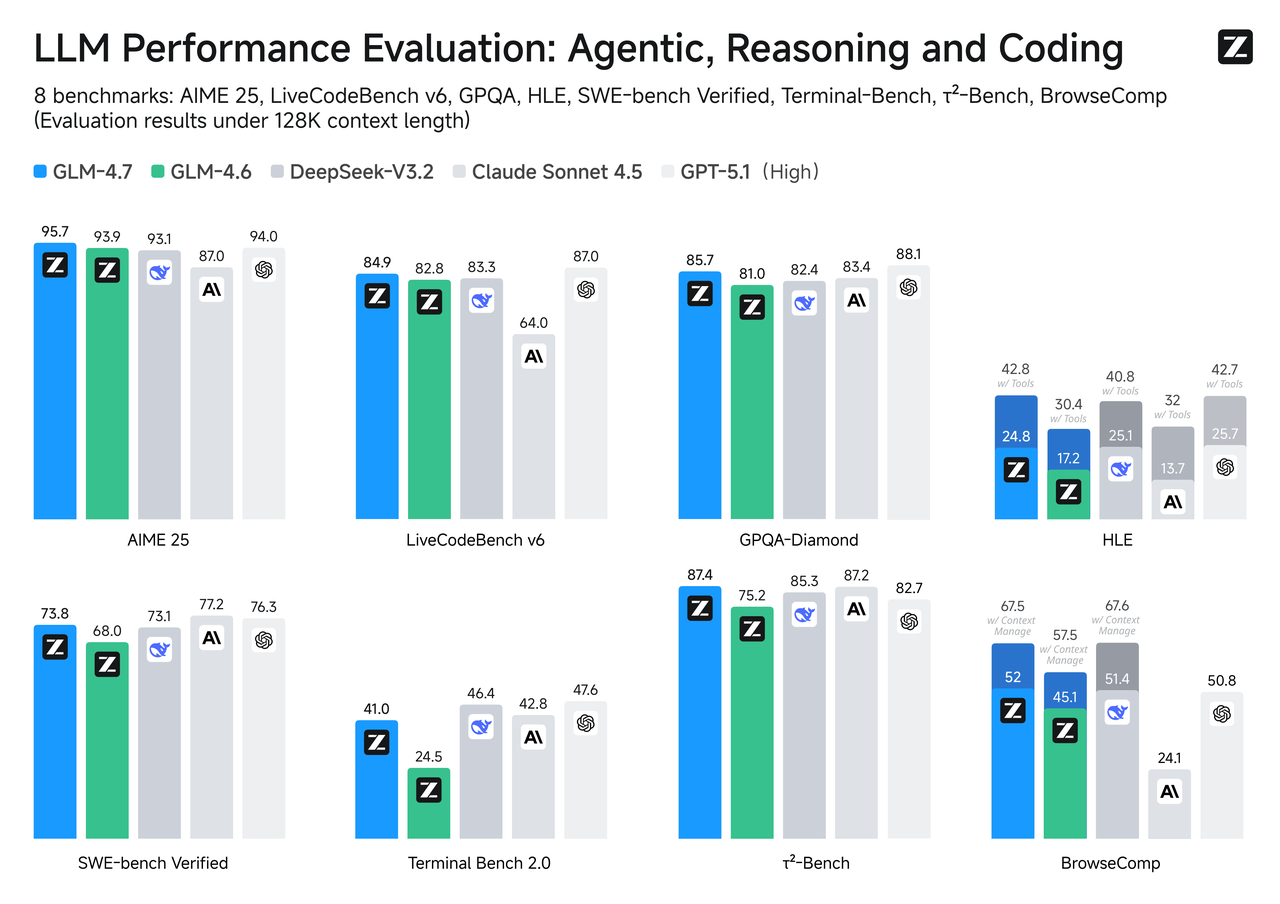

與其他模型組合

我的大部分工作混合了多個模型。GLM-4.7-Flash對於第一遍、草稿、摘要、基本問題回答來說很快。當我需要更強大的推理,或特定功能(如強大的程式碼解釋器或某個視覺功能)時,我會改用其他的。WaveSpeed讓我將該路由保存在一個地方。

有點令我驚訝的是:我預計在執行中切換模型會感到混亂。但它並沒有。提示保持相同的形狀,所以我可以比較輸出而不用扭曲程式碼。

文字+影像工作流程

我嘗試了一個小例程:收集來自用戶報告的螢幕截圖,執行輕OCR或視覺標題,然後要求GLM-4.7-Flash以純文字形式產生動作摘要。

我的步驟:

- 使用能識別視覺的模型從影像中提取文字/標籤。保持輸出簡潔,想想鍵值對或簡短的項目符號。

- 將該文字傳遞給GLM-4.7-Flash,附帶穩定的系統提示(兩行),並要求簡短的摘要和決定。

- 如果影像包含表格,我添加一個快速規則:“完全保留數字和單位。“這減少了後來的清理。

現場筆記:

- 在一個1.2MB的PNG上,混合了UI和文字,視覺遍歷對我來說花費了約2-4秒:GLM-4.7-Flash摘要在不到一秒內返回。該分割使流程感到快速。

- 成本是可預測的,因為我在將視覺輸出交給GLM-4.7-Flash之前將其限制為幾百個令牌。

- 如果你不需要視覺細微差別,先執行基本OCR(Tesseract或付費OCR API),然後將文字傳遞給GLM-4.7-Flash。更便宜,通常也足夠了。

文字+視頻工作流程

視頻更重,很明顯。我沒有將完整視頻發送給任何模型。我先提取了轉錄文字(whisper或付費ASR),然後將片段路由給GLM-4.7-Flash進行快速摘要。

一個有效的循環:

- 轉錄視頻一次。如果可以的話,保留時間戳。

- 按發言者輪流或3-5分鐘片段分塊(其中最簡潔的)。

- 要求GLM-4.7-Flash進行片段摘要和決定。保持系統提示錨定:“你只返回具有字段A/B/C的結構化JSON。”

- 從帶有第二遍的片段縫製頂層大綱。

實際上,GLM-4.7-Flash對於片段摘要感覺恰到好處:快速、低摩擦、計畫用的足夠準確。對於最終大綱,我有時會切換模型以獲得語調或細微差別。我將所有內容保持在WaveSpeed內,所以我的程式碼不會改變形狀。

定價

定價是我放慢速度的地方。不是因為它很複雜,而是因為驚喜出現在日誌中,而不是儀表板中。

WaveSpeed上的GLM-4.7-Flash

截至2026年1月,GLM-4.7-Flash可透過WaveSpeed獲得,具有自己的每令牌速率。確切的數字可能會改變,所以我不會在這裡確認它們。我在向生產推送任何內容之前檢查官方定價頁面,並在我的環境配置中設定軟限制。

我的估計方式:

- 樣本一個典型的提示+回應。乘以每日執行次數。這使我達到每日令牌。

- 為壞日子或新提示添加20-30%的餘量。

- 比較一個較慢但較便宜的模型進行同樣的任務。如果較慢的模型不會增加人工編輯時間,它可能總體會贏。

一個實用的技巧:按功能標誌記錄令牌。我為一部分用戶打開GLM-4.7-Flash並比較編輯時間和投訴。那告訴我比價格表更多的東西。

批量折扣

WaveSpeed提供基於批量的定價。如果你批量工作或執行資料回填,這些層級很重要。我曾經在尖峰週前聯絡過一次以確認閾值:答案很直接,讓我避免了在尷尬的時間窗口中限制工作。

我的規則:如果我預期10倍爆發、活動、遷移或研究衝刺,我首先給支援發電子郵件。重點不是特別協議:而是一個清晰的上限,所以我不需要整夜照看工作,因為沒人想要那樣。

我們為正是這種工作流程構建了WaveSpeed:更少的金鑰、更少的SDK切換,以及更少的時間花在思考基礎設施上。如果你在應付多個模型,只是想讓它們在單個、可預測的API後面表現良好,那就是我們試圖解決的問題。

➡️你可以在這裡探索它。

現在輪到你了:最近你處理過最荒唐的API金鑰亂局是什麼?在評論中說出來——我會一邊啜飲咖啡一邊閱讀所有評論,並感到略微不那麼孤獨。