WAN 2.2 LoRA 訓練設定:最佳學習率、步驟和觸發詞

嘿,朋友們。你知道嗎?我很喜歡 WAN 2.2 處理皮膚和光線的方式,但我慣常的 LoRA 訓練習慣並不能直接套用。臉部看起來太有光澤,模型一直把背景拉進同樣柔和的攝影棚外觀。這並不是「錯誤」,只是不符合我的風格。所以在 2026 年 1 月初,我進行了一些短期實驗,找到了適合 WAN 2.2 的 LoRA 訓練設定,感覺還不錯。沒什麼花哨的。只是足以降低塑膠光澤,保持主題穩定,同時讓基礎模型有發揮空間。

如果你在找快速範本:這不是那種東西。我在分享在多次運行中驗證過的設定、我的猶豫之處,以及我如何調整。這裡的目標關鍵詞很清楚——WAN 2.2 LoRA 訓練設定——但目標是更輕鬆的工作,而不是新的兔子洞。

為什麼 WAN LoRA 有所不同

我注意到 WAN 2.2 的表現就像一個非常固執的 SDXL 檢查點:它針對清晰肖像、光滑漸層和電影化光線進行了調優。當我按照我在普通 SDXL 基礎上訓練 LoRA 的方式訓練時,WAN 一直把我的結果推回那種拋光過的攝影棚外觀。

現場筆記:

- 提示詞引力很強。即使是輕微的權重(0.4–0.6)也會拉向乾淨的皮膚和對稱的構圖。

- 顏色聚類早期就會出現。如果你的資料集偏暖色調,WAN 會放大它。

- 背景同質化。沒有調整,它會預設為淺景深和柔和散景,無論你輸入什麼。

實踐中改變的是:我降低了學習率,使用了比平時更多的正則化圖像,並有意保持標題無聊。WAN 2.2 獎勵克制。當我試圖同時「教」風格和主題時,過擬合很快就會爬進來。

如果你是從 SD 1.5 LoRA 習慣過來的,想想:更少的聰明技巧,更多受控的基線。如果你習慣了 SDXL,速度稍微慢一點,更早地烘焙正則化。

資料集大小指南

我進行了四次通行,使用精心整理的肖像集(2026 年 1 月 5–12 日),每個集合都有整潔的標題和混合光線。以下是驗證過的結果:

- 8–12 張圖像:足以錨定特定的人物或產品輪廓。使用強力正則化。保持構圖多樣化。

- 15–30 張圖像:單一主體身份加溫和風格的黃金分割點。如果你想讓背景泛化,添加 20–40% 的非肖像照片。

- 40–80 張圖像:當你編碼一致的品牌外觀或多角度物體系列時很有用。你需要小心的標題和更多步驟。

比原始數量更重要的事情:

- 姿勢多樣性優於位置多樣性。WAN 很好地泛化位置:它在每張照片角度都相同時掙扎。

- 曝光平衡。如果你的集合中一半的曝光不足,WAN 稍後會使所有東西變暗。我在訓練前標準化了直方圖。

- 標題簡潔性。描述性的,不詩意的。「subject_token,牛仔夾克,窗戶光線,中等特寫」優於「窗邊下雨時的憂鬱坦率肖像」。

對於身份 LoRA,我降落在 12–20 張圖像作為可靠的底線。對於風格 LoRA,30–50 張給了我充足的空間,而不會崩潰到 WAN 的預設肖像光澤。

LR/步驟基線

對我來說感覺穩定的 WAN 2.2 LoRA 訓練設定(Kohya-ss 和 SDXL 基礎):

- 秩(dim):16–32。我預設為身份 16,風格 32。

- Alpha:匹配 dim(例如 16/16)。較低的 alpha 使結果不穩定。

- 優化器:帶有 weight_decay 0.01 的 AdamW。

- 學習率:身份 5e-5,風格 7e-5 到 1e-4。WAN 用塑膠感皮膚和損失尖峰懲罰高 LR。

- 調度器:帶預熱的餘弦。預熱總步驟的 5%。

- 批次大小:2–4(A100/4090)。梯度累積以模擬 8(如果需要)。

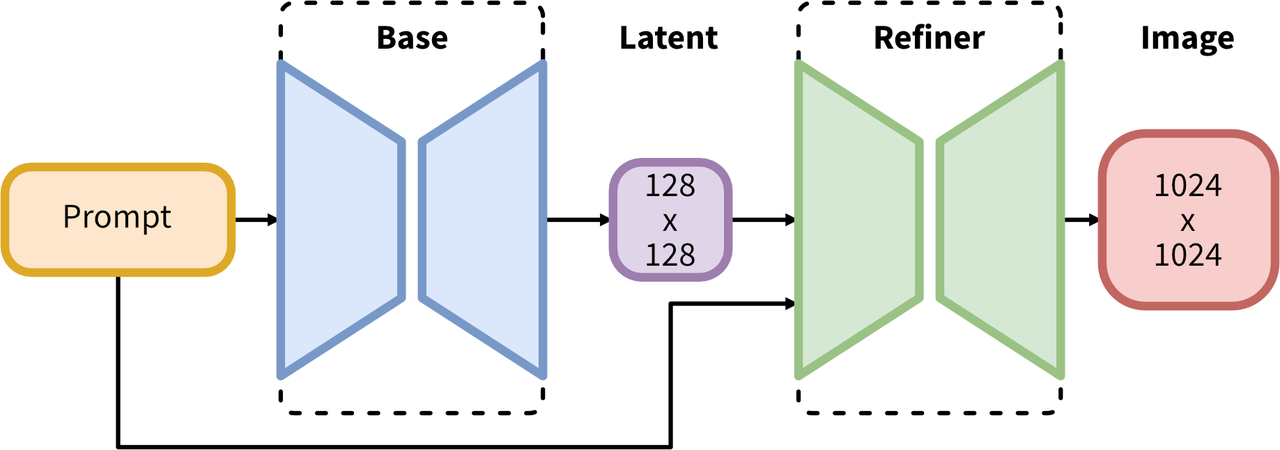

- 解析度:SDXL 原生的長邊 1024,帶分桶(例如 1024×768、1024×1024)。不要放大:它只是記憶噪聲。

- 輪數/步驟:我按步驟停止,而不是輪數。

- 12–20 張圖像:1,200–2,000 步

- 30–50 張圖像:2,000–3,500 步

- 60–80 張圖像:3,500–5,000 步

我使用的完整性檢查:

- 每 200–400 步保存一次,並用固定提示詞 + 種子預覽。

- 如果樣本在第 600 步之前銳化得太快,LR 太高。

- 如果在 20 張圖像集合上約 1,400 步後身份沒有鎖定,標題或正則化的偏差超過 LR。

這些數字不會贏得排行榜,但它們抵抗 WAN 對將所有東西磨光滑的傾向。

觸發詞策略

我保持觸發詞最少。WAN 已經有很強的先驗:堆積可愛的標記只會增加噪聲。

我做的是:

- 一個實例標記 + 一個類別標記。例如:「sora_person」作為實例,「person」或「woman/man」作為標題中的類別。

- 將實例標記放在每個標題的開頭。保持小寫,如果可以的話只有一個詞。

- 避免在同一 LoRA 中使用風格標記,除非你真的想要一個風格 LoRA。在 WAN 2.2 中混合身份和風格很快變得混亂。

在提示詞中,我只調用 LoRA 和實例標記,然後進行輕微的調整:

- LoRA:名稱在 0.5–0.8

- 實例標記在提示詞早期

- 風格詞在後期和輕微(「自然光,乾淨顏色,最少修飾」)

我出於好奇嘗試了發明的「WAN 風格」觸發詞。它們沒有幫助。基礎已經做了那部分,LoRA 應該刻出你需要的,而不是重新宣佈 WAN 2.2 擅長的。

正則化圖像

這是無聲的英雄。我為每個訓練圖像使用了 1–3 倍的正則化圖像,與標題進行了類別匹配。

- 對於身份 LoRA:20–60 張標籤為同一類別(「person」)的正則化圖像。我用普通提示詞從 WAN 2.2 本身生成了它們:「一個人的照片,中性背景,中等特寫,自然光」。

- 對於物體 LoRA:每個產品類別的正則化圖像(「鞋」、「瓶子」、「椅子」)。保持準確:不要混合類別。

為什麼它重要:WAN 2.2 喜歡在所有東西上烙印其肖像美學。正則化圖像給了它許可證保留基礎的範圍,同時讓 LoRA 保持身份。沒有它們,我的 LoRA 會過度強調皮膚光滑和散景,然後拒絕離開。

感覺正確的設定:

感覺正確的設定:

- 保持正則化圖像視覺上平淡且曝光良好。

- 不要用實例標記為正則化圖像編標題:只有類別。

- 在整個訓練中混合 10–20% 的訓練批次與正則化圖像(不只是開始時)。

如果你時間緊張,在你調整優化器之前添加正則化圖像。這是更大的槓桿。

過擬合檢測

我不依賴損失。WAN 在漂亮的樣本後隱藏過擬合。這些是我的線索:

- 提示詞慣性:改變提示詞幾乎不改變輸出。一切都漂移回相同的鏡頭和背景。

- 皮膚可塑性:毛孔均勻消失,特別是在頰骨和額頭周圍,即使有粗糙光線提示詞。

- 姿勢回聲:在不同種子中重複的肩膀/頸部角度。

- 顏色鎖定:一種溫色調在不同白平衡線索中粘著。

我每 200–400 步運行的快速檢查:

- 對抗性提示詞:切換到「刺眼的頭頂辦公室燈光,螢光,不討好」,看質地是否回復。

- 背景翻轉:強制「繁忙的街道,凌亂的架子」來測試構圖靈活性。

- 負面提示詞壓力:添加「過度光滑的皮膚、塑膠質地、重度修飾」,看它是否聽從。

如果連續兩次測試失敗,我會回滾到上一個檢查點,要麼添加更多正則化圖像,要麼把 LR 降一個台階。

修復崩潰

我遇到了兩種崩潰:身份融合和風格鎖定。

當身份融合時(臉部漂移,眼睛未對齐):

- 降低 LR 一步(例如 7e-5 → 5e-5)。

- 只有在資料集有足夠角度時才將秩從 16 增加到 32:否則它會記憶姿勢,而不是身份。

- 緊縮標題:去掉形容詞,保持焦距提示,保持實例標記在前。

- 添加 10–20 張更多相同類別的正則化圖像。

當風格鎖定時(一切看起來像 WAN 的預設攝影棚肖像):

- 將非肖像照片添加到資料集(環境、手部、局部身體)。

- 用餘弦調度增加 400–800 步:不要尖峰 LR。

- 降低推斷時的 LoRA 權重(0.8 → 0.5)並降低引導(CFG 5–6 → 3.5–4.5)。WAN 對較低 CFG 反應良好。

- 如果使用噪聲偏移或重度顏色擴充,撥回它們。WAN 已經穩定顏色:額外擴充使我的輸出變得混亂。

其他有幫助的控制:

- 在 1.0 時進行梯度剪裁以避免突然尖峰。

- 對於小運行關閉 EMA:使用微型資料集,EMA 使身份滯後於預覽。

- 種子紀律:每次用固定種子預覽。當其他一切都靜止時,小變化更容易判斷。

導出和重複使用

一些習慣節省了我以後的時間:

- 用清晰的名稱保存增量檢查點:模型、秩、LR、步驟和日期。例如:wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors。

- 如果你的工具支持,在 LoRA 元資料中保留訓練提示詞、驗證提示詞和種子。未來的我總是感謝過去的我。

- 版本粘性使用:在 WAN 2.2 上訓練的 LoRA 在 WAN 2.2 和近親身上效果最佳。它們在其他 SDXL 基礎上可用,但顏色和皮膚處理會改變。我把它們視為「WAN 優先」。

- 感覺良好的推斷預設:

- LoRA 權重 0.5–0.8(身份)、0.3–0.6(風格疊加)

- CFG 3.5–5.5

- 30–40 步,穩定採樣器(DPM++ 2M Karras 效果不錯)

- 保持提示詞簡短:WAN 聽到細微的轉向

如果你想合併 LoRA:我用堆積小型、單一目的的 LoRA(身份在 0.6 + 溫和顏色外觀在 0.3)比訓練一個大「所有東西」LoRA 有更好的運氣。WAN 尊重模組化。

有關更詳細的 WAN 2.2 工作流程和示例,請查看 官方 ComfyUI 文檔。

對於訓練,我仍然喜歡在本地運行,這樣我可以看到每個控制。但當涉及推斷、模型路由或在不同基礎模型之間切換而不用調整 API 時,你可以嘗試我們的 WaveSpeed。它將不同的模型放在一個一致的端點後面,所以我可以專注於提示詞和輸出,而不是基礎設施。

對於訓練,我仍然喜歡在本地運行,這樣我可以看到每個控制。但當涉及推斷、模型路由或在不同基礎模型之間切換而不用調整 API 時,你可以嘗試我們的 WaveSpeed。它將不同的模型放在一個一致的端點後面,所以我可以專注於提示詞和輸出,而不是基礎設施。