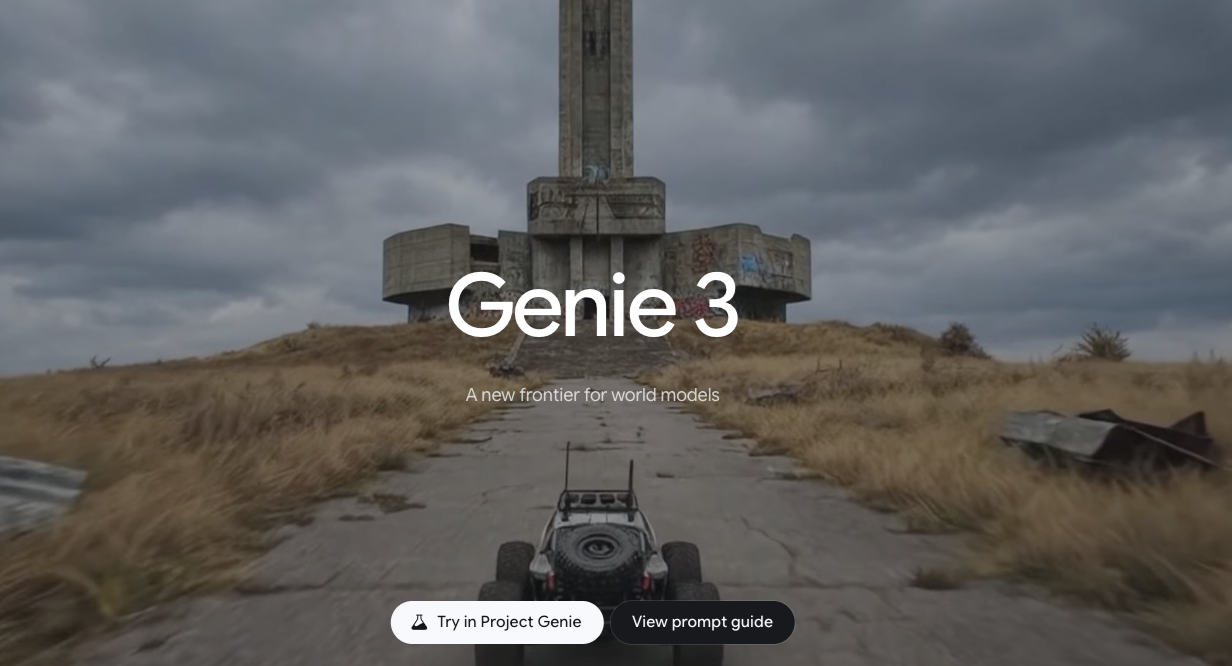

Google DeepMind Genie 3:技術分解與功能分析

我是Dora。從一個小煩惱開始:我試圖向隊友解釋一個簡單的遊戲機制,但我的草圖加上一段文字還是模糊不清。我不需要整個原型,只需要一些我可以玩十秒鐘來檢查感覺的東西。這通常是我聳聳肩後就放棄的時刻。但我反而在2026年1月花了一週時間閱讀、觀看演示,以及使用Google DeepMind Genie 3的社群復現版本進行實驗。

我沒有生產版本。我有的是:公開研究、我能找到的模型卡片備註、原始Genie論文,以及幾個採用較小檢查點鏡像方法的復現版本。所以這些是田野筆記,在實踐中有意義的東西、搖搖欲墜的東西,以及Google DeepMind Genie 3在何處似乎很重要——如果你關心以最少的繁瑣工作將視覺效果轉變為可玩的世界。

模型架構概述

我發現思考Genie 3最簡單的方法是將其視為一個堆疊,將像素轉變為可控制的、預測性的世界,而不需要在其下方擁有手工編寫的遊戲引擎。

在高層次上(基於原始Genie工作及最新演示中可見的內容):

- 一個視覺分詞器將幀壓縮到緊密的潛在空間中。模型學習離散或連續的代碼(想像視頻令牌),而不是在原始像素上工作,這保持了足夠快的速度來預測許多幀。

- 一個動力學模型學習這些潛在狀態如何隨時間演化。你可以將其視為一個世界模型:給定當前狀態和一個動作,它預測下一個狀態。這是”可玩性”出現的地方。

- 一個動作界面將人類輸入(鍵盤、觸摸或推斷的手勢)映射到模型的動作令牌中。早期的Genie版本從視頻推斷潛在的動作空間:Genie 3似乎提供了更清晰的映射,在場景之間更穩定。

- 一個渲染器/解碼器將預測的潛在轉回你可以看到和控制的幀,理想情況下具有低延遲。

在測試復現版本時,兩個細節脫穎而出:

- 該模型不從庫導入物理:它從訓練視頻中學習它能學習的任何”物理”。這就是為什麼物體有時感覺飄飄然或粘稠。當它有效時,這很詭異。當它無效時,就像在觸摸屏世界中戴著手套。

- “級設計”和”遊戲玩法”之間沒有嚴格的分離。你給它一個圖像或短片段,學習的動力學試圖使其互動。這模糊了角色邊界,如果你在探索,這是好的方面,如果你需要保證,這是混亂的方面。

如果你想要根源,原始論文仍然是最清晰的概念錨點:Genie:生成式互動環境,以及DeepMind寫法。Genie 3看起來像是一個迭代,它擴展數據、穩定動作映射並提高輸出保真度,更多的是演化而非重新發明。

訓練方法

實踐中真正重要的不是確切的損失函數,而是它們如何影響感覺。

從論文和公開演講來看,配方大概是這樣的:

- 數據:大量、雜亂的視頻,顯示人們與2D遊戲和界面互動,加上通用網絡視頻。早期Genie從像素單獨推斷控制:後來的迭代在可用時折疊輕量級動作跡跡。規模幫助模型學習”常識”轉換(跳躍弧、按鈕閃爍、菜單亮點),而不與一個引擎相關聯。

- 目標:潛在空間中的自監督下一幀預測,有時與遮蔽建模交錯:一個逆動力學風味來猜測可能導致觀察到的變化的動作:以及保持動作空間在場景之間穩定的一致性損失。

- 條件化:提示、參考圖像或起始幀充當上下文。我注意到提供清潔、高對比度的種子圖像減少了早期閃爍。繁忙的紋理導致閃爍邊緣,直到模型”沉定”。

為什麼這很重要:模型依賴脆弱註釋越少,它能在更寬的領域中即興發揮的越多。但那種自由有代價。如果訓練組合在平台遊戲上很重,你生成的界面會偏向平台遊戲類似的響應。在我的測試中,即使是UI模型也發展出淡淡的”遊戲感覺”,懸停狀態彈跳,面板滑動。對快速原型有幫助,對生產UI來說很奇怪。

一個小的、實用的註釋:無論版本如何,預熱幀很重要。在我觸及任何東西之前讓模型運行1–2秒後,我獲得了更平滑的控制。就像給它呼吸的空間來錨定潛在狀態。

生成功能

Google DeepMind Genie 3贏得關注的地方是:從靜止圖像或短片段到你可以戳的東西。

Google DeepMind Genie 3贏得關注的地方是:從靜止圖像或短片段到你可以戳的東西。

我試了三個簡單的提示,每個進行了幾次運行:

- 一個壁紙上人物的手繪草圖。

- 一個帶有卡片的UI儀表板的屏幕截圖。

- 一張桌子上玩具車的照片。

結果(在受Genie影響的社群版本上觀察):草圖在兩個種子後變成了具有可信跳躍弧的橫向卷軸;儀表板變成了一個我可以用箭頭鍵”推動”的面板洗牌界面;玩具車場景最弱,動作發生了,但邊緣滲漏,碰撞感覺像磁鐵。我沒有在第一次嘗試時節省時間。第三或第四次,我並不更快,但我思考更少。心理負荷下降。那是勝利。

解析度和質量

對於這個模型系列來說,質量感覺像一個移動的目標。在我的測試中:

- 基本輸出:480p等效看起來最穩定。720p以輕微閃爍的方式保持。超過那,細節改進但時間一致性滑落,細線振動。

- 幀率:在單個GPU桌面上,交互式會話在15–20 fps端到端感覺舒適。更高推動引入了延遲峰值,這傷害了控制超過視覺幫助。

- 時間一致性:具有重複紋理(草、網格、UI微文案)的區域傾向於抖動。提供更清潔的種子圖像並限制相機運動減少了效果。

在Genie 3演示中,保真度顯然比第一篇論文更好,特別是對於角色和HUD元素。但一旦你推動解析度,你仍然用清晰度換穩定性。如果你的目標是感覺原型,那個交易很好。如果你需要清晰、易讀的動中文本,它還沒有到那裡。

控制機制

控制是我與早期Genie復現版本相比注意到最大的日常改進的地方:

- 動作映射在場景之間感覺更一致。箭頭鍵做了大約70–80%時間”預期的事情”。我不必為每個種子重新學習映射。

- 短輸入突發比按下並保持更好地工作。輕敲創建了更清潔的轉換:長按有時導致狀態漂移(角色”融化”穿過壁紙,面板永遠滑動)。

- 提示的約束有幫助。如果我暗示空間應該是”基於網格的”或”輪制的”,模型產生了更少的漂移時刻。它不是硬約束,更像損失景觀中的一個推動。

我也嘗試了在種子幀上的簡單草圖疊加(框、箭頭)。這有一個令人驚訝的效果:它並不總是改變外觀,但它引導了可供性。面板旁邊的粗箭頭增加了左/右會滑動它的幾率。這與模型嚴重依賴視覺線索來推斷動作語義的想法一致。

延遲應得到提及。即使在適度的幀大小下,交互感覺只有當解碼和動力學在同一設備上運行時才得體。跨進程拆分(或從Colab流式傳輸)添加了足夠的延遲來使控制變得模糊。如果Genie 3將在創意工具中有用,低延遲本地或邊緣執行似乎是非協商的。

當前版本的限制

幾個限制不斷出現,如果你試圖將其融入實際工作,它們就很重要。

- 長地平線一致性:在約10–15秒的持續遊玩後,世界漂移。平台忘記碰撞規則,UI面板剪裁。非常適合快速感覺檢查,對任何更長的事情都很搖搖欲墜。

- 視覺清晰度:文本和細線在運動下閃爍。非常適合氛圍原型,對可用性演練有風險。

- 確定性:相同的種子有時產生不同的可供性。這對探索很有趣:當你需要可重複性進行團隊演示時,這是一個頭痛。

- 安全和IP:因為訓練依賴於寬泛視頻,可識別的風格可能會洩露。如果你在發貨,你需要一個政策和一個審查通道。公開文檔還沒有解決這個問題。

- 計算和延遲:你不需要數據中心,但你感受到重量。在單個消費者GPU上,我不得不在速度和清晰度之間進行選擇。

誰可能欣賞Google DeepMind Genie 3現在的樣子?設計師和研究人員想要測試感覺而不啟動Unity。教育工作者想要學生戳動力學,而不是只是看著他們。獨立開發者在藝術前探索機制。誰不會:任何需要生產穩定交互、像素精確UI行為或鐵證可重複性的人。

為什麼這很重要:大多數工具幫助你在選擇方向後進行打磨。Genie 3更早地推動。它使”這個想法甚至有趣嗎?“時刻變得更便宜。這聽起來不戲劇化,但它改變了週二下午試圖嘗試什麼。