Nano Banana Pro API на WaveSpeed: Как вызвать + Заметки о ценах

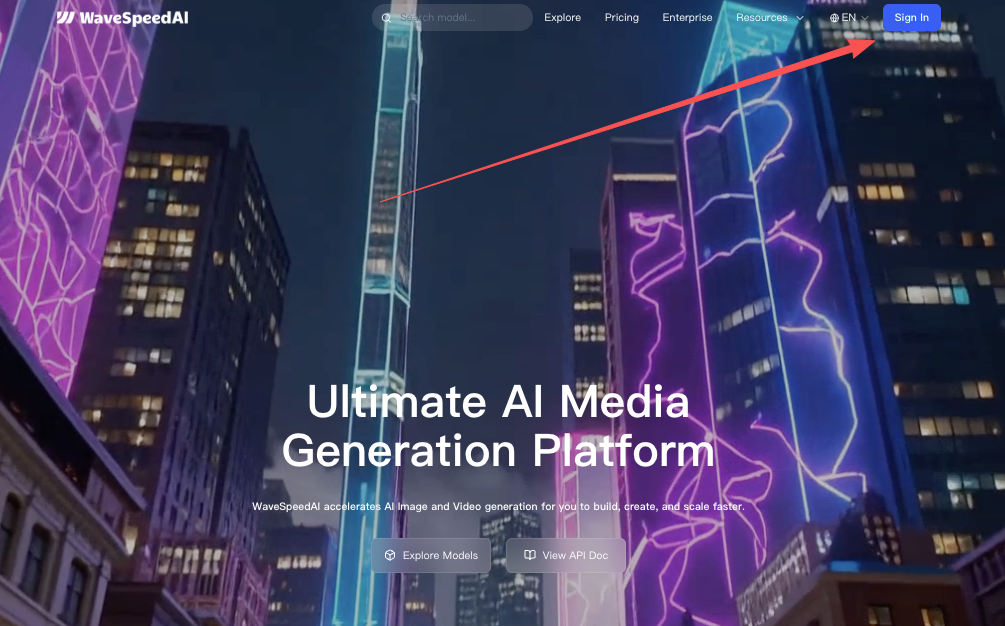

Когда-нибудь вы смотрели на документацию Nano Banana Pro API на WaveSpeed и думали “Что мне теперь делать?” Вы не одни. Я Дора, я лично тестировала десятки API, и у меня было немало опыта с недокументированными эндпоинтами и неожиданными счетами за использование. В этом руководстве я пошагово расскажу вам, как правильно вызывать Nano Banana Pro API и избежать ошибок в расчетах, которые могут подорвать бюджет вашего проекта.

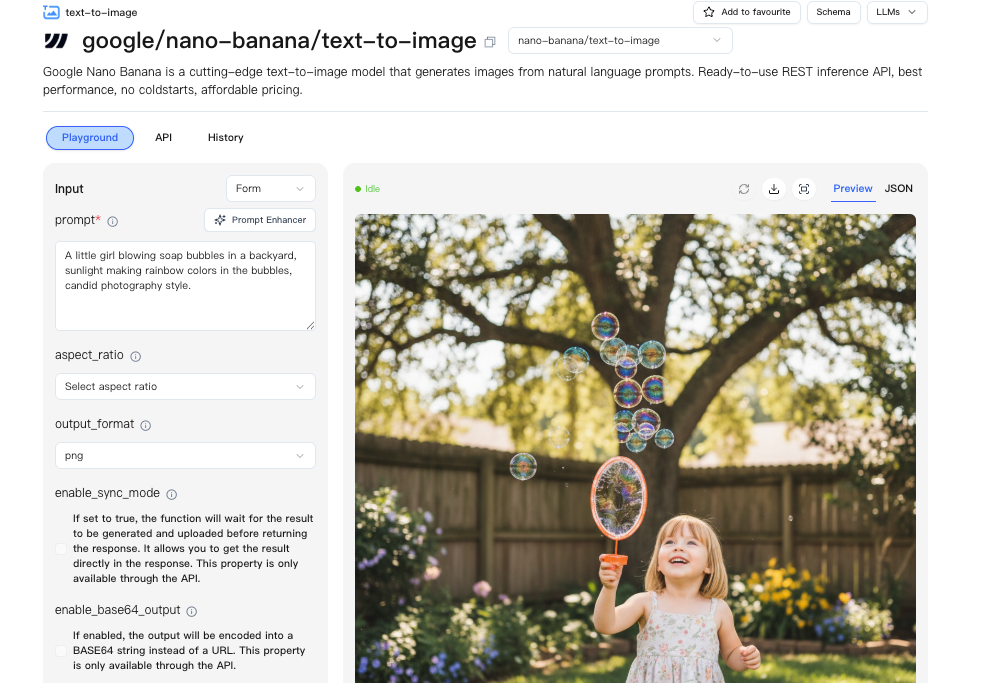

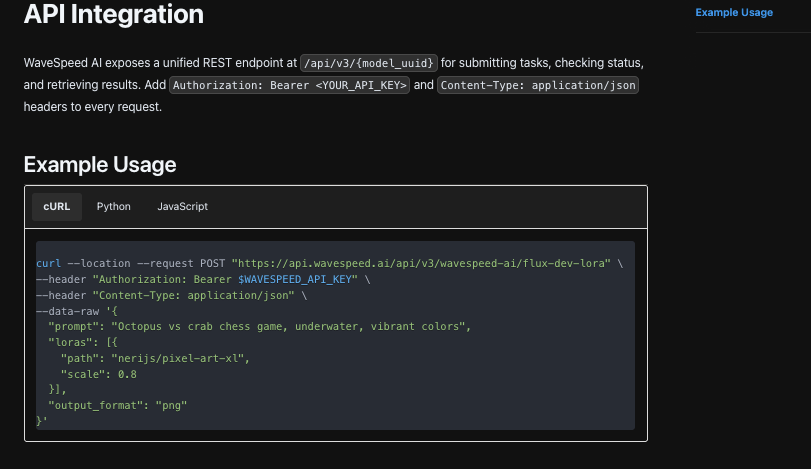

Эндпоинт / процесс

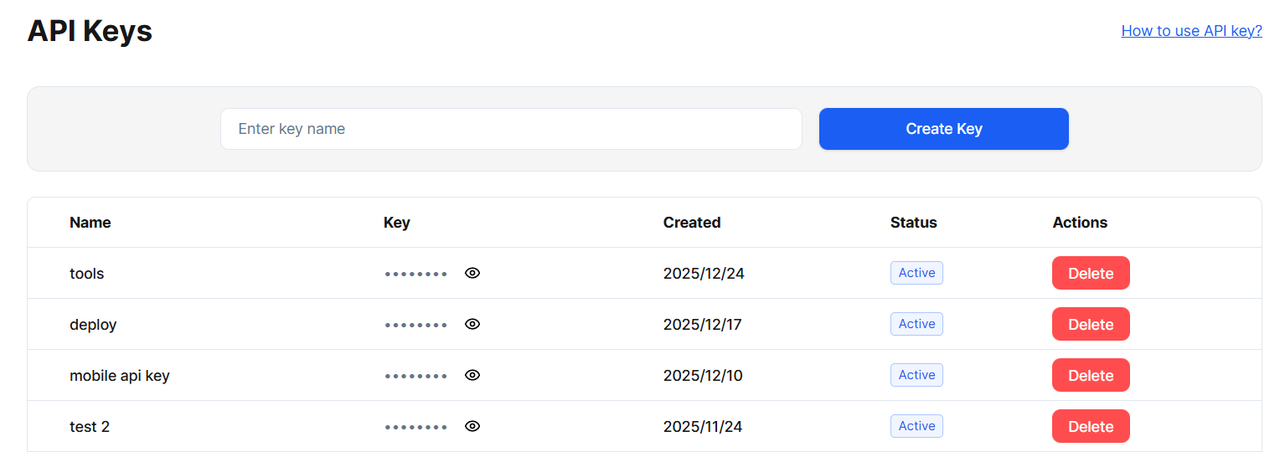

Я не переделал весь свой стек. Я обернул Nano Banana Pro небольшим сервисом-адаптером, чтобы я мог переключаться между провайдерами без глубокого рефакторинга кода. Панель управления WaveSpeed сделала это проще, чем я ожидал. Один эндпоинт, единообразная аутентификация и простой вид квоты, который не заставляет охотиться по всему интерфейсу.

Мой процесс выглядел так:

- Небольшой предварительный процессор очищал входные данные (приведение терминологии к нижнему регистру, удаление лишних пробелов, унификация временных меток).

- Я отправлял запросы на эндпоинт Nano Banana Pro со стабильной системной инструкцией и коротким набором примеров.

- Я кэшировал стабильные промпты и частые ответы. Ничего сложного, просто локальный кэш с TTL и собственный кэш WaveSpeed для идентичных запросов.

- Я хранил трассы: хеш промпта, параметры, задержка, количество токенов и коды ошибок, когда они появлялись.

Больше всего помогла предсказуемость. Эндпоинт не пытался выполнять умную маршрутизацию за меня. Если я запросил Nano Banana Pro, я его получил. Во время моих тестов средняя задержка оставалась стабильной, и дисперсия не резко увеличивалась во время рабочего времени в США, как я ожидал. Не идеально, но спокойнее, чем обычно.

Если вам важнее стабильная маршрутизация и прозрачное использование, чем погоня за самой дешевой строкой счета, попробуйте наш Wavespeed. Мы сосредоточены на предсказуемых эндпоинтах, чистой аутентификации и видимости использования, которая не требует предположений.

Если вам важнее стабильная маршрутизация и прозрачное использование, чем погоня за самой дешевой строкой счета, попробуйте наш Wavespeed. Мы сосредоточены на предсказуемых эндпоинтах, чистой аутентификации и видимости использования, которая не требует предположений.

Одно небольшое осложнение: опция потоковой передачи работала, но в моем использовании она не снижала воспринимаемую задержку достаточно, чтобы это имело значение. Для коротких текстов потоковая передача казалась лишней сложностью. Для более длинных резюме это было приятно, но не обязательно. Я выключил её везде, кроме сеансов ручного просмотра.

Ключевые параметры

Я стараюсь не крутить ручки без причины. Несколько параметров действительно имели значение здесь.

- Выбор модели: Nano Banana Pro оставалась стабильной во время моего периода тестирования (по состоянию на январь 2026 года). Никаких неожиданных замен. Эта стабильность — главная причина, по которой я продолжал.

- Температура: Для маркировки и классификации я держал её близко к нулю. Это снизило непоследовательность. Для резюмирования с небольшим синтезом 0,3–0,4 давали мне более гладкую фразировку без отклонения от указаний.

- Максимальное количество токенов: Я устанавливал жесткие лимиты для коротких задач, чтобы избежать раздутых выводов. Для длинных резюме я давал щедрые лимиты и полагался на жесткое ограничение по количеству символов в постобработке.

- Системная инструкция: Короткая, простая инструкция лучше, чем длинные блоки политики. Я использовал одно предложение для определения роли, плюс крошечный рубрикатор для “не делай выводы, показывай доказательства, когда не уверен”. Чем больше я добавлял, тем больше она колебалась.

- Top-p vs температура: Я держал top-p фиксированным на 1,0, пока регулировал температуру. Смешивание обоих делало различия сложнее отследить.

Что меня удивило, так это то, как чувствительна модель к расположению примеров. Два конкретных примера сразу после инструкции работали лучше, чем пять, разбросанные по всему тексту. Когда я переместил примеры в самый конец, качество упало на граничных случаях. API не требовал определенного формата, но последовательность окупалась: одинаковые названия полей, одинаковый порядок, одинаковая пунктуация.

Регуляторы качества

Помимо температуры и лимитов токенов, несколько шагов изменили характер выводов:

- Короткие вводные лучше, чем длинные политики. Однострочное намерение + два примера дали меньше чрезмерных объяснений, чем целая страница рекомендаций.

- Промпты на доказательства помогали. Вопрос “цитируй фразу, которая вызвала этот тег” значительно снизил воображаемые теги. Это также успокоило QA, потому что я мог быстро обнаружить галлюцинации.

- Мягкие ограничения > жесткие ограничения. Фраза “стремись к 3–5 пунктам” работала лучше, чем “ровно 4 пункта”. Модель уважала границы без нервозности.

- Детерминированное оформление: Я добавил немного структуры в конце, “Верни: метку, уверенность (0–1), доказательство (текст).” Это держало выводы аккуратными без ощущения схемы-тюрьмы.

Качество упало в двух случаях: грязные OCR входные данные и специальная лексика области. Решение было не в более умном промптировании. Это был просто крошечный шаг предварительной обработки: обрезать мусор, унифицировать дефисы и перечислить неизвестные термины в начале как “встреченные термины”. Как только я это сделал, модель перестала выдумывать странные теги. Это не сэкономило мне время в первый день, но к четвертому запуску я заметил, что не перечитываю так много. Меньше умственных усилий имеет значение.

Соображения по цене

Я не погонялся за самой дешевой строкой счета. Я хотел предсказуемых затрат на предсказуемый вывод.

Я не погонялся за самой дешевой строкой счета. Я хотел предсказуемых затрат на предсказуемый вывод.

Во время моих тестов Nano Banana Pro оказалась в среднем диапазоне по стоимости за тысячу токенов на WaveSpeed. Тихое преимущество было более последовательным использованием токенов. Потому что модель не болтала с правильной формой промпта, я видел меньше неожиданных скачков. Моя средняя длина вывода для резюме стабилизировалась, когда я добавил ограничение мягких пунктов.

Две маленькие привычки снизили затраты без ущерба качеству:

- Кэширование промпта для повторяющихся инструкций и примеров (WaveSpeed делала часть этого: мой адаптер делал остаток, так что идентичные запросы короткозамыкаются).

- Ранние выходы для случаев без операций. Если входные данные слишком короткие или очевидно неуместные, пропустите вызов и верните значение по умолчанию. Это звучит очевидно, но я имею тенденцию забывать об этом, пока не увижу счет.

Если вы имеете дело с нестабильными рабочими нагрузками, модель оплаты по мере использования имела смысл для меня. Если ваше использование стабильно и тяжело, вы можете рассмотреть зафиксированные кредиты, но только после месяца реальных цифр. Я не предварительно обязался бы на основе предположения.

Советы по пакетной обработке

Я запустил две еженедельные партии во время пробного периода. Несколько закономерностей помогли:

- Небольшой, стабильный размер пакета. Я остановился на порциях из 50 элементов. Параллелизм был скромным (10–12). Пропускная способность была хорошей, и обработка ошибок оставалась разумной.

- Бюджет повторных попыток с отступлением. Одна быстрая повторная попытка для переходных проблем, затем более длительное отступление, затем припаркуйте элемент. Никаких бесконечных циклов.

- Маркеры идемпотентности. Одинаковый ввод, одинаковый хеш, одинаковый ключ запроса. Если повторная попытка прошла, я не платил дважды и не логировал дважды.

- Предварительная валидация. Я отклонял входные данные, в которых отсутствовали обязательные поля, перед отправкой чего-либо в API. Скучно, но это сэкономило время.

Единственным трением была прозрачность ограничения скорости. Панель управления WaveSpeed четко показывала использование, но лимиты в минуту казались немного неясными во время пика. Я решил это, добавив защиту скользящего среднего в мой адаптер и воспринимая 429 как сигналы, а не как ошибки. После этого партии работали без проблем.

Обработка ошибок

Я держал обработку ошибок простой и заметной, следуя лучшим практикам обработки ошибок REST API.

- Тайм-ауты: Я установил консервативный тайм-аут клиента. Если запрос занял много времени, я отметил его для более медленной полосы повторных попыток. Длительные запросы часто завершались при повторной попытке: ключом было не забивать быструю полосу.

- 4xx vs 5xx: 4xx припарковывались для ручного просмотра, если это не был лимит скорости. 5xx получали короткий всплеск повторных попыток. Это избежало траты циклов на плохие входные данные.

- Guardrails в выводах: Я попросил модель всегда включать оценку уверенности. Когда оценка упала ниже 0,6, я отправил элемент в очередь ручного просмотра. Простая сортировка, меньше сожаления.

- Логирование: Я логировал исходный промпт и ответ только для помеченных случаев, не всё. Приватность осталась чище, и мои журналы были меньше.

Было несколько подлинных ошибок модели, уверенные, но неправильные теги на сарказм. Я не пытался выбраться из этого с помощью более умного промптирования. Я добавил проверку сарказма как отдельный легкий проход и только затем применил основной тегер. Два шага, меньше беспорядка.

Пример логики полезной нагрузки (объяснение без кода)

Вот форма того, что я отправлял, простым языком.

- Системная роль: одно предложение о работе. Например, “Вы — внимательный классификатор, который помечает маркетинговую копию небольшим набором меток и указывает на слова, которые привели к решению.”

- Контекст: крошечный глоссарий для любых странных терминов, плюс два четких примера, один чистый, один сложный.

- Инструкция: что вернуть и в каком порядке (метка, уверенность, доказательство), и ограничение тона (краткое, без колеблющегося языка).

- Ввод: исходный текст, неприкосновенный, кроме очистки пробелов.

- Лимиты: запрошенная максимальная длина для доказательства и потолок количества меток.

На стороне адаптера я создал стабильный хеш из системной роли + примеры + инструкция. Если этот хеш совпадал с предыдущим запросом с одинаковым вводом, я проверил кэш. Если нет, я вызвал эндпоинт Nano Banana Pro WaveSpeed с температурой и лимитами токенов, установленными для рабочей нагрузки. Я разобрал вывод по ключам, а не по позиции, поэтому небольшие изменения в фразировке ничего не сломали.

Если ответ не содержал какой-либо требуемый ключ, я не просил модель исправить себя на месте. Я повторно выдал промпт с коротким напоминанием: “Верни только три ключа.” Максимум одна повторная попытка. После этого это перешло в очередь просмотра. Это помешало системе зациклиться в бессмыслицу.

Если ответ не содержал какой-либо требуемый ключ, я не просил модель исправить себя на месте. Я повторно выдал промпт с коротким напоминанием: “Верни только три ключа.” Максимум одна повторная попытка. После этого это перешло в очередь просмотра. Это помешало системе зациклиться в бессмыслицу.