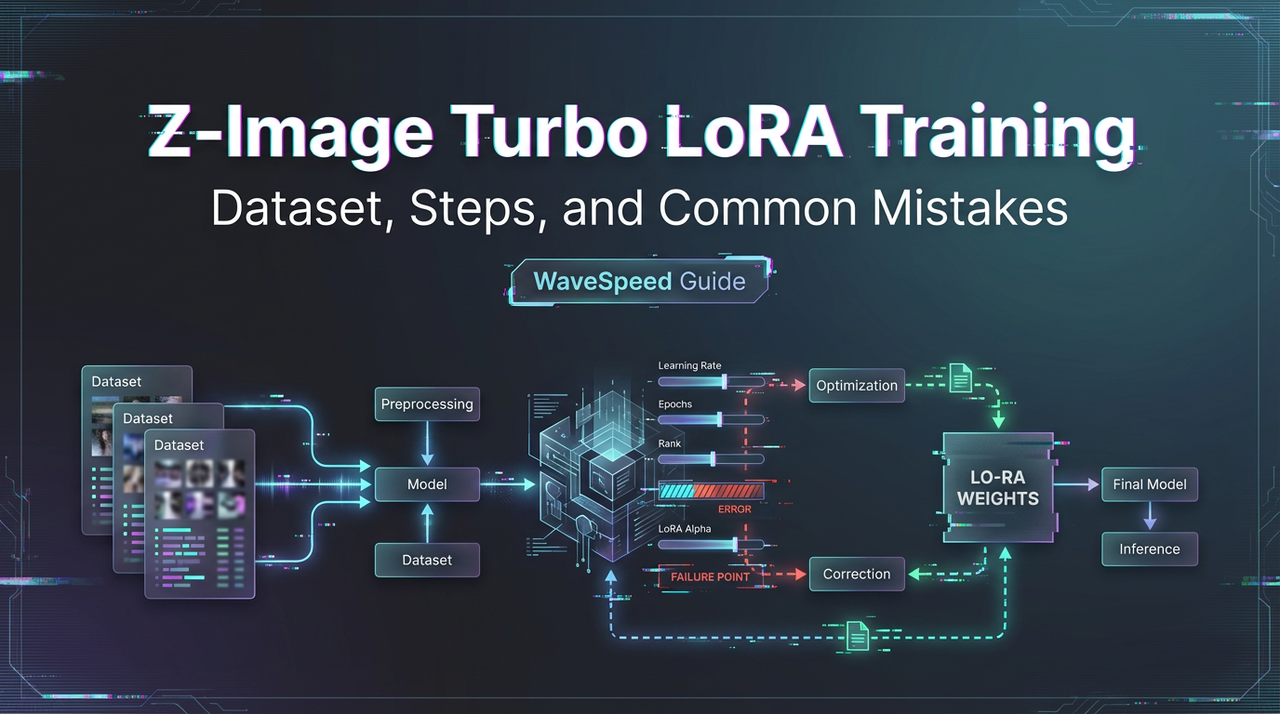

Treinar um LoRA Z-Image Turbo na WaveSpeed: Conjunto de Dados, Etapas e Erros Comuns

Opa, colega. Sou a Dora.

Na semana passada, queria um estilo pequeno e consistente para um conjunto de imagens de cabeçalho. Stock parecia errado, e ajustar prompts manualmente continuava variando. Então tentei algo que estava evitando: um rápido LoRA no Z-Image Turbo dentro do WaveSpeed. Esperava configurações complicadas e muita tentativa e erro. O que consegui foi mais simples do que imaginava, não sem esforço, apenas organizado.

Aqui está como treinei um Z-Image Turbo LoRA no WaveSpeed durante duas noites de janeiro de 2026, o que funcionou, o que não funcionou, e as configurações que vou reutilizar. Não é um guia para extrair cada último por cento. É uma base sólida que manteve minha cabeça clara e os resultados previsíveis.

Aqui está como treinei um Z-Image Turbo LoRA no WaveSpeed durante duas noites de janeiro de 2026, o que funcionou, o que não funcionou, e as configurações que vou reutilizar. Não é um guia para extrair cada último por cento. É uma base sólida que manteve minha cabeça clara e os resultados previsíveis.

Regras do dataset

O que coletei

Mantive pequeno: 45 imagens para um estilo visual definido (tons suavizados, linhas limpas, textura suave de papel). Tive bons resultados entre 30–120 imagens. Menos de 20 tende a sobreajustar: acima de 150 você está treinando mais um fine-tune do que um LoRA, e a vantagem de velocidade do Z-Image Turbo começa a se aplanar.

Diversidade vence quantidade

Dividi o conjunto:

- 70% imagens de “estilo principal” (o estilo que quero ensinar),

- 30% variedade de contexto (objetos/fundos diferentes para que o LoRA não vincule o estilo a uma cena).

Ângulos, iluminação e proporções variavam. Evitei quase-duplicatas (não três fotos do mesmo objeto com uma mudança de 5°).

Tamanho e formato

- Resolução: 768px no lado mais curto. Modelos Turbo lidam com 1024, mas 768 manteve o treinamento mais leve e reduziu artefatos nos meus testes.

- Formato: PNG ou JPEG de alta qualidade. Removi metadados. Perfis incorporados grandes às vezes confundiam a cor ligeiramente.

- Corte: Cortei para manter o assunto dominante, mas nem sempre centralizado. Simetria torna os modelos complacentes.

Dicas de legenda

Tentei duas passagens: auto-tagging primeiro, depois edições leves. Legendas automáticas me levaram 70% do caminho. Os últimos 30% importavam.

Mantenha legendas curtas e consistentes

- 1–2 frases ou uma lista de tags compacta.

- Mencione o token de estilo (mais sobre tokens abaixo) mais uma palavra de classe.

- Não descreva tudo. Nomeie apenas o que é estável e importante.

Exemplo que usei:

- “soka-style, minimalist illustration of a ceramic mug on a desk, soft paper texture, muted palette.”

- “soka-style, simple plant in a clay pot, side light, clean negative space.”

Palavras de classe ajudam

Se você está ensinando um estilo, use palavras de classe (illustration, photo, portrait, product shot). Se está ensinando um objeto/personagem, use o que é (mug, backpack, planner). Isso ajuda o LoRA a generalizar. Sem palavras de classe, meus primeiros testes fizeram o LoRA agarrar-se aos layouts.

Não sobreajuste com adjetivos

Removi adjetivos repetidos após a segunda passagem. Se toda legenda diz “warm, cozy, soft,” o modelo se prende àquela vibe mesmo quando você não quer. Mantive um adjetivo para tom.

Sinais negativos

Adicionei uma negação leve em algumas legendas onde realmente importava: “no harsh shadows.” Não em toda parte, apenas onde o contraste estava errado na imagem bruta. Muitos negativos a tornaram teimosa durante inferência.

Pequena nota: Tentei legendas vazias em cinco imagens como teste. Os resultados ficaram um pouco mais barulhentos. Não terrível, mas eu não pularia legendas se consistência importa.

Linha de base dos parâmetros de treinamento

Estas são as configurações que me deram resultados constantes no WaveSpeed com Z-Image Turbo. Executei três treinamentos curtos (cerca de 18–22 minutos cada na GPU padrão do meu workspace). Seus tempos podem diferir.

Configurações principais que reutilizei

- Base: Z-Image Turbo (mais recente em janeiro de 2026)

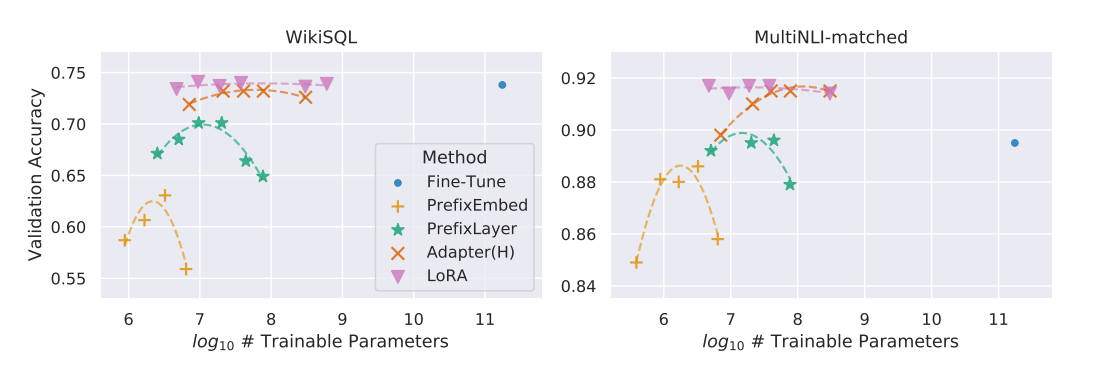

- LoRA rank (dim): 16 para estilo sutil: 32 quando o estilo precisa de mais força. Assentei em 16.

- Alpha: combine rank (16) ou metade (8). Eu combinei.

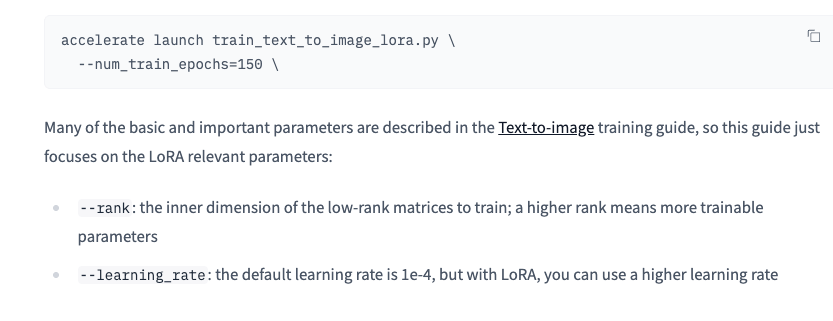

- Taxa de aprendizado: 1e-4 para começar. 2e-4 se o estilo não funcionar. 1e-3 ficou demais rápido nos meus testes. A documentação de treinamento LoRA do Hugging Face recomenda começar com 1e-4 para a maioria dos modelos stable diffusion.

- Tamanho do lote: 2–4. Usei 4 para manter as etapas razoáveis.

- Épocas/passos: Almeje 1–2 passagens completas pelos dados. Para 45 imagens × 10 repetições ÷ lote 4 ≈ 112 passos por época. Treinei 2 épocas (≈224 passos). Mais de 3 épocas começou a memorizar fundos.

- Agendador: Cosine ou constante com aquecimento. Usei cosine com aquecimento de 5%.

- Precisão: bfloat16 quando disponível. Estava bem aqui.

Imagens de regularização

Com LoRAs de estilo, nem sempre adiciono regularização. Para objetos ou personagens, adiciono 50–100 imagens de classe (simples “mug,” “portrait”) para manter anatomia e formas honestas. No Turbo, isso notavelmente reduziu folhas estranhas parecidas com mãos em fotos de plantas.

Checkpoints e salvamento

Habilitei salvamento a cada 50–80 passos. Deixou-me voltar ao ponto mais doce, que para meu conjunto era em torno do passo 180. Passos posteriores pareciam mais limpos, mas menos flexíveis em prompts.

Se você quer uma verificação rápida: faça uma execução de 60–90 passos primeiro. Não será perfeita, mas dirá se seu dataset está ensinando a lição certa.

Palavras de acionamento

Usei um token único para ancorar o estilo: “soka-style”. Você poderia usar algo como “kavli-ark” ou “mivva”. Curto, inventado e improvável de colidir com palavras reais.

Como escrevi legendas

- Comece legendas com o token uma vez: “soka-style, minimalist illustration …”

- Adicione uma palavra de classe: illustration, photo, render, o que corresponder.

- Mantenha consistência em todo o dataset.

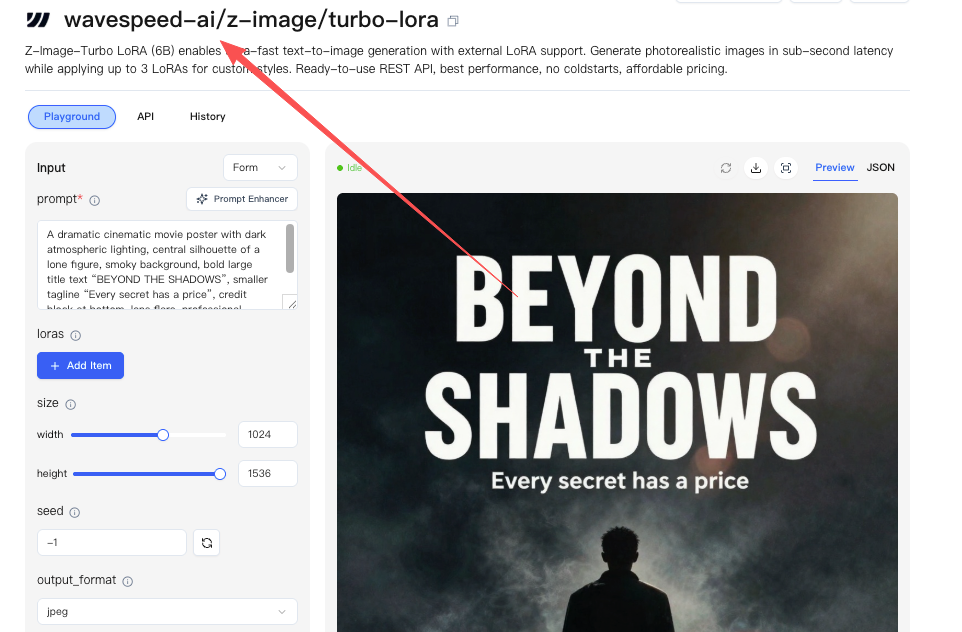

Como fiz prompts

- Positivo: “a product photo of a ceramic mug on a wooden desk, soka-style, soft paper texture, muted colors”

- Negativo: “harsh shadows, heavy grain, text watermark, chromatic aberration”

Quando evitar palavras de acionamento

Se você está treinando um objeto muito específico (uma garrafa de marca, um mascote), use um token + palavra de classe (“mivva-bottle”) em legendas, mas não é necessário forçar o token em cada prompt de inferência. Nos meus testes, Turbo respeitou a distribuição de treinamento: às vezes a palavra de classe sozinha era suficiente. O token ajudou quando a cena ficou complexa.

Uma oddidade: empilhar dois tokens de estilo confundiu o modelo (“soka-style, nova-style”). Consegui uma mistura turva. Um token por vez foi mais limpo.

Imagens de validação

A validação me salvou de perseguir fantasmas.

Seeds fixos e uma pequena grade

Defini três prompts que me importam e os mantive fixos entre execuções:

- “a ceramic mug on a desk, soka-style, soft paper texture, muted colors”

- “a leafy plant by a window, soka-style, side light, clean background”

- “a planner and pen, soka-style, top-down, gentle shadows”

- Seed: fixo (usei 12345). Uma seed por prompt.

- Passos: 20–28 para Turbo. Além de 30 começou a afinar demais.

- CFG: 3.5–6. Gostei de 4.5 para equilíbrio.

- Sampler: DPM++ 2M Karras ou uma variante Euler decente. Ambos se comportaram.

- Tamanho: 768×768 para paridade com corte de treinamento.

Também renderizei o mesmo conjunto uma vez sem o token para ver se o estilo era muito dominante. Na minha segunda execução, canecas ainda pareciam “papery” sem o token, uma dica de que eu tinha empurrado o estilo demais. Diminuindo o peso de LoRA para 0.6 corrigiu.

Se puder, mantenha um painel de validação leve aberto durante o treinamento. Observar os mesmos três prompts atualizarem é mais calmo do que examinar amostras aleatórias.

Correções

Aqui está o que deu errado e o que corrigiu.

Sobreajuste de fundos

- Sintoma: textura de papel idêntica aparece em cenas não relacionadas.

- Correção: reduza repetições por imagem (de 10 para 6), adicione 6–10 fundos neutros, abaixe o peso de LoRA em inferência (0.6–0.75).

Desvio de cor para bege

- Sintoma: tudo aquece como um filtro do final da tarde.

- Correção: remova adjetivos repetitivos “warm/soft/cozy” em legendas: adicione 6 imagens com tons mais frios: defina variedade de equilíbrio de branco no dataset: adicione “overly warm tones” ao negativo.

Prompts frágeis

- Sintoma: pequenas mudanças de prompt desabam a composição.

- Correção: aumente a variedade de dataset em tipos de objetos e layouts: treine com LR ligeiramente menor (1e-4 em vez de 2e-4): tente rank 32 se o estilo é complexo.

Publicar e reutilizar

Treinar este LoRA foi gerenciável em grande parte porque construímos WaveSpeed para remover as partes chatas do processo. Em vez de conectar scripts ou babysittar GPUs, pude fazer upload de um pequeno dataset, executar treinamentos curtos de Turbo LoRA, comparar checkpoints, e reutilizar o modelo em projetos sem quebrar meu fluxo.

Se está cansado de desvio de estilo, sobreajuste, ou perder o “bom teste”.

→ Treine um Z-Image Turbo LoRA no WaveSpeed

Quando a terceira execução pareceu constante, publiquei o LoRA dentro do WaveSpeed com um cartão de modelo simples:

Quando a terceira execução pareceu constante, publiquei o LoRA dentro do WaveSpeed com um cartão de modelo simples:

- Para que serve: estilo sutil de textura de papel, paleta suavizada, formas limpas.

- Para o que não serve: retratos fotorrealistas, produtos de alto brilho, sobreposições de texto pesado.

- Configurações que funcionaram: peso 0.6–0.85, CFG ~4.5, 20–26 passos, saída 768.

- Dois bons prompts e uma ressalva.

- Notas de versão: treinado em janeiro de 2026, rank 16, LR 1e-4, ~224 passos.

Mantive a licença simples e adicionei três imagens de validação. O eu futuro agradecerá ao eu passado pelos detalhes.

Reutilização

- Empilhamento: Pude empilhar este LoRA de estilo com um LoRA de objeto separado, mas mantive apenas um estilo por vez. Se deve empilhar, mantenha peso combinado abaixo de 1.0.

- Mesclagem: Não o assei em um checkpoint. O ponto todo era flexibilidade.

- Equipes: Compartilhei o link LoRA e os três prompts de validação fixos. Reduziu ida e volta de review. As pessoas olharam para a mesma referência.

Se é novo no WaveSpeed ou Z-Image Turbo, a documentação oficial vale a pena uma lida antes da sua primeira execução, especialmente suas notas sobre taxa de aprendizado e rank. Dei uma olhada depois da minha primeira passagem e desejei ter feito mais cedo.

Você também jurou que “apenas treinaria um pequeno LoRA,” apenas para descobrir cada imagem dois dias depois esportando um “filtro bege eterno” ou “fundo de textura de papel forçado”?

Rápido, jogue seus 45 imagens no WaveSpeed e tente Z-Image Turbo LoRA. Depois volte e me diga: salvou sua consistência de cabeçalho, ou fez todos seus objetos brotarem “tentáculos texturizados misteriosos”?