WAN 2.7 명령어 기반 동영상 편집 가이드

WAN 2.7은 명령어 기반 동영상 편집 기능을 추가했습니다. 이 기능이 무엇인지, 무엇을 편집할 수 있는지, 프로덕션 파이프라인에 어떻게 통합되는지, 그리고 개발자가 알아야 할 사항을 안내합니다.

안녕하세요, 여러분. 저는 Dora입니다. 저는 한동안 AI 비디오 도구를 다뤄왔는데, 처음 WAN 2.7의 명령어 기반 편집 기능에 대해 들었을 때, 이게 많은 것을 바꿔놓을 거라고는 바로 확신하지 못했습니다. 텍스트 명령으로 동영상을 편집한다는 게 데모에서는 그럴싸해 보이지만 실제로 사용할 때는 무너지는 기능처럼 들렸거든요.

부분적으로는 제가 틀렸다는 걸 인정합니다.

WAN 2.7의 명령어 기반 비디오 편집이란

기존 동영상 클립을 가져와서 변경하고 싶은 내용을 글로 쓰면, 모델이 다른 모든 요소는 그대로 유지하면서 해당 특정 요소만 조정합니다. 재생성이 아닙니다. 편집입니다.

표준 텍스트-투-비디오 생성과의 차이점

텍스트-투-비디오는 아무것도 없는 상태에서 시작합니다. 프롬프트를 작성하면 그 결과물이 나옵니다.

명령어 편집은 이미 존재하는 것에서 시작합니다. 클립이 있습니다. 타이밍이 설정되어 있습니다. 나머지는 건드리지 않으면서 특정 한 부분만—배경 교체, 조명 변경, 의상 색상 변경—바꿔달라고 모델에 요청하는 것입니다.

WaveSpeedAI의 분석에 따르면 이것이 운영 측면에서 중요한 이유는 이렇습니다. 이전에는 클립을 처음부터 재생성해야 했던 반복 작업이 이제는 가벼운 편집으로 처리될 수 있습니다. 재킷 색깔이 잘못됐다는 이유로 재생성하는 건 낭비처럼 느껴졌습니다. 재킷만 편집하는 건 딱 맞는 방법처럼 느껴졌습니다.

비디오 재창조와의 차이점

재창조는 참조 동영상의 모션 구조를 가져와서 새로운 피사체나 스타일에 적용합니다. 모션 전이입니다.

명령어 편집은 수정합니다. 원본 클립은 그대로 유지되고, 지정한 요소만 변경됩니다.

모델이 입력으로 받는 것

두 가지입니다. 소스 동영상(최대 1080P에서 15초)과 자연어 명령어입니다.

놀라웠던 점은 마스킹도, 레이어 분리도 없다는 것입니다. 클립과 문장만 있으면 됩니다.

명령어로 편집할 수 있는 것과 없는 것

지원되는 편집 카테고리

테스트와 Dzine 플랫폼 문서를 기반으로, 명령어 편집이 처리하는 항목은 다음과 같습니다.

- 배경 교체 (실내에서 실외, 맑음에서 비 오는 날)

- 조명 변경 (골든아워에서 블루아워)

- 객체 수준 조정 (셔츠 색상 변경, 소품 추가)

- 스타일 수정 (실사에서 일러스트)

이런 작업이 가능한 이유는 변화의 범위가 한정되어 있기 때문입니다. 모델은 배경이 무엇인지, 조명이 무엇을 하는지 알고 있습니다.

명령어 기반 편집에 저항하는 것

복잡한 공간 재배치는 잘 작동하지 않습니다. “캐릭터를 왼쪽으로 이동”은 깔끔한 결과를 내지 못했습니다. 캐릭터가 그 자리에 머물거나 구도가 어색하게 바뀌었습니다.

정체성이 강한 장면—특정 표정, 세밀한 로고 디테일—은 편집에 저항합니다. 모델은 조명을 바꿀 수 있지만 표정이나 나이를 변경할 때 정확한 특징을 유지하는 데 어려움을 겪습니다.

물리적 변화는 결과가 들쑥날쑥합니다. “물이 더 빠르게 흐르게 해줘”는 때로는 잘 작동하고, 때로는 결함이 생겼습니다.

편집 세분성

모든 편집은 프롬프트 수준입니다. 변경 내용을 설명하면 모델이 어느 부분에 적용할지 추론합니다. 아직 객체 수준의 타겟팅은 없습니다.

저는 매우 구체적인 명령어를 쓰는 법을 배웠습니다. “재킷을 빨간색으로 바꿔줘”는 “의상을 더 따뜻한 톤으로 만들어줘”보다 훨씬 잘 작동했습니다.

효과적인 편집 명령어 설계하기

좋은 편집 명령어의 조건

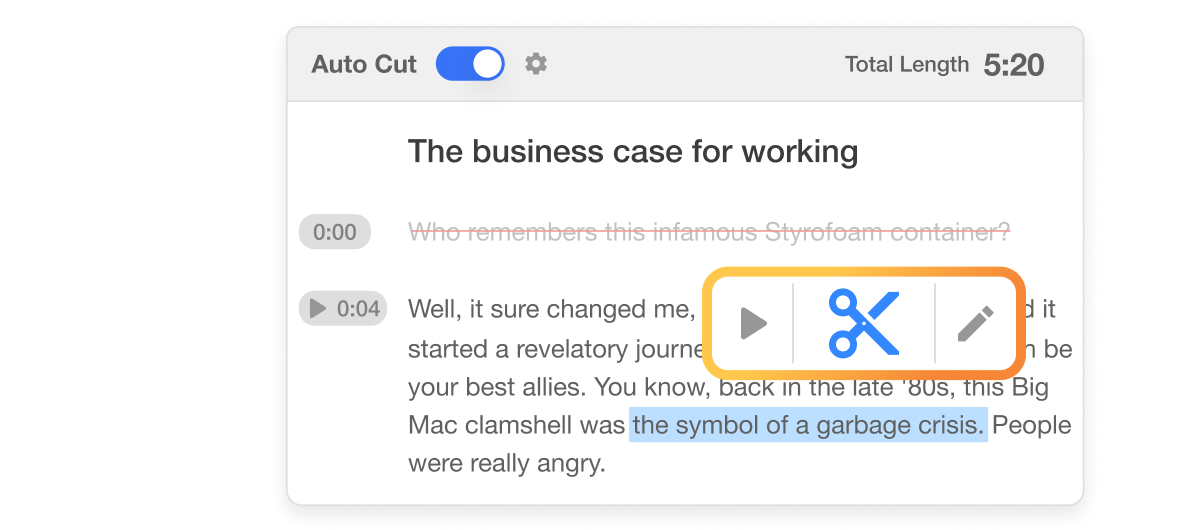

좋은 명령어는 구체적이고, 방향성이 있으며, 범위가 한정되어 있습니다. 이 접근 방식은 마스킹이나 레이어 분리 없이 텍스트를 편집하는 것만으로 동영상을 편집할 수 있는 Descript 같은 도구의 철학과 일맥상통합니다.

“하늘을 짙은 구름이 있는 흐린 날로 바꿔줘”는 일관되게 잘 작동했습니다. 무엇이 바뀌는지, 무엇이 되는지를 명시하고 세부 사항을 추가했기 때문입니다.

“더 드라마틱하게 보이게 해줘”는 작동하지 않았습니다. 너무 모호했습니다. 모델이 매번 다르게 해석했습니다.

나쁜 명령어의 조건

소스 클립과 모순되는 명령어는 조용히 실패합니다. 인물 중심 장면에서 “장면에서 사람을 제거해줘”는 무시되거나 깨진 프레임을 만들어냈습니다.

서로 충돌하는 여러 요소가 담긴 명령어는 어려움을 겪습니다. “재킷을 파란색으로 바꾸고 배경을 숲으로 바꾸고 비를 추가해줘”는 한 번에 세 가지 편집을 시도했습니다. 명령어 하나당 편집 하나가 훨씬 잘 작동했습니다. 이렇게 변경 사항을 명시하고 목표 상태를 설명하는 명확한 프롬프팅 패턴은, 기록 내용을 직접 편집하여 영상을 다듬는 Visla의 텍스트 기반 비디오 편집에서 볼 수 있는 모범 사례와 일치합니다.

프롬프팅 패턴

잘 작동한 패턴은 다음과 같습니다.

- 무엇이 바뀌는지 명시

- 목표 상태 설명

- 15단어 이내로 유지

“도시 배경을 산 풍경으로 교체해줘” — 명확한 주체, 명확한 목표, 깔끔한 결과.

입력 요구사항

소스 동영상 사양

소스 동영상: 2초에서 15초, 최대 1080P. 저는 1080P에서 5초 클립과 720P에서 10초 클립을 테스트했습니다. 둘 다 작동했습니다.

참조 정렬

소스에 심한 모션 블러, 급격한 컷, 또는 극단적인 노출이 있으면 편집 결과가 저하됩니다. 모델은 선명한 프레임이 필요합니다.

빠르게 패닝하는 장면은 번진 배경 교체를 만들어냈습니다. 정적이거나 느리게 움직이는 장면은 깔끔한 편집을 만들어냈습니다.

프로덕션 파이프라인에서 명령어 편집의 위치

저는 이것을 주요 도구로 사용하게 될 거라고 예상하지 않았습니다. 신기한 기능 정도로 생각했습니다. 하지만 그렇지 않았습니다.

생성 후 다듬기 루프

표준 텍스트-투-비디오로 클립을 생성한 후, 저는 종종 원하는 것의 80%를 얻었습니다. 모션은 맞고, 프레이밍도 맞았지만, 색상 그레이딩이 이상하거나 배경이 브리프와 맞지 않았습니다.

명령어 편집 이전에는 프롬프트를 조정해서 재생성하고 결과를 기대하는 수밖에 없었습니다. 성공률: 약 40%. 각 재생성은 60-90초가 걸렸고, 사용 가능한 결과물을 얻기 전에 세 번이나 네 번의 시도를 소모하는 경우가 많았습니다.

이제는 한 번 생성하고, 잘못된 특정 요소만 편집합니다. 성공률은 70%에 가깝고, 반복 작업도 더 빠릅니다. 각각 90초가 걸리는 세 번의 완전한 재생성(총 4.5분) 대신, 한 번 생성하고 한 번 편집(약 2.5분)합니다. 시간 절약은 여러 프로젝트에 걸쳐 누적됩니다.

완전한 재생성 없는 스타일 반복

저는 도시 거리를 걷는 캐릭터의 기본 클립 하나를 생성한 다음, 명령어 편집으로 세 가지 스타일 변형을 만들어서 이것을 테스트했습니다.

- “사이버펑크 네온 미학으로 전환”

- “수채화 그림 스타일로 변경”

- “흑백 필름 누아르로 만들기”

세 가지 편집 모두 원본 모션과 구도를 유지했습니다. 시각적 스타일만 변경되었습니다. 캐릭터의 걷는 사이클은 동일하게 유지되었습니다. 카메라 움직임도 바뀌지 않았습니다.

이것은 전체 장면을 세 번 재생성하지 않고도 컨셉 옵션을 보여주고 싶은 클라이언트 프레젠테이션에 유용합니다. 또한 생성 크레딧을 소모하지 않고 광고 크리에이티브를 A/B 테스트하는 데도 유용합니다.

같은 워크플로를 편집 대신 재생성으로 시도해봤습니다—스타일 키워드를 포함한 세 가지 다른 프롬프트를 작성했습니다. 세 개 중 두 개가 약간 다른 모션 타이밍으로 돌아와서 비교를 방해했습니다. 편집은 테스트하는 스타일 변수를 제외한 모든 것을 비교 가능하게 유지했습니다.

비용 비교: 편집 대 재생성

WaveSpeedAI의 비용 분석에 따르면, 명령어 기반 편집은 표준 생성과 다른 비용 구조를 가질 가능성이 높지만, 정확한 가격은 아직 공개되지 않았습니다.

워크플로 관점에서, 편집이 생성과 초당 동일한 비용이 든다 하더라도, 실패한 시도를 버리지 않기 때문에 실제로는 더 저렴합니다. 한 번 생성하고 한 번 타겟 편집하는 것이 세 번 완전히 재생성하는 것보다 낫습니다.

계산: 1080P에서 생성 비용이 초당 $0.12(PiAPI의 WAN 2.6 가격)라면, 5초 클립은 $0.60입니다. 세 번 재생성하면 $1.80입니다. 한 번 생성하고 한 번 편집하면—편집이 같은 $0.60이 든다 해도—총 $1.20입니다. 낭비를 줄이는 것만으로 33% 절약됩니다.

편집이 생성보다 저렴한 것으로 밝혀진다면(처음부터 새 프레임을 만드는 것이 아니라 기존 프레임을 수정하는 것이므로 가능성이 높아 보입니다), 절약은 더 커집니다.

API 액세스 시사점

별도 엔드포인트 또는 파라미터 플래그?

WaveSpeedAI의 분석에 따르면, 명령어 편집에는 새로운 페이로드 필드—아마도 edit_instruction 파라미터와 별도의 엔드포인트—가 필요할 것입니다.

프로덕션 통합 전에 공식 API 문서를 기다리고 있습니다.

토큰 및 컴퓨팅 비용

다중 입력 추론은 단일 입력 생성보다 무겁습니다. 명령어 편집은 소스 동영상과 편집 명령어를 모두 처리하므로 더 높은 컴퓨팅 비용이 발생합니다.

그에 맞게 예산을 계획하되, 가격이 공개될 때까지 예상치를 확정하지 마세요.

비동기 작업 고려사항

모든 WAN 작업은 비동기적으로 실행됩니다. 요청을 제출하고, 작업 ID를 받고, 완료될 때까지 폴링합니다.

테스트에서 예상 대기 시간: 5초 1080P 편집에 30초에서 2분.

FAQ

명령어 기반 편집이 출시 시 WaveSpeed API를 통해 사용 가능한가요?

WAN 2.7은 2026년 3월 내에 출시됩니다. 명령어 편집의 API 가용성은 아직 확인되지 않았습니다. WaveSpeedAI는 일반적으로 공식 출시 후 며칠 내에 새 엔드포인트를 추가합니다.

편집을 위한 소스 동영상은 얼마나 길 수 있나요?

1080P에서 최대 15초입니다. 짧은 클립(2-5초)은 더 빠르게 처리되고 더 깔끔한 편집을 만들어냅니다.

편집이 원본 오디오를 보존하나요? 편집에 따라 다릅니다. 배경 변경은 오디오를 보존합니다. 시각적 미학을 변경하는 스타일 변화는 때로는 싱크에 영향을 미칩니다. 케이스별로 테스트해볼 가치가 있습니다.

이전 게시물: