OmniHuman-1.5:Toward Virtual Humans with “Soul”

Have you ever watched videos featuring smoothly animated digital humans, but felt they lacked genuine emotion? To overcome this limitation, we introduce OmniHuman-1.5, developed by ByteDance—a groundbreaking framework designed to generate character animations that transcend superficial mimicry. It not only brings virtual avatars to life but also endows them with the ability to express emotions.

디지털 인간이 부드럽게 애니메이션되는 영상을 본 적 있지만, 진정한 감정이 부족하다고 느낀 적이 있나요? 이 한계를 극복하기 위해 ByteDance가 개발한 OmniHuman-1.5 를 소개합니다. 이는 표면적인 모방을 뛰어넘는 캐릭터 애니메이션을 생성하도록 설계된 획기적인 프레임워크입니다. 가상 아바타에 생명을 불어넣을 뿐만 아니라 감정을 표현할 수 있는 능력을 부여합니다.

모방에서 표현으로: 기술적 혁신

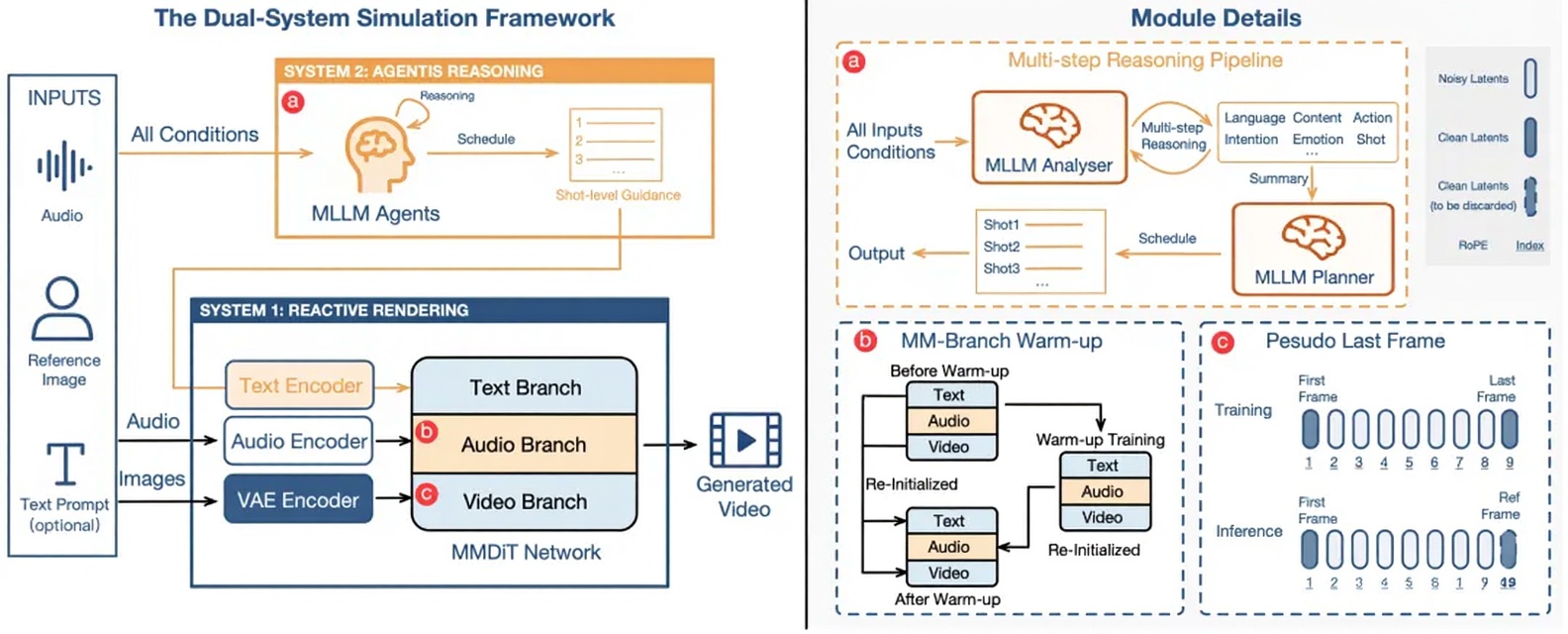

OmniHuman-1.5는 이중 시스템 시뮬레이션 프레임워크를 사용합니다.

첫째, 이 방법은 다중모달 대형 모델을 활용하여 구조화된 의미 표현을 생성하고, 고급 의미 가이드를 제공하여 동작 생성이 단순한 리듬 동기화를 넘어 맥락과 감정에 더 잘 정렬되도록 합니다.

둘째, 특별히 설계된 다중모달 DiT 아키텍처와 의사-최종 프레임 메커니즘을 통해 다중모달 정보를 효율적으로 융합하면서 충돌을 완화하여, 캐릭터, 장면 및 언어와 깊이 있게 일치하는 동작을 생성합니다.

OmniHuman-1.5가 할 수 있는 것은?

🎶음악 공연

사진 하나와 노래만으로 OmniHuman-1.5는 아티스트의 정확한 멈춤, 숨소리, 리듬을 모방하는 “디지털 싱어”를 만들 수 있습니다.

🎭감정 연기

OmniHuman-1.5는 디지털 싱어뿐만 아니라 감정 있는 디지털 배우도 제작할 수 있습니다.

🗣️맥락 인식 제스처

반복적인 제스처 대신 애니메이션이 의미와 정렬됩니다. 예를 들어, 오디오에서 “심장”을 언급할 때 캐릭터가 자연스럽게 손을 가슴에 올립니다.

✍️텍스트 기반 애니메이션

OmniHuman-1.5는 프롬프트 제어 를 지원합니다. 예시는 다음과 같습니다:

- 카메라 움직임: “카메라가 천천히 캐릭터를 원형으로 회전하며 예술 영화 같은 분위기를 연출합니다.”

- 객체 생성: “아바타가 렌즈를 향해 손을 뻗은 후 말하기 시작합니다.”

- 특정 동작: “펭귄이 춤을 추고, 선글라스를 쓰고, 무대에서 공연합니다.”

👥다중 캐릭터 및 스타일화된 시나리오

이전의 디지털 인간과 달리 OmniHuman-1.5는 집단 대화에 참여하고 앙상블 공연을 수행할 수 있습니다.

또한 인간, 동물, 의인화된 캐릭터, 스타일화된 만화 등 다양한 형태에서 작동하며 뛰어난 다재다능함을 보여줍니다.

결론: “영혼”을 가진 가상 인간으로

가상 인간 기술이 새로운 혁신을 이루었습니다. OmniHuman-1.5의 등장은 가상 인간이 표면적인 모방에서 깊이 있는 표현으로 진화한 새로운 시대를 의미합니다. 당신이 말한 것을 이해하고 진정하고 진심 어린 소통으로 당신과 소통할 수 있습니다. OmniHuman-1.5 모델의 출시를 기대해봅시다!

지금 바로 WaveSpeedAI에 가입하세요. 또한 아래 소셜 미디어를 통해 우리와 연결할 수 있습니다.

Discord: Discord