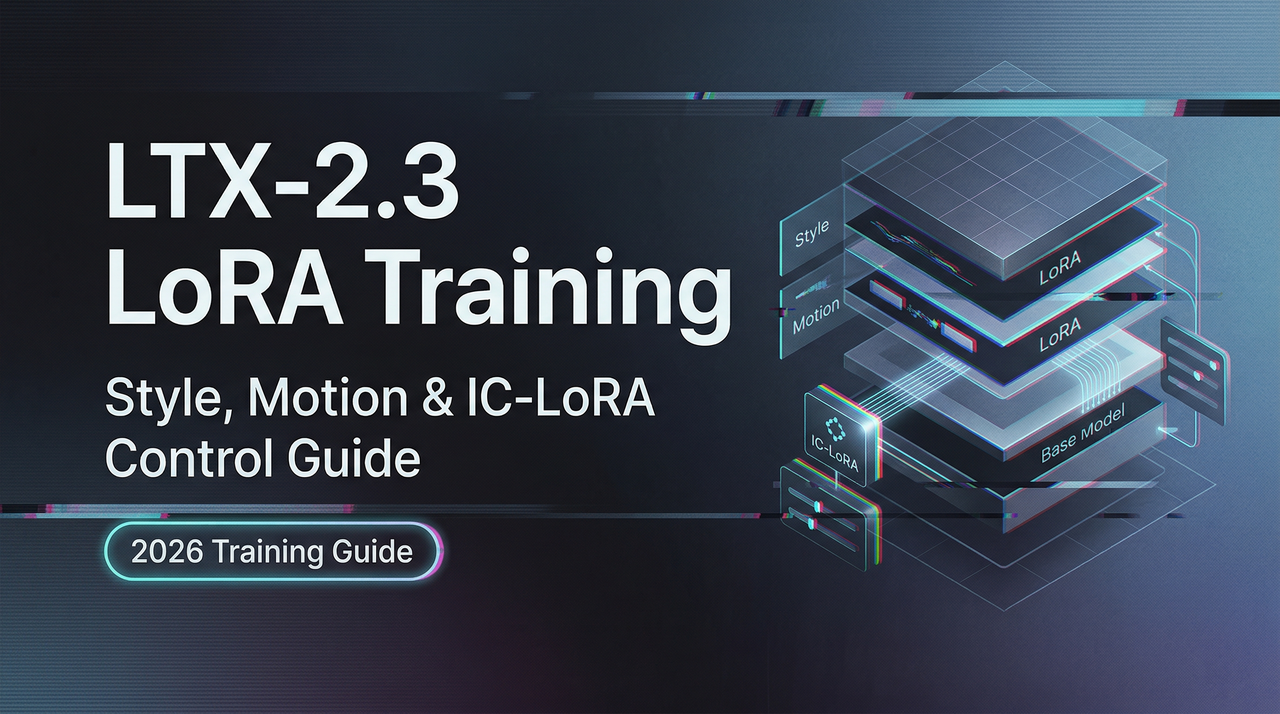

LTX-2.3 LoRA 학습 가이드: 스타일, 모션 및 IC-LoRA 제어 (2026)

공식 ltx-trainer를 사용하여 LTX-2.3에서 커스텀 LoRA를 학습합니다. 스타일 LoRA, IC-LoRA 구조적 제어, 랭크 설정, 데이터셋 준비 및 일반적인 학습 실패 사례를 다룹니다.

안녕, 친구. 나는 Dora야.

일주일을 LoRA 훈련에 쓸 계획은 아니었어. 그냥 제품 데모가 특정 모션 패턴을 따라야 했는데, 텍스트 프롬프트만으로는 부족했거든. 그 작은 불편함이 나를 LTX-2.3 훈련 경로로 이끌었고, 내가 발견한 것은 나를 놀라게 했어 — 혁명적이어서가 아니라, 어떤 설정이 실제로 중요한지 알고 나면 조용히 실용적이기 때문이야.

이건 포괄적인 참고서가 아니야. 2026년 3월에 스타일, 모션, IC-LoRA 제어 워크플로우를 테스트하면서 배운 것들이야.

LTX-2.3 공식 트레이너에 포함된 것들

LTX-2 GitHub 저장소는 세 개의 패키지를 가진 모노레포로 구성되어 있어: 모델 구현을 위한 ltx-core, 생성 워크플로우를 위한 ltx-pipelines, 그리고 LoRA 및 IC-LoRA 파인튜닝을 위한 ltx-trainer. 너비와 높이 설정은 32로 나누어져야 하고, 프레임 수는 8n+1 규칙을 따라야 해 — 즉 1, 9, 17, 25 프레임 등으로.

첫 번째 훈련 실행에서 이걸 무시했어. 트레이너가 오류를 냈고, 수동으로 프레임을 패딩했더니 작동했어. 작은 제약이지만, 미리 알아두면 좋아.

세 가지 LoRA 유형과 각각의 사용 시기

스타일 LoRA (외관, 텍스처, 색상)

스타일 LoRA는 LTX-2.3에 시각적 미학을 가르쳐 — 색상 그레이딩, 텍스처 처리, 조명 분위기. 나는 일관된 흰 배경과 부드러운 그림자가 있는 제품 사진으로 하나를 훈련했어. 캐릭터나 스타일 LoRA의 경우, 20-50장의 이미지로 보통 좋은 결과를 얻을 수 있어. 단, 매우 구체적인 주제의 경우 80-120장까지 늘리기도 해.

이미지 전용 데이터셋도 여기서는 잘 작동해. 처음 몇 개의 LoRA를 훈련할 때는 비디오 클립 대신 정지 프레임을 사용했어 — 큐레이션이 더 간단하고, 모션을 처리할 필요 없이 모델이 정체성을 학습하거든.

모션/이펙트 LoRA (움직임, 변환)

모션 LoRA는 사물이 어떻게 보이는지보다 어떻게 움직이는지에 집중해. 카메라 팬, 물체 회전, 변환 시퀀스. 이것들은 정지 이미지가 아닌 짧고 일관된 비디오 클립이 필요해. 일관된 프레이밍의 15초 클립으로 돌리-인 모션 LoRA를 테스트했는데, 다양한 피사체에서 모델이 움직임 패턴을 잘 포착했어.

모션 훈련은 스타일보다 덜 안정적으로 느껴졌어. 더 많은 재시도, 더 가변적인 결과.

IC-LoRA (구조적 제어: 깊이, 포즈, 캐니 엣지)

IC-LoRA는 달라. 새로운 미학이나 모션을 모델에게 가르치는 대신, 깊이 맵, 포즈 스켈레톤, 엣지 감지 같은 참조 신호를 기반으로 생성을 조건화해. IC-LoRA는 추론 시 참조 비디오 프레임을 기반으로 비디오 생성을 조건화할 수 있게 해줘서, 텍스트-투-비디오 베이스 모델 위에 세밀한 비디오-투-비디오 제어를 가능하게 해.

나는 깊이 IC-LoRA를 사용해서 시각적 콘텐츠를 완전히 바꾸면서 카메라 움직임을 고정시켰어. 공식 IC-LoRA 가이드는 세 가지 제어 모드를 잘 설명해: 엣지 보존을 위한 Canny, 카메라 및 공간 기하학을 위한 Depth, 인간 모션 전환을 위한 Pose.

데이터셋 준비 규칙

프레임 수 제약 (8n+1 규칙)

프레임 수는 8로 나눈 값 + 1이어야 해. 이건 유연한 가이드라인이 아니야 — 클립이 10프레임이나 15프레임이면, 트레이너가 오류를 내거나 내부적으로 패딩할 거야. 업로드 전에 데이터셋을 17프레임(2 × 8 + 1)으로 일괄 처리했더니 훈련이 매끄럽게 진행됐어.

해상도 나눗셈 (32px 규칙)

너비와 높이는 32로 나누어져야 해. 배치를 1024×576으로 리사이징했다가 트레이너가 조용히 1024×608로 패딩하는 걸 보고 나서 이걸 배웠어. 처음부터 올바르게 리사이징하는 게 나아.

비디오 vs 이미지 데이터셋: 각각의 사용 시기

이미지 전용 데이터셋도 LTX-2.3 LoRA 훈련에 유효해. 특히 정체성이나 스타일 LoRA의 경우, 너무 일찍 모션 학습을 강제하는 것보다 훨씬 쉬워. 모든 프로젝트를 정지 이미지로 시작해서 외관을 검증한 다음, 모션이 중요하면 짧은 비디오 클립을 추가했어.

모션이 많은 작업의 경우, 짧고 일관된 클립이 여전히 긴 다중 장면 세그먼트보다 나아.

기본 훈련 설정

올바른 기본값인 랭크 32와 더 높게 올려야 할 때

LTX-2.3의 경우, 랭크 32가 올바른 기본값이야. 보통 LoRA가 너무 일찍 경직되지 않으면서 충분한 용량을 제공해. 복잡한 스타일 LoRA에서 랭크 64를 테스트했는데 개선이 거의 없었어 — 데이터셋이 채울 만큼 크거나 다양하지 않아서 추가 용량이 도움이 안 됐거든.

학습률 시작점과 변경해야 할 때

LTX-2.3 LoRA 훈련에서는 1e-4가 시작하기 좋은 곳이야. 이건 지루한 답이 올바른 답인 경우 중 하나야. 처음 네 개의 LoRA에서 학습률을 건드리지 않았는데, 모두 깔끔하게 수렴했어.

스텝 수: 일찍 멈춰야 할 때 아는 법

많은 사용자들이 체크포인트 250, 500, 750이 이미 좋아 보이는지 확인하기 전에 높은 스텝 수로 바로 뛰어드는 데 시간을 낭비해. 나는 체크포인트 500에서 샘플을 뽑아보고, LoRA가 이미 강해 보이면 거기서 멈춰. 체크포인트 750이나 1000에서 LoRA가 이미 강해 보인다면, 훨씬 더 밀어붙이면 오히려 더 취약해질 수 있어.

과적합은 모델이 일반화하는 대신 훈련 데이터를 암기할 때 나타나. 검증 샘플이 훈련 프레임과 동일하게 보이기 시작해.

IC-LoRA: 깊이, 포즈, 엣지 제어

IC-LoRA가 표준 스타일 LoRA와 다른 점

IC-LoRA는 모션을 시각적 스타일링에서 분리해. 텍스트와 스타일 LoRA로 외관을 조종하고, 구조화된 가이드로 움직임을 조종해. LTX-2.3 IC-LoRA 유니온 컨트롤 모델은 단일 어댑터에서 깊이, 포즈, 엣지 등 여러 제어 신호를 지원해.

제품 턴테이블 시퀀스에서 깊이 IC-LoRA를 실행했어. 카메라 경로는 참조 깊이 맵에 고정되어 있었지만, 시각적 콘텐츠는 내 프롬프트에 따라 완전히 바뀌었어.

ComfyUI IC-LoRA 워크플로우 통합

RunComfy LTX 2.3 IC-LoRA 워크플로우는 깊이, 포즈, 엣지 추출을 자동으로 처리해. 참조 클립을 로드하고, 제어 모드를 선택하고, 스타일 중심 프롬프트를 작성하면, 모델이 모션을 별도로 처리해.

처음에 놓쳤던 세부 사항: IC-LoRA가 모션과 구조를 제어하기 때문에 프롬프트는 외관에 집중해야 해. IC-LoRA가 제어하는 동안 프롬프트에서 카메라 움직임을 설명하려고 하면 충돌이 생겨.

일반적인 훈련 실패와 수정 방법

LoRA가 모든 것에 번지는 경우 (DOP 해결책)

DOP(프롬프트 드롭아웃)는 LoRA가 모든 것에 번지기 시작할 때 가장 먼저 활용할 수 있는 고급 옵션이야. 비슷한 아이템에서는 잘 작동하지만 관련 없는 피사체에도 영향을 미치기 시작하는 제품 스타일 LoRA를 훈련했어. 캡션 드롭아웃을 추가하니 LoRA가 일반화되는 데 도움이 됐어.

높은 스텝 수에서의 과적합

더 많은 스텝을 범용 품질 업그레이드로 취급하지 마. 모션 LoRA를 2,000 스텝까지 실행했다가 기본 패턴을 학습하는 대신 정확한 훈련 프레임을 재현하기 시작하는 걸 봤어. 체크포인트 750으로 롤백했어.

캡션 드롭아웃과 캐시 텍스트 임베딩 충돌

캡션 드롭아웃을 사용하는 경우, 캐시 텍스트 임베딩은 OFF로 유지해야 해. 이건 잘못 사용하면 조용히 훈련 동작을 악화시킬 수 있는 몇 안 되는 소소한 설정 중 하나야. 한번 둘 다 활성화했더니 일관성 없는 결과가 나왔어 — 모델이 캐시된 임베딩에 의존할지 누락된 캡션을 처리할지 결정하지 못했거든.

배포 전 LoRA 검증하기

LoRA를 완성으로 선언하기 전에 세 가지 검증 테스트를 실행해: LoRA를 사용할 때와 사용하지 않을 때 같은 프롬프트로 기대한 것이 추가되는지 확인, 일반화를 확인하기 위한 다양한 프롬프트, 그리고 훈련 세트에 없었던 엣지 케이스. LoRA가 훈련 캡션과 밀접하게 일치하는 프롬프트에서만 작동한다면, 과적합된 거야.

FAQ

A100이나 더 작은 GPU에서 LoRA를 훈련할 수 있나요?

LTX-2.3 훈련은 공식적으로 80GB+ VRAM의 Nvidia H100 GPU를 대상으로 하지만, 더 낮은 VRAM 설정에서도 그래디언트 체크포인팅과 낮은 해상도로 작동할 수 있어. 직접 A100 훈련을 테스트해보지는 않았지만, 공식 트레이너 문서는 이를 권장 하드웨어 기준으로 언급하고 있어.

H100에서 스타일 LoRA를 훈련하는 데 얼마나 걸리나요?

현장 보고에 따르면, 검증과 소규모 재시작을 포함해 중간 크기 데이터셋의 경우 단일 4090에서 LoRA당 약 3-5시간이 걸린다고 해. H100은 더 빠르겠지만, 직접적인 수치는 없어.

LTX-2 LoRA는 재훈련 없이 LTX-2.3에서 작동하나요?

아니. LTX-2.3은 더 높은 품질 데이터로 훈련된 완전히 재설계된 VAE를 탑재하고 있고, 텍스트 커넥터 아키텍처도 변경됐어. LTX-2의 구 LoRA는 깔끔하게 전환되지 않아 — 테스트해봤더니 시각적 아티팩트가 발생했어.

IC-LoRA를 스타일 LoRA와 결합할 수 있나요?

응. 최대 세 개의 LoRA 어댑터를 동시에 쌓아서, 커스텀 미학과 구조적 제어를 혼합할 수 있어. IC-LoRA 로더 전에 스타일 LoRA를 실행했고, IC-LoRA가 기하학과 타이밍을 유지할 수 있도록 가중치를 적당히 유지했어.

클라우드 플랫폼을 통해 LoRA 훈련이 가능한가요?

응. RunComfy AI Toolkit과 fal.ai 모두 GPU 인프라를 관리하지 않고 브라우저 기반 훈련을 제공해. 데이터셋을 업로드하고, 파라미터를 설정하고, LoRA가 완성되면 다운로드하면 돼.

LTX-2.3용 LoRA 훈련은 마법이 아니야. 데이터셋 준비, 기본 설정, 그리고 일찍 멈춰야 할 때 아는 것이야. 8n+1 프레임 규칙과 32px 나눗셈 제약이 처음에는 임의적으로 느껴지지만, 그냥 모델의 기하학적 요구사항이야. 이를 피하려 하지 말고 함께 작업해.

나를 놀라게 한 건 복잡성이 아니었어 — 첫 번째 실행에서 모든 파라미터를 조정하는 대신 랭크 32와 1e-4 학습률을 고수했을 때 얼마나 많은 시간을 절약했는지였어.

이전 게시물: