DeepSeek V4 vs Claude Opus 4.5 코딩 벤치마크 비교

여기 Dora입니다. 지난 일요일 아침, 불안정한 테스트를 패치하기 위해 에디터와 채팅창 사이를 오가고 있었는데, 모델이 존재하지 않는 import를 계속 만들어냈어요. 큰 문제는 아니지만, 손을 느리게 하는 종이 베인 같은 불편함이죠. 모델을 바꾸면 실제 처리 시간뿐 아니라 내 저장소에 들어가는 것을 믿는 데 필요한 정신적 노력도 줄어들지 않을까 궁금했어요.

그래서 지난 주(2026년 1월 27일~2월 1일) 간단하고 반복 가능한 루프를 돌렸어요: 같은 작업, 같은 저장소 스냅샷, DeepSeek V4와 Claude Opus 4.5를 번갈아가며 사용. 이건 연구실 연구가 아니에요. CI에 모델을 연결하기 전에 확인할 만한 종류의 체크예요. 당신도 코딩을 위해 DeepSeek V4와 Claude Opus 4.5 중에서 고민 중이라면, 전환하기 전에 읽고 싶을 만한 내용들입니다.

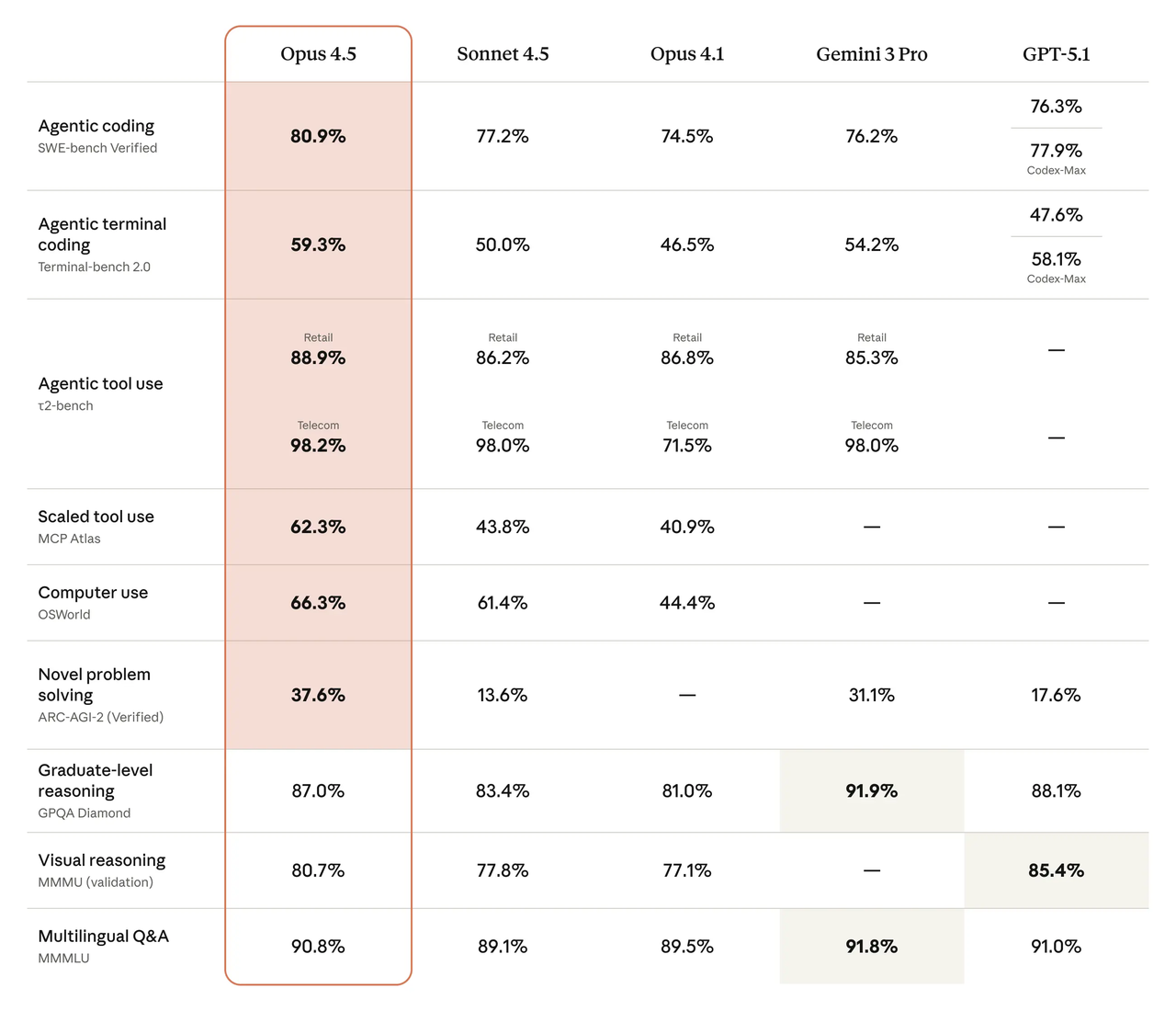

현재 벤치마크 리더

SWE-bench Verified 순위

바람이 어디로 부는지 빠르게 파악해야 할 때, 저는 공개 리더보드부터 시작합니다. SWE-bench Verified 리더보드에서는 DeepSeek의 최신 모델들과 Anthropic의 최신 Claude 제품군이 모두 상위권에 자리 잡고 있으며, 프롬프트, 도구, 평가 방식이 변함에 따라 주마다 작은 격차가 변해요. 저에게 중요한 건 단일 숫자가 아니라 패턴이에요: 어떤 모델이 도구에 의존하지 않고 끝에서 끝까지 문제를 일관되게 해결하는지, 그리고 프롬프트 조정에 얼마나 민감한지요.

2026년 2월 초 제 빠른 분석:

- DeepSeek V4는 요청한 모든 컨텍스트를 제공하면 여러 파일, 저장소 규모 작업에서 강한 움직임을 보여줍니다. 긴 프롬프트와 명시적 파일 맵의 이점을 봅니다.

- Claude Opus 4.5는 꾸준한 결과를 내놓고 컨텍스트를 줄이거나 시스템 메시지를 제거할 때 덜 퇴행하는 경향이 있습니다. 화려하지는 않지만, 최소 수준이 높게 느껴져요.

HumanEval 점수

HumanEval은 더 좁은 범위이고, 단위 테스트가 있는 짧은 코딩 문제지만, 기본적인 코드 생성을 확인하는 데 유용해요. OpenAI HumanEval 저장소의 현재 요약과 EvalPlus 리더보드 같은 커뮤니티 추적 도구는 두 모델 모두 최상위 계층에 배치합니다. 여기서는 정확한 pass@1에 고정되지 않아요: seed 전반에 걸친 안정성과 모델이 언어 트릭에 의존하는 빈도가 아닌 직접적이고 관용적인 코드를 작성하는지를 확인합니다.

제 실행에서 DeepSeek V4는 때때로 더 길고 “설명적인” 솔루션을 생산했는데, 괜찮지만 항상 내가 원하는 좁은 diff는 아니었어요. Claude Opus 4.5는 더 자주 깔끔한 함수를 반환했는데, 추가 해설 없이 테스트를 통과했어요. 벤치마크는 이런 차이를 암시하지만: 직접 해본 일이 이를 명확하게 했어요.

제 실행에서 DeepSeek V4는 때때로 더 길고 “설명적인” 솔루션을 생산했는데, 괜찮지만 항상 내가 원하는 좁은 diff는 아니었어요. Claude Opus 4.5는 더 자주 깔끔한 함수를 반환했는데, 추가 해설 없이 테스트를 통과했어요. 벤치마크는 이런 차이를 암시하지만: 직접 해본 일이 이를 명확하게 했어요.

각 모델이 뛰어난 분야

긴 컨텍스트 (DeepSeek)

이 설정을 끝에서 끝까지 재현하고 싶으시면, 제가 준비한 짧은 DeepSeek V4 빠른 시작 가이드에서 제가 여기서 의존하고 있는 채팅과 API 기본 사항을 설명합니다.

두 모델 모두에 실제 작업을 했어요: 조용히 복잡해진 작은 FastAPI 서비스를 리팩토링하는 것. 약 14개 파일이 중요했고, README는… 낙관적이었어요. 저장소 스냅샷을 압축해서 파일 요약과 간단한 스크립트로 생성한 호출 그래프를 함께 제공했어요. DeepSeek V4는 광활함 속에서도 침착했어요. 여러 파일 효과를 추적하고 단계적 계획을 요청했을 때 당황하지 않았어요: 먼저 인터페이스, 다음 테스트, 마지막 핸들러. 놀라운 부분은 구조적 힌트를 얼마나 잘 사용했는지 - 간단한 파일명과 책임의 “맵”을 제공했을 때, 존재하지 않는 파일에 대한 편집 제안을 중단했어요.

두 가지 실용적인 주의:

- 숨을 쉴 수 있는 공간이 필요했어요. 컨텍스트를 너무 공격적으로 줄이면 조심스러워지고 이미 제공한 파일을 보자고 시작했어요. 완전한 그림을 주면 깔끔하게 진행했어요.

- “내가 놓친 게 뭘까?” 같은 프롬프트를 잘 처리했어요. 테스트 스위트 기반 엣지 케이스를 물었을 때, 제가 잊은 세 가지를 찾아냈어요: 빈 auth 헤더, 손상된 페이지네이션 param, 오류 로깅의 느린 경로.

처음엔 시간을 절약하지 못했어요. 초기 설정, 컨텍스트 패키징, 짧은 파일 맵 작성에 약 20분이 걸렸어요. 하지만 몇 번의 실행 후 정신적 부하가 줄었어요. “이걸 알려줬나?” 걱정을 덜 했어요. 코딩 일정이 여러 모듈에 걸친 큰 diff처럼 보인다면, DeepSeek V4는 컨텍스트가 넓어질 때 안정적인 손을 가지고 있어요.

코드 신뢰성 (Claude)

Claude Opus 4.5는 다른 방식으로 저를 설득했어요: 예리한 모서리가 더 적어요. 최소한의 패치를 요청하면 정확히 그걸 줬어요. 드라이 런을 포함한 3단계 계획을 요청하면 명령을 환각하지 않았어요. 그리고 제가 요청하지 않은 것을 “개선”하려는 욕구에 저항했어요.

Claude Opus 4.5는 다른 방식으로 저를 설득했어요: 예리한 모서리가 더 적어요. 최소한의 패치를 요청하면 정확히 그걸 줬어요. 드라이 런을 포함한 3단계 계획을 요청하면 명령을 환각하지 않았어요. 그리고 제가 요청하지 않은 것을 “개선”하려는 욕구에 저항했어요.

작은 예: 타임존 수학 관련 불안정한 테스트가 있었어요. 제 프롬프트는 단호했어요: “프로덕션 코드를 바꾸지 말고 테스트를 수정하고, 근본 원인을 한 문장으로 설명하세요.” Claude는 tz fixture를 매개변수화하고 단일 assertion을 조정해서 aware datetime을 사용하도록 제안했어요. 첫 번째 시도에 통과했어요. DeepSeek도 수정했지만, 같은 숨에서 helper를 리팩토링하려고 했어요. 틀린 건 아니지만, 제가 원했던 것보다 더 무거웠어요.

5개 작업에 걸쳐 Claude의 diff는 일관되게 더 작았어요. 뜬금없이 나타나는 import가 더 적었어요. 그리고 추측할 때도 깔끔한 메모를 남겼어요: “pytz를 사용 가능하다고 가정: 아니면 zoneinfo로 교체하세요.” 그런 헤지된 제안은 감사하기 쉬워요.

두 가지 제한이 있었어요:

- Claude는 성능에서 안전하게 플레이했어요. 한 경우, DeepSeek이 즉시 지적한 간단한 O(n) 개선보다 명확성을 선택했어요. 저는 이렇게 물어야 했어요: “같은 제약 하에서 최적화하세요.” 했지만, 먼저 뛰어들지 않을 거예요.

- 매우 긴 프롬프트로, 더 빨리 천장에 도달했어요. 요약이 도움이 됐지만, DeepSeek은 모델이 “전체 앱을 머리에 담으라”고 원할 때 덜 답답했어요.

당신의 하루가 대부분 정밀한 패치, 테스트 수리, API 주변의 글루 코드라면, Claude Opus 4.5는 변경을 거의 예측 가능하게 유지해요. 실제로, 그건 느낄 수 있는 신뢰성이에요.

직접 비교를 실행하는 방법

코딩을 위해 DeepSeek V4와 Claude Opus 4.5 사이에서 망설이고 있다면, 짧고 지루한 실험이 어떤 리더보드보다 더 많은 걸 말해줍니다. 제가 사용한 루프입니다, 자유롭게 조정하세요.

코딩을 위해 DeepSeek V4와 Claude Opus 4.5 사이에서 망설이고 있다면, 짧고 지루한 실험이 어떤 리더보드보다 더 많은 걸 말해줍니다. 제가 사용한 루프입니다, 자유롭게 조정하세요.

1. 당신의 주를 반영하는 작업 선택

- 한 개의 저장소 일거리 (리팩토링 또는 모듈 추출)

- 하나의 불안정한 테스트

- 하나의 API 통합 변경

- 하나의 작은 알고리즘 조정

각각 45분 이하로 유지하세요. 모델의 생성뿐 아니라 상호작용도 시간 제한하세요.

2. 입력 고정

- 특정 커밋을 고정하세요. 테스트하는 동안 대상을 움직이지 마세요.

- 모델이 볼 수 있는 것을 정하세요: 전체 파일 vs 발췌문. 발췌문을 전달하는 경우 짧은 파일 맵을 작성하세요.

- 두 모델에 동일한 시스템 프롬프트 스타일을 사용하세요. 저는 단순하게 유지합니다: “당신은 유용한 코딩 어시스턴트입니다. 최소한의 diff와 실행 가능한 코드를 선호합니다.”

3. 재사용할 수 있는 프롬프트 작성

- 작업: “여기 목표, 제약, 테스트가 있습니다.”

- 컨텍스트: 파일 목록 또는 요약, 알려진 위험 포함.

- 출력 형식: “계획을 제안하고 (글머리표), 그 다음 diff, 그 다음 한 문장 위험 주의.”

4. 둘 다를 위해 같은 신호 캡처

- 통과 테스트까지의 시도 (1–N)

- diff의 라인 변경 (대략이면 됨)

- 모델을 위해 작성해야 한 메모 (“X 편집 중단”, “기존 helper Y 사용”)

- 첫 번째 초록색 테스트까지의 시간

5. 누수 보호

- 도구 비교를 계획하지 않으면 도구를 비활성화하세요. 한 모델이 쉘을 실행하고 다른 모델이 그렇지 않으면, 같은 것을 테스트하지 않는 거예요.

- 검색을 허용하면 둘 다 같은 문서 스냅샷을 가리키세요.

6. 벤치마크로 온전성 확인, 숭배하지 마세요

- SWE-bench Verified를 훑어보고 당신의 결과가 극단적으로 벗어나 보이는지 확인하세요. 그렇다면, 모델을 탓하기 전에 프롬프트를 확인하세요.

- 한입 크기 문제의 경우, 공식 저장소에서 HumanEval 샘플을 훑거나 몇 개를 로컬로 실행하세요. 단일 실행보다 몇 가지 seed 전반에 걸친 일관성이 더 드러나요.

7. 선택: 작은 루브릭 추가

1–5 점으로 평가:

- Diff 최소성 (필요한 것만 건드렸나요?)

- Fixture 규율 (테스트, env, 의존성)

- 복구 동작 (놓친 부분을 지적할 때 자정정하나요?)

- 설명 품질 (하나 또는 두 개의 명확한 문장, 블로그 게시물 아님)

실제로 무엇을 주시하는지

- 모델이 처음부터 제약을 존중하나요?

- 잘못되면, 쉽게 찾을 수 있는 방식으로 잘못되나요?

- 컨텍스트를 전환하는 동안 패치를 제안하도록 하는 것이 안전한가요?

이건 제게는 효과가 있었어요, 당신의 결과는 다를 수 있어요. 요점은 승자를 결정하는 게 아니에요: 어느 것이 당신의 코드와 당신의 일정에서 인지적 마찰을 줄이는지 보는 것이에요.