WAN 2.7 命令ベース動画編集ガイド

WAN 2.7が命令ベースの動画編集機能を追加。その概要、編集できる内容、プロダクションパイプラインへの統合方法、そして開発者が知っておくべきことを解説します。

こんにちは、皆さん。Doraです。AIビデオツールをしばらく使ってきましたが、WAN 2.7の指示ベース編集機能について初めて聞いたとき、大きな変化をもたらすとはすぐには思えませんでした。テキストコマンドでビデオを編集するというのは、デモでは見栄えが良くても実際に使うと崩れてしまうような機能に聞こえました。

正直、半分は間違いでした。

WAN 2.7における指示ベースビデオ編集とは

既存のビデオクリップを用意し、変更したい内容を書くと、モデルがその特定の要素を調整しながら他の部分はすべてそのまま保持します。再生成ではなく、編集です。

標準的なテキスト→ビデオ生成との違い

テキスト→ビデオは何もないところから始まります。プロンプトを書いて、結果を受け取ります。

指示編集は、すでに存在するものから始まります。クリップはある。タイミングは設定済み。残りに触れずに一部分だけを変更するよう—背景を入れ替え、照明を変え、衣装の色を変える—モデルに依頼します。

WaveSpeedAIの分析では、これが業務的に重要だと指摘されています。以前はクリップをゼロから再生成する必要があったイテレーションサイクルが、軽量な編集として処理できるようになりました。ジャケットの色が間違っていたからといって再生成するのは無駄に感じていました。ジャケットだけを編集するのは正しい方向性です。

ビデオ再現との違い

再現は参照ビデオのモーション構造を取り込み、新しい被写体やスタイルに適用します。モーション転送です。

指示編集は修正します。元のクリップはそのまま残り、指定した要素だけが変わります。

モデルが受け取る入力

2つのもの:ソースビデオ(1080Pで最大15秒)と自然言語の指示。

驚いたこと:マスキングも、レイヤー分離もありません。クリップと文章だけです。

指示で編集できるものとできないもの

対応している編集カテゴリー

テストとDzineのプラットフォームドキュメントによると、指示編集が対応しているのは:

- 背景の入れ替え(屋内→屋外、晴れ→雨)

- 照明の変更(ゴールデンアワー→ブルーアワー)

- オブジェクトレベルの調整(シャツの色を変える、小道具を追加する)

- スタイルの変更(リアル→イラスト調)

これらが機能するのは、境界が明確な変更だからです。モデルは背景とは何か、照明が何をするかを理解しています。

指示ベース編集が難しいもの

複雑な空間的な再配置はうまくいきません。「キャラクターを左に移動させて」ではきれいな結果が出ませんでした。キャラクターはそのままか、構図がぎこちなくズレました。

アイデンティティが重要なシーン—特定の表情、細かいロゴの詳細—は編集に抵抗します。モデルは照明を変えられますが、表情や年齢を変えるときに正確な特徴を維持するのが難しいです。

物理的な変化は当たり外れがあります。「水の流れを速くして」は時々うまくいき、時々ちぐはぐに見えました。

編集の粒度

すべての編集はプロンプトレベルです。変更内容を説明すると、モデルがどの部分に適用するかを推測します。まだオブジェクトレベルのターゲティングはありません。

非常に具体的な指示を書くことを学びました。「ジャケットを赤に変えて」は「アウトフィットを暖かいトーンにして」より効果的でした。

効果的な編集指示の設計

良い編集指示の条件

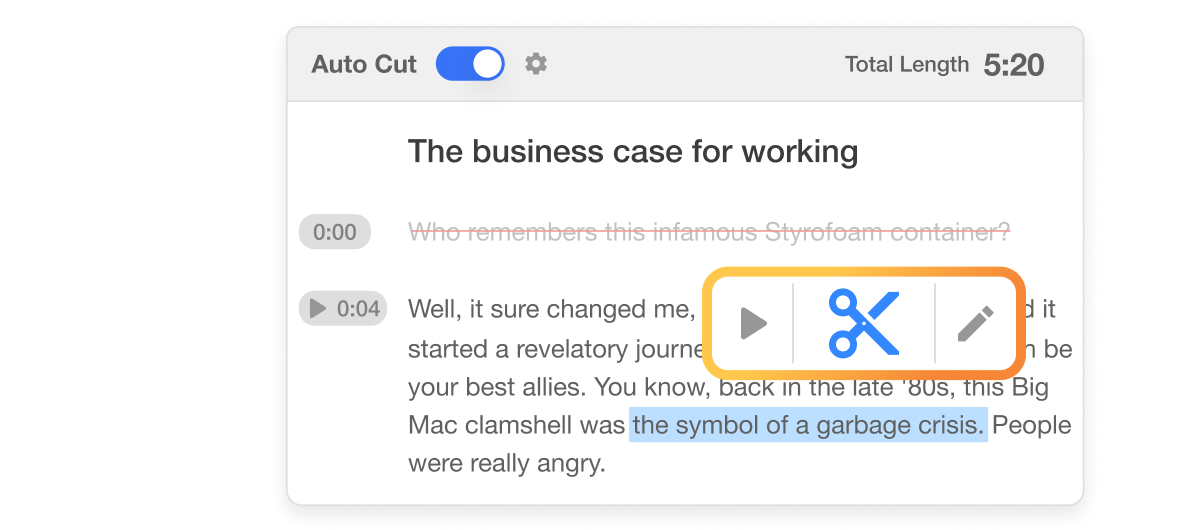

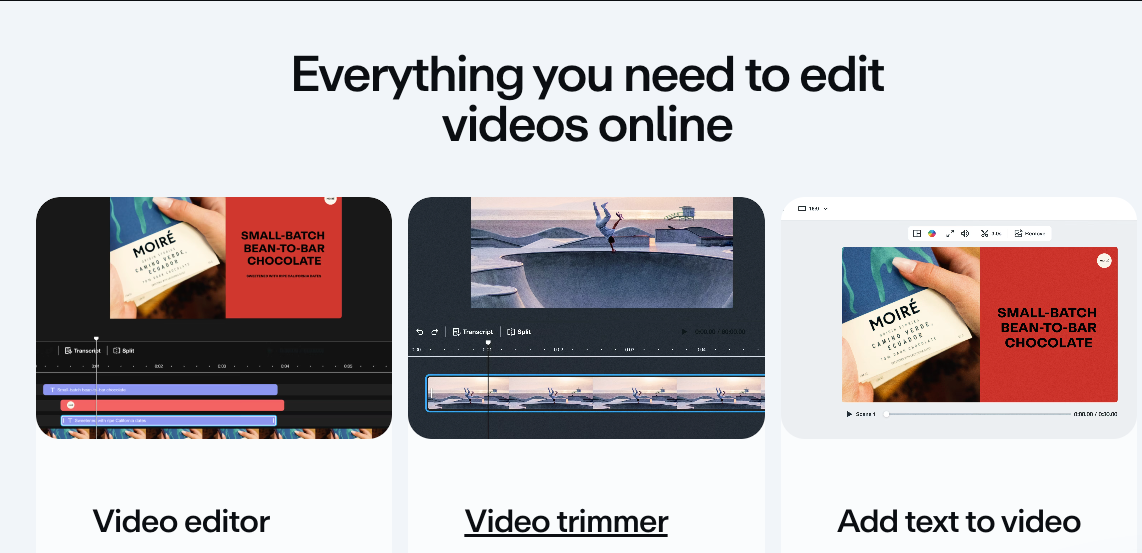

良い指示は具体的で、方向性があり、範囲が限定されています。このアプローチは、マスキングやレイヤー分離なしにテキストを編集するだけでビデオを編集できるDescriptのような哲学に通じます。

「空を暗い雲のある曇り空に変えて」は一貫して機能しました。何が変わるか、何になるか、詳細が指定されています。

「もっとドラマチックに見せて」はうまくいきませんでした。曖昧すぎました。モデルは毎回異なる解釈をしました。

悪い指示の条件

ソースクリップと矛盾する指示は静かに失敗します。キャラクター中心のショットで「シーンから人を消して」は無視されるか、フレームが壊れた状態になりました。

複数の矛盾する要素を含む指示は苦手です。「ジャケットを青に変えて、背景を森にして、雨を追加して」は一度に3つの編集を試みました。1つの指示につき1つの編集の方が効果的でした。 この明確なプロンプトパターン—何が変わるかを述べて目標の状態を説明する—は、トランスクリプトを直接編集して映像を洗練させるVislaのテキストベースビデオ編集で見られるベストプラクティスと一致しています。

プロンプトパターン

うまくいったパターン:

- 何が変わるかを述べる

- 目標の状態を説明する

- 15語以内に収める

「都市の背景を山の風景に入れ替えて」—明確な対象、明確な目標、きれいな結果。

入力要件

ソースビデオの仕様

ソースビデオ:2〜15秒、最大1080P。1080Pで5秒のクリップと720Pで10秒のクリップをテストしました。両方とも機能しました。

参照のアライメント

ソースに激しいモーションブラー、急激なカット、極端な露出がある場合、編集結果が劣化します。モデルには明確なフレームが必要です。

速いパンショットでは背景の入れ替えがぼやけました。静止または動きの遅いショットではきれいな編集ができました。

プロダクションパイプラインにおける指示編集の位置づけ

これをメインツールとして使うとは思っていませんでした。目新しい機能だと思っていました。でもそうではありませんでした。

生成後のポリッシュループ

標準的なテキスト→ビデオ生成でクリップを作ると、求めているものの80%が得られることがよくありました。モーションは正しく、フレーミングも正しかったのですが、カラーグレーディングがおかしかったり、背景がブリーフに合わなかったりしました。

指示編集以前は、プロンプトを調整して再生成し、うまくいくことを祈るしかありませんでした。成功率:約40%。各再生成には60〜90秒かかり、使えるものが見つかるまで3〜4回試みることもよくありました。

今は一度生成して、問題のある特定の要素だけを編集します。成功率は約70%に近づき、イテレーションも速くなりました。90秒の完全な再生成を3回(合計4.5分)する代わりに、1回の生成と1回の編集(合計約2.5分)で済みます。複数のプロジェクトにまたがると、この時間の節約は積み重なります。

完全な再生成なしのスタイルイテレーション

都市の街を歩くキャラクターのベースクリップを1つ生成し、指示編集で3つのスタイルバリアントを作成してテストしました:

- 「サイバーパンクのネオン美学にシフトして」

- 「水彩画スタイルに変えて」

- 「モノクロのフィルムノワールにして」

3つの編集はすべて、元のモーションと構図を保持しました。変わったのはビジュアルスタイルだけです。キャラクターの歩行サイクルはまったく同じでした。カメラの動きもズレませんでした。

これは、シーン全体を3回再生成せずにコンセプトの選択肢を見せたいクライアントプレゼンテーションに役立ちます。また、生成クレジットを消費せずに広告クリエイティブのA/Bテストにも便利です。

同じワークフローを編集の代わりに再生成で試してみました—スタイルキーワードを組み込んだ3つの異なるプロンプトを書いて。3つのうち2つはモーションのタイミングが若干異なって戻ってきて、比較ができなくなりました。編集では、テストしていたスタイル変数以外はすべて比較可能な状態に保たれました。

コスト比較:編集 vs 再生成

WaveSpeedAIのコスト分析によると、指示ベース編集は標準的な生成とは異なるコストプロファイルを持つ可能性がありますが、正確な価格はまだ公開されていません。

ワークフローの観点からは、編集が生成と同じ1秒あたりのコストであっても、失敗した試みを破棄しないため実際にはより安くなります。1回の生成と1回のターゲットを絞った編集は、3回の完全な再生成より優れています。

計算:生成が1080Pで1秒あたり$0.12(PiAPIのWAN 2.6価格)とすると、5秒のクリップは$0.60。3回の再生成は$1.80。1回の生成と1回の編集—たとえ編集が同じ$0.60であっても—は$1.20にしかなりません。無駄を減らすだけで33%の節約です。

編集が生成より安くなる場合(既存フレームを修正するためゼロから作成するより可能性が高い)、節約はさらに拡大します。

APIアクセスへの影響

別のエンドポイントかパラメータフラグか?

WaveSpeedAIの分析では、指示編集には新しいペイロードフィールドが必要になる可能性があると示唆しています—おそらくedit_instructionパラメータ、場合によっては別のエンドポイント。

本番統合の前に公式APIドキュメントを待っています。

トークンとコンピュートコスト

マルチ入力推論はシングル入力生成より重くなります。指示編集はソースビデオと編集指示の両方を処理するため、コンピュートコストが高くなります。

予算を適切に設定してください。ただし、価格が公開されるまで最終的な予測は立てないでください。

非同期ジョブの考慮事項

すべてのWAN操作は非同期で実行されます。リクエストを送信し、タスクIDを取得し、完了するまでポーリングします。

テストでの予想待機時間:5秒の1080P編集で30秒〜2分。

よくある質問

指示ベース編集はローンチ時にWaveSpeed APIで利用できますか?

WAN 2.7は2026年3月中にローンチします。指示編集のAPI利用可能性はまだ確認されていません。WaveSpeedAIは通常、公式リリースから数日以内に新しいエンドポイントを追加します。

編集のためのソースビデオはどのくらいの長さまで対応していますか?

1080Pで最大15秒。短いクリップ(2〜5秒)の方が処理が速く、よりきれいな編集ができます。

編集は元のオーディオを保持しますか? 編集の内容によります。背景の変更はオーディオを保持します。ビジュアル美学を変えるスタイルの変更は同期に影響することがあります。ケースバイケースでテストする価値があります。

関連記事: