WAN 2.7:新機能、APIアクセス、アップグレードパス

WAN 2.7はAlibabaの大型アップグレード:最初/最後のフレーム制御、9グリッドI2V、音声参照、指示ベース編集。開発者が知っておくべきことをまとめました。

みなさん、こんにちは。Doraです!Wan モデルファミリーは2.1の頃からずっと注目してきました。プロダクション パイプラインでオープンソースの勢いがつき始めたモデルは、カバレッジよりも速く動くことが多いからです。WAN 2.7 はまだリリース途中で — 2026年3月中にローンチ予定 — なので、これはリリースレビューではありません。すでに2.5を運用しているチームがインフラを切り替えるべきか、それとも待つべきかを判断するための事前チェックリストです。

誇大広告なし。確認済みのこと、まだ曖昧なこと、そして…それがあなたのビルドキューに何を意味するかだけをお伝えします。Wan のようなモデルがプロダクション スタックのどこに収まるかをまだ整理中なら、仕様の詳細に踏み込む前にAI動画生成ツールが実際のワークフローでどう使われているかのこの解説が意思決定の軸足を固めるのに役立ちます。

WAN 2.7を60秒で(短いバージョン)

プロダクトまたはエンジニアリングの視点から評価するなら:WAN 2.7は純粋な品質向上というよりも、機能的な拡張として形成されつつあります。見出しは「より良い動画」ではなく、「より多くのコントロール サーフェス」です。映像品質、オーディオ生成、モーション ダイナミクスにわたって改善が見られますが、より興味深い追加点は構造的なものです:ファースト/ラスト フレーム コントロール、9グリッドのマルチ入力I2V、被写体+音声リファレンス、そしてインストラクション ベースの編集。

2.5との差分は主に解像度ではありません。単一の呼び出しでモデルが受け付けるアンカリング入力の数です。

WAN 2.7の新機能

ファースト フレームとラスト フレームの動画コントロール

ファースト アンド ラスト フレーム アプローチでは、2枚の画像を使って動画の始まりと終わりの両方をユーザーが定義し、モデルが中間コンテンツを自動生成します。これはWanシリーズの以前のリリース(Wan2.1-FLF2V-14Bを参照)でスタンドアロン モデルとして存在していましたが、2.7では別チェックポイントとしてではなくモデル内に組み込まれています。

プロダクション チームにとって:これは定義されたキーフレームがある場合に最も重要です — 静止した製品ショット、動いている製品ショット — フルの手動アニメーション パスなしにモデルにトランジションを補間させたい場合です。エンドポイントは決定論的です。中間で何が起こるかは依然確率的ですが、コンポジションのガードレールは確保されています。

9グリッド画像から動画(3×3マルチ入力)

WAN 2.7は3×3グリッド合成アプローチをサポートしており、単一の動画生成タスクに対して最大9枚のリファレンス画像を構造化入力として送信できます。これは単一フレームのI2Vとは意味のある違いがあります。

実際の応用:様々なアングルや照明条件でキャラクター一貫性のあるコンテンツを生成する場合、単一のアンカーではなくリファレンス グリッドを提供できるようになりました。異なるツールがマルチ リファレンスの一貫性をどう扱うかを比較しているなら、マルチフェイスとマルチ入力サポートを備えた最高のビデオ フェイス スワップ ツールのこのガイドが現在のソリューションがまだ苦労している箇所を示しています。品質チェックのコストを高くするI2Vバッチ ジョブのワンショット運頼み要素が減ります。グリッド入力のエンドポイント スキーマはこの記事執筆時点で正式に公開されていないため、起動時にAPIパラメータ構造を確認してください。

被写体+音声リファレンス

WAN 2.7では、視覚的な被写体リファレンスと音声リファレンスを組み合わせて、キャラクターの外見と声の両方が入力と一致した動画を生成できます。これはWan 2.6がR2Vモデルで導入したものの拡張で — 外見と音声の両方を含むキャラクター リファレンス動画をアップロードし、テキスト プロンプトを使ってそのキャラクターが登場する鮮やかな新しいシーンを生成できるようにしていました。

2.7では、これが別のモデル エンドポイントではなくより緊密に統合されることが期待されています。キャラクター主導の短尺コンテンツやローカライゼーション パイプラインを構築するチームにとって、…これは最も明確なプロダクションROIを持つ機能です — 繰り返しのバッチ呼び出しで音声リファレンスの処理が安定していれば。参考として、これはアイデンティティと音声の一貫性が両方求められる場合に特に、現在のAIビデオ フェイス スワップ パイプラインが大規模で崩れ始める箇所でもあります。

インストラクション ベースの動画編集

WAN 2.7は自然言語インストラクションを使用した既存動画の編集をサポートします — 背景の変更、照明の修正、またはキャラクターの衣装の変更を説明してモデルに残りを処理させることができます。

これは生成から編集への意味のある転換です。ポスト プロダクションの修正ループを実行するプロダクト チームにとって、小さな変更に対する手動のロトスコーピングとコンポジティング作業の軽量な代替手段が開かれます。主な未知数は、編集がモーション隣接要素(例えば動いている被写体の衣装)に影響する場合に、モデルが長いクリップ全体の時間的一貫性をどう処理するかです。そこは類似ツールが歴史的に劣化してきた箇所です。

公式のAlibaba Cloud Model Studioドキュメントは現在のWanラインアップの関連する編集エンドポイントをすでにカバーしており、2.7で見られるであろうAPIパターンのベースラインを提供しています。

動画再現 / 複製 [要検証]

この機能 — モーション構造を保持しながらスタイルや被写体の変更を加えて既存動画を再現または複製する — はWAN 2.7のサードパーティ サマリーに登場しています。この記事執筆時点でAlibaba公式ドキュメントで独自に確認されていません。 Alibabaの正式リリース ノートで確認されるまで、この機能にワークフローの依存関係を構築しないでください。アップグレード プロジェクトをスコープしている場合は、探索的なものとして位置づけてください。

変わらないもの(2.6からのアーキテクチャの継続性)

基本的なDiT(拡散トランスフォーマー)アーキテクチャは引き継がれます。Wanシリーズは主流の動画DiTアーキテクチャに基づくトランスフォーマー コンポーネントを使用し、フル アテンション メカニズムを採用して長距離の時空間依存性を正確に捉え、高い時間的・空間的一貫性を確保します。

ローカル推論を実行するチームにとって重要:GPUメモリ プロファイルと量子化アプローチは大幅には変わりません。 2.6の推論スタックが最適化されているなら(FP8 ops、マルチGPU シャーディング)、その投資は引き継がれます。まったく新しいデプロイメント アーキテクチャは期待しないでください。

APIアクセスと利用可能性 — 確認済みのこととTBD

公式アクセス パス(DashScope / Wan.video)

以前のWanバージョンで確認されている2つの公式チャネルは、Alibaba CloudのDashScopeプラットフォーム — APIキーのプロビジョニングとモデル アクセスを処理する — とクリエイター向けワークフローのWan.videoでした。どちらもローンチ時に2.7を提供することが期待されていますが、地域ごとの利用可能性(特に国際アカウントと中国本土)はリリース時に確認する必要があります。

DashScope APIキーはDASHSCOPE_API_KEY環境変数から読み込まれ、国際ユーザーはdashscope-intl.aliyuncs.comを指します — 確立されたインフラを考えると、同じパターンが2.7にもほぼ確実に適用されます。

サードパーティ APIの利用可能性

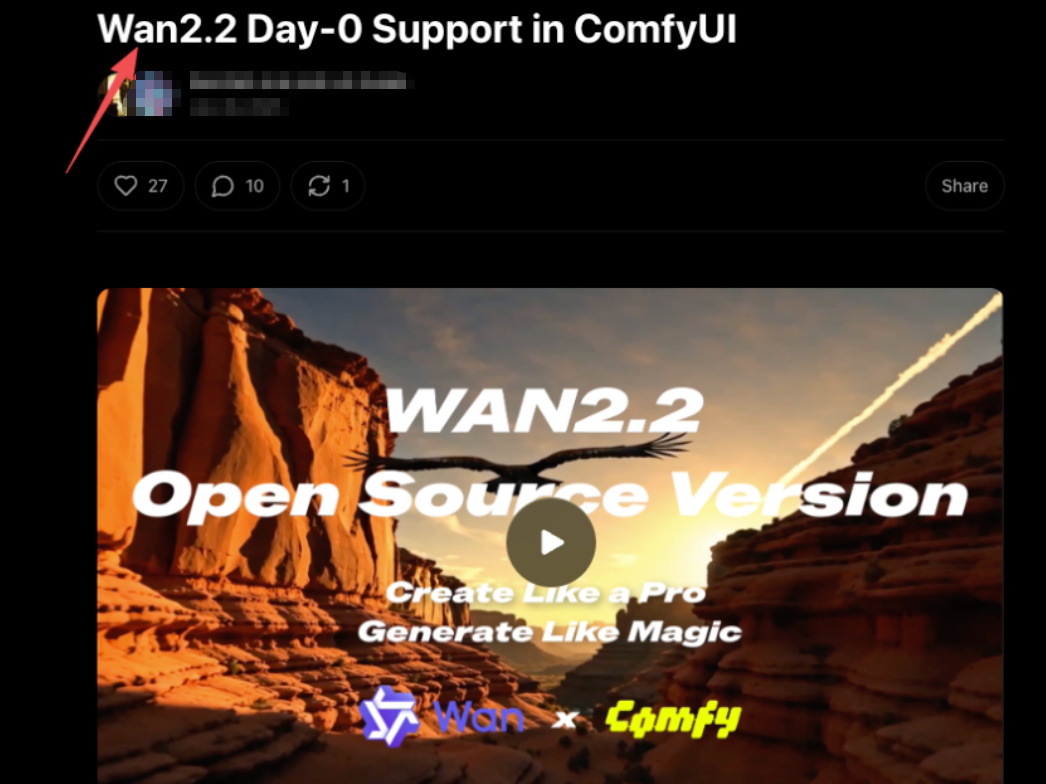

この記事執筆時点で、WAN 2.7はサードパーティAPIアグリゲーターでまだ確認されていません。2.2以降のパターンに基づくと — Wan 2.1と2.2はともにオープンソース モデルウェイトのローンチ日にComfyUIネイティブ サポートが提供されました — 2.7が公開ウェイトとともにリリースされればコミュニティ統合もすぐに続くと期待できます。

2.7がオープンソースとしてリリースされるかどうか自体は未確認です。以下のFAQを参照してください。

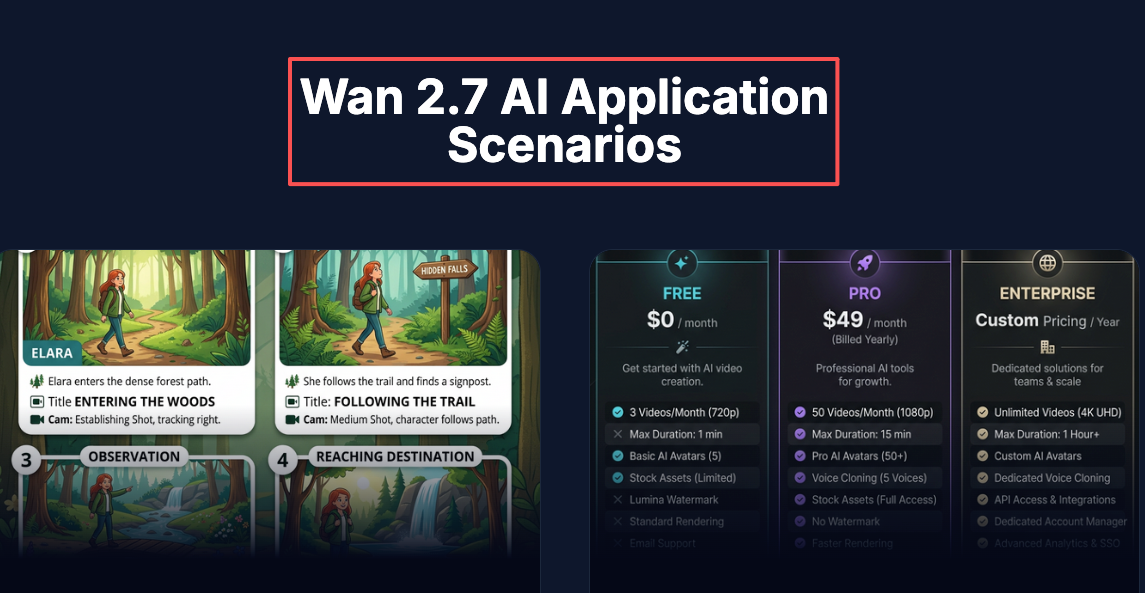

今すぐWAN 2.7を優先すべきチーム

リファレンス ヘビーな動画制作を行うチーム

パイプラインがすでにショット間のキャラクター一貫性に依存していて、複数の生成パスやControlNetの回避策で補完してきた場合 — 被写体+音声リファレンスとマルチ フレーム グリッド入力が、そのオーバーヘッドを最も直接的に削減する2つの機能です。アップグレードのスコープ検討に値します。

マルチ入力I2Vが必要なビルダー

単一画像のI2Vは一貫性が必要になるまでは機能します。9グリッド入力はリファレンス サーフェス エリアを大幅に変えます。これをシミュレートするためにバッチの回避策を使ってきたなら、2.7が複数のAPI呼び出しを1つに統合できるかもしれません。

WAN 2.5を待てるクリエイティブ チーム

2.5のワークフローが安定していて、新機能が現在のプロダクション ボトルネックにマッピングされない場合は、急ぐ必要はありません。モデルはまだローンチ中です。何かを再配線する前に、コミュニティ フィードバックの最初の2週間でエッジ ケースを浮き上がらせましょう。

FAQ

- WAN 2.7はいつAPIで公式に利用可能になりますか? ローンチは2026年3月中に計画されています。地域ごとの正確なAPI利用可能日:まだ確認されていません。

- WAN 2.7はWAN 2.2のようにオープンソースですか? 未確認。Wan 2.2はApache 2.0の下でリリースされ、商用利用とComfyUI統合が可能でした。2.7が同じライセンスに従うかどうかはローンチ前の資料では述べられていません。

- WAN 2.7はComfyUIをサポートしますか? まだ確認された統合はありません。以前のリリースを考えると — Wan 2.1と2.2はともにローンチ日またはその近くでComfyUIサポートがありました — モデルウェイトが公開されればコミュニティ ノードがすぐに続くと仮定してください。

- WAN 2.5と比べた価格はどうですか? 価格はまだ発表されていません。WanモデルシリーズはDashScopeを通じて秒単位または動画単位で課金されるのが一般的でした。更新された料金はローンチ時にAlibaba Cloud Model Studioの価格を確認してください。

- 今日サードパーティAPIプロバイダーからWAN 2.7にアクセスできますか? まだできません。モデルはローンチしていません。公式のWan GitHubとDashScopeドキュメントでリリース確認を監視し、その後プラットフォームのサポートを確認してください。

ローンチ後に注目すべきこと

2.7が最初の数週間で安定するにつれて、追跡する価値のあるいくつかのことがあります:

— インストラクション編集での時間的一貫性:インストラクション ベースの編集は、プレビューの説明に対して実際に異なる動作をする可能性が最も高い機能です。コミュニティの出力を注意深く観察してください。

— オープンソース ウェイトのリリース:ウェイトが公開されれば、数日以内にComfyUIワークフロー、Diffusers統合、量子化バリアントが登場することを期待してください。そうでなければ、DashScope APIが主要なアクセス パスのままとなり — 地域のレイテンシが実際のワークフロー変数になります。

— 動画再現機能のステータス:これは公式ソースが必要です。Alibabaが明示的に確認するまで、何かの仕様に組み込まないでください。