OmniHuman-1.5:Toward Virtual Humans with “Soul”

Avez-vous déjà regardé des vidéos présentant des humains numériques animés avec fluidité, mais senti qu’il leur manquait une véritable émotion ? Pour surmonter cette limitation, nous vous présentons OmniHuman-1.5, développé par ByteDance—un cadre révolutionnaire conçu pour générer des animations de personnages qui transcendent la simple imitation. Il ne redonne pas seulement vie aux avatars virtuels, mais les dote également de la capacité d’exprimer des émotions.

De l’imitation à l’expression : une percée technique

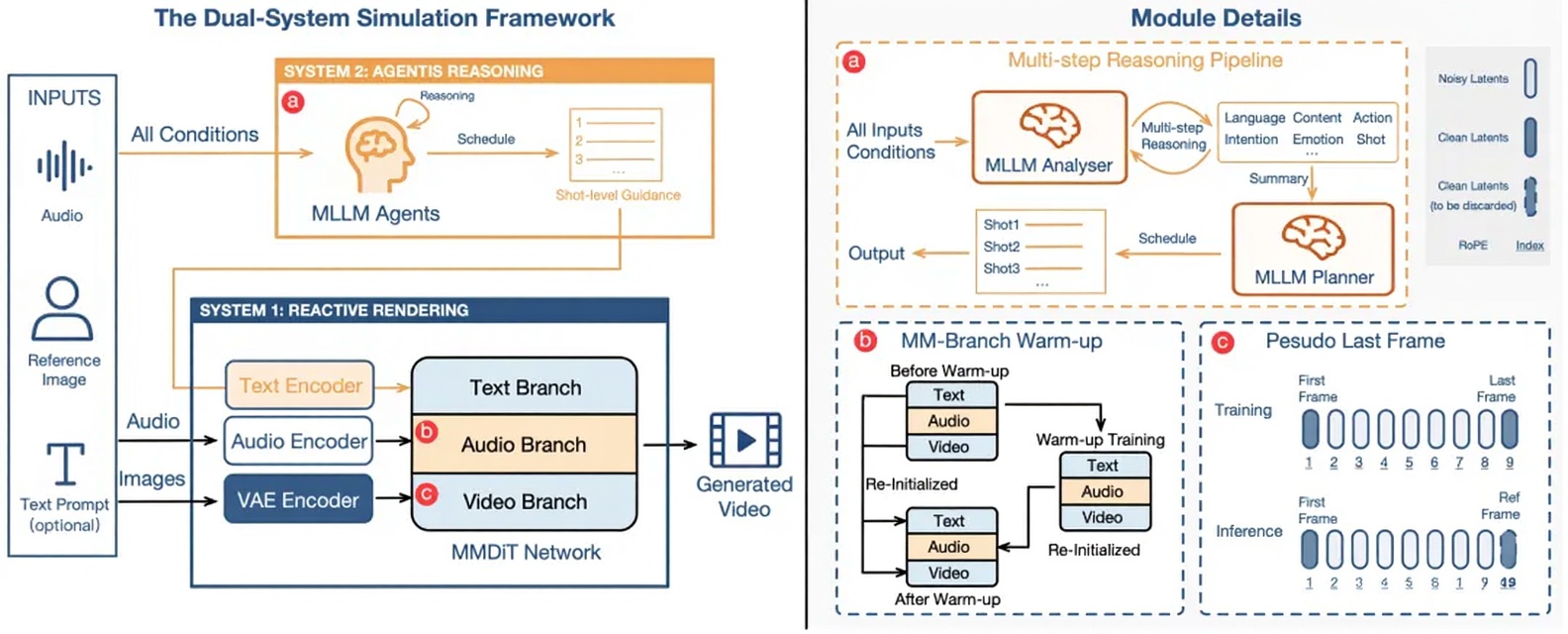

OmniHuman-1.5 emploie un cadre de simulation à double système.

Premièrement, cette méthode exploite des modèles multimodaux de grande taille pour générer des représentations sémantiques structurées, fournissant une orientation sémantique avancée qui permet à la génération de mouvements de transcender la simple synchronisation rythmique et de mieux s’aligner avec le contexte et l’émotion.

Deuxièmement, grâce à une architecture DiT multimodale spécialement conçue et un mécanisme de pseudo-image finale, elle fusionne efficacement les informations multimodales tout en atténuant les conflits, générant ainsi des actions profondément cohérentes avec les personnages, les scènes et le langage.

Que peut faire OmniHuman-1.5 ?

🎶Performances musicales

En utilisant simplement une photo et une chanson, OmniHuman-1.5 peut créer un « chanteur numérique » qui imite précisément les pauses, les respirations et le rythme de l’artiste.

🎭Jeu émotionnel

OmniHuman-1.5 peut non seulement créer des chanteurs numériques, mais aussi produire des acteurs numériques émotionnels.

🗣️Gestes contextuel

Au lieu de gestes répétitifs, les animations s’alignent avec le sens. Par exemple, lorsque l’audio mentionne « cœur », le personnage place naturellement une main sur sa poitrine.

✍️Animation guidée par texte

OmniHuman-1.5 supporte le contrôle par invite. Les exemples incluent :

- mouvements de caméra : « La caméra tourne lentement autour du personnage pour une atmosphère d’auteur. »

- génération d’objets : « L’avatar se tend vers l’objectif, puis commence à parler. »

- actions spécifiques : « Un pingouin danse, porte des lunettes de soleil et se produit sur scène. »

👥Scénarios multi-personnages et stylisés

Contrairement aux humains numériques précédents, OmniHuman-1.5 peut participer à des conversations de groupe et effectuer des actes d’ensemble.

Il fonctionne également avec des humains, des animaux, des figures anthropomorphes et des dessins animés stylisés, démontrant une polyvalence remarquable.

Conclusion : Vers des humains virtuels avec une « âme »

La technologie des humains virtuels a connu une nouvelle percée. L’émergence d’OmniHuman-1.5 signifie une nouvelle ère où les humains virtuels sont passés de la simple imitation à l’expression profonde. Il peut comprendre ce que vous dites et engager une communication véritablement sincère avec vous. Attendons avec impatience le lancement du modèle OmniHuman-1.5 !

Inscrivez-vous dès maintenant sur WaveSpeedAI. De plus, vous pouvez nous contacter sur les réseaux sociaux ci-dessous.

Discord : Discord