Inworld TTS 1.5 est maintenant disponible sur WaveSpeedAI (Max + Mini)

WaveSpeedAI prend désormais en charge Inworld TTS 1.5, un moteur de synthèse vocale en temps réel prêt pour la production, conçu pour une faible latence, une grande expressivité et une montée en charge optimale.

WaveSpeedAI prend désormais en charge Inworld TTS 1.5, un moteur de synthèse vocale en temps réel prêt pour la production, conçu pour une faible latence, une grande expressivité et une mise à l’échelle optimale.

Si vous développez des agents vocaux, des assistants en temps réel, des dialogues de PNJ de jeux vidéo, ou toute interface vocale interactive où chaque milliseconde compte, cette intégration n’a qu’un seul objectif : déployer une expérience vocale réactive et naturelle—sans sacrifier la fiabilité ni les coûts à grande échelle.

Note de co-marketing : Nous réaliserons une promotion conjointe avec Inworld à partir du mardi 10 février 2026 (mardi, 2h00)—donc si vous évaluez la voix en temps réel pour votre produit, c’est la meilleure semaine pour le tester de bout en bout.

Pourquoi c’est important : qualité au top + latence en temps réel

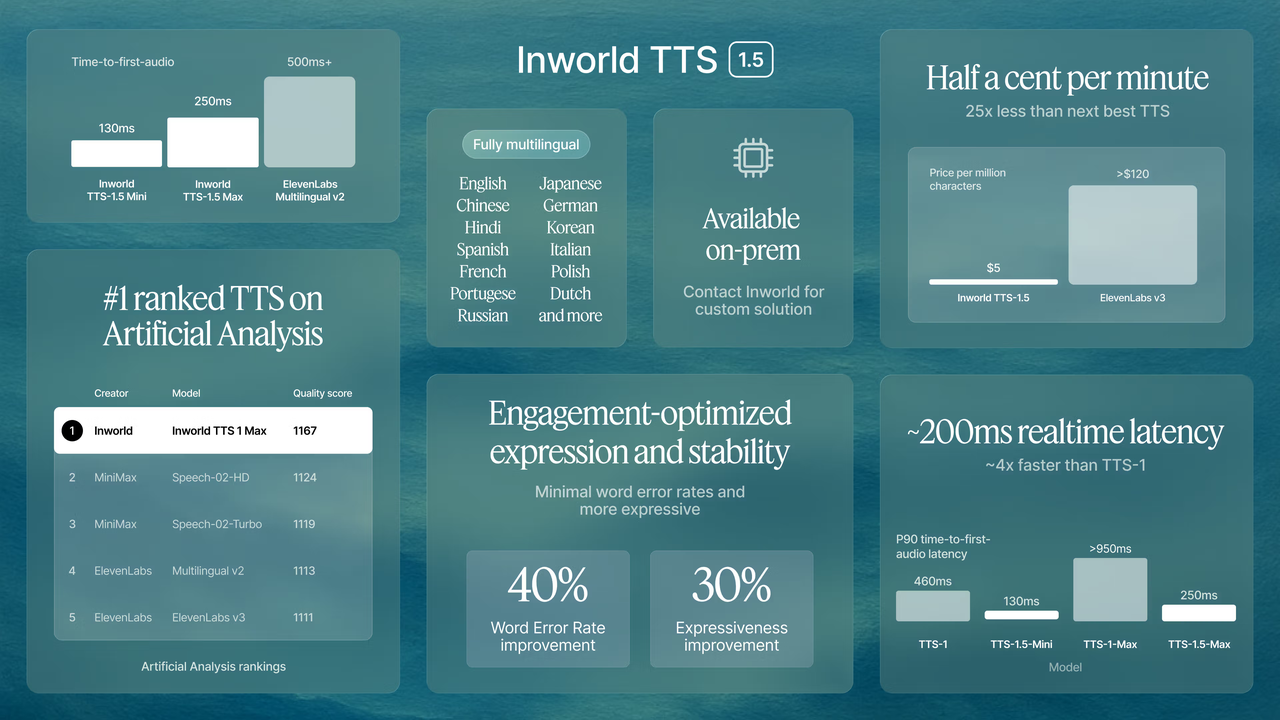

La dernière gamme TTS d’Inworld se positionne autour de benchmarks tiers mesurables—notamment les performances sur des classements indépendants et la réactivité en temps réel.

- Signal de classement n°1 (qualité) : Inworld TTS figure au sommet des comparaisons TTS d’Artificial Analysis, qui suivent la qualité (ELO) ainsi que la vitesse et le prix.

- Streaming en temps réel : Inworld met en avant le streaming en temps réel via WebSocket, avec des variantes de modèles ciblant différents compromis latence/qualité.

En résumé : les développeurs ne veulent pas seulement de « bonnes voix »—ils veulent de bonnes voix qui répondent instantanément et ne s’effondrent pas sous la charge.

Max vs Mini : quel modèle choisir ?

WaveSpeedAI propose deux choix en production :

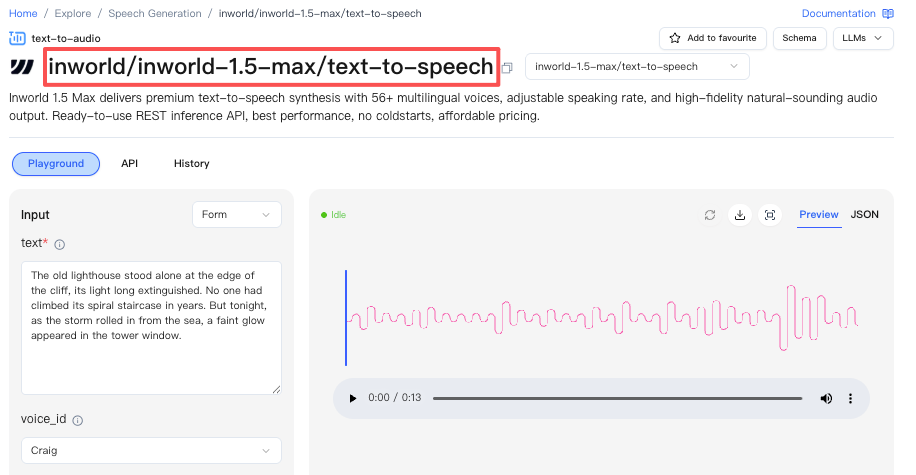

TTS 1.5 Max (recommandé pour la plupart des applications)

Choisissez Max si votre priorité est la meilleure qualité vocale globale, la stabilité et l’expressivité, tout en maintenant la latence dans le domaine du temps réel (Inworld décrit une performance de l’ordre de ~200 ms pour Max).

Cas d’usage typiques :

- Agents vocaux où le naturel est primordial

- Support client / UX en entreprise

- Narration de contenu où un ton « humain » fait la différence

Endpoint WaveSpeedAI : https://wavespeed.ai/models/inworld/inworld-1.5-max/text-to-speech

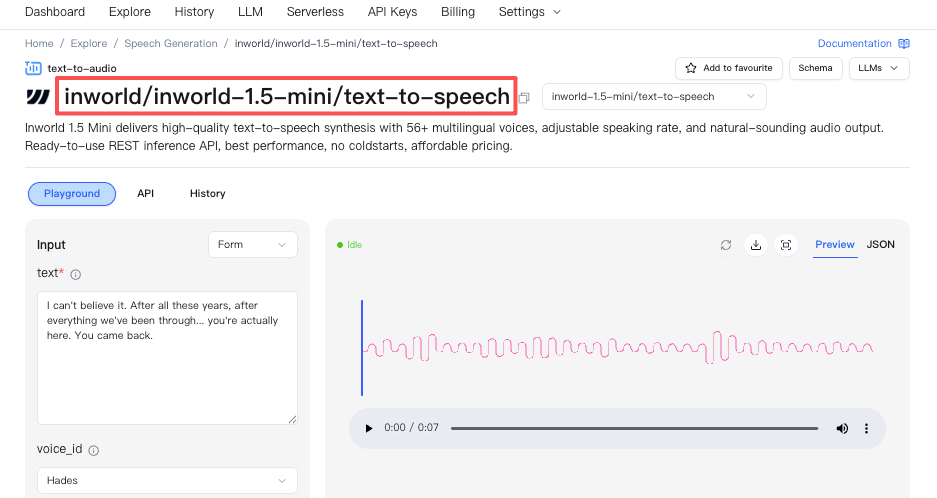

TTS 1.5 Mini (quand la latence est le KPI n°1)

Choisissez Mini si votre priorité est une latence ultra-faible pour des échanges instantanés (Inworld décrit une latence P90 <120 ms pour Mini).

Cas d’usage typiques :

- Dialogues de PNJ en jeu en temps réel

- Avatars en direct / interactions en streaming

- Tout produit où le temps de réponse prime sur la fidélité

Endpoint WaveSpeedAI : https://wavespeed.ai/models/inworld/inworld-1.5-mini/text-to-speech

Ce que vous pouvez construire maintenant (cas d’usage réels)

Voici les modèles que nous voyons les équipes déployer le plus rapidement :

Agents vocaux en temps réel (S2S / tour de parole) La synthèse à faible latence et le streaming sont ce qui donne à la conversation un sentiment de « vivant »—surtout lorsque vous les associez à un LLM et à un pipeline audio interruptible.

Copilotes vocaux pour le support client Lorsque vous avez besoin d’un ton constant, d’une grande intelligibilité et d’une maîtrise des coûts, la « couche vocale » ne peut pas être le goulot d’étranglement. Inworld propose également des options de clonage vocal pour des voix personnalisées ou de marque.

Jeux et personnages interactifs Réponses courtes, forte concurrence et pics imprévisibles—c’est là que l’infrastructure compte autant que le modèle.

Démarrage rapide : appeler Inworld TTS 1.5 sur WaveSpeedAI

Utilisez directement les endpoints des modèles :

Conseils d’implémentation (orientés production) :

- Préférez le streaming WebSocket lorsque vous avez besoin d’une lecture en temps réel et d’échanges serrés.

- Si vous développez un agent vocal, concevez-le pour les interruptions (barge-in) et la lecture audio partielle plutôt que d’attendre la forme d’onde complète.

- Si vous avez besoin de fonctionnalités d’alignement comme des horodatages / annotations audio, planifiez votre couche de lecture client pour consommer ces signaux (idéal pour la mise en surbrillance de type karaoké, les sous-titres ou la synchronisation d’interface).

FAQ

Prenez-vous en charge le streaming WebSocket ? Oui—Inworld positionne TTS 1.5 pour le streaming en temps réel via WebSocket, et c’est la voie recommandée pour les interfaces vocales interactives.

Combien de langues sont prises en charge ? Inworld propose un support multilingue ; WaveSpeedAI expose les modèles pour vous permettre de créer des expériences multilingues depuis la même surface d’intégration. (L’ensemble exact des langues prises en charge dépend du modèle/de la version que vous sélectionnez.)

Le clonage vocal est-il disponible ? Inworld propose des capacités de clonage vocal (avec différents niveaux/flux selon le type de clonage).