Accédez à GLM-4.7-Flash via l'API WaveSpeed

Salut les gars, je suis Dora. L’idée m’est venue d’une petite frustration : encore un autre projet, encore une autre clé API, et encore un autre SDK avec ses propres idées sur les jetons et les tentatives. Je voulais essayer GLM-4.7-Flash parce que les gens n’arrêtaient pas de parler de sa rapidité pour la rédaction quotidienne et la recherche rapide. Mais je ne voulais pas réorganiser toute ma pile juste pour faire quelques tests.

Alors j’ai choisi une approche plus discrète : accéder à GLM-4.7-Flash via l’API WaveSpeed. Les mêmes modèles de client, une seule clé, modèle interchangeable. J’ai testé cela sur quelques scripts en janvier 2026 et j’ai pris des notes. Rien de dramatique. Mais cela a rendu mon quotidien un peu plus léger. Et honnêtement, c’est maintenant le critère—plus léger c’est mieux que plus bruyant.

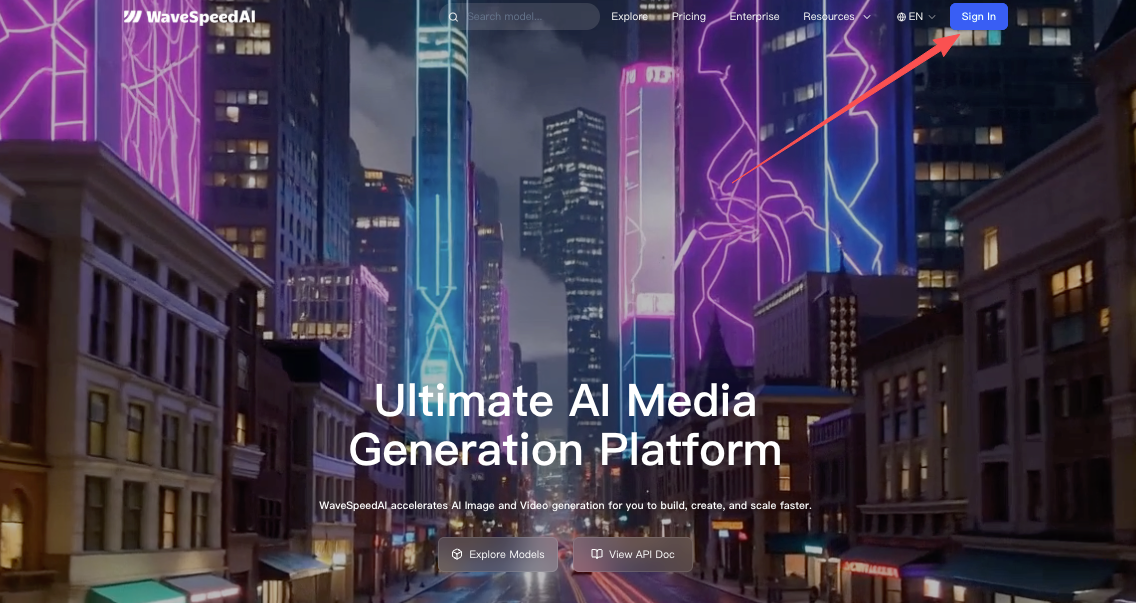

Pourquoi utiliser WaveSpeed

Je ne prétendrai pas que WaveSpeed est magique. C’est plutôt comme un tiroir d’adaptateurs fiable : pas excitant, mais c’est ce que tu attrapes quand tu veux avancer dans ton travail.

Ce qui m’importait, ce n’était pas le nombre de modèles, c’était l’absence de friction. Je pouvais pointer le même code sur différents modèles, changer une ligne, et continuer. C’est tout, pas de prise de tête.

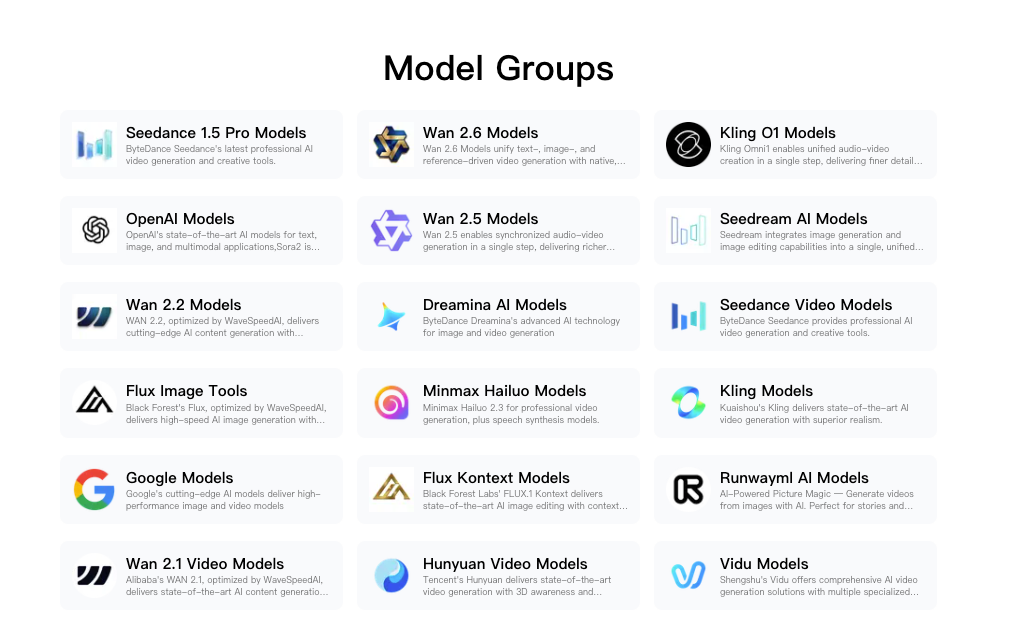

Une clé API, plus de 600 modèles

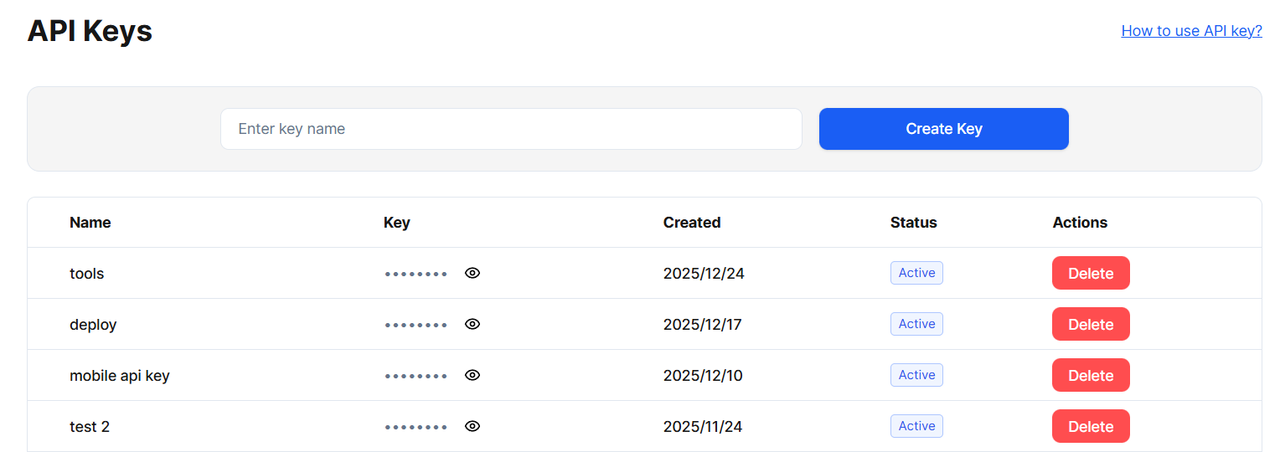

Mon vrai gain était mental. Je ne cherche pas dans les tableaux de bord des fournisseurs pour faire tourner les clés ou plafonner les dépenses. Une clé dans mon gestionnaire de secrets, et je peux router vers GLM-4.7-Flash pour des brouillons rapides, puis passer à un modèle plus puissant quand une invite a besoin de plus de profondeur. Je définis toujours des limites par projet, mais les frais généraux baissent.

En pratique : j’ai conservé ma variable d’environnement existante (WAVESPEED_API_KEY dans mon cas), et j’ai seulement changé le nom du modèle. Cette petite décision—garder les noms alignés, pas de fantaisie—m’a sauvé de casser l’intégration continue.

Pas de changement de SDK

Je suis resté avec le client compatible OpenAI que j’utilise déjà. Pas de nouveaux noms de méthodes, pas de réapprentissage des drapeaux de streaming. Si tu as construit de petits utilitaires autour des complétions de chat, du streaming et des appels d’outils, ils se transfèrent généralement. J’aime que WaveSpeed ne me demande pas d’adopter sa vision avant de me rendre un jeton, si tu vois ce que je veux dire.

Deux mises en garde que j’ai remarquées :

- Les noms de modèles varient selon les fournisseurs. Je vérife l’identifiant exact dans la documentation officielle de WaveSpeed avant de valider le code.

- Les fonctionnalités spécifiques au fournisseur (comme les formats de réponse spéciaux ou les bizarreries des appels de fonction) peuvent toujours différer. Garde un petit fichier adaptateur où tu normalises les charges utiles. Le mien fait 60 lignes et se rentabilise chaque semaine.

Code de démarrage rapide

J’ai utilisé les points de terminaison de style OpenAI que WaveSpeed expose. Si ton code frappe déjà une API Chat Completions, cela devrait te sembler familier. Le seul vrai changement est l’URL de base et le nom du modèle.

J’ai testé cela du 12 au 15 janvier 2026 avec de petits lots d’invites. Les courtes invites ont commencé à streamer en moins d’une seconde sur ma connexion. Évidemment, tes résultats varieront selon le réseau, la taille de l’invite et la charge du serveur.

Exemple de remplacement direct

Voici la forme que j’ai utilisée. Vérifie la documentation officielle de WaveSpeed pour l’identifiant de modèle le plus récent (je l’ai vu listé comme glm-4.7-flash).

Node.js (fetch) :

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests) :

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])De petites notes que j’ai trouvées utiles :

- Si ton application stream les jetons, reprends le même parsing SSE : le drapeau stream de WaveSpeed s’est comporté comme prévu dans mes tests.

- Je définis un délai d’expiration légèrement plus long que d’habitude quand je ne suis pas sûr de la charge du modèle.

- Enregistre le nom du modèle dans les réponses. Le toi de l’avenir te remerciera quand les sorties dériveront et que tu auras besoin de confirmer ce qui a été exécuté.

Combiner avec d’autres modèles

La plupart de mon travail mélange les modèles. GLM-4.7-Flash est rapide pour les premiers passages, la rédaction, la synthèse, les réponses aux questions de base. Quand j’ai besoin d’un raisonnement plus puissant, ou d’une capacité spécifique (comme un bon interpréteur de code ou une certaine fonction de vision), je route ailleurs. WaveSpeed me permet de garder ce routage au même endroit.

Ce qui m’a un peu surpris : je m’attendais à ce que basculer entre les modèles en cours d’exécution soit compliqué. Ce ne l’était pas. Les invites restaient de la même forme, donc je pouvais comparer les sorties sans contorsionner le code.

Flux texte + image

J’ai essayé une petite routine : collecter une capture d’écran d’un rapport d’utilisateur, exécuter un OCR léger ou une légende de vision, puis demander à GLM-4.7-Flash de produire un résumé d’action en langage clair.

Mes étapes :

- Utilise un modèle capable de vision pour extraire le texte/les étiquettes de l’image. Garde la sortie compacte, pense à des paires clé-valeur ou à de courtes puces.

- Transmets ce texte à GLM-4.7-Flash avec une invite système stable (deux lignes), et demande un court résumé avec des décisions.

- Si l’image a des tableaux, j’ajoute une règle rapide : « Préserve les nombres et les unités exactement. » Cela a réduit le nettoyage plus tard.

Notes de terrain :

- Sur un PNG de 1,2 Mo avec une interface utilisateur mixte + du texte, le passage de vision a pris ~2–4 secondes pour moi : la synthèse GLM-4.7-Flash est revenue en moins d’une seconde. Cette division a gardé le flux qui se sent vivifiant.

- Le coût était prévisible car je limitais la sortie de vision à quelques centaines de jetons avant de la transmettre.

- Si tu n’as pas besoin de nuance de vision, exécute d’abord un OCR basique (Tesseract ou une API OCR payante), puis transmets le texte à GLM-4.7-Flash. Moins cher, souvent assez bon.

Flux texte + vidéo

La vidéo est plus lourde, évidemment. Je n’ai envoyé de vidéo complète à aucun modèle. J’ai d’abord tiré la transcription (whisper ou un ASR payant), puis j’ai routé les sections vers GLM-4.7-Flash pour une synthèse rapide.

Une boucle qui a fonctionné :

- Transcris la vidéo une fois. Si tu peux, garde les horodatages.

- Divise par tours de parole ou segments de 3–5 minutes (celui qui est plus propre).

- Demande à GLM-4.7-Flash des résumés de segments et des décisions. Garde l’invite système ancrée : « Tu renvoies seulement du JSON structuré avec les champs A/B/C. »

- Assemble un plan de haut niveau à partir des segments avec une deuxième passe.

En pratique, GLM-4.7-Flash s’est avéré juste pour les résumés de segments : rapide, peu de friction, bonne précision pour la planification. Pour le plan final, j’ai parfois changé de modèle pour le ton ou la nuance. J’ai gardé tout à l’intérieur de WaveSpeed pour que mon code ne change pas de forme.

Tarification

La tarification est là où je ralentis. Pas parce que c’est compliqué, mais parce que les surprises apparaissent dans les journaux, pas dans les tableaux de bord.

GLM-4.7-Flash sur WaveSpeed

En janvier 2026, GLM-4.7-Flash est disponible via WaveSpeed avec son propre taux par jeton. Les chiffres exacts peuvent changer, donc je ne les épinglerai pas ici. Je vérifie la page de tarification officielle avant de pousser quoi que ce soit en production et je définis des limites souples dans ma configuration env.

Comment j’estime :

- Échantillonne une invite et une réponse typiques. Multiplie par le nombre d’exécutions quotidiennes. Cela m’amène aux jetons quotidiens.

- Ajoute 20–30 % de marge pour les mauvais jours ou les nouvelles invites.

- Compare cela à un modèle plus lent mais moins cher pour la même tâche. Si le modèle plus lent n’augmente pas le temps d’édition humain, il pourrait gagner au global.

Une astuce pratique : enregistre les jetons par drapeau de fonctionnalité. Je bascule GLM-4.7-Flash pour une tranche d’utilisateurs et je compare le temps d’édition et les plaintes. Cela m’en dit plus qu’un tableau de prix.

Remises de volume

WaveSpeed propose une tarification basée sur le volume. Les niveaux importent si tu traites des lots de travaux ou exécutes des resauvegarden de données. Je me suis renseigné une fois pour confirmer les seuils avant une semaine de pointe : la réponse était simple et m’a sauvé de l’étranglement du travail dans des fenêtres maladroites.

Ma règle : si je m’attends à une explosion 10x, une campagne, une migration, ou un sprint de recherche, je contacte d’abord le support. Le point n’est pas une affaire spéciale : c’est un plafond clair pour que je ne surveille pas les travaux toute la nuit, parce que personne ne veut cela.

Nous avons construit WaveSpeed pour exactement ce genre de flux de travail : moins de clés, moins de changements de SDK, et moins de temps à penser à l’infrastructure. Si tu jongle avec les modèles et que tu veux juste qu’ils se comportent derrière une seule API prévisible, c’est le problème que nous essayons de résoudre.

➡️ Tu peux l’explorer ici.

À toi maintenant : quel est le cirque de clé API le plus ridicule auquel tu as affaire dernièrement ? Laisse-le dans les commentaires—je les lirai tous en sirotant un café et en me sentant un peu moins seul.