Qu'est-ce que Google Genie 3 ? Le modèle mondial de DeepMind expliqué

Salut, c’est Dora. Un petit détail m’a frappé. Je faisais des extraits d’une courte vidéo de référence pour une idée UX, et je me suis surprise à souhaiter pouvoir “piquer” le clip, ajuster la scène, changer l’angle, décaler le personnage de deux pas vers la gauche, sans rouvrir Figma ni toucher à After Effects. C’est à ce moment que je suis revenue à la ligne Genie de Google. J’avais vu les démos Genie précoces il y a des mois, puis les discussions plus récentes sur « Genie 3 ».

J’ai passé quelques soirées fin janvier 2026 à lire les articles officiels, regarder les vidéos de recherche, et les comparer avec les modèles d’environnement interactif plus anciens que j’ai réellement essayés. Quand j’ai pu, j’ai recréé de petits flux à partir des matériaux Genie publics plus anciens. Quand l’accès était fermé, j’ai pris des notes et j’ai fait une pause quand les prétentions semblaient floues. Voici ce qui m’a marquée, en me concentrant sur ce que les « modèles du monde » signifient en pratique, pas dans les communiqués de presse.

Ce que Google Genie 3 fait

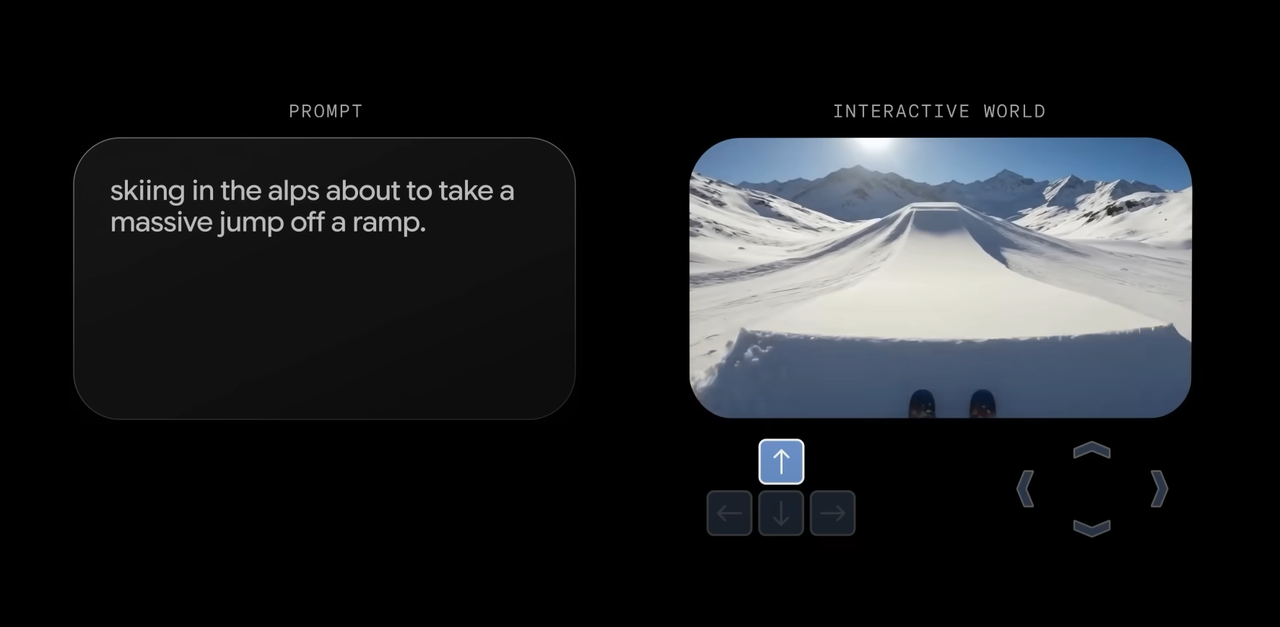

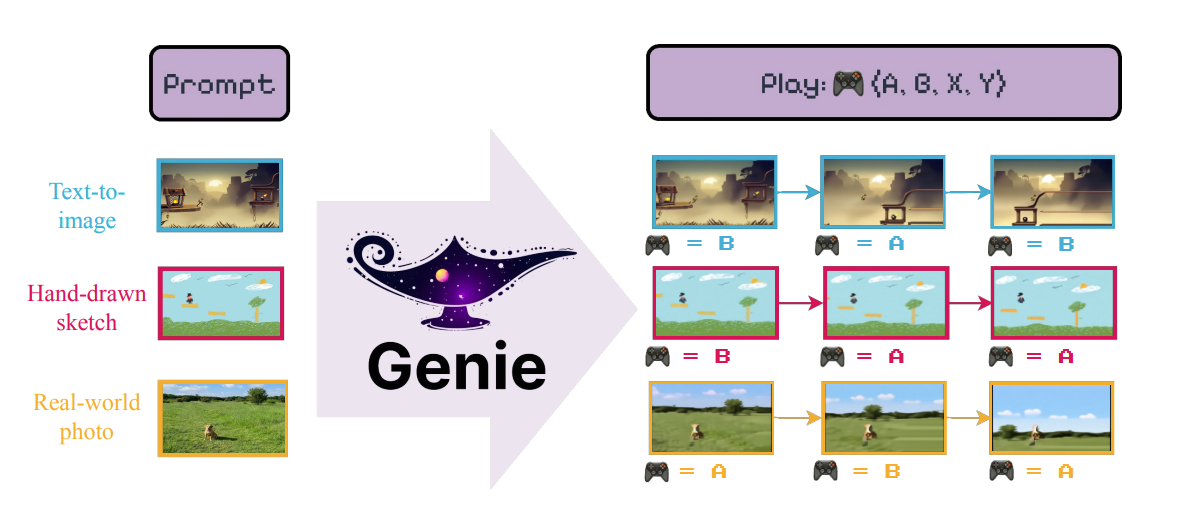

À un haut niveau, Genie 3 est présenté comme un modèle du monde qui peut transformer du texte ou des images en scènes interactives et jouables, pensez à de petits extraits 2D ou 3D stylisés que vous pouvez réellement contrôler plutôt que simplement regarder. Dans les démos de Google/DeepMind, vous esquissez ou décrivez une scène, et le modèle crée un environnement cohérent avec des objets, des règles pseudo-physiques, et un acteur contrôlable. Le résultat final ressemble à une vidéo, mais il se comporte comme un petit jeu.

À un haut niveau, Genie 3 est présenté comme un modèle du monde qui peut transformer du texte ou des images en scènes interactives et jouables, pensez à de petits extraits 2D ou 3D stylisés que vous pouvez réellement contrôler plutôt que simplement regarder. Dans les démos de Google/DeepMind, vous esquissez ou décrivez une scène, et le modèle crée un environnement cohérent avec des objets, des règles pseudo-physiques, et un acteur contrôlable. Le résultat final ressemble à une vidéo, mais il se comporte comme un petit jeu.

Le discours est subtil mais important : au lieu de rendre des images uniques qui ne semblent correctes que de loin, un modèle du monde essaie d’apprendre la dynamique sous-jacente. Quand vous appuyez à gauche, le personnage se déplace d’une manière qui correspond toujours au monde qu’il vient d’imaginer. Quand une balle tombe, la gravité se comporte de la même manière à chaque fois. Cette cohérence est la différence entre un clip cool et un outil que vous pouvez utiliser.

Ce que j’ai remarqué en comparant les démos de Genie 3 aux itérations Genie antérieures, c’est la poussée vers des déroulements plus longs et plus cohérents. Les anciennes versions de Genie pouvaient produire des jouets amusants et de niveau unique : Genie 3 semble maintenir les règles plus longtemps, de sorte que les actions s’enchaînent sans que la scène ne s’effondre. Je dis « semble » parce que je n’ai pas d’expérience pratique avec la version de recherche exacte. Mais les clips montrent moins de bizarreries étranges, moins de moments où un personnage traverse un mur ou où les textures se dissolvent quand la caméra fait un panoramique. La mise à jour semble moins portée sur l’éclat et plus sur la stabilité.

En pratique, voici comment j’utiliserais quelque chose comme ça si c’était dans ma boîte à outils aujourd’hui :

- Esquisser un prototype : Transformer une mise en page esquissée en une maquette jouable pour que les parties prenantes puissent ressentir le timing et les affordances, pas seulement les voir.

- Explorer les idées de mouvement : Générer des variantes de transitions ou d’interactions et choisir celle qui semble juste en main.

- Enseigner ou tester : Construire de petits mondes contraints pour vérifier une séquence d’actions, comme les flux d’intégration ou les tâches de formation.

C’est là l’attrait. Pas de magie, juste moins de friction dans les premiers passages.

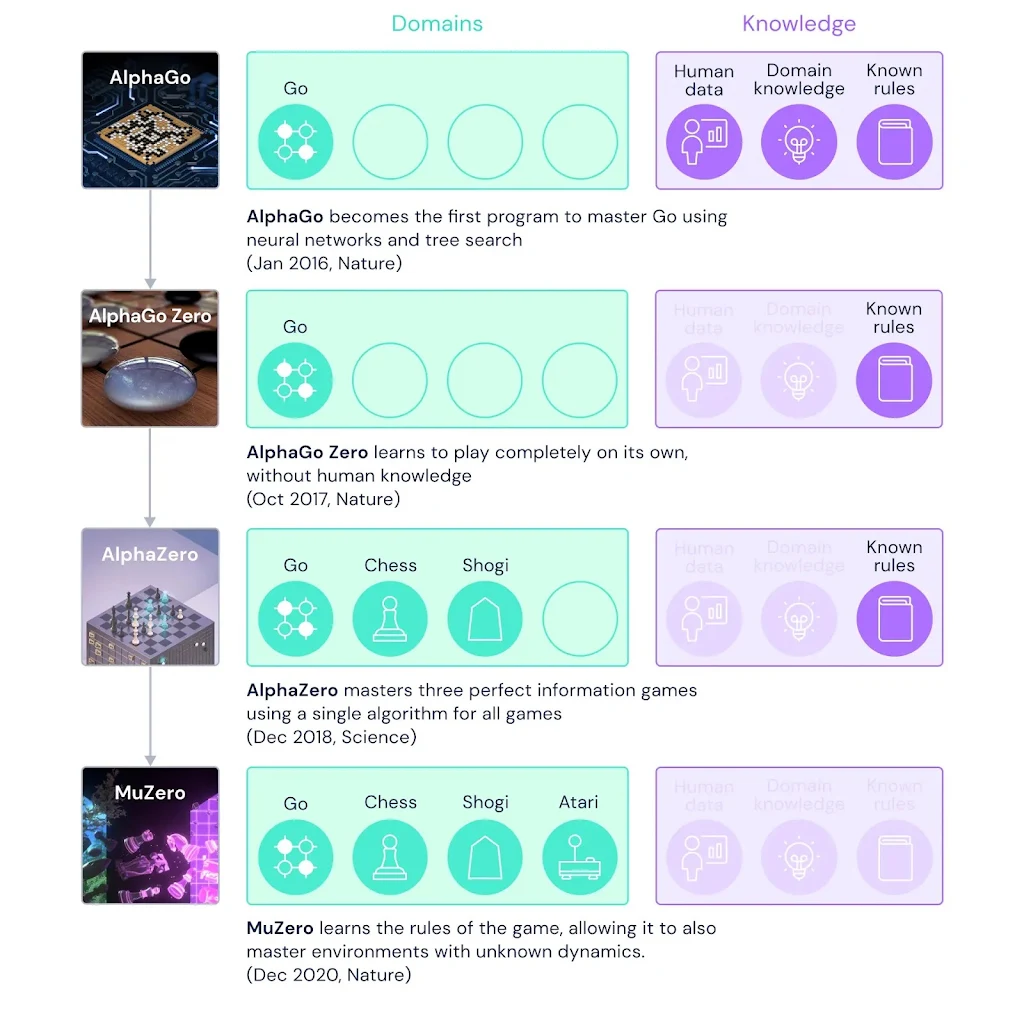

Comment fonctionnent les modèles du monde

Je ne vais pas accumuler le jargon. L’idée centrale : un modèle du monde essaie d’apprendre comment une scène change au fil du temps, pas seulement comment elle ressemble. Si vous avez vu des travaux comme MuZero ou Dreamer, le fil vous semblera familier : apprendre une représentation compacte de l’état, prédire comment il évolue avec les actions, et générer des images qui restent dans le caractère.

Quelques points pratiques que j’ai en tête quand j’entends « modèle du monde » :

Quelques points pratiques que j’ai en tête quand j’entends « modèle du monde » :

- Il y a une mémoire interne de la scène. Le modèle ne redessine pas à partir de zéro à chaque image : il garde une trace des entités et des règles pour que le mouvement soit continu.

- Les actions ont de l’importance. Au lieu de seulement prédire la prochaine image, il prédit le prochain état en fonction d’une action (sauter, tourner, entrer en collision). C’est ce qui le rend jouable.

- La cohérence coûte du calcul. Les déroulements plus longs et stables signifient une formation et une inférence plus prudentes. Si quelque chose semble lent, c’est souvent pour cette raison.

Modèle du monde versus générateur vidéo

La plupart des générateurs vidéo d’aujourd’hui créent des pixels plausibles, puis espèrent que votre cerveau comble les lacunes. Ils excellent dans les rafales cinématiques courtes et les montages rapides. Mais essayez de les contrôler et l’illusion s’effondre. Au moment où vous ajoutez un apport, le modèle doit se souvenir de ce qui existe, où il est, et comment il se comporte.

Un modèle du monde inverse la priorité : se souvenir d’abord, rendre ensuite. Cela coûte plus cher au départ, données, formation, garde-fous, mais cela paie en interactivité. Dans mes notes, j’ai écrit : « La génération vidéo est un conteur : le modèle du monde est un régisseur. » Ce n’est pas une analogie parfaite, mais cela explique pourquoi Genie 3 semble différent. Vous ne demandez pas seulement : « Pouvez-vous faire en sorte que cela ressemble à un platformer ? » Vous demandez : « Puis-je le jouer deux fois et obtenir les mêmes règles ? » C’est le standard qui compte pour le travail.

Capacités clés démontrées

Comme je n’avais pas accès direct à la version Genie 3, je me suis appuyée sur ce qui est visible et cohérent dans les démos et papiers officiels, et sur ce que je pouvais reproduire avec des artefacts publics plus anciens. Voici les parties qui m’ont semblé significatives :

Comme je n’avais pas accès direct à la version Genie 3, je me suis appuyée sur ce qui est visible et cohérent dans les démos et papiers officiels, et sur ce que je pouvais reproduire avec des artefacts publics plus anciens. Voici les parties qui m’ont semblé significatives :

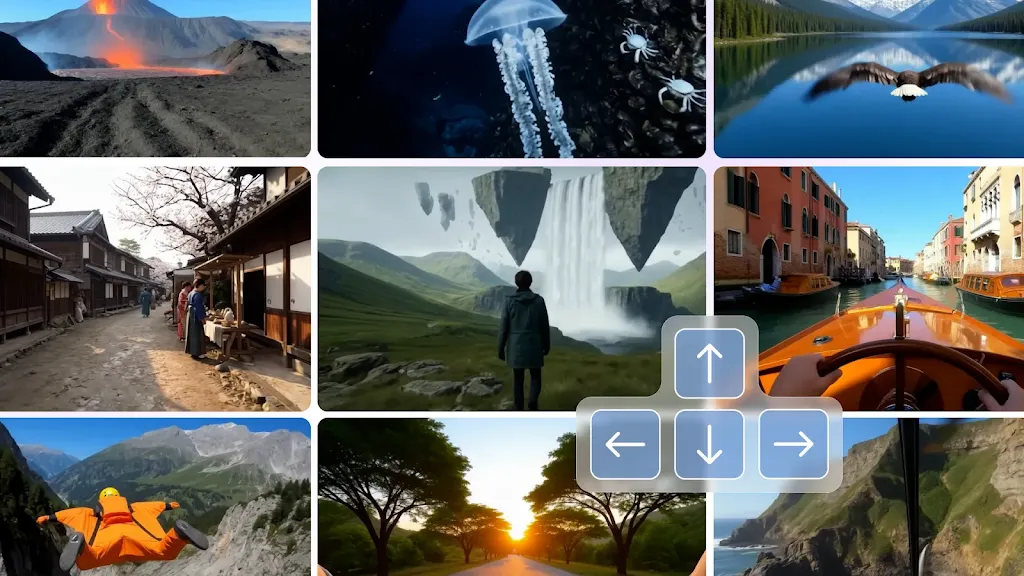

- Scènes jouables à partir d’invites : Transformer du texte ou des esquisses en petits environnements que vous pouvez contrôler. Dans les anciens matériaux Genie, je pouvais passer d’une feuille de sprites brute à un simple platformer en quelques minutes. Dans les démos Genie 3, la même idée s’affiche avec une meilleure stabilité et des séquences plus longues. Les arcs de saut semblent reproductibles. Les collisions semblent moins molles.

- Persistance des règles dans le temps : C’est la victoire tranquille. En génération vidéo, les clips plus longs dérivent souvent, les objets se morphent, l’éclairage bégaie, les mises en page rampent. Dans les modèles du monde de type Genie, la « physique » et les identités des objets restent. J’ai vu moins de ruptures de continuité dans les clips Genie 3 par rapport aux versions antérieures.

- États de démarrage modifiables : Certaines démos montrent l’ensemencement du monde à partir d’une image ou d’une mise en page, puis la lecture à partir de là. Cela compte plus qu’il n’y paraît. Cela signifie que je peux esquisser dans mon outil de choix, puis passer à un test jouable sans reconstruire les actifs.

- Déroulements conditionnels à l’action : Le modèle répond aux entrées avec des résultats cohérents. Appuyez à gauche : vous vous déplacez à gauche. Appuyez vers le haut près d’une corniche : vous la saisissez. Cela semble basique, mais c’est la différence entre un jouet et un banc d’essai.

- Visuels stylisés mais lisibles : Le look se situe quelque part entre l’art des jeux rétro et la vidéo picturale. Ce n’est pas photoréaliste, ce qui est une caractéristique pour de nombreux flux de travail. Vous obtenez de la clarté sans les bords troublants.

- Horizons plus longs, toujours limités : J’ai remarqué des déroulements qui semblent durer des dizaines de secondes avec des règles stables. Mais ce ne sont pas des bacs à sable open-world. Les espaces sont compacts à dessein, ce qui, franchement, est acceptable pour la plupart des prototypes.

Où ça a un peu grinçé :

- Latence et vitesse d’itération : Dans les expériences antérieures, j’ai souvent attendu plus longtemps que je le voulais qu’un nouveau « monde » se stabilise. Si Genie 3 est plus lourd, je m’attends à des attentes similaires. C’est acceptable si les résultats sont réutilisables, moins acceptable si vous explorez.

- Contrôle sur les contraintes : Les concepteurs veulent des curseurs : force de la gravité, friction, tolérance de collision. Les démos montrent rarement des boutons explicites. Si le contrôle existe, c’est probablement caché dans les invites ou les paramètres cachés. Je voudrais des curseurs visibles.

- Remise des actifs : Même quand une scène semble juste, l’exporter dans un pipeline de production n’est pas banal. Extraction de sprites, hitboxes, machines d’état, ce sont des tâches de colle. Je n’ai pas encore vu de chemins clairs dans les matériaux publics.

Une petite joie de mes tests avec les artefacts Genie antérieurs : la charge mentale a baissé. Je ne cherchais pas le « bon » plug-in pour simuler la physique dans une maquette. J’ai tapé, généré et poussé un personnage autour. Cela ne m’a pas d’abord rendue plus rapide, mais cela m’a rendue moins tendue. Cela a compté plus que je ne l’aurais prévu.

État d’accès actuel

Début février 2026, Genie 3 reste dans le domaine de la recherche. Il y a des articles, des conférences et des vidéos de démonstration. Je n’ai pas vu une API large et publique sur laquelle vous pouvez vous connecter avec un compte Google, et je n’ai pas de version grand public dans aucun outil Workspace. Si vous lisez cela plus tard et que cela a changé, tant mieux, envoyez-moi un message et je vais mettre à jour.

Où chercher en ce moment :

- Les articles de recherche officiels de Google DeepMind. Commencez par l’article Genie original et le blog pour l’ancrage, puis feuilletez les discussions de suivi qui mentionnent « Genie 2 » ou « Genie 3 » en tant qu’itérations internes.

- Les enregistrements de conférences et les démos de laboratoire. Ils montrent souvent les déroulements les plus récents des mois avant tout aperçu public.

- Les préimpressions universitaires faisant référence à la « génération vidéo basée sur le modèle du monde » ou à la « génération d’environnement interactif ». La terminologie varie, mais la mécanique s’accorde.

Conclusions pratiques si vous décidez d’attendre, de construire ou d’ignorer

- Si vous prototypez beaucoup d’interactions (produit, jeu, apprentissage), gardez un œil sur Genie. Même un aperçu public limité serait utile pour la prévisualisation et les tests de sensation.

- Si vous avez besoin d’actifs de production aujourd’hui, ne planifiez pas autour de lui. Traitez-le comme un compagnon d’esquisse, pas comme un pipeline.

- Si vous vous souciez de la réplication de la recherche, vous pouvez toujours beaucoup apprendre en jouant avec des projets de modèles du monde ouverts comme des variantes de Dreamer et en lisant les sections de méthode de Genie. Les principes se transfèrent.

Je vais ajouter une petite note légèrement ennuyeuse. Le terme de recherche « Genie 3 Google » tire un mélange de messages Genie plus anciens et de nouvelles nouvelles de modèles du monde. Certaines articles brouillent le marketing et la recherche. En cas de doute, retracez les réclamations jusqu’au blog DeepMind ou aux PDFs d’articles. Cela économise du temps et maintient les attentes stables.