WAN 2.2 LoRA Training Settings: Meilleur Learning Rate, Steps et Trigger Words

Salut mes amis. Vous saviez ? J’ai aimé comment WAN 2.2 gère la peau et l’éclairage, mais mes habitudes usuelles d’entraînement LoRA ne se sont pas traduites proprement. Les visages ressortaient trop brillants, et le modèle gardait l’habitude de tirer les arrière-plans vers le même look de studio doux. Ce n’était pas « faux », juste pas mien. Donc début janvier 2026, j’ai lancé une poignée d’expériences courtes pour trouver les paramètres d’entraînement LoRA spécifiques à WAN 2.2 qui semblaient sensés. Rien de spectaculaire. Juste assez pour réduire la brillance plastique, maintenir un sujet stable, et laisser le modèle de base respirer.

Si vous cherchez un modèle rapide : ce n’est pas ça. Je partage ce qui a tenu au fil de plusieurs exécutions, où j’ai hésité, et comment j’ai ajusté. Le mot clé cible ici est clair, paramètres d’entraînement LoRA WAN 2.2, mais l’objectif est un travail plus calme, pas un nouveau trou du lapin.

Pourquoi WAN LoRA est Différent

J’ai remarqué que WAN 2.2 se comporte comme un très opinioné checkpoint SDXL : il est accordé pour des portraits nets, des gradients lisses et une lumière cinématographique. Quand j’ai entraîné des LoRAs de la façon dont je le fais sur des bases SDXL plus simples, WAN gardait constamment mes résultats vers cette ambiance de studio polie.

Notes de terrain :

- La gravité du prompt est forte. Même des poids légers (0,4–0,6) tirent vers une peau propre et un cadrage symétrique.

- Le clustering de couleur apparaît tôt. Si votre ensemble de données penche vers le chaud, WAN l’amplifie.

- Les arrière-plans s’homogénéisent. Sans ajustements, il revient par défaut à une faible profondeur de champ et un bokeh doux, peu importe ce que vous lui aviez fourni.

Ce qui a changé dans la pratique : j’ai abaissé les taux d’apprentissage, utilisé plus d’images de régularisation que d’habitude, et gardé les captions ennuyeuses exprès. WAN 2.2 récompense la retenue. Quand j’ai essayé d’« enseigner » le style et le sujet en même temps, le surapprentissage s’est glissé rapidement.

Si vous venez d’habitudes LoRA SD 1.5, pensez : moins de tours de passe-passe, plus de lignes de base contrôlées. Si vous êtes habitué à SDXL, allez un peu plus lentement que la normale et intégrez la régularisation plus tôt.

Guide de Taille d’Ensemble de Données

J’ai lancé quatre passages avec des ensembles de portraits curés (5–12 janvier 2026), chacun avec des captions soignées et un éclairage mixte. Voici ce qui a tenu :

- 8–12 images : Suffisant pour ancrer une silhouette de personne spécifique ou de produit. Utilisez une forte régularisation. Gardez les compositions variées.

- 15–30 images : Spot idéal pour l’identité d’un sujet unique avec un léger style. Ajoutez 20–40 % de plans non-portrait si vous voulez que les arrière-plans se généralisent.

- 40–80 images : Utile quand vous encodez un look de marque cohérent ou une ligne d’objets multi-angle. Vous aurez besoin de captions soignées et de plus d’étapes.

Les choses qui importaient plus que le nombre brut :

- La diversité des poses par rapport à la diversité des lieux. WAN généralise bien les lieux : il lutte quand chaque plan est du même angle.

- L’équilibre d’exposition. Si la moitié de votre ensemble est sous-exposée, WAN assombrit tout par la suite. J’ai standardisé les histogrammes avant l’entraînement.

- La simplicité des captions. Descriptive, pas poétique. « subject_token, veste en jean, lumière de fenêtre, gros plan moyen » bat « portrait candide mélancolique près d’une fenêtre pluvieuse ».

Pour les LoRAs d’identité, je me suis posé sur 12–20 images comme un sol fiable. Pour les LoRAs de style, 30–50 m’ont donné de la place pour respirer sans s’effondrer vers la brillance de portrait par défaut de WAN.

Ligne de Base LR/Étapes

Les paramètres d’entraînement LoRA WAN 2.2 qui semblaient stables pour moi (Kohya-ss et base SDXL) :

- Rank (dim) : 16–32. Je fais défaut à 16 pour l’identité, 32 pour le style.

- Alpha : correspondre à dim (p. ex., 16/16). L’alpha inférieur rendait les résultats fragiles.

- Optimizer : AdamW avec weight_decay 0.01.

- Taux d’apprentissage : 5e-5 pour l’identité, 7e-5 à 1e-4 pour le style. WAN punit les LR élevés avec une peau plastiquée et des pics de perte.

- Scheduler : cosine avec warmup. Warmup 5 % du total des étapes.

- Taille de batch : 2–4 (A100/4090). Accumulation de gradient pour simuler 8 si nécessaire.

- Résolution : SDXL natif 1024 sur le long côté avec bucketing (p. ex., 1024×768, 1024×1024). Ne redimensionnez pas : vous ne feriez que mémoriser du bruit.

- Epochs/steps : j’arrête par étapes, pas par epochs.

- 12–20 images : 1 200–2 000 étapes

- 30–50 images : 2 000–3 500 étapes

- 60–80 images : 3 500–5 000 étapes

Vérifications de bon sens que j’ai utilisées :

- Enregistrez tous les 200–400 pas et prévisualisez avec un prompt fixe + seed.

- Si les échantillons s’affûtent trop rapidement avant l’étape 600, LR est élevé.

- Si l’identité ne se verrouille pas vers ~1 400 étapes sur un ensemble de 20 images, les captions ou la régularisation sont plus décalées que LR.

Ces chiffres ne remporteront pas un classement, mais ils résistent à la tendance de WAN à tout polir.

Stratégie de Mot Déclencheur

J’ai gardé les déclencheurs minimalistes. WAN a déjà un antérieur fort : empiler les tokens mignons ajoute juste du bruit.

Ce que j’ai fait :

- Un token d’instance + un token de classe. Exemple : « sora_person » comme instance, « person » ou « woman/man » comme classe dans les captions.

- Mettez le token d’instance au début de chaque caption. Gardez-le en minuscules, un mot si vous pouvez.

- Évitez les tokens de style dans le même LoRA sauf si vous voulez vraiment un LoRA de style. Mélanger l’identité et le style dans WAN 2.2 est devenu boueux rapidement.

Dans les prompts, j’appelle uniquement la LoRA et le token d’instance, puis je mets en couches une direction douce :

- lora : name à 0.5–0.8

- token d’instance au début du prompt

- mots de style tard et légers (« lumière naturelle, couleur propre, retouche minimale »)

J’ai essayé les déclencheurs inventés « style WAN » par curiosité. Ils n’ont pas aidé. La base fait déjà cette partie, la LoRA devrait creuser ce dont vous avez besoin, pas re-annoncer ce que WAN 2.2 est bon à faire.

Images de Régularisation

C’était le héros silencieux. J’ai utilisé 1–3x images de régularisation par image d’entraînement, appariées en classe aux captions.

- Pour les LoRAs d’identité : 20–60 images reg étiquetées comme la même classe (« person »). Je les ai générées à partir de WAN 2.2 lui-même avec des prompts simples : « photo d’une personne, arrière-plan neutre, gros plan moyen, lumière naturelle ».

- Pour les LoRAs d’objets : images reg par classe de produit (« chaussure », « bouteille », « chaise »). Gardez-les précis : ne mélangez pas les classes.

Pourquoi cela importait : WAN 2.2 aime imprimer son esthétique de portrait sur tout. Les images reg lui ont donné la permission de garder la plage de la base tout en laissant la LoRA tenir l’identité. Sans elles, mes LoRAs over-accentuaient le lissage de peau et le bokeh, puis refusaient de partir.

Les paramètres qui semblaient justes :

Les paramètres qui semblaient justes :

- Gardez les images reg visuellement banales et bien exposées.

- Ne légendez pas les images reg avec les tokens d’instance : seulement la classe.

- Mélangez 10–20 % des batches d’entraînement avec des images reg tout au long (pas seulement au départ).

Si vous êtes à court de temps, ajoutez des images reg avant de modifier l’optimiseur. C’est le plus gros levier ici.

Détection du Surapprentissage

Je n’ai pas compté uniquement sur la perte. WAN cache le surapprentissage derrière des échantillons jolis. Voici ce qui m’a mis en alerte :

- L’inertie du prompt : changer le prompt change à peine la sortie. Tout dérives vers la même lentille et le même arrière-plan.

- La plasticité de la peau : les pores disparaissent uniformément, surtout autour des joues et des fronts, même avec des prompts d’éclairage granuleux.

- L’écho de pose : angles épaule/cou répétés à travers des seeds variées.

- Le verrouillage de couleur : une teinte chaude qui s’accroche à travers différents signaux de balance des blancs.

Les vérifications rapides que j’ai lancées tous les 200–400 pas :

- Prompt adversarial : passer à « lumière de bureau aérienne dure, fluorescente, peu flatteuse » et voir si la texture revient.

- Retournement d’arrière-plan : forcer « rue animée, étagères encombrées » pour tester la flexibilité de composition.

- Pression de prompt négatif : ajouter « peau surpolie, texture plastique, retouche lourde » et voir s’il écoute.

Si deux de ces tests échouaient d’affilée, je revenais au checkpoint précédent et soit j’ajoutais plus d’images reg, soit je baissais LR d’un cran.

Corriger les Effondrements

J’ai frappé deux genres d’effondrement : fusion d’identité et verrouillage de style.

Quand l’identité a fondu (les visages ont dévié, les yeux se sont mal alignés) :

- Abaissez LR d’un cran (p. ex., 7e-5 → 5e-5).

- Augmentez le rang de 16 à 32 seulement si l’ensemble de données a suffisamment d’angles : sinon il mémorise les poses, pas l’identité.

- Serrez les captions : supprimez les adjectifs, gardez les indices de longueur focale, gardez le token d’instance en premier.

- Ajoutez 10–20 images reg supplémentaires de la même classe.

Quand le style s’est verrouillé (tout ressemblait au portrait de studio par défaut de WAN) :

- Ajoutez des plans non-portrait à l’ensemble de données (environnemental, mains, corps partiel).

- Augmentez les étapes de 400–800 avec un horaire cosine : ne montez pas en flèche LR.

- Réduisez le poids LoRA à l’inférence (0.8 → 0.5) et abaissez légèrement les conseils (CFG 5–6 → 3.5–4.5). WAN répond bien à un CFG inférieur.

- Si vous utilisez le décalage de bruit ou un aug de couleur lourd, baissez-les. WAN stabilise déjà la couleur : l’aug supplémentaire rendait mes sorties boueuses.

Les autres boutons qui ont aidé :

- Écrêtage de gradient à 1.0 pour éviter les pics soudains.

- EMA désactivé pour les petites exécutions : avec les petits ensembles de données, EMA rendait l’identité en retard par rapport aux aperçus.

- Discipline de seed : prévisualisez avec un seed fixe chaque fois. Les petits changements sont plus faciles à juger quand tout le reste est immobile.

Export et Réutilisation

Quelques habitudes m’ont fait gagner du temps plus tard :

- Enregistrez les checkpoints incrémentiels avec des noms clairs : modèle, rang, LR, étapes et date. Exemple : wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors.

- Gardez le prompt d’entraînement, le prompt de validation et le seed dans les métadonnées LoRA si votre outil le supporte. Le moi futur remercie toujours le moi passé.

- Utilisation version-sticky : les LoRAs entraînées sur WAN 2.2 fonctionnaient mieux sur WAN 2.2 et les frères proches. Elles étaient utilisables sur d’autres bases SDXL, mais la couleur et la gestion de la peau ont changé. Je les traite comme « WAN-first ».

- Les défauts d’inférence qui semblaient bons :

- Poids LoRA 0.5–0.8 (identité), 0.3–0.6 (superposition de style)

- CFG 3.5–5.5

- 30–40 étapes avec un échantillonneur stable (DPM++ 2M Karras fonctionnait bien)

- Gardez les prompts courts : WAN entend les nudges subtiles

Si vous voulez fusionner des LoRAs : j’ai eu plus de chance d’empiler les petites LoRAs à usage unique (identité à 0.6 + léger look de couleur à 0.3) qu’en entraînant une grosse LoRA « tout ». WAN respecte la modularité.

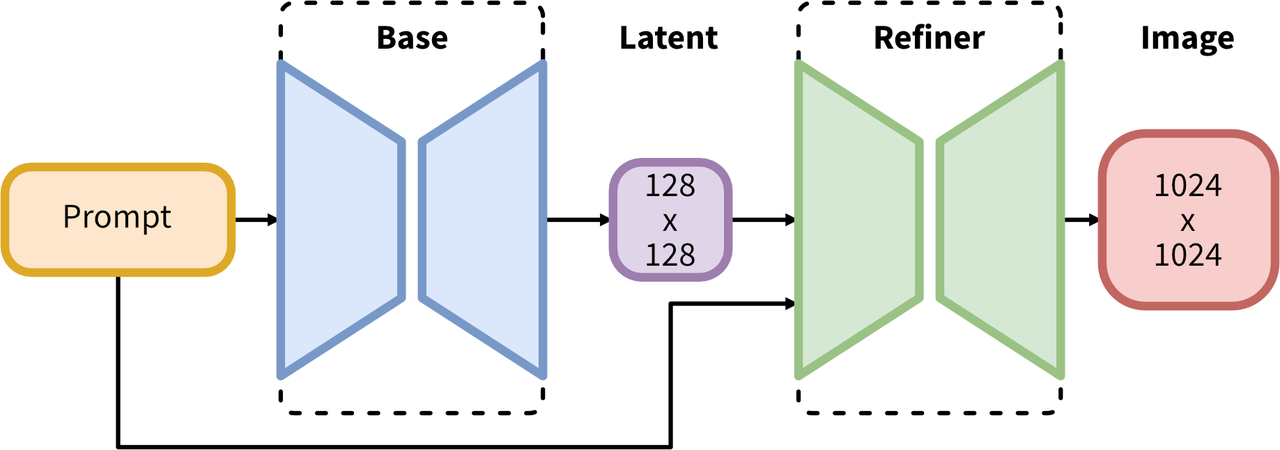

Pour des workflows WAN 2.2 plus détaillés et des exemples, consultez la documentation ComfyUI officielle.

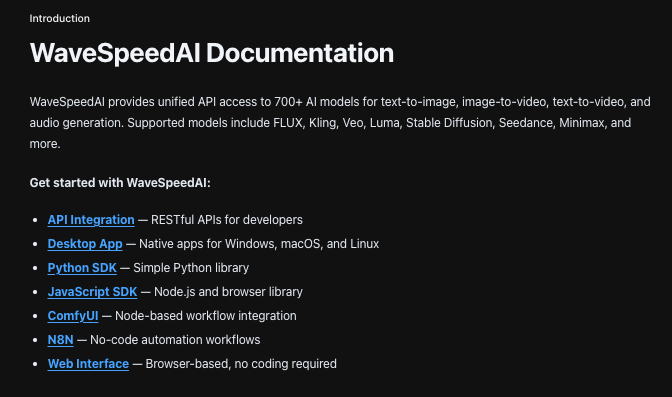

Pour l’entraînement, je préfère toujours exécuter les choses localement où je peux voir chaque bouton. Mais en ce qui concerne l’inférence, le routage des modèles ou le passage entre les modèles de base sans jongler avec les API, vous pouvez essayer notre WaveSpeed. Il garde les différents modèles derrière un point final cohérent pour que je puisse me concentrer sur les prompts et les sorties au lieu de l’infrastructure.

Pour l’entraînement, je préfère toujours exécuter les choses localement où je peux voir chaque bouton. Mais en ce qui concerne l’inférence, le routage des modèles ou le passage entre les modèles de base sans jongler avec les API, vous pouvez essayer notre WaveSpeed. Il garde les différents modèles derrière un point final cohérent pour que je puisse me concentrer sur les prompts et les sorties au lieu de l’infrastructure.