Exigences en VRAM pour LTX-2 : Vérité sur 12 Go vs 24 Go (Testé en 4K@50fps)

Salut, je suis le gars qui a personnifié la VRAM de son GPU en tant que propriétaire grognon qui me jette dehors dès que je donne une fête un peu ambitieuse. Enchanté—je suis ici pour partager les cicatrices de bataille d’une semaine de guerre OOM en janvier 2026.

La première fois que LTX-2 a crashé sur moi, ce n’était pas dramatique. Juste une petite boîte “out of memory” et le genre de soupir que tu réserves à un bogue d’imprimante. Je ne poussais rien de fou, un petit clip, une invite basique, mais les maths de la VRAM ne se soucient pas des intentions. Le propriétaire grognon n’était pas d’accord. … fais-moi confiance.

Au cours de la semaine dernière (janvier 2026), j’ai pris des notes en exécutant LTX-2 sur une GPU laptop 12GB, une carte de bureau 16GB, et une machine empruntée de 24GB. Rien de scientifique. Juste des exécutions, des redémarrages, et une simple question : jusqu’où je peux aller avant que la VRAM ne me tape sur l’épaule ? C’est ce qui compte régulièrement.

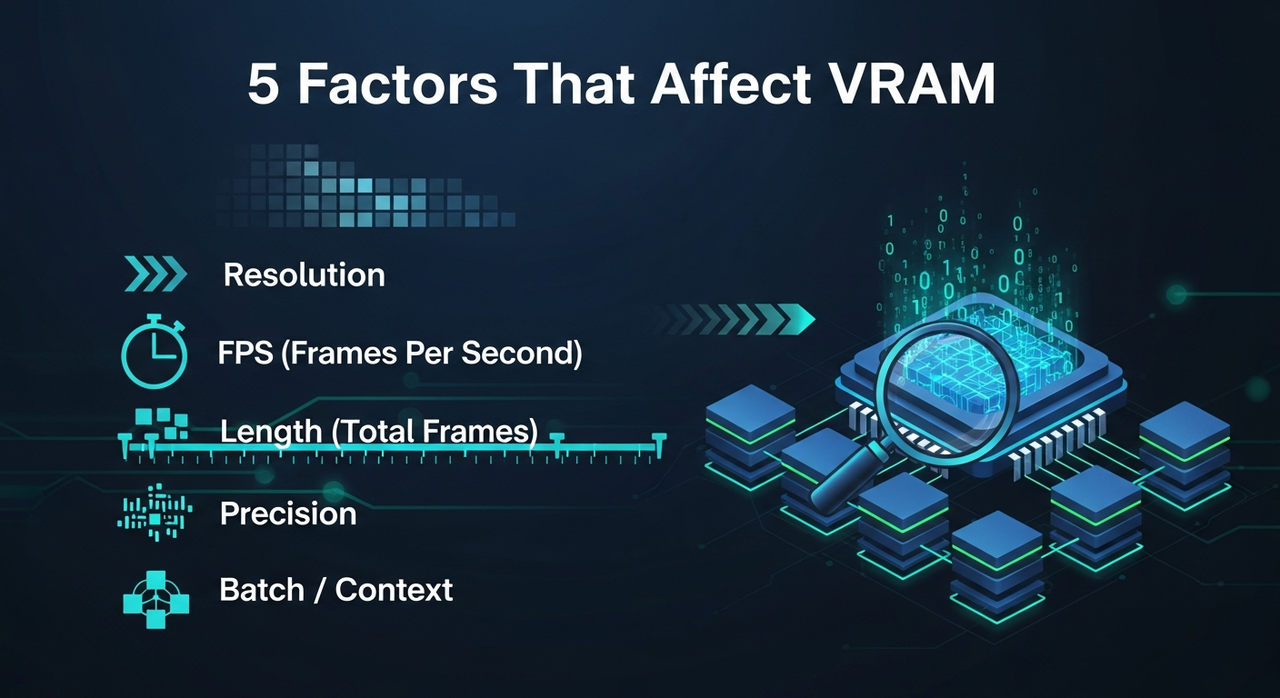

5 facteurs qui affectent la VRAM (résolution / fps / longueur / précision / batch)

Voici la courte liste que j’ai ressentie dans la pratique, pas juste la documentation.

Voici la courte liste que j’ai ressentie dans la pratique, pas juste la documentation.

1. Résolution

Doubler la largeur et la hauteur multiplie à peu près les pixels par quatre. Les modèles comme LTX-2 le ressentent immédiatement. 720p à 1080p est l’étape qui fait souvent basculer une exécution de correcte à fragile. 4K sans astuces ? C’est là que la maison de cartes vacille.

2. FPS

Plus de images par seconde signifie plus de images retenues ou préparées en mémoire pendant certaines étapes. Si tu es près de la limite, passer de 25 à 16 fps est un petit changement qui libère une quantité surprenante de VRAM et de marge de manœuvre pour la cohérence. Laisse-moi te dire, ça a sauvé plus de passages que je ne peux les compter.

3. Longueur (nombre total de images)

La longueur s’étire sur tout. Certains pipelines fragmentent les images, d’autres essaient de maintenir des pools de contexte plus grands. De toute façon, 4–6 secondes est généralement décontracté, 10–12 secondes devient serré, 20 secondes c’est où je commence à planifier, pas à espérer.

4. Précision

fp16 est le point doux par défaut pour moi. bf16 était similaire sur la boîte 24GB, mais fp32 a augmenté l’utilisation et semblait inutile pour la génération. Si tu vois un chemin 8-bit ou quantifié qui est stable, ça vaut la peine d’essayer sur une VRAM basse, mais je l’ai traité comme expérimental.

5. Batch / contexte

N’importe quelle forme de batching, d’échantillonnage multi-seed, ou de contexte temporel long agit comme un multiplicateur. Quand j’oublie de réinitialiser le batch à 1, je l’ai payé instantanément.

Petite note : Activez l’attention efficace/backends si votre compilation les supporte. J’ai vu des gains modestes de l’attention économe en mémoire et des I/O verrouillées par page : pas révolutionnaire, mais suffisant pour empêcher une exécution de basculer.

Configurations du monde réel : GPU 12GB / 16GB / 24GB

Ce sont les configurations que j’ai pu répéter sans surveillance. Les tiennes varieront selon le pilote, la compilation, et tout ce que ton système fait d’autre.

12GB (laptop classe 3060)

- Stable : 576p–720p, 5–8 secondes, 16–24 fps, fp16, batch=1.

- Marginal : 1080p sous 4–6 secondes à 12–16 fps avec des paramètres conservateurs.

- Notes : Les pics de VRAM pendant les premières étapes étaient le point d’échec habituel. Garder les aperçus désactivés et fermer les autres applications GPU a aidé.

16GB (desktop classe 4080)

- Stable : 1080p, 6–10 secondes, 16–24 fps, fp16.

- Marginal : 1080p à 12–15 secondes si je diminuais les fps ou utilisais la segmentation.

- Notes : C’est le premier niveau où “ça marche tout seul” commence à s’appliquer pour 1080p. J’ai toujours évité le batching.

24GB (classe 4090)

- Stable : 1080p, 12–20 secondes, 24 fps, fp16, place pour des ajustements de guidance doux.

- Marginal : 4K via tiling ou passes segmentées : correct pour les clips courts, mais tu sens la surcharge.

- Notes : Si tu veux de la marge pour les expériences (masques, éditions, invites plus longues), 24GB semblait calme. Pas excessif, juste calme.

4K@50fps : est-ce réalisable et à quel prix ?

Réponse courte : oui, mais pas comme je l’espérais.

Le 4K direct à 50 fps à partir de LTX-2 est où la VRAM et le temps protestent tous les deux. Sur 24GB, j’ai seulement obtenu des courtes rafales pour tourner, et même là, j’ai vu la qualité vaciller et le risque OOM dès que je nudge la longueur.

Ce qui a mieux fonctionné

- Générez à 1080p, 12–16 fps, gardez-le propre.

- Upscalez à 4K avec un upscaler dédié (variantes de type Topaz ou ESRGAN si tu vis du côté ouvert).

- Interpolez les images à 50 fps avec des outils de style RIFE/Flowframes.

Les compromis que j’ai remarqués

- La cohérence temporelle s’est mieux maintenue quand j’ai d’abord upscalé, puis interpolé.

- L’interpolation peut ajouter une sensation de feuilleton doux. Baissez-le ou ajoutez un tout petit peu de grain après.

- Les clips “4K natif” qui ont tourné ne semblaient pas meilleurs que 1080p → upscale pour mon utilisation. Ils ont juste pris plus de temps et crashé plus.

Donc : réalisable, oui. Ça en vaut la peine localement, généralement non, à moins que ton clip soit inférieur à ~5 secondes ou que tu aies vraiment besoin de pureté single-pass.

Stratégies pour VRAM basse (tile / segment / fps inférieur)

Ce sont ceux auxquels j’ai continué à revenir.

- Carrelez intelligemment : Si le pipeline supporte la diffusion/attention en carreaux, utilisez-le. Chevauchement un peu pour cacher les coutures. Ça ajoute du temps, économise de la VRAM, et te met en territoire 4K sur 16–24GB.

- Segmentez par temps : Rendez 3–4 secondes de morceaux, puis cousez-les. C’est pénible, oui, mais ça dompte les pics de VRAM et te permet de re-rouler les segments problématiques.

- Baissez d’abord les fps, pas la résolution : Passer de 24 à 16 fps a souvent préservé l’apparence et libéré de la mémoire. Les spectateurs remarquent les baisses de résolution plus vite que les baisses de images à courtes durées.

- Gardez batch=1 : Les exécutions multi-seed sont sympas : elles doublent aussi tes problèmes.

- Désactivez les aperçus : Les aperçus en direct maintiennent parfois des tampons supplémentaires. Les exécutions sans tête étaient plus stables pour moi.

- Précision mixte activée, précision exotique désactivée : fp16 a maintenu l’équilibre. J’ai traité les chemins 8-bit comme un dernier recours.

- Déchargez quand c’est possible : Si votre pile supporte le déchargement du CPU ou du disque pour les caches KV, cela peut vous acheter quelques secondes supplémentaires au détriment de la vitesse.

Flux de dépannage OOM

Mon réinitialisation rapide quand le propriétaire me jette dehors :

- Redémarrez le processus pour effacer les résidus de VRAM. Ne faites pas confiance aux libérations partielles.

- Définissez batch=1, désactivez les aperçus, fermez les autres applications GPU.

- Baissez les fps à 16. Si cela échoue toujours, diminuez la résolution d’un cran (1080p → 900p ou 720p).

- Raccourcissez la longueur de 2–3 secondes. Testez à nouveau.

- Activez le rendu en carreaux/segmenté si disponible.

- Assurez-vous que fp16 est activé. Évitez bf16/fp32 sauf si vous savez que vous en avez besoin.

- Si cela continue d’échouer au démarrage, votre pic est trop élevé (résolution/contexte). S’il échoue tard, c’est probablement la croissance de la longueur/contexte.

- Dernier recours : basculez vers une GPU cloud avec plus de VRAM, terminez le rendu, puis revenez local.

Recommandations de niveau GPU

Si tu décides quoi acheter ou emprunter :

- 12GB : Correct pour les brouillons, 576p–720p, l’idéation rapide, et les coupes sociales courtes. Tu devras segmenter beaucoup.

- 16GB : Bon chauffeur quotidien pour le travail 1080p sous ~10 secondes. Moins de hacks, plus de flux.

- 24GB : Confortable pour les 1080p plus longs, les expériences légères 4K, et essayer les options avancées sans surveillance.

- 24GB+ (ou GPU cloud multi): Utilisez quand les délais importent, ou vous poussez les chronologies 4K avec moins de compromis.

Je n’achèterais pas sur la base d’un seul modèle. LTX-2 évoluera: ta tolérance pour le tiling et les coutures ne le sera pas.

Quand utiliser le cloud (comparaison des coûts WaveSpeed)

Je garde une simple feuille “WaveSpeed”, pas un service, juste un moyen approximatif de comparer les dollars par minute vidéo terminée.

Comment j’estime (janvier 2026)

- Notez la cible de clip (par exemple, 4K@50 fps, 10 secondes).

- Chronométrez une exécution locale propre à 1080p, puis ajoutez mon temps d’upscale/interp.

- Évaluez une GPU cloud comparable à l’heure.

Les taux spot typiques que j’ai vus récemment

(très approximatif : vérifiez votre fournisseur)

- Classe L4/A10G : $0.50–$1.20/hr

- A100 40/80GB : $1.50–$3.50/hr

- H100 : $3–$7/hr

Exemple, mes chiffres de la semaine dernière

- Boîte locale 24GB : un pipeline 4K@50 fps de 10 secondes (génération 1080p → upscale → interpolation) a pris ~14 minutes de bout en bout. L’électricité + l’usure sont difficiles à évaluer, mais je l’appelle $0.10–$0.20/run.

- Cloud A100 80GB : le même pipeline a terminé en ~6–8 minutes. À ~$2.50/hr, c’est environ $0.25–$0.35 par exécution.

Donc ma ligne “WaveSpeed” pour ce cas :

- Local : moins cher par exécution, plus lent, mais zéro mise en file d’attente.

- Cloud : un peu plus par exécution, plus rapide, et moins compliqué quand j’ai un OOM.

Quand je bascule vers le cloud

- Je suis sur un délai et je ne peux pas soigner les correctifs OOM.

- J’ai besoin d’un passage 1080p plus long ou de n’importe quel passage 4K sérieux.

- Je veux explorer les paramètres sans crainte de crash.

Quand je reste local

- Les brouillons courts, les tests de look, et l’exploration des invites.

- Je suis d’accord avec 720p/1080p et 6–10 secondes.

Ça a marché pour moi, tes coûts et tes délais seront différents. Si tu heurtes les mêmes murs que moi, ça vaut le coup de jeter un œil.

Si tu atteins les limites de VRAM ou si tu ne veux simplement pas surveiller les correctifs OOM, WaveSpeed te permet d’exécuter LTX-2 sur des GPU cloud plus grands sans changer ton flux de travail. Tu gardes tes invites et tes paramètres — le matériel cesse juste d’être le goulot d’étranglement.

La surprise silencieuse : une fois que j’ai évalué les exécutions de cette façon, j’ai arrêté de chasser le “4K@50 natif” localement. J’ai juste obtenu l’apparence correcte à 1080p et j’ai laissé le pipeline faire le levage.

La surprise silencieuse : une fois que j’ai évalué les exécutions de cette façon, j’ai arrêté de chasser le “4K@50 natif” localement. J’ai juste obtenu l’apparence correcte à 1080p et j’ai laissé le pipeline faire le levage.

Et toi, alors ? Quel est le crash OOM le plus ridicule que tu as survécu avec LTX-2 ? Laisse tes histoires de guerre (ou tes tours de victoire) ci-dessous—je lis chaque commentaire et j’aime échanger des astuces.