Démarrage rapide LTX-2 ComfyUI : Votre première vidéo en 10 minutes (support natif Day-0)

Bonjour, je m’appelle Dora. Je n’avais pas prévu d’essayer LTX-2 dans ComfyUI le week-end dernier. J’ai juste rencontré un petit problème sur un plan client : j’avais besoin de deux courtes séquences avec le même style, et mes outils habituels dérivaient constamment. J’ai vu une note sur le « support jour-0 ltx-2 comfyui », j’ai pris une pause, et j’y ai consacré une soirée. J’ai testé entre le 6 et le 8 janvier 2026, sur mon poste de travail principal et sur un ordinateur portable de voyage.

Ce qui suit n’est pas une critique, juste ce que cela ressent réellement de faire fonctionner LTX-2 à l’intérieur de ComfyUI, où cela m’a aidée, où cela m’a posé problème, et les paramètres que je réutiliserais si je devais recommencer demain.

Qu’est-ce que le support natif jour-0 (version du 5-6 janvier 2026)

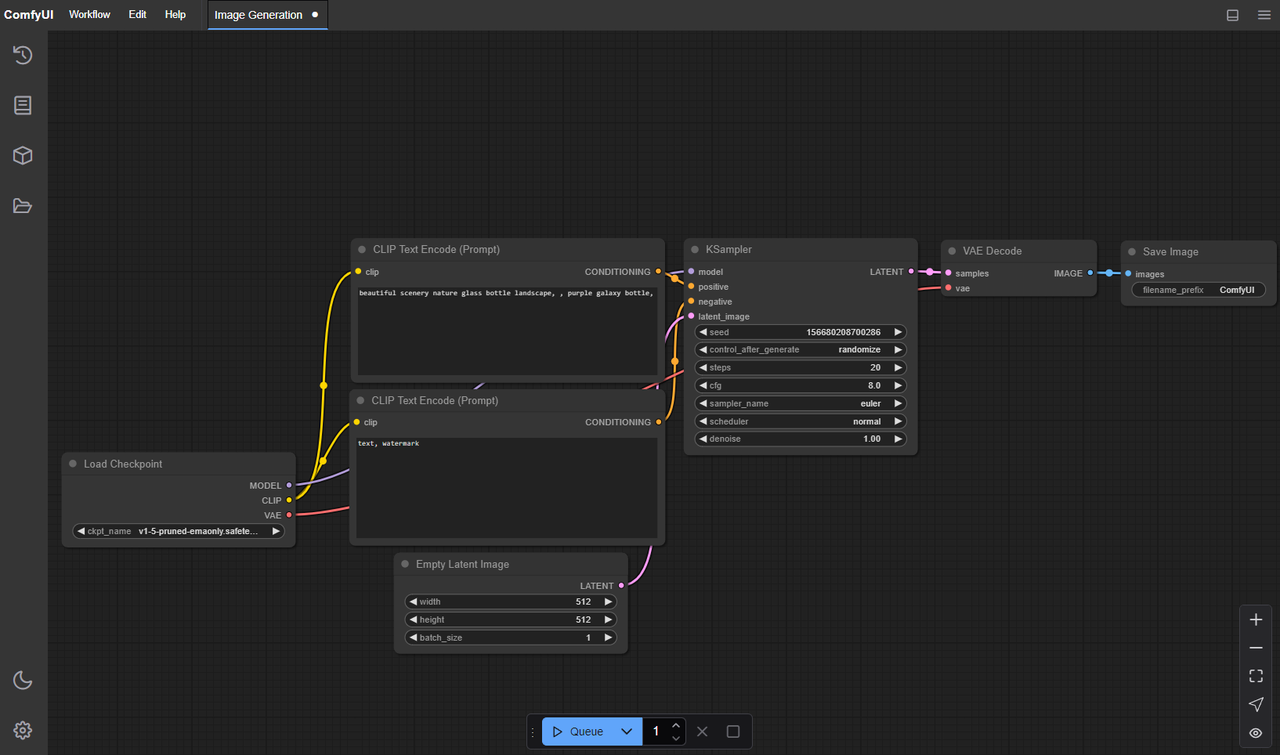

Le support jour-0 ici signifie que LTX-2 est livré avec des nœuds et un flux de travail de référence qui fonctionnent à l’intérieur de ComfyUI la même semaine où le modèle arrive. Pas de scripts de contournement, pas de forks mystérieux. J’ai récupéré les modifications le 6 janvier et j’ai constaté :

- Des nœuds intégrés étiquetés pour LTX-2 (chargeur, échantillonneur et un simple chemin d’aperçu).

- Un flux de travail exemple qui fonctionne réellement d’un bout à l’autre sans câblage manuel. Pas beau, mais fonctionnel.

- Des crochets de téléchargement de modèle qui pointent vers les poids officiels. Je devais toujours les placer dans mon répertoire de modèles, mais au moins les liens correspondaient à la documentation.

Je ne m’attendais pas à la magie, et ce n’en est pas. La première passe m’a semblé un peu sommaire : présets limités, quelques erreurs cryptiques. Mais c’était assez stable pour afficher des clips de 4 à 6 secondes, et la cohérence des couleurs entre les passages était meilleure que d’habitude. Pour une sortie ComfyUI jour-0, c’est rare.

Si la reproductibilité vous importe : les graines ont fonctionné, et j’ai pu ajuster la force du mouvement sans que la scène ne s’effondre. C’était la petite surprise qui m’a gardée en exploration.

Exigences minimales (GPU / VRAM / version ComfyUI)

Ceci provient de mes propres machines. Votre configuration peut différer.

- ComfyUI : un pull récent au 6 janvier 2026. Les anciens forks m’ont donné des erreurs d’importation de nœuds. Si vous conservez un environnement de longue durée, envisagez un venv propre juste pour LTX-2. Suivez la documentation officielle de ComfyUI.

- GPU/VRAM :

- 12 GB VRAM : viable à 512×288 à 512×320, clips de 4-5 s, mouvement conservateur.

- 16 GB VRAM : 512×512 à 4-6 s semblait confortable. OOM occasionnel avec mouvement agressif ou nombreuses étapes.

- 24 GB+ VRAM : 768×432 à 768×768 à 5-8 s fonctionnait en douceur. Bonne marge pour un CFG plus élevé.

- CPU/RAM : rien d’inhabituel. J’ai utilisé 32 GB de RAM système : l’utilisation est restée modeste.

- Pilotes/Runtime : CUDA 12.x, build PyTorch correspondant à votre CUDA. xformers a aidé sur la carte 12 GB mais n’était pas obligatoire sur 24 GB.

Si vous êtes sur un GPU portable 8 GB, je skipperais le local pour l’instant et utiliserais un runner cloud.

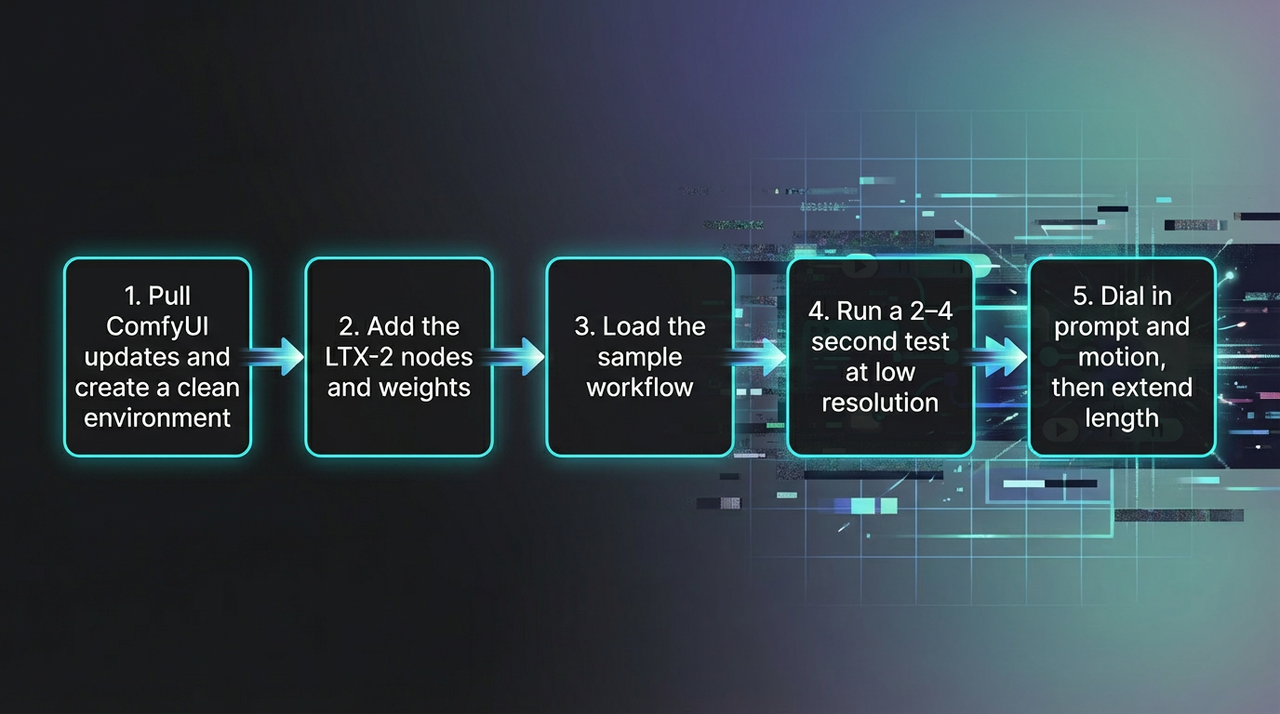

Flux de travail de la première exécution en 5 étapes

Voici le chemin exact que j’ai suivi le 6 janvier. Sans artifices supplémentaires.

Voici le chemin exact que j’ai suivi le 6 janvier. Sans artifices supplémentaires.

-

Récupérez les mises à jour ComfyUI et créez un environnement propre J’ai cloné un dossier ComfyUI frais à partir de GitHub et installé les exigences à partir du fichier inclus. Mélanger les anciens nœuds avec les nouveaux modèles vidéo cause généralement d’étranges défaillances silencieuses. Propre m’a économisé une heure.

-

Ajoutez les nœuds LTX-2 et les poids J’ai utilisé les nœuds LTX-2 fournis qui ont été fournis avec la mise à jour du 5-6 janvier. Pour les poids, j’ai suivi les liens dans l’info-bulle du nœud et placé les fichiers sous

models/ltx(le chemin suggéré). Si votre nœud ne trouve pas les poids, il vous le dira, vérifiez juste les noms de fichiers exacts. -

Chargez le flux de travail exemple L’exemple fourni m’a donné une ligne de base fonctionnelle : invite de texte en entrée, aperçu vidéo en sortie. J’ai changé seulement trois choses : graine, résolution et force du mouvement. Commencer simple a gardé les erreurs évidentes.

-

Exécutez un test de 2-4 secondes à basse résolution Mon premier passage était 512×320, 4 secondes, 16 images, étapes d’échantillonneur à 20. Cela a pris ~50-70 secondes sur une 4090 24 GB, ~2-3 minutes sur une 3060 12 GB. L’objectif n’était pas la vitesse : c’était de vérifier le pipeline.

-

Affinez l’invite et le mouvement, puis prolongez la longueur Une fois que j’ai aimé l’apparence de base, j’ai ajusté CFG et la force du mouvement, puis poussé à 6-8 secondes. Si la scène s’effondrait, je revenais en arrière : réduire le mouvement, verrouiller la graine et garder la même résolution.

Petite note : J’ai sauvegardé chaque test avec graine et paramètres dans le nom du fichier. Quand les clips commencent à se brouiller à 1 h du matin, ce fil d’Ariane est un cadeau.

Paramètres recommandés (résolution / fps / longueur par défaut)

Ce sont des points de départ qui se sont bien comportés pour moi. Ajustez à votre goût.

-

Résolution

- 512×320 ou 512×512 pour les premiers aperçus. Stable, assez rapide, facile sur VRAM.

- 768×432 quand vous voulez plus de détails sans vous engager dans le carré.

-

FPS

- 12-16 fps pour les passages de concept. Vous verrez les arcs de mouvement sans temps de rendu important.

- 24 fps uniquement quand vous êtes sûr de l’apparence : cela augmente le temps et la mémoire.

-

Longueur

- 4-6 secondes est le sweet spot pour l’itération. Passé 8 secondes, le modèle commence à dériver à moins que votre invite ne soit très ancrée.

-

CFG / Étapes

- Commencez CFG à 3-5. Une valeur plus élevée ajoute du contraste mais peut verrouiller excessivement la scène.

- Les étapes à 18-24 étaient suffisantes dans la plupart des cas. Je n’ai pas vu de gros gains au-delà de 28.

-

Mouvement

- Gardez-le conservateur au départ. Si vous avez besoin de gros mouvements, montez en petits coups et gardez la graine fixe au fur et à mesure que vous ajustez.

J’ai aussi gardé un préset « paramètres sensés » : 512×512, 16 fps, 6 s, CFG 4, étapes 22, mouvement 0.6. C’est ennuyeux, mais ennuyeux c’est fiable.

3 invites copier-coller qui fonctionnent

Ce ne sont pas des mots magiques, juste des invites qui ont produit des clips réguliers et reproductibles entre le 6 et le 8 janvier. J’inclus une courte note de configuration pour chacun.

-

Macro de produit avec légère parallaxe

- Invite :

"une simple tasse en céramique sur un bureau en bois, douce lumière de fenêtre du matin, faible profondeur de champ, légère parallaxe de gauche à droite, couleurs naturelles, grain minimal" - Notes : Gardez les noms d’objets d’arrière-plan simples. Si vous ajoutez du langage de marque, cela tend à halluciner des logos.

- Invite :

-

Scène de rue avec mouvement retenu

- Invite :

"une rue de ville tranquille au crépuscule, des enseignes au néon se reflétant sur le pavé mouillé, léger crachin, caméra se rapprochant lentement, léger halo de lumière, cinématique mais discret" - Notes : Si vos lumières commencent à clignoter, baissez le mouvement et diminuez CFG de 1.

- Invite :

-

Boucle de texture naturelle

- Invite :

"gros plan sur des ondulations à la surface d'un lac, légère brise, tons de coucher de soleil chaud, caméra verrouillée avec de petits micro-mouvements, légères lumières, ambiance calme" - Notes : Idéal pour les arrière-plans. Le verrouillage de graine la garde proche d’une boucle si vous coupez les queues.

- Invite :

Conseil : Si vous voulez un contrôle de style plus serré, commencez par des mots de ton (« discret, lumière naturelle, composition propre ») avant les objets. Cela semblait mieux ancrer la palette.

Erreurs courantes de première exécution + correctifs rapides

C’étaient mes vrais accrocs et ce qui les a corrigés.

-

CUDA manquant de mémoire au démarrage

- Correctif : diminuez d’abord la résolution, puis les étapes, puis le mouvement. Si vous êtes sur 12 GB, restez à une largeur 512 et gardez les clips sous 6 secondes. Fermez les navigateurs qui mangent VRAM (sérieusement).

-

Nœud non trouvé / classe manquante

- Correctif : mettez à jour ComfyUI vers les commits du 5-6 janvier : supprimez les anciens nœuds personnalisés qui regroupent les chargeurs vidéo hérités, puis relancez. Si l’erreur pointe vers un nom de nœud spécifique, recherchez les doublons dans votre dossier

custom_nodes.

- Correctif : mettez à jour ComfyUI vers les commits du 5-6 janvier : supprimez les anciens nœuds personnalisés qui regroupent les chargeurs vidéo hérités, puis relancez. Si l’erreur pointe vers un nom de nœud spécifique, recherchez les doublons dans votre dossier

-

Fichier de poids non détecté

- Correctif : faites correspondre le nom de fichier exact que le nœud attend. Gardez les chemins ASCII uniquement ; évitez les liens symboliques sous Windows si possible. Relancez ComfyUI après avoir déplacé les fichiers.

-

Décalage Torch / CUDA

- Correctif : assurez-vous que votre build PyTorch correspond à votre kit d’outils CUDA. Si vous ne voulez pas déboguer, utilisez la roue pip suggérée dans le README GitHub ComfyUI

pour votre GPU.

pour votre GPU.

- Correctif : assurez-vous que votre build PyTorch correspond à votre kit d’outils CUDA. Si vous ne voulez pas déboguer, utilisez la roue pip suggérée dans le README GitHub ComfyUI

-

FFmpeg non trouvé pour l’export

- Correctif : installez FFmpeg et ajoutez-le à PATH. En repli rapide, exportez les images et assemblez avec n’importe quel encodeur de confiance.

-

Scintillement ou déviation de style au milieu du clip

- Correctif : réduisez le mouvement, diminuez CFG de 1-2, et gardez les invites propres. La sur-description tend à combattre la cohérence temporelle.

Pro tip : Si rien ne fonctionne et que vous êtes serré par le temps, affichage à 12-16 fps et ralentissez à 24 fps en post-production avec fusion d’images. Ce n’est pas élégant, mais c’est calme dans une tempête.

Ce que j’ai aimé

- Pas de lutte contre les dépendances. J’ai testé une invite en moins de cinq minutes.

- Paramètres raisonnables. La première sortie n’était pas parfaite, mais ce n’était pas du chaos.

Ce qui m’a posé problème

- Moins de contrôle qu’un graphe ComfyUI complet. J’ai regretté de ne pas pouvoir câbler des étapes post-personnalisées.

- Temps de file d’attente. Mon attente la plus longue était ~6 minutes pendant les heures de pointe.

À qui cela convient

- Si vous explorez les apparences et ne voulez pas toucher aux pilotes, c’est facile.

- Si vous avez besoin d’un pipeline reproductible avec les versions et les graines suivies entre les projets, ComfyUI local gagne toujours.

- Si vous avez juste besoin d’exécuter LTX-2 immédiatement sans configuration, WaveSpeed vous permet de rendre dans un navigateur et de vérifier les invites avant de vous engager dans un pipeline local.

Cela a fonctionné pour moi ; les résultats peuvent varier. Si vous voyagez ou sur une GPU 8 GB, cela vaut le coup.

Une petite réflexion pour finir : LTX-2 à l’intérieur de ComfyUI ne m’a pas rendue plus rapide immédiatement. Cela a rendu mes choix plus clairs : moins de boutons qui importaient, plus qui ne l’étaient pas. C’est cela, plus que la vitesse, que je remarque une semaine plus tard.