Comment utiliser DeepSeek V4 : Guide de démarrage rapide du jour 1 pour l'API et le chat

Il y a longtemps que je ne vous ai pas vus ! Mes amis. Je m’appelle Dora. J’ai rencontré un petit problème un mardi matin : je devais transformer un ensemble confus de notes en quelque chose de livrable, et mon modèle habituel se perdait dans des explications joyeuses et vagues. Je voulais des réponses directes, moins de détours. C’est ce qui m’a poussée à essayer DeepSeek V4. Je l’ai testé en janvier 2026 à la fois sur le chat web et l’API. Ce qui suit n’est pas une visite guidée des fonctionnalités. C’est comment je l’ai fait fonctionner, où c’était solide, et où j’hésite encore.

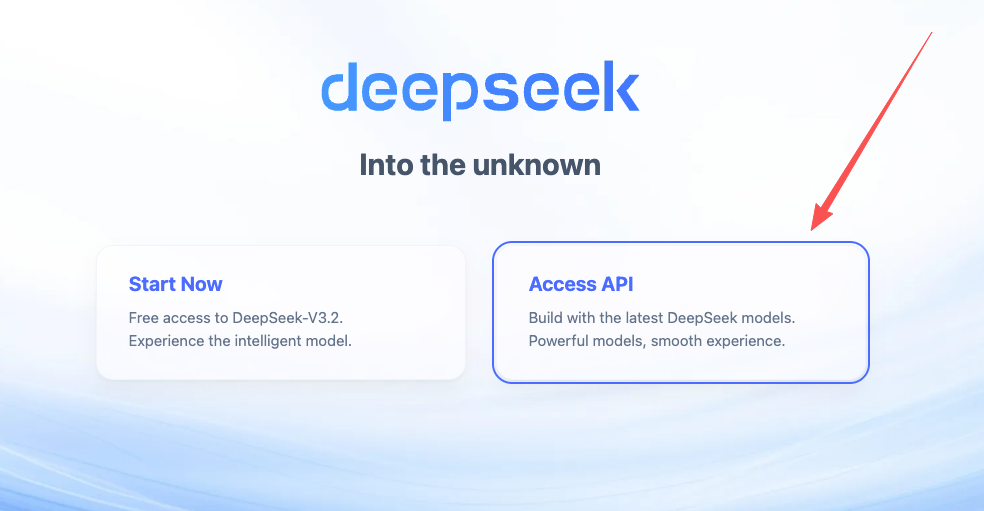

Options d’accès au lancement

J’ai commencé simplement : pas de code, juste le chat web. Puis je suis passée à l’API quand j’ai eu besoin de runs répétables. Si vous préférez d’abord jouer avec les prompts et câbler les choses plus tard, ce chemin est stable et sans friction.

Interface de chat web

Je me suis connectée par le site principal et j’ai choisi V4 dans la liste des modèles. Si vous avez utilisé d’autres interfaces de style chat, cela vous semblera familier : message système en haut, échanges de chat dessous, paramètres rangés ailleurs.

Ce qui a aidé :

- J’ai écrit un court message système qui reflétait ma façon de penser : « Soyez direct. Citez les hypothèses. Si vous devinez, dites-le. » Cela a empêché le modèle de sur-expliquer.

- J’ai gardé la température basse (environ 0.2) pour rédiger des spécifications ou des commentaires de code. Quand je voulais des alternatives pour la formulation ou le nommage, je l’ai augmentée à 0.5.

- J’ai utilisé un petit rituel avant chaque nouveau fil : coller un petit bloc de contexte. Deux lignes. « Projet : nettoyage de documentation interne. Ton : clair, concis, pas de métaphores. » Cela a empêché V4 de s’égarer, et c’était aussi un bon moyen de rester honnête sur ce dont j’avais vraiment besoin.

Frictions :

- Les longs chats deviennent parfois vagues. Réinitialiser le fil et coller un contexte frais réglait cela plus fiablement que d’essayer de le contrôler en cours de route.

- Le copier-coller de formatage était correct, mais je préfère toujours récupérer les résultats via le code avec l’API pour tout ce dont j’ai besoin d’exécuter plus d’une fois.

Si vous n’avez besoin que d’aide occasionnelle, de brouillons plus propres, de refactorisations rapides, d’e-mails plus serrés, l’interface web suffit. Mais si vous voulez de la cohérence entre les tâches (même style, même structure, pas de surprises), l’API est là où ça se stabilise.

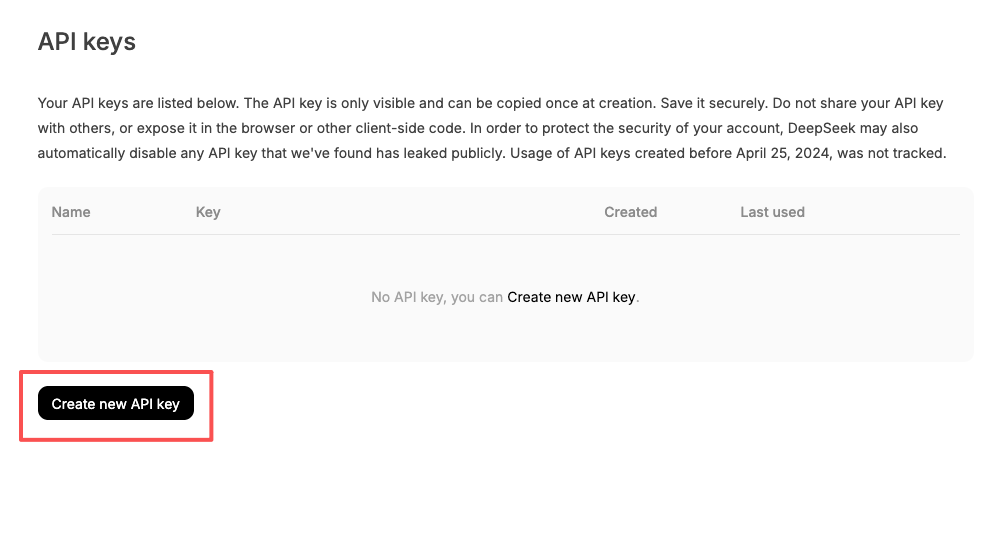

Accès API

J’ai créé une clé API à partir de mon tableau de bord de compte et je l’ai rangée dans mon environnement. Rien de compliqué :

J’ai créé une clé API à partir de mon tableau de bord de compte et je l’ai rangée dans mon environnement. Rien de compliqué :

- macOS/Linux : export DEEPSEEK_API_KEY=”…” dans votre profil shell.

- Windows PowerShell : setx DEEPSEEK_API_KEY ”…” et relancer le terminal.

L’API DeepSeek suit la forme désormais familière de chat-completions. Si vous avez utilisé des clients compatibles avec OpenAI, c’est pratiquement du plug-and-go. La principale chose à surveiller est le nom du modèle, V4 est disponible, mais l’identifiant exact peut changer. J’ai vérifié la chaîne du modèle actuel à partir du tableau de bord avant de faire des appels.

Pour la confidentialité : j’évite d’envoyer des secrets ou des données clients à moins d’avoir confirmé la politique de conservation. Je masque aussi les identifiants et utilise des valeurs factices dans les prompts. Cela prend 30 secondes et évite des maux de tête futurs.

Si vous voulez le point de départ officiel, la porte la plus sûre est le lien docs du site principal : DeepSeek. La zone de compte a généralement les points de terminaison actuels, les noms de modèles et les limites de débit.

Votre premier appel API

J’aime faire une petite requête ennuyeuse d’abord. Cela me dit si l’authentification est câblée, le nom du modèle est valide, et les réponses ressemblent à ce que j’attends. Après cela, je l’intègre dans un script.

Authentification

J’ai utilisé un token Bearer dans l’en-tête Authorization et gardé la clé dans une variable env. Cela réduit les chances que je la valide accidentellement ou que je la mette dans un snippet partagé. Voici la forme que j’ai testée en janvier 2026 :

- En-tête : Authorization: Bearer $DEEPSEEK_API_KEY

- Point de terminaison : le chemin chat-completions affiché dans vos docs de compte

- Modèle : vérifiez la chaîne exacte de V4 dans le tableau de bord (par exemple, « deepseek-v4 »), car le nommage peut changer

Une petite note : si votre organisation achemine les requêtes via un proxy, testez d’abord avec curl. C’est plus facile de voir ce qui va réellement sur le fil.

Requête de base

Mon premier appel demande au modèle de résumer un court texte avec un format strict. Si un modèle suit le formatage du premier coup, je lui fais davantage confiance pour les tâches structurées plus tard.

Curl (compact, facile à comparer plus tard) :

curl -s https://api.your-deepseek-endpoint/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-d '{

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": "Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\nFormat:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"}

]

}'Python (utilisant un client de style OpenAI générique) :

from os import getenv

import requests

API_KEY = getenv("DEEPSEEK_API_KEY")

URL = "https://api.your-deepseek-endpoint/v1/chat/completions"

payload = {

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": (

"Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\n"

"Format:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"

)},

],

}

resp = requests.post(

URL,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json",

},

json=payload,

timeout=30,

)

resp.raise_for_status()

print(resp.json()["choices"][0]["message"]["content"])Ce que je cherche dans la sortie :

- A-t-il gardé la structure exacte (ligne Summary, puis puces Risks) ?

- Y a-t-il des réserves ou des mots de remplissage que je n’ai pas demandés ?

- Si je réexécute avec le même prompt à température 0, obtiens-je le même format ?

Mes exécutions étaient propres : V4 a suivi le format sans s’écarter et a bien géré les instructions lapidaires. C’est généralement un bon signe pour les tâches en aval comme la rédaction de changelog ou les commentaires de code. Le principal piège était la gestion du budget tokens, les réponses qui incluent de longs textes entre guillemets peuvent déborder. Je l’ai corrigé en réduisant les entrées et en demandant d’abord des résultats plus courts, puis en les développant au besoin.

Première tâche de codage à essayer

J’aime les petites automations qui sont immédiatement utiles. La première chose que j’ai essayée était un petit helper qui renomme les fichiers de capture d’écran en titres lisibles. Pas glamour. Très utile.

Configuration que j’ai utilisée (janvier 2026)

Configuration que j’ai utilisée (janvier 2026)

- Un dossier plein d’images comme Screenshot 2026-01-18 at 11.02.31.png

- Un fichier YAML avec quelques règles (nom du projet, format de date)

- Un prompt qui demande à V4 de produire un script et un plan de simulation avant de toucher à des fichiers

Prompt que j’ai envoyé via l’API

You are helping me write a safe file-renamer. Requirements:

- Input: directory of PNG/JPG screenshots.

- Output: dry-run first: then rename.

- Pattern: {project}-{short-title}-{YYYYMMDD}.{ext}

- Short titles: extract from on-screen window titles if present: otherwise infer 2–4 words from file metadata: avoid stop words.

- Constraints: no overwrites: lowercase: hyphens only: log actions.

Return:

1) Risks (3 bullets)

2) Plan (numbered steps)

3) Python script (<= 120 lines)

4) One test case (pytest-style) using a temp directory.Ce qui s’est passé :

Première tentative : le script avait l’air bien mais a sauté le flag —dry-run. Je lui ai demandé d’insérer une option CLI “—dry-run” avec un défaut de true. Il a accepté et gardé le code sous la limite.

Deuxième tentative : il a deviné l’analyse EXIF. Je l’ai poussé à le gater derrière un try/except et continuer sans échouer. Après cela, ça a tourné proprement.

Pourquoi c’est une bonne première tâche :

Cela force un formatage soigné et une simple I/O.

Vous pouvez valider la justesse sans lire chaque ligne, il suffit d’exécuter avec un dossier factice et voir le journal.

Cela expose les cas limites rapidement (espaces, collisions, noms longs).

Ce que j’ai remarqué à propos de V4 ici :

Il répond bien aux contraintes en langage clair. « No overwrites: lowercase: hyphens only » a mieux fonctionné qu’un long template.

Il est resté ancré quand je lui ai demandé un plan avant le code. Cette petite pause nous a aidés tous les deux. Je pouvais attraper les étapes manquantes avant qu’il ne produise quelque chose de dangereux.

Limites et compromis :

Ce n’est pas un substitut à la lecture du code. Je parcours toujours les opérations de fichiers non sécurisées et les importations inattendues.

Pour les scripts plus longs, je divise la tâche : plan → fonctions principales → wrapper CLI → tests. V4 a respecté la séquence plus que certains modèles que j’ai utilisés, mais il peut toujours mélanger les étapes si je suis vague.

Qui cela aide :

Les créateurs qui veulent des utilitaires rapides et sûrs.

Les équipes qui préfèrent une structure cohérente entre les prompts.

Les gens qui valorisent le formatage prévisible plutôt que la créativité tape-à-l’œil.

Qui pourrait être frustré :

Quiconque s’attend à ce qu’un modèle devine les règles métier sans les écrire.

Les gens qui veulent des résultats longs en un coup. Les petites boucles fonctionnent mieux ici.

Pourquoi c’est important pour moi :

Une fois qu’un modèle fait les choses simples de manière fiable, formatage, courts plans, température basse, le reste de mon flux de travail devient plus léger. Je pense à V4 comme une paire de mains stable. Pas de magie. Juste stable.

Si vous êtes curieux, essayez le même motif avec une tâche différente demain : générez un changelog à partir de messages de commit, ou produisez des étapes de migration à partir d’une diff de schéma. Gardez la contrainte plan-first, et voyez si votre charge mentale diminue d’un cran. La mienne l’a fait.

Je vais continuer à tester V4 avec des documents plus longs la semaine prochaine. Je me demande comment il gère les résumés cités sans gonfler la sortie. Silencieusement plein d’espoir, mais je vais laisser les runs me le dire.

Questions fréquemment posées

Quel est le moyen le plus rapide de commencer avec DeepSeek V4 : chat web ou API ?

Commencez par le chat web pour itérer sur les prompts avec une configuration minimale, puis passez à l’API pour la cohérence et les exécutions répétables. Le chat fonctionne bien pour les brouillons plus propres ou les refactorisations rapides. Pour un style stable, un formatage strict et l’automatisation, l’API fournit des résultats plus stables et prévisibles.

Comment utiliser DeepSeek V4 via l’API ?

Créez une clé API, stockez-la dans une variable d’environnement, et envoyez une requête de chat-completions avec Authorization: Bearer . Vérifiez le nom exact du modèle (par exemple, deepseek-v4) dans votre tableau de bord. Commencez par un petit prompt de test structuré à basse température pour confirmer l’authentification, le formatage et le comportement déterministe.

Comment utiliser DeepSeek V4 pour garder les réponses concises et au format ?

Définissez un court message système énonçant les règles de style (par exemple, soyez direct, énoncez les hypothèses). Gardez la température basse (environ 0–0.2) pour les specs et les résultats structurés. Fournissez un petit bloc de contexte au début de chaque fil, et demandez un plan avant le code. Cela réduit la dérive et améliore l’adhérence au format.