Extension ComfyUI-LTXVideo : Support LoRA, Flux de travail et Quand l'utiliser

Utilisation de LTXVideo dans ComfyUI : Guide Pratique

La première fois que j’ai essayé ComfyUI LTXVideo, je ne cherchais pas de nouvelles fonctionnalités. Je voulais juste un moyen fiable de transformer un storyboard brut en mouvement sans surveiller chaque image. Mon petit obstacle : une erreur « missing node » de plus après une longue journée. J’ai presque fermé la fenêtre. À la place, je lui ai donné une semaine (début janvier 2026) et je l’ai testé sur quelques vrais projets : une boucle produit de 12 secondes, un extrait pédagogique pour un cours, et l’une de ces expériences texture-to-motion qui ressemble soit à de la magie, soit à quelque chose de maudit.

Ce que j’ai trouvé n’était pas magique. Mais cela a rendu le travail plus léger à quelques endroits discrets. C’est généralement le signal que je cherche.

Noyau Intégré vs Extension : Quelle est la Différence

Je continuais à voir des gens parler du « support LTXVideo dans ComfyUI », mais il n’était pas clair ce qui était natif et ce qui nécessitait des éléments supplémentaires. Voici ce que j’ai remarqué en pratique.

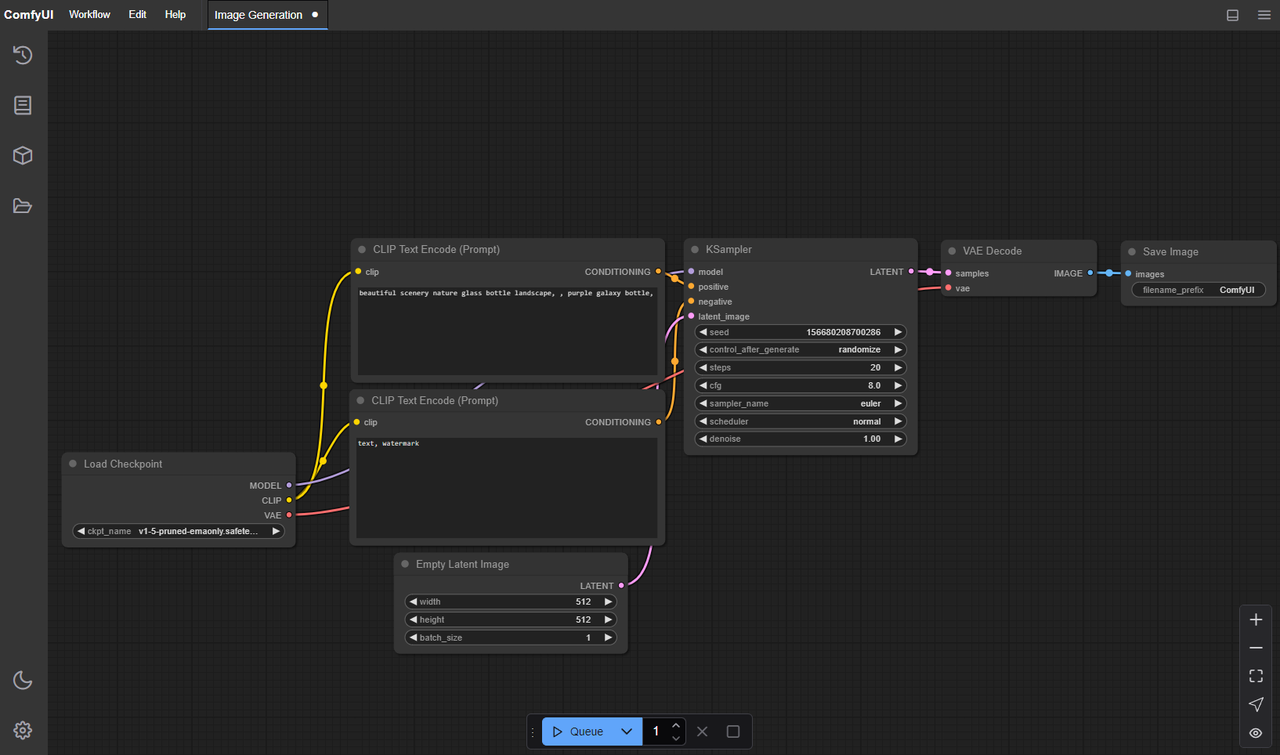

- Noyau (base ComfyUI) : Vous pouvez configurer des flux généraux text-to-image/video, planifier des samplers et gérer le conditionnement. L’application de base est très solide pour router les données, prévisualiser les images et garder les exécutions reproductibles. Mais elle ne dispose pas de nœuds LTX-Video spécialisés par défaut.

- Extension (nœuds personnalisés LTXVideo) : Cela ajoute des nœuds conscients du modèle (chargeurs, samplers, blocs de conditionnement) construits autour de l’architecture LTX-Video. L’extension comprend la longueur de mouvement du modèle, les fenêtres de contexte et les petites contraintes qui ne correspondent pas bien aux nœuds génériques.

La différence apparaît quand vous essayez d’en faire moins avec le collage manuel. Avec seulement des nœuds de base, je jonglais avec les formes de tenseurs, je devinais les paramètres par défaut et je tombais sur des incompatibilités de forme. Avec l’extension installée, le graphe est devenu plus court et les erreurs ont diminué. J’ai toujours dû réfléchir, juste pas aux tuyauteries.

Un petit exemple : j’ai construit une boucle de 8-12 secondes avec un éclairage cohérent dans la scène. La version core-only m’a pris ~45 minutes pour se stabiliser : laissez-moi vous dire que la version extension s’est bien exécutée au deuxième essai (environ 15 minutes), car le sampler pré-configuré et l’assembleur vidéo ont géré l’alignement des images sans que je ne m’en soucie.

Donc, si vous évaluez : le noyau est suffisant si vous aimez le contrôle total et ne vous dérangez pas de câbler. L’extension est pour quand vous vous souciez davantage des exécutions répétables que des tuyaux hand-tunés.

Ce que l’Extension Ajoute (workflows / nœuds / LoRA)

Je ne m’attendais pas à grand-chose quand j’ai cliqué sur les graphes d’exemple, j’en ai vu trop qui sont essentiellement des captures d’écran. Ceux-ci étaient mieux que cela.

Ce qui m’a aidé :

- Nœuds spécialisés : Chargeur de modèle pour LTX-Video, un sélecteur de longueur de mouvement qui évite les nombres d’images bizarres, et un sampler qui respecte les bonnes fenêtres de temps du modèle. Ils éliminent quelques pièges qui apparaissent généralement seulement après un rendu échoué.

- Workflows d’exemple : Trois sur lesquels je revenais sans cesse, text-to-video de base, image-to-video avec injection de mouvement, et style-transfer utilisant LoRA. Chacun est assez clair pour commencer, mais pas tellement rigide que vous ne puissiez pas échanger des pièces.

- Hooks LoRA : L’extension expose la force LoRA et la combinaison proprement. J’ai pu empiler un style LoRA avec un léger identity LoRA et garder le mouvement stable. Je dois dire, c’est rare dans les configurations vidéo précoces.

Une petite surprise : la gestion des couleurs par défaut s’est avérée plus calme que la plupart des modèles vidéo open que j’ai essayés. Les bleus n’ont pas explosé. La peau est restée dans une gamme crédible. J’ai quand même dû ajuster l’exposition, mais je n’étais pas en lutte avec la saturation.

Limites que j’ai rencontrées :

- Les longues séquences (plus de ~12-16 secondes) dérivent à moins que j’introduise des images clés d’ancrage ou que je divise l’exécution. C’est normal à ce stade, mais cela vaut la peine de noter.

- L’empilement lourd de LoRA peut déstabiliser le mouvement. Deux c’est bien, trois c’est risqué à moins que vous sous-croquez les forces.

Étapes d’Installation et de Mise à Jour

Préparation

- Mettez à jour ComfyUI vers une construction récente. J’ai utilisé le nightly de janvier 2026 sur les deux machines.

- Python 3.10-3.11 fonctionnait mieux. J’ai gardé un venv frais par machine.

Installez l’extension LTXVideo

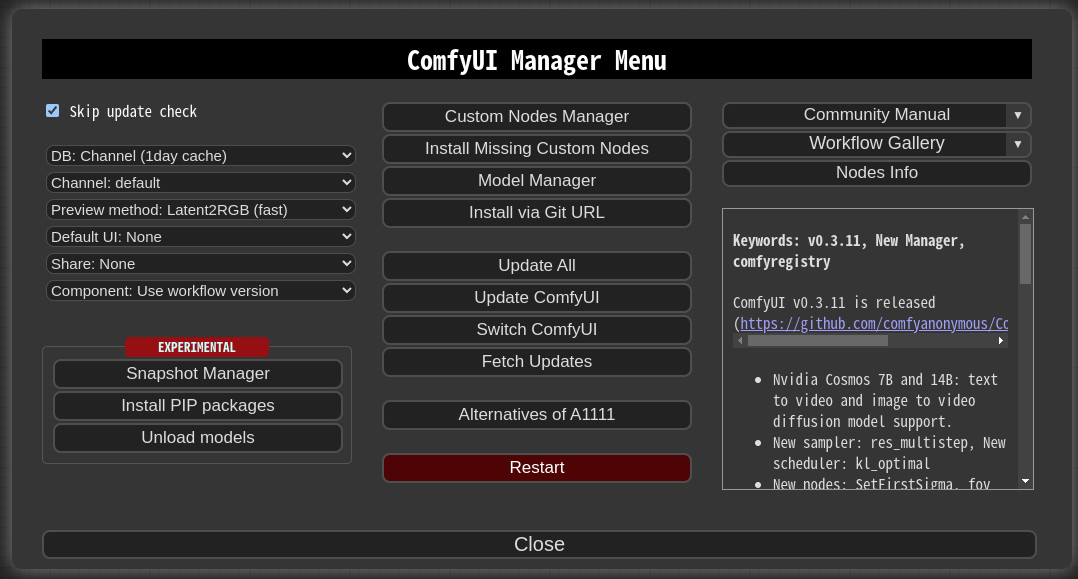

- Utilisez ComfyUI-Manager si vous l’avez : Recherchez « LTXVideo » ou « ComfyUI-LTXVideo » et installez.

- Route manuelle : clonez le repo dans ComfyUI/custom_nodes. Ensuite, installez les dépendances (

pip install -r requirements.txt) dans votre environnement.

Modèles

- Mettez les points de contrôle LTX-Video où l’extension les attend. La plupart des versions regardent sous

models/ltxvideooumodels/checkpoints: le nœud vous dit généralement le chemin exact au survol. - Si vous utilisez LoRA, placez-les sous

models/loras(ou où le nœud liste par défaut).

CUDA et runtimes

- Linux avec CUDA 12.x et PyTorch 2.3+ fonctionnait sans problème. Sur macOS, Metal fonctionnait, mais j’ai gardé les tailles de lot petites.

- Si vous voyez des pics de mémoire à la première exécution, réduisez la longueur du mouvement ou réglez une précision de décodage inférieure si le nœud l’expose.

Mises à Jour

- Récupérez les derniers éléments du repo de l’extension. Réinstallez les dépendances quand des commits majeurs arrivent (j’ai rencontré une incompatibilité torch-vision et une augmentation protobuf : tous deux corrigés avec une réinstallation propre).

- Effacez le cache ComfyUI si les nœuds n’apparaissent pas après une mise à jour. Un redémarrage rapide résout souvent les imports obsolètes.

Coût en temps : La première installation m’a pris ~20 minutes sur une boîte Linux propre, ~30 minutes sur macOS parce que j’ai dû re-lier quelques builds métal. Les mises à jour prenaient des minutes à moins que les dépendances ne changent.

Walkthrough des Workflows d’Exemple

J’ai exécuté trois workflows plusieurs fois chacun, en ajustant juste assez pour voir à quel point ils sont stables.

J’ai exécuté trois workflows plusieurs fois chacun, en ajustant juste assez pour voir à quel point ils sont stables.

1. Text-to-video (baseline)

- Configuration : Prompt, negative prompt, le chargeur LTX-Video, le sampler du modèle, et un writer vidéo à 512-768 sur le côté court. J’ai gardé la longueur du mouvement à 8-12 secondes.

- Observations : Le premier passage ne visait rarement le rythme exact, mais il me donnait une « prise de base » stable. Le deuxième passage avec des éditions mineures du prompt a résolu la plupart des problèmes. Chaque rendu prenait 2-4 minutes sur l’A6000, ~6-8 sur le M3 Max.

- Petit conseil : Si le mouvement semble flottant, resserrez les conseils temporels ou réduisez le CFG d’une encoche. Pour moi, 4,5-6,5 était la bande utilisable.

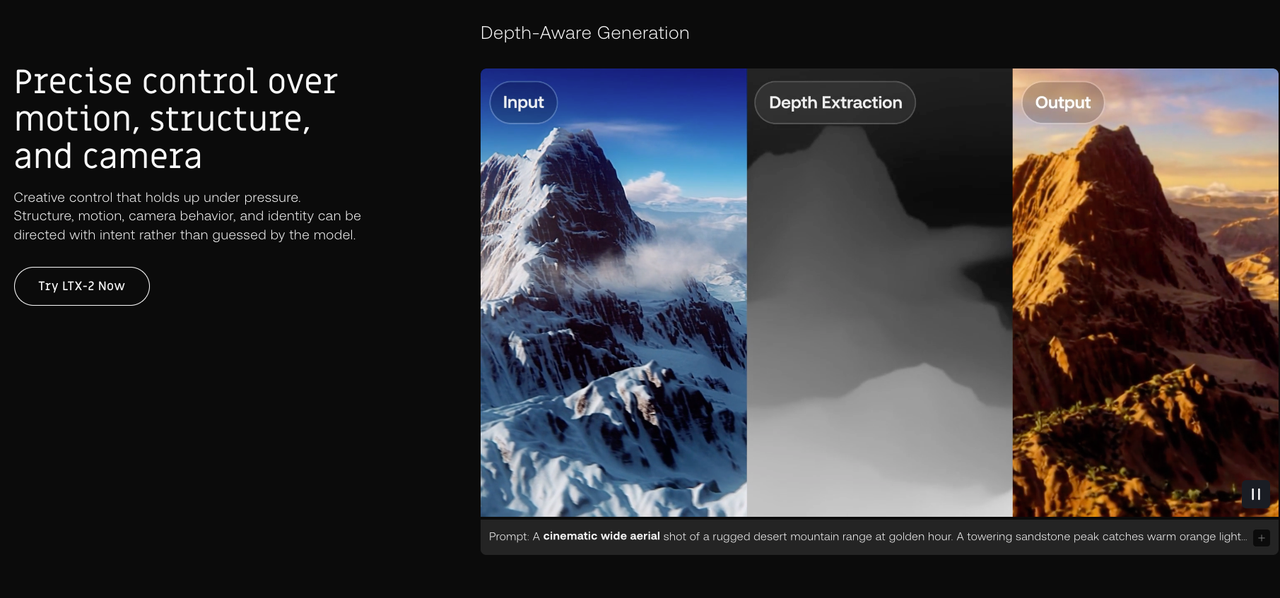

2. Image-to-video avec injection de mouvement

- Configuration : Une seule image de référence, plus un style LoRA de faible force pour garder la texture cohérente. J’ai utilisé le nœud de mouvement de l’extension pour encourager la dérive de caméra au lieu de laisser inventer le mouvement.

- Observations : Cela n’a pas économisé du temps au premier essai, j’ai trop réglé. Au troisième essai, j’ai réalisé que cela réduisait la charge mentale : moins d’artefacts à trier, moins de surprises « qu’est-ce que c’est dans le coin ? ».

- Note pratique : Si le sujet se déforme autour de l’image 3-5, ajoutez une image d’indice de séquence médiane ou une image d’ancrage. J’ai utilisé deux ancres pour un clip de 10 secondes et cela semblait bloqué.

3. Style avec LoRA (plus identité légère)

- Configuration : Prompt de base, un style LoRA à 0,6-0,8, identity LoRA à 0,2-0,3, et mouvement conservateur.

- Observations : La combinaison s’est tenue mieux que je ne l’espérais. Plus fort que 0,8 en style a commencé à « briller » les textures, joli pour les affiches, étrange pour le mouvement. Garder l’identité basse a évité les changements inquiétants.

- Export : J’ai écrit en ProRes pour l’étalonnage. H.264 convient pour les vérifications rapides, mais les couleurs semblaient mieux quand j’ai fait une légère passe dans Resolve.

Toutes les exécutions confondues, j’ai économisé peut-être 15-20 minutes par clip par rapport à l’assemblage de nœuds génériques. Le plus grand gain était moins de redémarrages. Moins d’ajustements, plus de décisions.

Bases LoRA & IC-LoRA

J’ai tendance à recourir au LoRA seulement quand j’en ai besoin. Avec LTXVideo, cela vaut l’étape supplémentaire, surtout pour la cohérence.

J’ai tendance à recourir au LoRA seulement quand j’en ai besoin. Avec LTXVideo, cela vaut l’étape supplémentaire, surtout pour la cohérence.

- LoRA : Pensez-y comme une empreinte digitale styliste légère. En vidéo, poussez gentiment. Les forces plus de ~0,8 semblent fragiles à mesure que le mouvement s’accumule.

- Identity LoRA : Utile pour garder un personnage ou un produit stable dans les images. J’aimais les valeurs dans la gamme 0,15-0,35.

- IC-LoRA (image-conditioned LoRA) : C’est là que j’ai trouvé la valeur pratique la plus importante. Alimenter une image de référence propre dans IC-LoRA a stabilisé les détails (logos, visages) sans geler la scène. J’ai utilisé une image claire de face et parfois un angle latéral comme indice secondaire.

Ce qui compte en pratique :

- Les références propres battent les prompts intelligents. Garbage in, garbage out, et cela se voit davantage en mouvement.

- Mélanger moins, accorder plus légèrement. Deux LoRAs légèrement appliqués fonctionnaient mieux que trois se battant l’un l’autre.

- Re-seed si le micro-jitter apparaît. Une nouvelle graine plus les mêmes ancres résolvait souvent le petit scintillement facial.

Corrections « Missing Node »

J’ai rencontré trois variantes de « missing node » lors des tests. Aucune n’était dramatique, mais elles cassent le flux.

- Extension non chargée : Assurez-vous que le dossier LTXVideo se trouve sous

ComfyUI/custom_nodeset qu’il a un__init__.py. Redémarrez ComfyUI. Si le journal montre des erreurs d’import, réinstallez les dépendances pour ce nœud. - Dérive de dépendance : Les incompatibilités Torch/CUDA se manifestent par des erreurs d’import. Alignez les versions PyTorch et CUDA listées dans le README de l’extension. Un venv frais est plus rapide que de déboguer un enchevêtrement.

- Anciens workflows, nouveaux nœuds : Certains graphes référencent des nœuds renommés. Ouvrez le JSON, recherchez la classe du nœud et mappez-la au nouveau nom. Les CHANGELOGs de l’extension notent généralement ceux-ci.

Vérifications rapides de la santé mentale :

- Mettez à jour ComfyUI-Manager, puis « scannez les mises à jour ».

- Effacez le cache de ComfyUI et redémarrez.

- Confirmez les chemins du modèle dans le nœud de chargement, un point de contrôle manquant ressemble à un nœud manquant du point de vue de l’interface utilisateur.

Appliquez Ces Workflows sur WaveSpeed

J’ai essayé une exécution en cloud pour voir comment cela se traduit loin de mon bureau. Sur WaveSpeed, j’ai mis en place un espace de travail ComfyUI avec un GPU de classe RTX et j’ai glissé l’extension LTXVideo de la même manière.

Deux notes si vous allez par cette route :

Deux notes si vous allez par cette route :

- Gardez vos modèles organisés : J’ai d’abord synchronisé les points de contrôle et les LoRAs LTX-Video dans les dossiers attendus (

models/ltxvideo,models/loras), puis j’ai ouvert les graphes d’exemple. Faites-moi confiance, pas de surprises une fois que les chemins correspondent. - Longueurs d’exécution : Un GPU cloud m’a permis de tester des clips de 12-16 secondes à une résolution plus élevée sans me soucier de la VRAM. Cela n’a pas résolu la dérive par lui-même, mais cela a accéléré l’itération, je pouvais rendre trois prises en parallèle et choisir le meilleur.

Si vous travaillez sur un ordinateur portable, c’est un moyen sans stress de tester les idées avant de s’engager dans des installations locales. Vos résultats peuvent varier, mais cela m’a épargné quelques boucles de compilation tard dans la nuit.

La petite pensée persistante : LTXVideo dans ComfyUI ne cherche pas à vous impressionner dès le départ. Il réduit simplement le nombre de choses que vous devez garder à l’esprit à la fois. Les jours chargés, c’est suffisant.