2 formateurs de modèles maintenant en direct sur WaveSpeedAI : Entraînez votre propre Wan ou Flux pour LoRA

2 Formateurs de Modèles Maintenant en Direct sur WaveSpeedAI : Entraînez Votre Propre Wan ou Flux pour LoRA

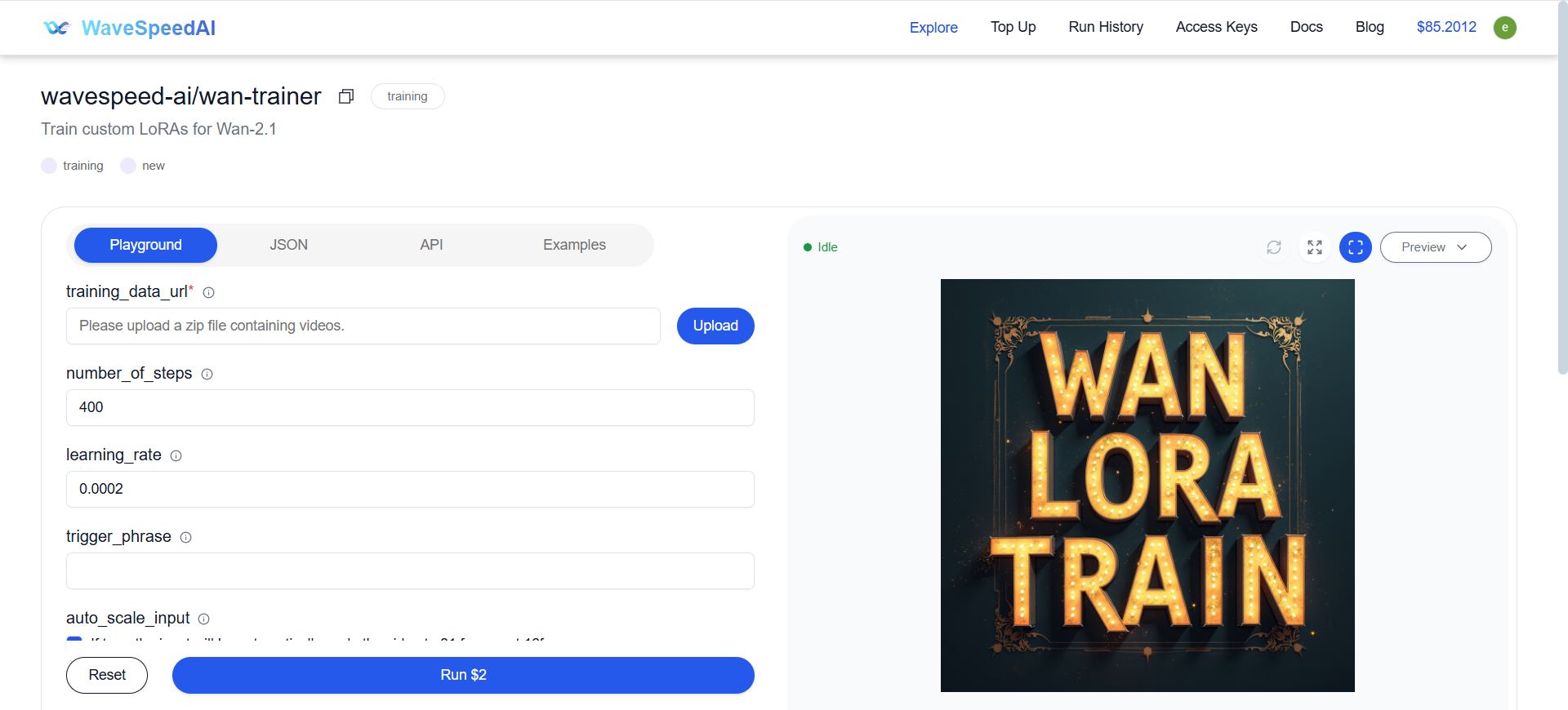

Nous sommes heureux de vous présenter Wan-Trainer et Flux-Dev-LoRA-Trainer — 2 outils d’entraînement qui peuvent entraîner des modèles avec votre propre ensemble de données.

À Propos de Wan-Trainer

Wan est une suite de modélisation de génération vidéo open source développée par Alibaba qui supporte une variété de tâches, notamment Text-to-Video, Image-to-Video, Édition Vidéo, Text-to-Image et Video-to-Audio.

Avec Wan-Trainer fourni par WaveSpeedAI, vous pouvez facilement télécharger votre propre ensemble de données et affiner rapidement votre propre modèle Wan-LoRA en une simple opération ! Toutes les tâches supportées par Wan — du Text-to-Video — peuvent être entraînées directement sur WaveSpeedAI.

Créer un Exemple Wan_3D_Pintr_Lora :

- Exemple d’Ensemble de Données Vidéo : Ensemble de Données Vidéo

- Prétraitement des Données : Préparez environ 10 clips vidéo avec des caractéristiques cohérentes et compressez-les dans un fichier ZIP.

- Durée : Chaque clip vidéo doit avoir une durée d’environ 5 secondes.

- Annotation : La plateforme Wavespeed fournit une fonctionnalité de balisage automatique.

- Paramètres :

- learning_rate : Le taux auquel le modèle apprend. Les valeurs plus élevées peuvent accélérer l’entraînement mais risquent un surajustement.

- trigger_phrase : Une phrase spécifique qui active le modèle pour générer une image.

- number_of_steps : 1000

- auto_scale_input : Si activée (true), la vidéo d’entrée sera automatiquement mise à l’échelle à 81 images à 16fps.

Exemple JSON :

{

"learning_rate": 0.0002,

"trigger_phrase": "3d",

"number_of_steps": 1000,

"auto_scale_input": true,

"training_data_url": "https://d32s1zkpjdc4b1.cloudfront.net/media/8cb24be7c94d472cb7895e1499bd0ae7/archives/1746773122258761405_gMU3b9hp.zip",

"model_id": "wavespeed-ai/wan-trainer"

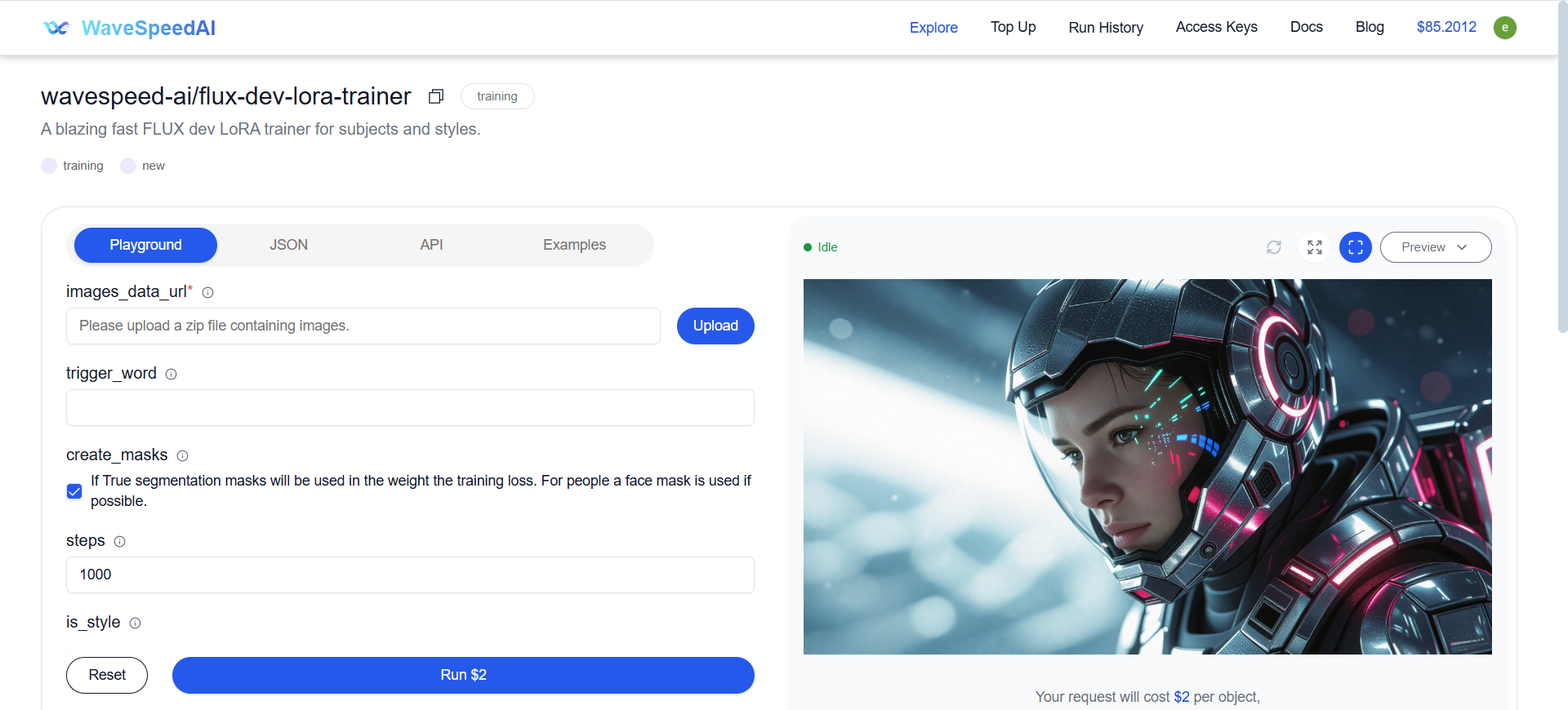

}À Propos de Flux-Dev-LoRA-Trainer

Flux Dev est une version open source non commerciale du modèle text-to-image développé par Black Forest Labs. Il excelle en qualité d’image, performance détaillée et reproduction fidèle des indices de commande.

Avec Flux-Dev-LoRA-Trainer fourni par WaveSpeedAI, vous pouvez facilement télécharger votre propre ensemble de données et affiner votre propre modèle Flux-Dev-LoRA en une simple opération !

Créer un Exemple FLUX_Style_Lora :

- Exemple d’Ensemble de Données Image : Ensemble de Données Image

- Prétraitement des Données : Placez toutes les images d’entraînement du même style dans un seul dossier.

- Résolution : Les images originales doivent idéalement avoir une résolution de 1024×1024 ou supérieure. Elles peuvent être converties en 512×512 ultérieurement si nécessaire.

- Rapport d’Aspect : Lors de l’entraînement sur Flux.1, un rapport d’aspect 1:1 peut être utilisé. Des rapports d’aspect supplémentaires peuvent être ajoutés pour améliorer la diversité.

- Clarté : Utilisez autant que possible des images claires et de haute qualité.

- Diversité : Incorporez des variations dans les angles, les conditions d’éclairage et les vêtements pour améliorer l’adaptabilité du modèle.

- Paramètres :

- trigger_word : Mot déclencheur à utiliser dans les légendes. S’il est défini sur None, aucun mot déclencheur ne sera utilisé. Si les légendes ne sont pas fournies, le mot déclencheur remplacera les légendes. Si des légendes existent, le mot déclencheur est ignoré.

- create_masks : Si True, des masques de segmentation sont appliqués pour pondérer la perte d’entraînement. Pour les sujets humains, les masques faciaux sont prioritaires si possible.

- steps : Généralement calculé comme (nombre d’images) × 100 (par exemple, 20 images → 2000 étapes).

- is_style : Lorsque True, configure l’entraînement pour le transfert de style. Cela désactive la segmentation et le sous-titrage, en utilisant le mot déclencheur pour définir le style.

- is_input_format_already_preprocessed : Indique si les données d’entrée sont prétraitées. La valeur par défaut (False) suppose une entrée brute avec des noms de fichiers image/légende correspondants (par exemple, photo.jpg et photo.txt). Définissez sur True pour les données prétraitées.

- data_archive_format : Format d’archive. S’il n’est pas spécifié, il est déduit de l’URL.

Exemple JSON :

{

"create_masks": false,

"images_data_url": "https://d32s1zkpjdc4b1.cloudfront.net/media/8cb24be7c94d472cb7895e1499bd0ae7/archives/1747100030859337188_6Ddljsqo.zip",

"is_input_format_already_preprocessed": true,

"is_style": true,

"steps": 2000,

"trigger_word": "test",

"model_id": "wavespeed-ai/flux-dev-lora-trainer"

}Essayez Wan-Trainer et Flux-Dev-LoRA-Trainer Maintenant sur WaveSpeedAI

Affinez vos propres modèles d’IA avec Wan-Trainer et Flux-Dev-LoRA-Trainer sur WaveSpeedAI — aucune configuration complexe requise.

Qu’il s’agisse de Text-to-Video, Image-to-Video ou même d’Édition Vidéo, Wan-Trainer vous permet de télécharger vos propres données et de personnaliser le puissant modèle Wan pour répondre à vos objectifs créatifs.

Avec Flux-Dev-LoRA-Trainer, vous pouvez facilement personnaliser le modèle Flux-Dev — réputé pour sa qualité d’image et sa fidélité aux invites — en entraînant votre propre LoRA en utilisant vos propres images.

Que vous construisiez des flux de travail vidéo expressifs ou des générateurs d’images personnalisés, WaveSpeedAI vous donne le contrôle total et des résultats rapides. Commencez à affiner vos modèles dès aujourd’hui !