Acceder a GLM-4.7-Flash a través de WaveSpeed API

Oye, soy Dora. El impulso vino de una pequeña molestia: otro proyecto más, otra clave API, y otro SDK con sus propias ideas sobre tokens y reintentos. Quería probar GLM-4.7-Flash porque la gente no dejaba de mencionar su velocidad para borradores cotidianos e investigación rápida. Pero no quería reconfigurar toda mi stack solo para hacer algunas pruebas.

Así que opté por un camino más tranquilo: acceder a GLM-4.7-Flash a través de la API de WaveSpeed. Los mismos patrones de cliente, una sola clave, modelo intercambiado. Probé esto en algunos scripts en enero de 2026 y tomé notas. Nada de esto es dramático. Pero sí hizo mi día a día un poco más ligero. Y honestamente, ese es el estándar ahora: más ligero gana sobre más ruidoso.

Por qué usar WaveSpeed

No voy a pretender que WaveSpeed es magia. Es más como un cajón de adaptadores confiable: no es emocionante, pero es lo que buscas cuando quieres ponerte a trabajar.

Lo que me importaba no era la cantidad de modelos, sino la falta de fricción. Podía apuntar el mismo código a diferentes modelos, intercambiar una línea y listo. Así de simple, sin dramatismo.

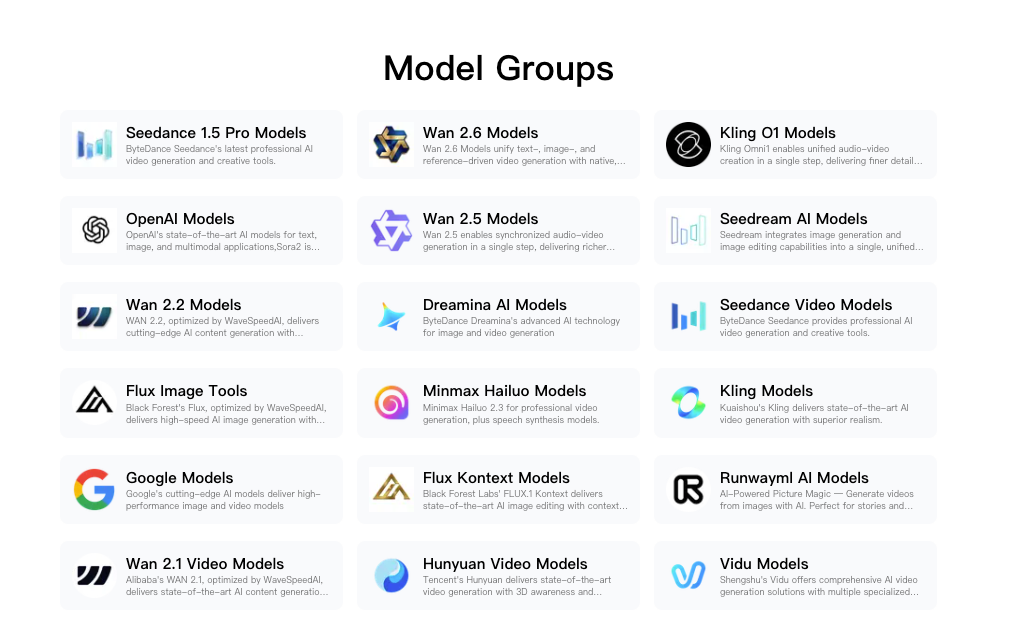

Una clave API, más de 600 modelos

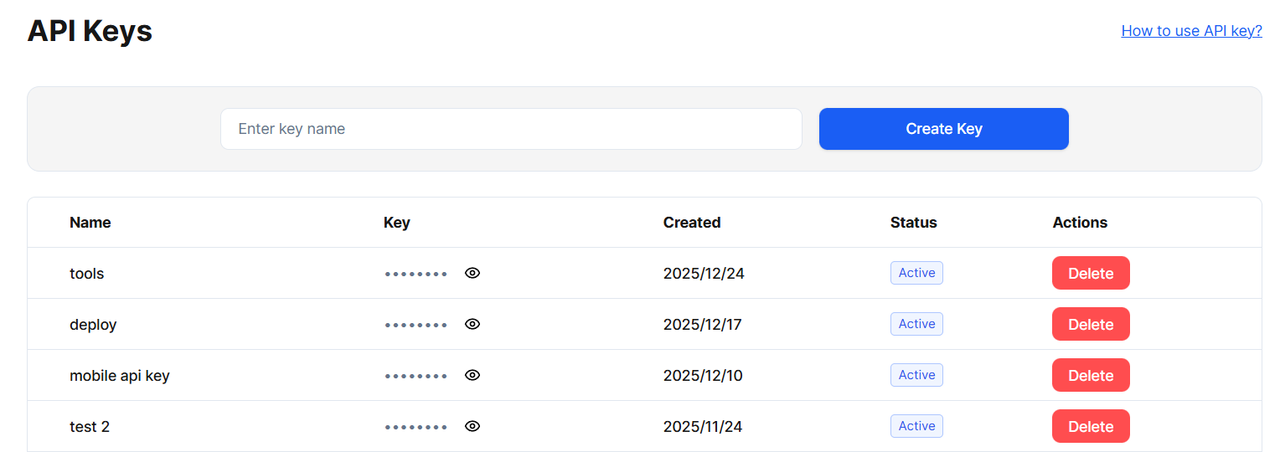

Mi verdadera victoria fue mental. No ando buscando a través de paneles de control de proveedores para rotar claves o limitar gastos. Una clave en mi gestor de secretos, y puedo dirigirme a GLM-4.7-Flash para borradores rápidos, luego cambiar a un modelo más pesado cuando un prompt necesita más profundidad. Aún establezco límites por proyecto, pero la sobrecarga disminuye.

Mi verdadera victoria fue mental. No ando buscando a través de paneles de control de proveedores para rotar claves o limitar gastos. Una clave en mi gestor de secretos, y puedo dirigirme a GLM-4.7-Flash para borradores rápidos, luego cambiar a un modelo más pesado cuando un prompt necesita más profundidad. Aún establezco límites por proyecto, pero la sobrecarga disminuye.

En la práctica: mantuve mi variable de entorno existente (WAVESPEED_API_KEY en mi caso), y solo cambié el nombre del modelo. Esa pequeña decisión—mantener nombres alineados, no ser ingenioso—me salvó de romper CI.

Sin cambio de SDK

Me quedé con el cliente compatible con OpenAI que ya estaba usando. Sin nuevos nombres de métodos, sin reaprender banderas de streaming. Si has construido pequeñas utilidades alrededor de completaciones de chat, streaming y llamadas de herramientas, la mayoría se traslada. Me gusta que WaveSpeed no me pida adoptar su perspectiva antes de devolver un token, si tiene sentido.

Dos advertencias que noté:

- Los nombres de modelos varían según los proveedores. Verifico el identificador exacto en la documentación oficial de WaveSpeed antes de confirmar código.

- Las características específicas del proveedor (como formatos de respuesta especiales o peculiaridades de llamadas de función) aún pueden diferir. Mantén un pequeño archivo adaptador donde normalices cargas. El mío tiene 60 líneas y se paga a sí mismo cada semana.

Código de inicio rápido

Usé los puntos finales de estilo OpenAI que expone WaveSpeed. Si tu código ya llama a una API de Completaciones de Chat, esto debería resultarte familiar. El único cambio real es la URL base y el nombre del modelo.

Probé esto del 12 al 15 de enero de 2026 con prompts de lote pequeño. Los prompts cortos comenzaron a hacer streaming en menos de un segundo en mi conexión. Obviamente, tu experiencia variará con la red, el tamaño del prompt y la carga del servidor.

Probé esto del 12 al 15 de enero de 2026 con prompts de lote pequeño. Los prompts cortos comenzaron a hacer streaming en menos de un segundo en mi conexión. Obviamente, tu experiencia variará con la red, el tamaño del prompt y la carga del servidor.

Ejemplo de reemplazo directo

Aquí está la forma que usé. Consulta la documentación oficial de WaveSpeed para obtener el identificador de modelo más reciente (lo he visto listado como glm-4.7-flash).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])Pequeñas notas que encontré útiles:

- Si tu aplicación hace streaming de tokens, mantén el mismo análisis SSE: la bandera de stream de WaveSpeed se comportó como se esperaba en mis pruebas.

- Establezco el tiempo de espera por solicitud un poco más alto que lo usual cuando no estoy seguro de la carga del modelo.

- Registra el nombre del modelo en las respuestas. El tú del futuro te lo agradecerá cuando los resultados se desvíen y necesites confirmar qué se ejecutó.

Combina con otros modelos

La mayoría de mi trabajo mezcla modelos. GLM-4.7-Flash es rápido para primeros intentos, borradores, resumenes, respuestas básicas de preguntas. Cuando necesito razonamiento más pesado, o una capacidad específica (como un intérprete de código fuerte o una cierta característica de visión), me dirijo a otro lado. WaveSpeed me permite mantener esa dirección en un solo lugar.

La mayoría de mi trabajo mezcla modelos. GLM-4.7-Flash es rápido para primeros intentos, borradores, resumenes, respuestas básicas de preguntas. Cuando necesito razonamiento más pesado, o una capacidad específica (como un intérprete de código fuerte o una cierta característica de visión), me dirijo a otro lado. WaveSpeed me permite mantener esa dirección en un solo lugar.

Lo que me sorprendió un poco: esperaba que cambiar modelos durante la ejecución se sintiera desordenado. No fue así. Los prompts mantuvieron la misma forma, así que podía comparar resultados sin contorsionar el código.

Flujo de texto + imagen

Probé una pequeña rutina: recopilar una captura de pantalla de un informe del usuario, ejecutar OCR ligero o un subtítulo de visión, luego pedirle a GLM-4.7-Flash que produzca un resumen de acciones en lenguaje natural.

Mis pasos:

- Usar un modelo compatible con visión para extraer texto/etiquetas de la imagen. Mantén la salida compacta, piensa en pares clave-valor o viñetas cortas.

- Pasa ese texto a GLM-4.7-Flash con un aviso de sistema estable (dos líneas), y solicita un resumen breve con decisiones.

- Si la imagen tiene tablas, agrego una regla rápida: “Preserva números y unidades exactamente.” Esto redujo la limpieza después.

Notas de campo:

- En un PNG de 1.2MB con UI mixto + texto, el paso de visión me llevó ~2-4 segundos: la summarización de GLM-4.7-Flash volvió en menos de un segundo. Esa división mantuvo el flujo sintiéndose ágil.

- El costo fue predecible porque restringí la salida de visión a unos pocos cientos de tokens antes de pasarla.

- Si no necesitas matiz de visión, ejecuta OCR básico primero (Tesseract o una API OCR pagada), luego pasa el texto a GLM-4.7-Flash. Más barato, a menudo suficientemente bueno.

Flujo de texto + video

El video es más pesado, obviamente. No envié video completo a ningún modelo. Extraje la transcripción primero (whisper o un ASR pagado), luego dirigí secciones a GLM-4.7-Flash para summarización rápida.

Un bucle que funcionó:

- Transcribe el video una vez. Si puedes, mantén marcas de tiempo.

- Divide por cambios de hablante o segmentos de 3-5 minutos (lo que sea más limpio).

- Solicita a GLM-4.7-Flash resúmenes de segmentos y decisiones. Mantén el aviso de sistema anclado: “Solo devuelves JSON estructurado con campos A/B/C.”

- Cose un esquema de nivel superior a partir de los segmentos con un segundo paso.

En la práctica, GLM-4.7-Flash se sintió adecuado para los resúmenes de segmentos: rápido, baja fricción, precisión suficientemente buena para la planificación. Para el esquema final, a veces cambié modelos por tono o matiz. Mantuve todo dentro de WaveSpeed para que mi código no cambiara de forma.

Precios

Los precios son donde me ralentizo. No porque sea complicado, sino porque las sorpresas aparecen en los registros, no en los paneles de control.

GLM-4.7-Flash en WaveSpeed

A partir de enero de 2026, GLM-4.7-Flash está disponible a través de WaveSpeed con su propia tasa por token. Los números exactos pueden cambiar, así que no los fijaré aquí. Compruebo la página de precios oficial antes de enviar cualquier cosa a producción y establezco límites suaves en mi configuración de entorno.

A partir de enero de 2026, GLM-4.7-Flash está disponible a través de WaveSpeed con su propia tasa por token. Los números exactos pueden cambiar, así que no los fijaré aquí. Compruebo la página de precios oficial antes de enviar cualquier cosa a producción y establezco límites suaves en mi configuración de entorno.

Cómo estimo:

- Muestrea un prompt + respuesta típicos. Multiplica por el número de ejecuciones diarias. Eso me lleva a tokens diarios.

- Agrega 20-30% de margen para días malos o nuevos prompts.

- Compara eso con un modelo más lento pero más barato para la misma tarea. Si el modelo más lento no aumenta el tiempo de edición humana, podría ganar en general.

Un truco práctico: registra tokens por bandera de característica. Activo GLM-4.7-Flash para una porción de usuarios y comparo el tiempo de edición y las quejas. Eso me dice más que una tabla de precios.

Descuentos por volumen

WaveSpeed ofrece precios basados en volumen. Los niveles importan si haces trabajos por lotes o ejecutas recargas de datos. Me comuniqué una vez para confirmar umbrales antes de una semana pico: la respuesta fue directa y me salvó de limitar trabajo en ventanas incómodas.

Mi regla: si espero una explosión 10x, campaña, migración, o un sprint de investigación, me comunico primero con el soporte. El punto no es un trato especial: es un techo claro para que no vigile trabajos toda la noche, porque nadie quiere eso.

Construimos WaveSpeed exactamente para este tipo de flujo de trabajo: menos claves, menos cambios de SDK, y menos tiempo pensando en infraestructura. Si estás malabarismo con modelos y solo quieres que se comporten detrás de una sola API predecible, ese es el problema que estamos intentando resolver.

➡️Puedes explorarlo aquí.

Ahora te toca a ti: ¿cuál es el circo de claves API más ridículo con el que has tratado últimamente? Déjalo en los comentarios—los leeré todos mientras saboreo café y me siento ligeramente menos solo.