API GLM-4.7-Flash: Guía rápida de completaciones de chat y streaming

Hola, soy Dora. La semana pasada me topé con un pequeño inconveniente: una tarea de resumen de borrador que se sentía más pesada de lo que debería. Las herramientas que normalmente uso eran demasiado lentas o demasiado inteligentes para su propio bien. Quería algo rápido y predecible, aunque no fuera llamativo.

Así que le di una oportunidad seria a la API de GLM-4.7-Flash (enero de 2026). No buscaba un “guau”. Quería solicitudes limpias, respuestas rápidas y configuraciones que se comportaran como dicen que lo hacen. Aquí está lo que configuré, qué ayudó, dónde tropezó, y por qué la volvería a usar cuando necesito velocidad sin drama.

Obtén Tu Clave de API

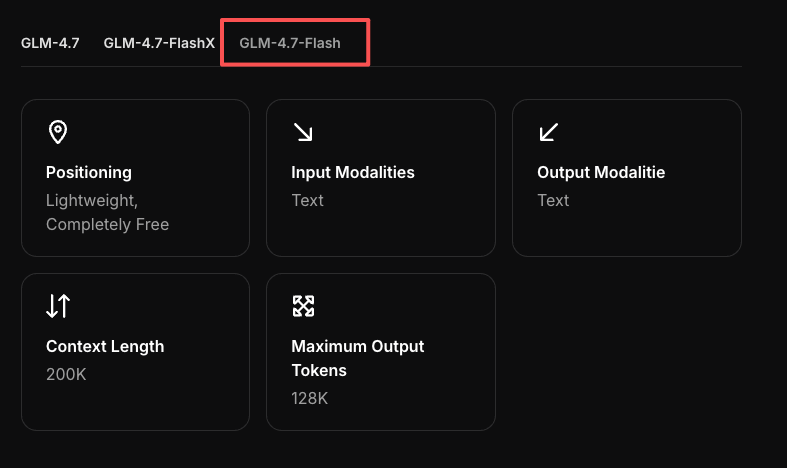

Empecé simple: obtén una clave, haz una solicitud, mira si los conceptos básicos se sienten sensatos. Aprecio las APIs que no esconden las palancas. Para contexto, GLM-4.7-Flash es parte de la familia más amplia de modelos GLM de Zhipu AI, que enmarca muchas de las decisiones de diseño en torno a la velocidad y la previsibilidad.

Recorrido del Panel de WaveSpeed

Usé el panel de WaveSpeed, que envuelve el acceso a la API de GLM-4.7-Flash. El flujo fue lo suficientemente simple:

- Crear un proyecto (nombré el mío “flash-notes”).

- Generar una clave de servidor y un token de cliente ligero. Solo usé la clave de servidor en mis scripts locales.

- Revisar el panel de uso para detectar los límites de velocidad predeterminados. El mío mostró un límite de ráfaga modesto y una cuota por minuto, suficiente para pruebas pero no para un pico de producción.

Una pequeña cosa que me gustó: el panel muestra errores 4xx/5xx recientes con marcas de tiempo. Cuando alcancé límites más tarde, no tuve que adivinar. Si trabajas en equipo, la visibilidad de clave basada en roles ayudó: mantuve la clave con capacidad de escritura en un archivo .env y rotaba una vez durante la semana para verificar que la revocación funcionaba (lo hizo, instantáneamente).

Solicitud Básica

Mi primer punto de control fue el mismo que uso para cualquier modelo nuevo: un mensaje corto, una respuesta corta y sin sorpresas en el JSON.

El esquema de API sigue el mismo patrón de chat-completions descrito en la guía oficial de API de GLM-4.7, lo que significaba que no necesitaba reaprender la semántica de solicitudes.

Ejemplo de curl

Aquí está la llamada más simple que funcionó consistentemente para mí. El nombre del endpoint puede variar entre proveedores: este es el patrón que usé durante las pruebas.

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{"role": "user", "content": "Summarize this in one sentence: GLM-4.7-Flash API quick test."}

],

"temperature": 0.2,

"max_tokens": 120

}'Notas de la ejecución

- Latencia: Vi el primer token ~200–400 ms en un mensaje pequeño a media mañana (hora de EE.UU.). De principio a fin se completó en menos de un segundo para respuestas cortas.

- Estabilidad: Las respuestas fueron JSON bien formado cada vez cuando el streaming estaba desactivado.

- Costo: No puedo hablar de tu plan, pero los tokens se reportaron claramente en los registros de uso. Eso importa cuando estás impulsando iteraciones rápidas.

Ejemplo en Python

Para scripts pequeños, prefiero una función única con claves cargadas desde el entorno.

import os

import requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{

"role": "user",

"content": "Give me 3 bullet points on maintaining a calm writing workflow."

}

],

"temperature": 0.3,

"max_tokens": 180

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

resp = requests.post(BASE_URL, json=payload, headers=headers, timeout=30)

resp.raise_for_status()

data = resp.json()

print(data["choices"][0]["message"]["content"]) # typical OpenAI-style schemaDos pequeñas reacciones:

- Alivio: El esquema coincidía con el formato habitual de chat-completions, lo que significaba que no había capa de adaptador. Lo coloqué en una herramienta preexistente con cambios mínimos.

- Una limitación: Los resultados más largos a mayor temperatura a veces divagaban. Eso es normal para modelos tipo “Flash”: recorté con

max_tokensy ajusté el tono mediante un mensaje de sistema más estricto.

Habilitar Streaming

Solo activo el streaming cuando estoy dando forma a texto en vivo o cuando la latencia importa más que la completitud. GLM-4.7-Flash se sentía hecho para esto: primeros tokens rápidos, chunking estable una vez que los parámetros fueron configurados correctamente.

Configuración del Parámetro de Stream

Para habilitar eventos enviados por el servidor (SSE), establecí stream: true. Eso es todo. El resto es mantenimiento: asegúrate de que tu cliente lea líneas de eventos y se detenga en [DONE].

Versión de curl que usé:

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-N \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "user", "content": "Draft a two-sentence intro about quiet tools."}

],

"stream": true,

"temperature": 0.2,

"max_tokens": 120

}'Dos notas de campo:

- Si olvidas

-N(sin búfer) con curl, el stream puede parecer atascado. - Si obtienes un blob JSON simple en lugar de eventos, verifica que

streamsea booleanotruey no una cadena.

Manejar Chunks en Código

En Python, leo línea por línea, analizo marcos data: y me detengo en el centinela. Este patrón funcionó sin problemas.

import os, json, requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [{"role": "user", "content": "Write a calm closing paragraph."}],

"stream": True,

"temperature": 0.2,

}

with requests.post(

BASE_URL,

json=payload,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

stream=True,

timeout=60

) as r:

r.raise_for_status()

for line in r.iter_lines(decode_unicode=True):

if not line or not line.startswith("data:"):

continue

data = line[len("data:"):].strip()

if data == "[DONE]":

break

try:

delta = json.loads(data)["choices"][0]["delta"].get("content", "")

print(delta, end="", flush=True)

except (KeyError, json.JSONDecodeError):

# Skip malformed or heartbeat frames gracefully

continue

print() # newlineLo que me sorprendió un poco: el tiempo de los chunks fue constante. Intenté algunos mensajes más largos y aún obtuve un ritmo predecible. El streaming no ahorró tiempo real en respuestas muy cortas, pero redujo mi sensación de espera, lo que importa cuando estoy editando directamente en la terminal.

Referencia de Parámetros

Solo ajusto algunos botones de vez en cuando. Con la API de GLM-4.7-Flash, estos se comportaron como se esperaba.

temperature / top_p / max_tokens

- temperature: Mantuve esto entre 0.1 y 0.4 para tareas de producción. Números más bajos dieron frases más estrictas e imaginativas, lo cual está bien para resúmenes y texto de soporte. Si te desplazas por encima de 0.7, espera tangentes.

- top_p: Dejé top_p alrededor de 0.9. Cuando lo apretaba a 0.6 con baja temperatura, los resultados se sentían recortados, útiles para puntos de viñeta, menos para escritura matizada.

- max_tokens: Este fue mi guardarraíl. Para tareas de formato corto, 150–250 mantuvo los costos ordenados y evitó divagaciones. Para esquemas, 600–800 fue suficiente. Si el modelo se detiene antes, suele ser esto, no un error.

Una pequeña configuración que funcionó bien para mí cuando necesitaba respuestas nítidas y factuales:

{

"model": "GLM-4.7-Flash",

"temperature": 0.2,

"top_p": 0.9,

"max_tokens": 200

}Por qué esto importa en la práctica: cuando quieres velocidad, no quieres reescrituras. Una temperatura conservadora con un max_tokens generoso pero no ilimitado me ahorró tener que ejecutar la misma llamada dos veces solo para recortar la fraseología.

Errores Comunes

Mantuve un pequeño cuaderno junto a mí mientras probaba. Dos errores surgieron lo suficiente para ser dignos de mención clara.

Mantuve un pequeño cuaderno junto a mí mientras probaba. Dos errores surgieron lo suficiente para ser dignos de mención clara.

429 Límite de Velocidad

Lo que vi:

- Ráfagas de solicitudes paralelas (5–10 a la vez) a veces activaban un 429. Sucedió más en el primer minuto de una clave nueva.

Lo que ayudó:

- Backoff: retardo exponencial con jitter (por ejemplo, 200 ms, 400 ms, 800 ms, hasta ~3 s) limpió picos sin que tuviera que estar pendiente.

- Colas: coalescencia de mensajes casi idénticos en una ventana de lote corta (100–200 ms) redujo mi tasa máxima en ~30% sin cambiar UX.

- Comprobaciones de panel: el panel de uso confirmó cuándo era yo el problema. Sin misterio allí, lo que aprecié.

Quién esto activa: equipos que cableaban GLM-4.7-Flash en vistas previas de UI y ganchos de servidor al mismo tiempo. Si importa, pregunta a tu proveedor sobre límites por minuto más altos o usa una cola ligera en memoria.

Respuesta JSON Inválida

Lo que vi:

- Cuando el streaming está activado, algunos clientes intentan analizar cada marco

data:como JSON completo. Así no es como funciona SSE. Los marcos son parciales. - Una vez, con una conexión ruidosa, obtuve una línea de evento truncada que rompió analizadores estrictos.

Lo que ayudó:

- Protege tu analizador: solo analiza el JSON después de

data:y espera que contenga un pequeño delta, no el mensaje completo. Detente en[DONE]. - Tiempos de espera: mantén un tiempo de espera de lectura razonable pero evita matar un stream por un solo marco mal formado.

- Si necesitas JSON sin stream: apaga el stream y normalmente obtendrás un objeto JSON limpio y único. En mis ejecuciones, el modo sin stream nunca produjo JSON mal formado.

Un inconveniente más menor: si tu proxy o servidor inyecta registros en stdout, puede contaminar el stream. Mantén los registros separados de las tuberías de respuesta.

Después de toda esta prueba, la razón por la que me quedé con WaveSpeed es bastante simple: no quería pensar en la tubería.

Construimos WaveSpeed para ser la capa aburrida y confiable entre tu código y modelos rápidos como GLM-4.7-Flash. Endpoints limpios, comportamiento predecible, y un panel que te dice qué realmente sucedió cuando algo sale mal—límites de velocidad, errores, uso—sin adivinanzas.

Construimos WaveSpeed para ser la capa aburrida y confiable entre tu código y modelos rápidos como GLM-4.7-Flash. Endpoints limpios, comportamiento predecible, y un panel que te dice qué realmente sucedió cuando algo sale mal—límites de velocidad, errores, uso—sin adivinanzas.

Si estás cableando Flash en resúmenes, borradores, vistas previas de UI, o trabajos de fondo y solo quieres que se mantenga fuera del camino, eso es exactamente la brecha que estamos tratando de llenar. → ¡Haz clic aquí!