¿Qué es Z-Image-Turbo? El Modelo de Texto a Imagen Ultra Rápido de 6B Explicado

Oye, chicos. Soy Dora. Ese día, me topé con Z-Image-Turbo después de un pequeño inconveniente: necesitaba texto limpio y legible dentro de una imagen, y mi configuración habitual siempre me daba letras onduladas. No era inutilizable, pero siempre un poco defectuoso, como una señal pintada a toda prisa. Seguía viendo notas sobre un modelo que manejaba texto de forma nativa y se ejecutaba en una tarjeta de 16GB sin drama. Así que la semana pasada (febrero de 2026), probé Z-Image-Turbo en mi propia máquina y a través de una API. La versión corta: es rápido, es práctico, y no intenta ser un espectáculo. Esa combinación me llamó la atención.

¿Qué es Z-Image-Turbo?

Z-Image-Turbo es un modelo de generación de imágenes de código abierto con 6 mil millones de parámetros, diseñado para iteración rápida y representación de texto legible. Se dirige al punto ideal que muchos de nosotros realmente necesitamos: visuales lo suficientemente buenos, tipografía fiable y una configuración que no fuerza una estación de trabajo completa. Admite indicaciones bilingües (inglés y chino), y está ajustado para cronogramas de muestreo cortos, que es como mantiene la latencia baja.

Z-Image-Turbo es un modelo de generación de imágenes de código abierto con 6 mil millones de parámetros, diseñado para iteración rápida y representación de texto legible. Se dirige al punto ideal que muchos de nosotros realmente necesitamos: visuales lo suficientemente buenos, tipografía fiable y una configuración que no fuerza una estación de trabajo completa. Admite indicaciones bilingües (inglés y chino), y está ajustado para cronogramas de muestreo cortos, que es como mantiene la latencia baja.

Lo probé tanto localmente como a través de un punto final alojado. Localmente, se ejecutó en una GPU de 16GB sin malabarismos de dispositivos. A través de la API, pude enviar imágenes individuales a una tasa constante por imagen sin preocuparme por el ajuste por lotes. No está intentando superar a los modelos más cinemáticos: está intentando obtener una imagen sólida con palabras legibles, rápido.

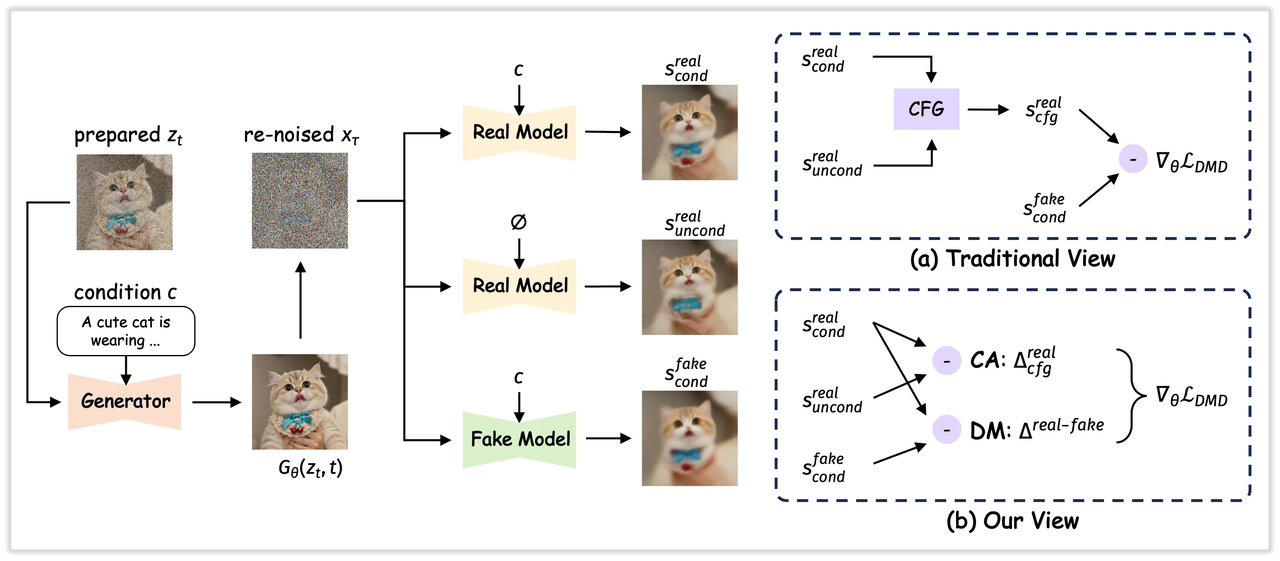

La arquitectura de parámetro 6B

No selecciono modelos por conteo de parámetros, pero explica algo del comportamiento. Con 6B, Z-Image-Turbo se siente intencionalmente restringido: más ligero que las variantes de difusión gigantes, más pesado que los más pequeños orientados a dispositivos móviles. En la práctica, eso significó dos cosas para mí. Primero, la memoria se mantuvo predecible, sin OOM de última hora cuando ajusté la resolución. Segundo, los indicadores respondieron consistentemente. No tuve que sobre-ingenierizar la orientación para mantener la tipografía intacta.

El detalle de arquitectura que más importaba: está entrenado para tratar el texto en la imagen como un objetivo de primera clase, no como un accidente afortunado. Puedes notarlo cuando pides señalización, maquetas de UI o tomas de productos con etiquetas. Las letras no se derriten tan pronto como añades estilo. No son perfectas, pero son lo suficientemente estables como para que dejara de vigilar el indicador.

Muestreo de 8 pasos, ¿por qué es tan rápido?

La mayoría de mis generaciones terminaron entre 6 y 10 pasos, con 8 como predeterminado. Ese es donde aparece la velocidad. Los cronogramas de bajo paso a menudo se desmoronan en detalles finos, pero aquí los resultados mantuvieron la forma, y el texto se mantuvo legible la mayoría de las veces. En mi GPU de laptop de 16GB, las imágenes de 512×512 routinariamente terminaban en un par de segundos: en la API alojada, la latencia se mantuvo ágil incluso con concurrencia ligera.

La mayoría de mis generaciones terminaron entre 6 y 10 pasos, con 8 como predeterminado. Ese es donde aparece la velocidad. Los cronogramas de bajo paso a menudo se desmoronan en detalles finos, pero aquí los resultados mantuvieron la forma, y el texto se mantuvo legible la mayoría de las veces. En mi GPU de laptop de 16GB, las imágenes de 512×512 routinariamente terminaban en un par de segundos: en la API alojada, la latencia se mantuvo ágil incluso con concurrencia ligera.

Esto no me ahorró tiempo al principio, seguía preocupándome por la formulación del indicador. Pero después de algunas ejecuciones, noté la caída de la carga mental. Menos reintentos. Menos impulsos de “uno más semilla”. Si trabajas en bucles cortos (borrador → ajuste → envío), el bajo conteo de pasos se suma rápidamente.

Características clave que importan

Intento evitar listas de características, pero algunas opciones aquí moldearon cómo usé el modelo.

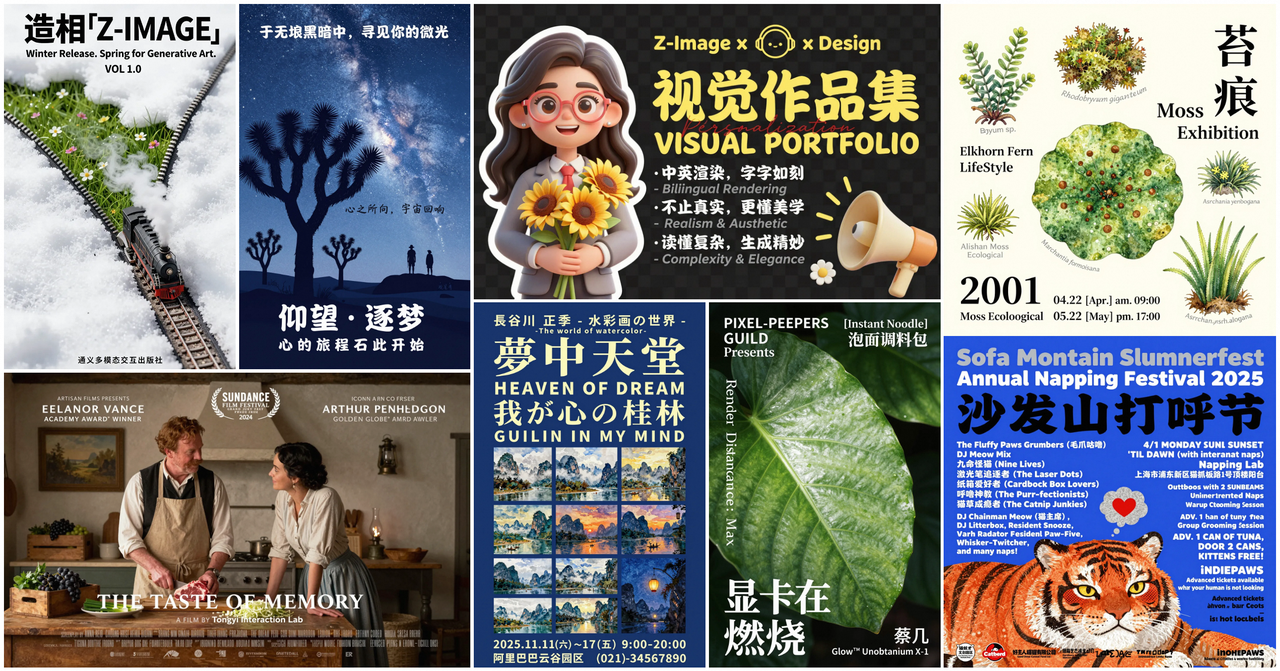

Soporte de indicador bilingüe (EN/ZH)

Probé indicadores en inglés y chino simple uno al lado del otro: etiquetas, señalización, subtítulos cortos. El modelo manejó ambos sin que cambiara nada en la configuración. Lo que se destacó fue que la intención del indicador se trasladaba entre idiomas. Cuando pedí “un tablero de menú limpio con tres secciones” en chino, me dio la misma estructura que el indicador en inglés, no una reinterpretación vaga. Si trabajas en equipos o mercados diferentes, esto reduce fricción, sin ajuste fino adicional, sin trucos específicos del idioma.

Límites: los indicadores en idiomas mixtos dentro de una sola imagen a veces se inclinaban hacia un idioma para el texto representado. Podía dirigirlo con instrucciones explícitas (por ejemplo, “título en EN, subtítulo en ZH”), pero no es perfecto. Aún así, para flujos de trabajo bilingües, es una de las experiencias más sencillas que he tenido.

Representación nativa de texto en imágenes

Esta es la razón por la que me quedé. El texto se ve como texto la mayoría de las veces, líneas de base rectas, fuentes reconocibles y caracteres que sobreviven cambios de estilo leves. Arrojé casos de fallo común contra él: señalización curva, pies de página pequeños, etiquetas de falsa UI. Se mantuvo mejor que los modelos abiertos usuales que uso, especialmente en tamaños modestos. No es tipografía de portada de revista, pero lo suficientemente bueno como para que dejara de enmascarar y componer cada vez.

Esta es la razón por la que me quedé. El texto se ve como texto la mayoría de las veces, líneas de base rectas, fuentes reconocibles y caracteres que sobreviven cambios de estilo leves. Arrojé casos de fallo común contra él: señalización curva, pies de página pequeños, etiquetas de falsa UI. Se mantuvo mejor que los modelos abiertos usuales que uso, especialmente en tamaños modestos. No es tipografía de portada de revista, pero lo suficientemente bueno como para que dejara de enmascarar y componer cada vez.

Una pequeña nota práctica: los indicadores de texto cortos y precisos funcionaban mejor. Los párrafos largos aún se desdibujan. Si estás diseñando copias pesadas en una imagen, probablemente seguirás queriendo una herramienta de diseño. Pero para logotipos, etiquetas, pancartas y maquetas simples de UI, Z-Image-Turbo hizo viable la ruta “simplemente renderizalo aquí”.

Compatibilidad de 16GB VRAM

Lo ejecuté en una GPU de 16GB sin fragmentación o medio día de bingo de dependencias. Las imágenes cuadradas de 768px funcionaron: 1024px necesitaba un poco más de paciencia y la configuración de precisión correcta, pero seguía siendo bien. Para mí, esto importa más que una demostración elegante. Si el modelo se comporta bien en una GPU de laptop común, puedo mantenerlo en mi bucle diario en lugar de girar un equipo separado.

Si estás en 8–12GB, es posible que necesites reducir la resolución o depender de la API. Si tienes 24GB+, tendrás más espacio para formatos grandes, pero el valor central del modelo, resultados rápidos y estables en texto, se muestra incluso en tamaños más pequeños.

Rendimiento de referencia

Los puntos de referencia no son el trabajo, pero ayudan a verificar las impresiones.

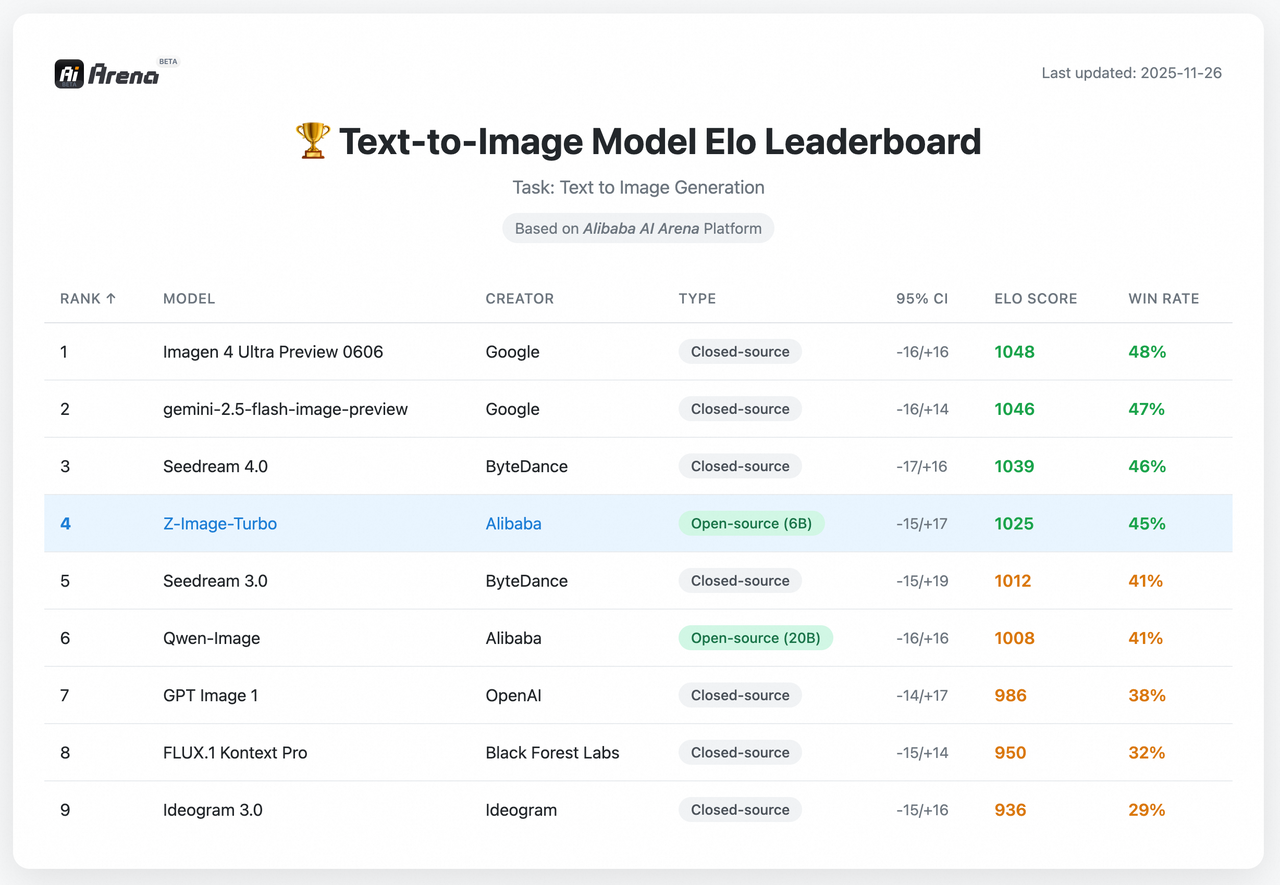

#1 de código abierto en el tablero de clasificación de Artificial Analysis

A principios de febrero de 2026, Z-Image-Turbo figura en o cerca de la parte superior entre modelos de imagen de código abierto en el tablero de clasificación de Artificial Analysis (las clasificaciones cambian, así que trata esto como una instantánea). Eso se alinea con lo que sentí: la velocidad y la fidelidad del texto parecen ser sus características distintivas. Los tableros de clasificación no miden todo, pero son un proxy útil para cómo un modelo se generaliza más allá de una demostración curada.

A principios de febrero de 2026, Z-Image-Turbo figura en o cerca de la parte superior entre modelos de imagen de código abierto en el tablero de clasificación de Artificial Analysis (las clasificaciones cambian, así que trata esto como una instantánea). Eso se alinea con lo que sentí: la velocidad y la fidelidad del texto parecen ser sus características distintivas. Los tableros de clasificación no miden todo, pero son un proxy útil para cómo un modelo se generaliza más allá de una demostración curada.

Cómo se compara con modelos de código cerrado

Contra los grandes modelos alojados, Z-Image-Turbo intercambia el fotorrealismo máximo por velocidad, costo y texto controlable. Si quieres escenas brillantes y cinemáticas con iluminación intrincada, algunas opciones cerradas aún lo superan. Si quieres un gráfico limpio con palabras legibles en dos minutos, este se mantiene firme. También noté que se necesitaban menos acrobacias de indicador para mantener la tipografía intacta, menos prueba, más resultado. Para pequeños equipos o creadores solitarios, ese equilibrio suele ser la diferencia entre “experimento agradable” y “esto se envía hoy”.

¿Quién debe usar Z-Image-Turbo?

Casos de uso ideales

- Gráficos sociales con texto corto y legible (anuncios, pancartas, miniaturas)

- Maquetas de productos y escenas simples de UI donde las etiquetas necesitan sobrevivir

- Documentos internos y diapositivas que se benefician de visuales rápidos sin un desvío de diseño

- Activos bilingües donde la flexibilidad del idioma del indicador ahorra idas y venidas

- Iteración rápida en sprints, cuando quieres 3–5 variantes decentes rápido y seguir adelante

En mis pruebas, la victoria no fue solo la velocidad bruta. Fue previsibilidad. Podía ajustar el estilo o diseño sin perder el texto completamente, lo que significaba menos reinicios.

Cuándo elegir otros modelos en su lugar

- Fotorrealismo de alta gama para impresiones de formato grande o anuncios, algunos modelos cerrados aún ofrecen un acabado más pulido.

- Párrafos largos o sistemas de tipografía complejos, usa una herramienta de diseño o post-procesa.

- Composición pesada o consistencia de múltiples imágenes (mismo personaje en escenas diferentes), querrás un modelo con identidad fuerte y controles de múltiples tomas.

Si tu trabajo se inclina hacia la narración cinemática o estudios de iluminación intrincados, podrías preferir una herramienta diferente. Z-Image-Turbo es más un conductor diario que un auto de espectáculo.

Cómo empezar

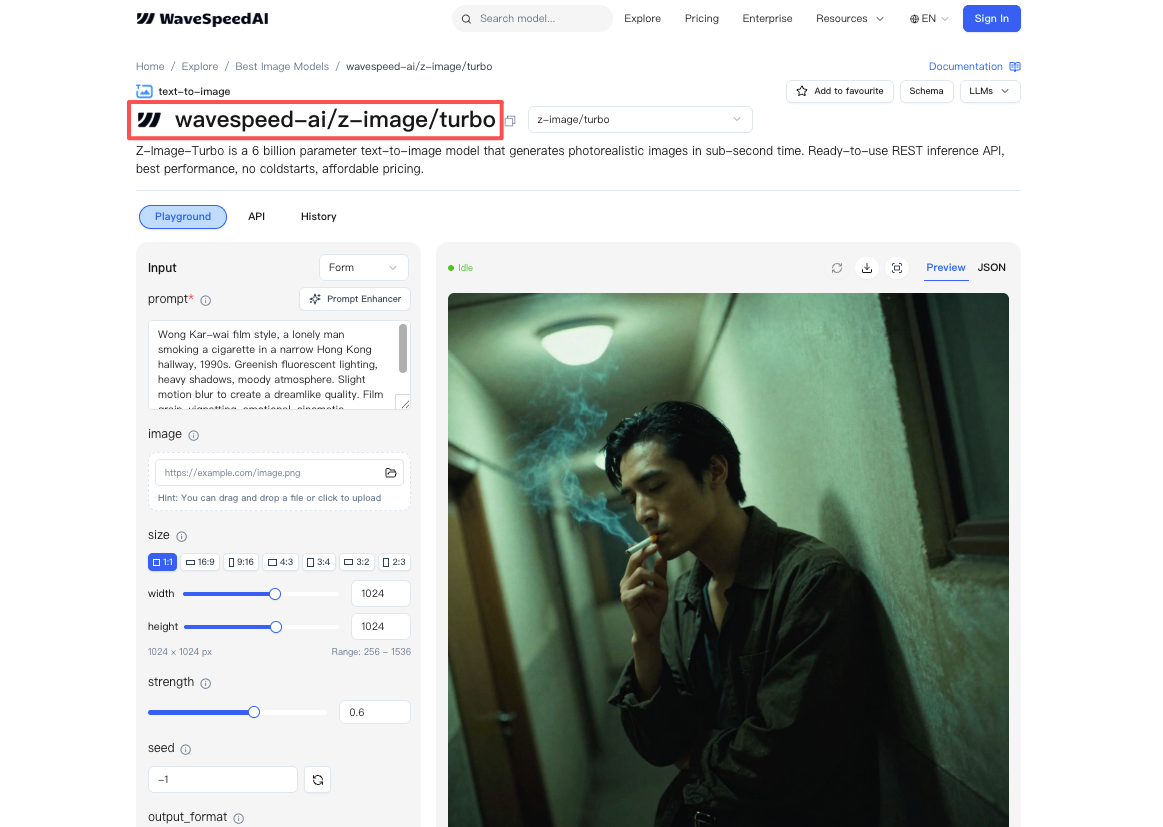

Inicio rápido de la API de WaveSpeed

Probé primero la API de WaveSpeed para evitar derivaciones de configuración. La autenticación fue estándar, y el cuerpo de la solicitud fue simple: indicador, pasos (me mantuve en 8), tamaño y una semilla si quieres reproducibilidad. Los valores predeterminados eran sensatos. Si estás probando la representación de texto, comienza con frases cortas y una resolución media, luego escala hacia arriba una vez que te guste el aspecto. Pasé de idea a primera imagen utilizable en menos de cinco minutos, la parte más rápida de todo este experimento.

Si prefieres lo local, el modelo se ejecutó limpiamente en una GPU de 16GB con configuración de precisión típica. Mantén un ojo en VRAM mientras cruzas 768px. Si alcanzas límites, reduce pasos antes de reducir orientación: el muestreo de 8 pasos es el punto aquí.

Descripción general de precios ($0.005/imagen)

A través de WaveSpeed, el precio fue de aproximadamente $0.005 por imagen en configuración estándar. Eso es difícil de criticar para borradores, activos sociales o experimentos rápidos. Si estás generando a escala, observa límites de concurrencia, la latencia se mantuvo baja para mí con ráfagas pequeñas, pero no probé a fondo más allá de un puñado de trabajos paralelos.

A través de WaveSpeed, el precio fue de aproximadamente $0.005 por imagen en configuración estándar. Eso es difícil de criticar para borradores, activos sociales o experimentos rápidos. Si estás generando a escala, observa límites de concurrencia, la latencia se mantuvo baja para mí con ráfagas pequeñas, pero no probé a fondo más allá de un puñado de trabajos paralelos.

Esto funcionó para mí, tu experiencia puede variar. Si estás malabarismo con indicadores bilingües o simplemente quieres texto que se vea como si perteneciera a la imagen, vale la pena una mirada. Lo último que noté, casi por accidente: dejé de capturar pantallas y editar una y otra vez. Menos desvíos. Eso se sintió como el punto.