¿Qué es Google Genie 3? El modelo mundial de DeepMind explicado

Hola, soy Dora. Una pequeña cosa me hizo reflexionar. Estaba recortando un video de referencia corto para una idea de UX, y me sorprendí a mí misma deseando poder “empujar” el clip, mover la escena, cambiar el ángulo, mover el personaje dos pasos hacia la izquierda, sin reabrir Figma o tocar After Effects. Fue entonces cuando volví a Genie de Google. Había visto las primeras demostraciones de Genie hace meses, luego la charla más nueva sobre “Genie 3”.

Pasé algunos anocheceres a finales de enero de 2026 leyendo las publicaciones oficiales, viendo los videos de investigación y comparándolos con modelos de entorno interactivo anteriores que he probado. Donde pude, recreé pequeños flujos de los materiales públicos de Genie más antiguos. Donde el acceso estaba cerrado, tomé notas y pausé cuando las afirmaciones parecían vagas. Aquí está lo que se me quedó, con un enfoque en lo que los “modelos de mundo” significan en la práctica, no en comunicados de prensa.

Qué hace Google Genie 3

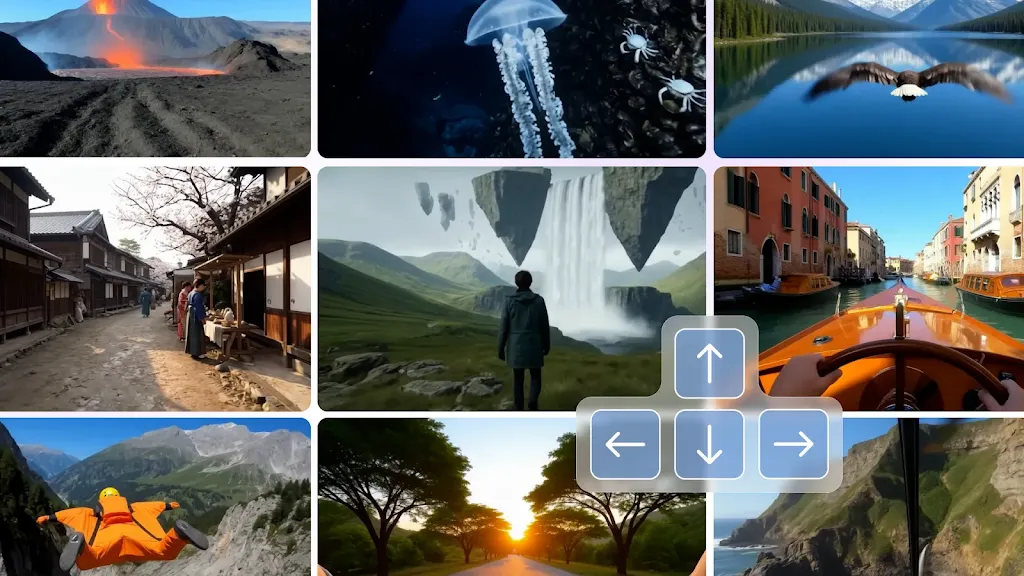

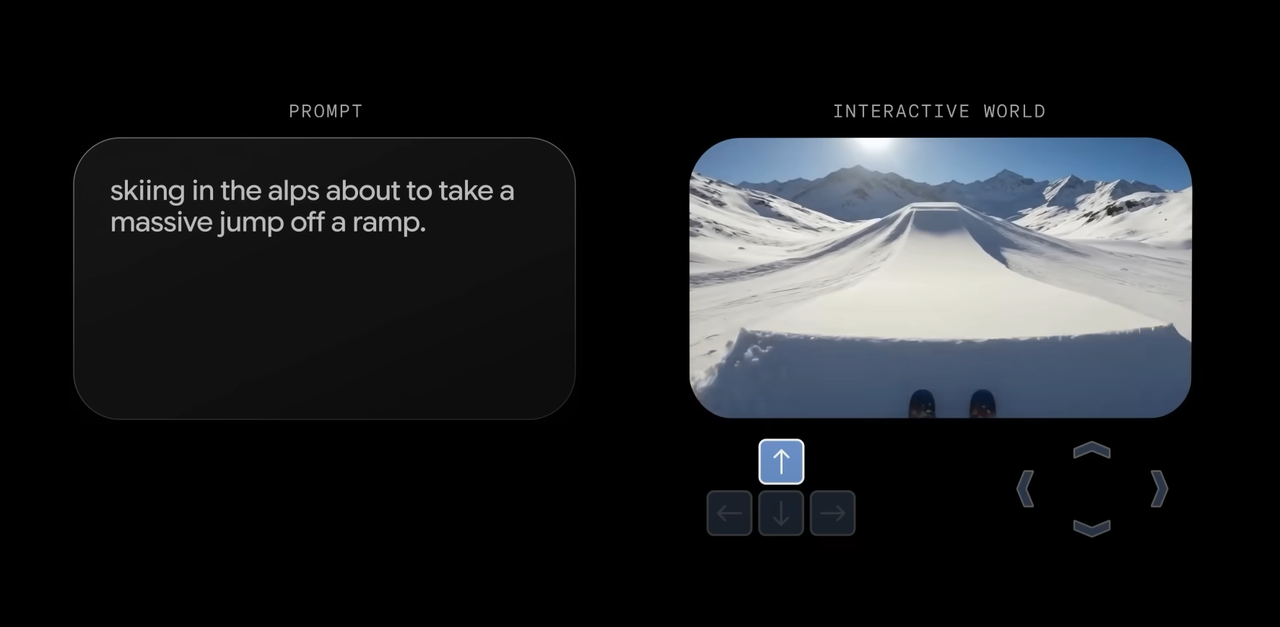

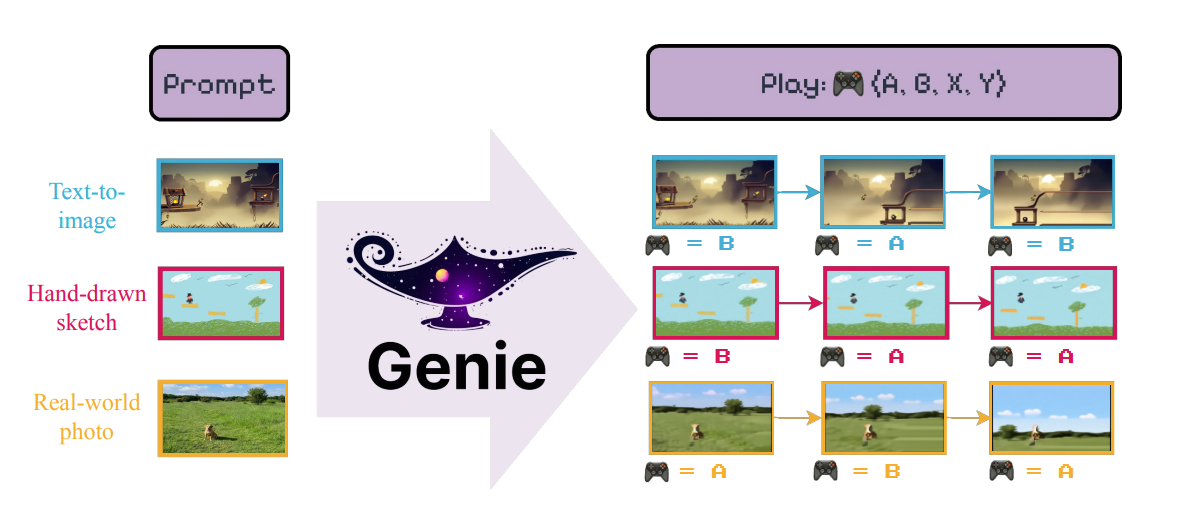

En líneas generales, Genie 3 se presenta como un modelo de mundo que puede convertir texto o imágenes en escenas interactivas y jugables, piensa en snippets 2D cortos o estilizados en 3D que puedas controlar realmente en lugar de solo mirar. En las demostraciones de Google/DeepMind, dibujas o describes una escena, y el modelo activa un entorno consistente con objetos, reglas de física, y un actor controlable. El resultado final se parece a un video, pero se comporta como un juego diminuto.

En líneas generales, Genie 3 se presenta como un modelo de mundo que puede convertir texto o imágenes en escenas interactivas y jugables, piensa en snippets 2D cortos o estilizados en 3D que puedas controlar realmente en lugar de solo mirar. En las demostraciones de Google/DeepMind, dibujas o describes una escena, y el modelo activa un entorno consistente con objetos, reglas de física, y un actor controlable. El resultado final se parece a un video, pero se comporta como un juego diminuto.

La propuesta es sutil pero importante: en lugar de renderizar fotogramas únicos que solo se ven bien desde la distancia, un modelo de mundo intenta aprender la dinámica subyacente. Cuando presionas izquierda, el personaje se mueve de una manera que aún encaja con el mundo que acaba de imaginar. Cuando cae una pelota, la gravedad se comporta igual cada vez. Esa consistencia es la diferencia entre un clip genial y una herramienta que puedas usar.

Lo que noté al comparar las demostraciones de Genie 3 con iteraciones anteriores de Genie es el empuje hacia despliegues más largos y coherentes. Los Genie anteriores podían producir juguetes divertidos de un solo nivel: Genie 3 parece mantener las reglas más tiempo, por lo que las acciones se encadenan sin que la escena se desmorone. Digo “parece” porque no tengo acceso directo a la construcción exacta de la investigación. Pero los clips muestran menos glitches raros, menos momentos donde un personaje atraviesa una pared o donde las texturas se derriten cuando la cámara se mueve. La actualización parece ser menos sobre flashy y más sobre estabilidad.

En la práctica, así es como usaría algo como esto si estuviera en mi caja de herramientas hoy:

- Esbozar un prototipo: Convertir un diseño esbozado en un mock jugable para que los stakeholders sientan el tiempo y la asequibilidad, no solo que los vean.

- Explorar ideas de movimiento: Generar variantes de transiciones o interacciones y elegir la que se sienta correcta en la mano.

- Enseñar o probar: Construir mundos pequeños y restringidos para verificar una secuencia de acciones, como flujos de incorporación o tareas de capacitación.

Ese es el atractivo. No magia, solo menos fricción en los primeros pasos.

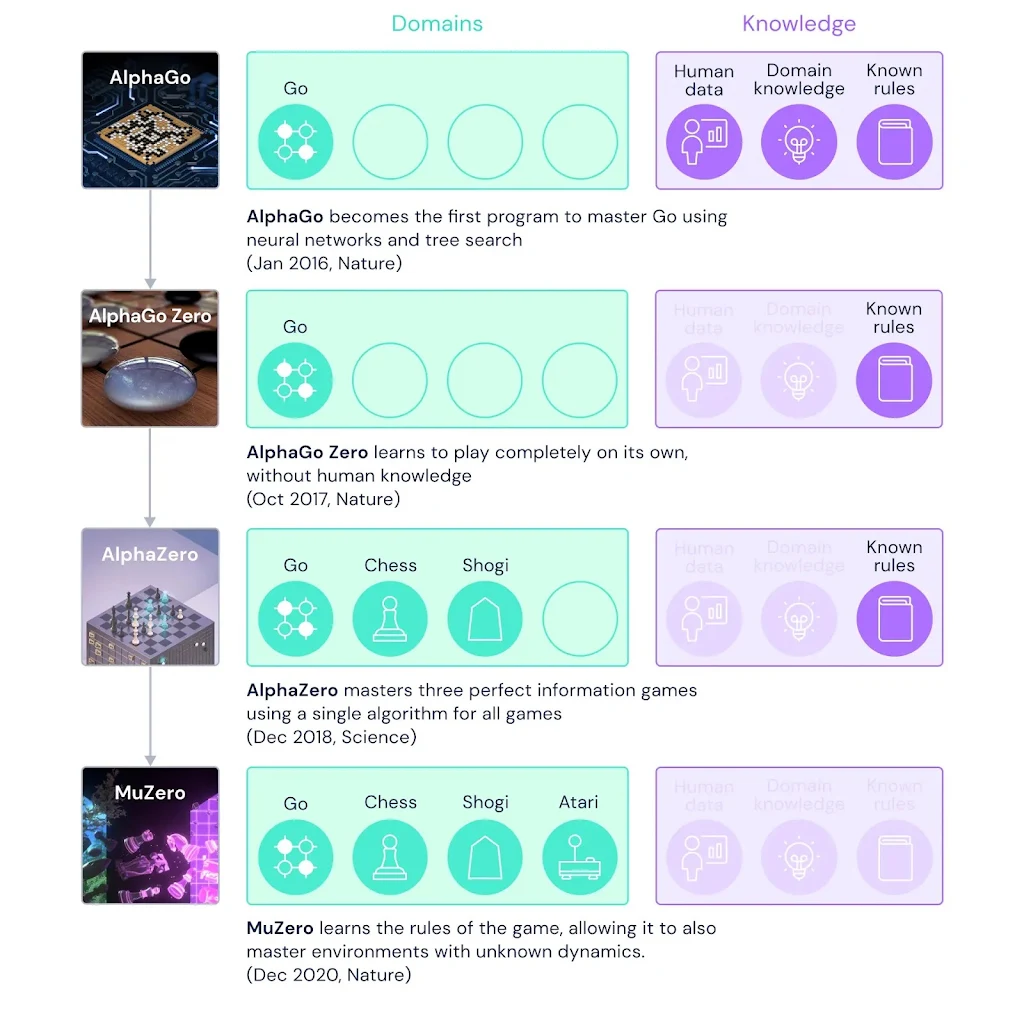

Cómo funcionan los modelos de mundo

No voy a amontonar jerga. La idea central: un modelo de mundo intenta aprender cómo cambia una escena con el tiempo, no solo cómo se ve. Si has visto trabajo como MuZero o Dreamer, el hilo te resultará familiar: aprende una representación compacta del estado, predice cómo evoluciona con acciones y muestrea imágenes que se mantienen en carácter.

Algunos puntos prácticos que tengo en mente cuando escucho “modelo de mundo”:

Algunos puntos prácticos que tengo en mente cuando escucho “modelo de mundo”:

- Hay una memoria interna de la escena. El modelo no está redibujando desde cero cada fotograma: mantiene un registro de entidades y reglas para que el movimiento tenga continuidad.

- Las acciones importan. En lugar de solo predecir el siguiente fotograma, predice el siguiente estado dada una acción (saltar, girar, colisionar). Eso es lo que lo hace jugable.

- La coherencia cuesta recursos computacionales. Los despliegues más largos y estables significan un entrenamiento e inferencia más cuidadosos. Si algo se siente lento, esa es a menudo la razón.

Modelo de mundo vs generador de video

La mayoría de los generadores de video hoy en día producen píxeles plausibles, luego esperan que tu cerebro complete las lagunas. Destacan en ráfagas cortas y cinematográficas y ediciones rápidas. Pero intenta controlarlos e ilusión se desmorona. En el momento en que añades entrada, el modelo tiene que recordar qué existe, dónde está y cómo se comporta.

Un modelo de mundo invierte la prioridad: recuerda primero, renderiza segundo. Cuesta más inicialmente, datos, entrenamiento, salvaguardas, pero da sus frutos en interactividad. En mis notas, escribí: “La generación de video es una narradora: el modelo de mundo es un director de escena.” No es una analogía perfecta, pero explica por qué Genie 3 se siente diferente. No solo estás preguntando, “¿Puedes hacer que esto se vea como un platformer?” Estás preguntando, “¿Puedo jugarlo dos veces y obtener las mismas reglas?” Ese es el estándar que importa para el trabajo.

Capacidades clave demostradas

Dado que no tuve acceso directo a la construcción de Genie 3, me basé en lo que es visible y consistente en las demostraciones oficiales y documentos, y en lo que pude reproducir con artefactos públicos más antiguos. Aquí están las partes que parecieron significativas:

Dado que no tuve acceso directo a la construcción de Genie 3, me basé en lo que es visible y consistente en las demostraciones oficiales y documentos, y en lo que pude reproducir con artefactos públicos más antiguos. Aquí están las partes que parecieron significativas:

- Escenas de indicación a jugable: Convertir texto o dibujos en pequeños entornos que puedas controlar. En materiales de Genie más antiguos, podía pasar de una hoja de sprites aproximada a un platformer simple en minutos. En demostraciones de Genie 3, la misma idea aparece con mejor estabilidad y secuencias más largas. Los arcos de salto se ven repetibles. Las colisiones se ven menos blandas.

- Persistencia de reglas con el tiempo: Esta es la victoria silenciosa. En la generación de video, los clips más largos a menudo se alejan, los objetos se transforman, la iluminación titila, los diseños se mueven. En modelos de mundo tipo Genie, la “física” y las identidades de objetos persisten. Vi menos roturas de continuidad en los clips de Genie 3 en comparación con los anteriores.

- Estados iniciales editables: Algunos demostraciones muestran sembrar el mundo desde una imagen o diseño, luego jugar desde allí. Eso importa más de lo que suena. Significa que puedo hacer un esbozo en mi herramienta de elección, luego entrar en una prueba jugable sin reconstruir activos.

- Despliegues condicionales de acción: El modelo responde a entradas con resultados consistentes. Presiona izquierda: te mueves hacia la izquierda. Presiona arriba cerca de un saliente: lo atrapas. Esto suena básico, pero es la diferencia entre un juguete y un banco de pruebas.

- Visuales estilizados pero legibles: El aspecto se ubica en algún lugar entre arte de videojuegos retro y video pictórico. No es fotorrealista, que es una característica para muchos flujos de trabajo. Obtienes claridad sin aristas extrañas.

- Horizontes más largos, aún acotados: Noté despliegues que se sienten como decenas de segundos con reglas estables. Pero no son mundos abiertos de sandbox. Los espacios son compactos a propósito, que, francamente, está bien para la mayoría de prototipos.

Donde se frotó un poco:

- Latencia y velocidad de iteración: En experimentos anteriores, a menudo esperaba más de lo que quería que un nuevo “mundo” se estabilizara. Si Genie 3 es más pesado, espero esperas similares. Eso está bien si los resultados son reutilizables, menos bien si estás explorando.

- Control sobre restricciones: Los diseñadores quieren controles: fuerza de gravedad, fricción, tolerancia de colisión. Los demostraciones rara vez muestran botones explícitos. Si existe el control, probablemente está escondido en indicaciones o parámetros ocultos. Me gustaría ver deslizadores visibles.

- Entrega de activos: Incluso cuando una escena se siente correcta, exportarla a un pipeline de producción es no trivial. Extracción de sprites, hitboxes, máquinas de estado, estas son tareas de pegamento. Aún no vi rutas claras en materiales públicos.

Una pequeña alegría de mis pruebas laterales con artefactos anteriores de Genie: la carga mental se redujo. No estaba buscando el “complemento correcto” para fingir física en un mock. Escribí, generé y empujé un personaje. No me hizo más rápido al principio, pero me hizo menos tenso. Eso importó más de lo que esperaba.

Estado actual del acceso

A principios de febrero de 2026, Genie 3 está en tierra de investigación. Hay documentos, charlas y videos de demostración. No he visto una API pública amplia en la que puedas iniciar sesión con una cuenta de Google, y no tengo un lanzamiento de consumidor en ninguna herramienta de Workspace. Si estás leyendo esto después y eso cambió, genial, envíame una nota y lo actualizaré.

Dónde buscar ahora:

- Publicaciones de investigación oficial de Google DeepMind. Comienza con el documento original de Genie y el blog para fundamentación, luego examina charlas de seguimiento que mencionen “Genie 2” o “Genie 3” como iteraciones internas.

- Grabaciones de conferencias y demostraciones de laboratorio. A menudo muestran los despliegues más nuevos meses antes de cualquier vista previa pública.

- Preprints académicos que hacen referencia a “generación de video de modelo de mundo” o “generación de entorno interactivo.” La nomenclatura varía, pero la mecánica rima.

Conclusiones prácticas si estás decidiendo si esperar, construir o ignorar

- Si haces prototipos de interacciones mucho (producto, juego, aprendizaje), mantén un ojo en Genie. Incluso una vista previa pública limitada sería útil para previsualizaciones y pruebas de sensación.

- Si necesitas activos de producción hoy, no planees alrededor de ello. Trátalo como un compañero de bosquejo, no un pipeline.

- Si te importa la replicación de investigación, aún puedes aprender mucho jugando con proyectos de modelos de mundo abiertos como variantes de Dreamer y leyendo secciones de métodos de Genie. Los principios se transfieren.

Añadiré una nota pequeña, ligeramente aburrida. El término de búsqueda “Genie 3 Google” trae una mezcla de publicaciones de Genie más antiguas y noticias de modelos de mundo más nuevas. Algunos escritos difuminan marketing e investigación. Cuando dudes, rastrea afirmaciones al blog de DeepMind o a los PDF de documentos. Ahorra tiempo y mantiene las expectativas estables.