Configuración de entrenamiento LoRA WAN 2.2: mejor tasa de aprendizaje, pasos y palabras clave

Oye mis amigos. ¿Lo sabías? Me gustó cómo WAN 2.2 manejaba la piel e iluminación, pero mis hábitos usuales de entrenamiento LoRA no se tradujeron limpiamente. Los rostros salían demasiado brillantes, y el modelo seguía atrayendo fondos hacia el mismo look de estudio suave. No estaba “mal”, solo no era mío. Entonces, a principios de enero de 2026, ejecuté un puñado de experimentos cortos para encontrar configuraciones de entrenamiento LoRA específicas para WAN 2.2 que sintieran sensatas. Nada llamativo. Solo lo suficiente para reducir el brillo plástico, mantener un sujeto estable, y aún así dejar que el modelo base respire.

Si estás buscando una plantilla rápida: esto no es eso. Estoy compartiendo lo que se mantuvo en múltiples ejecuciones, dónde dudé, y cómo ajusté. La palabra clave objetivo aquí es clara, configuraciones de entrenamiento LoRA WAN 2.2, pero el objetivo es un trabajo más tranquilo, no un nuevo agujero de conejo.

Por qué LoRA de WAN es Diferente

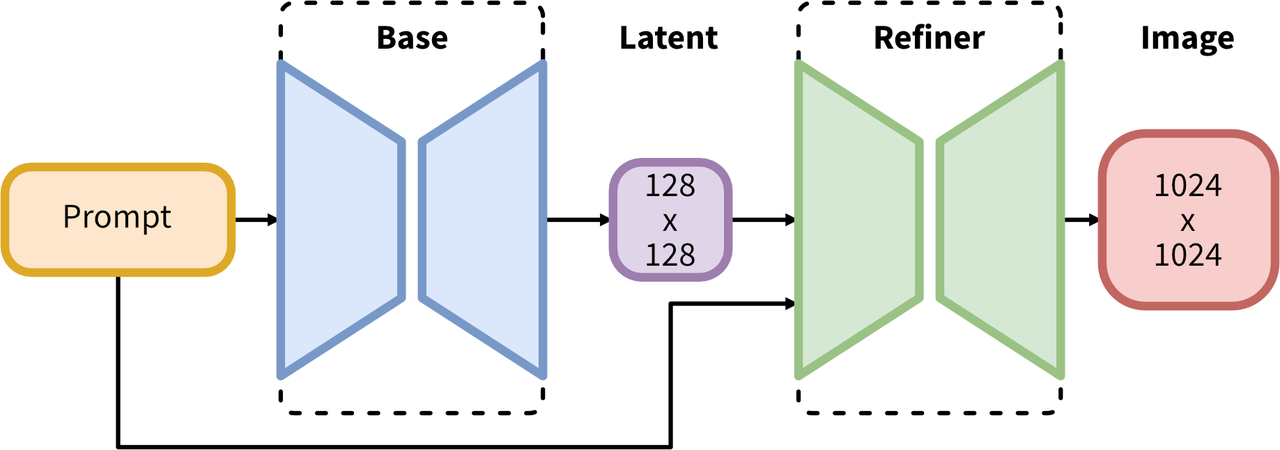

Noté que WAN 2.2 se comporta como un muy obstinado checkpoint SDXL: está sintonizado para retratos nítidos, gradientes suaves, y luz cinemática. Cuando entrenaba LoRAs de la forma en que lo hago en bases SDXL más simples, WAN seguía empujando mis resultados hacia ese ambiente de estudio pulido.

Notas de campo:

- La gravedad del prompt es fuerte. Incluso con pesos ligeros (0.4–0.6), tira hacia piel limpia y encuadres simétricamente.

- El agrupamiento de colores aparece temprano. Si tu conjunto de datos tiende a ser cálido, WAN lo amplifica.

- Los fondos se homogenizan. Sin empujones, por defecto va a poca profundidad de campo y bokeh suave, sin importar qué le proporcionaras.

Lo que cambió en la práctica: reduje las tasas de aprendizaje, usé más imágenes de regularización de las usuales, y mantuve los títulos aburridos a propósito. WAN 2.2 recompensa la moderación. Cuando intenté “enseñar” estilo y tema al mismo tiempo, el sobreajuste se metió rápido.

Si vienes de hábitos LoRA SD 1.5, piensa: menos trucos ingeniosos, líneas base más controladas. Si estás acostumbrado a SDXL, ve un poco más lento que lo normal e integra la regularización antes.

Guía de Tamaño del Conjunto de Datos

Hice cuatro pasadas con conjuntos de retratos curados (5-12 de enero de 2026), cada uno con títulos ordenados e iluminación mixta. Aquí está lo que se mantuvo:

- 8–12 imágenes: Suficiente para anclar una silueta específica de persona o producto. Usa regularización fuerte. Mantén composiciones variadas.

- 15–30 imágenes: Punto dulce para identidad de tema único con estilo leve. Agrega 20–40% de shots no retrato si quieres que los fondos se generalicen.

- 40–80 imágenes: Útil cuando estás codificando un look de marca consistente o una línea de objeto multi-ángulo. Necesitarás títulos cuidadosos y más pasos.

Las cosas que importaron más que el recuento bruto:

- Diversidad de poses sobre diversidad de ubicación. WAN generaliza ubicaciones bien: lucha cuando cada shot es del mismo ángulo.

- Balance de exposición. Si la mitad de tu conjunto está subexpuesto, WAN oscurece todo después. Estandaricé histogramas antes del entrenamiento.

- Simplicidad de títulos. Descriptivos, no poéticos. “subject_token, chaqueta de denim, luz de ventana, primer plano medio” supera “retrato candente sombrío cerca de una ventana lluviosa”.

Para LoRAs de identidad, aterricé en 12–20 imágenes como un piso confiable. Para LoRAs de estilo, 30–50 me dio espacio para respirar sin colapsar al brillo de retrato predeterminado de WAN.

Línea Base LR/Steps

Las configuraciones de entrenamiento LoRA WAN 2.2 que se sintieron estables para mí (Kohya-ss y base SDXL):

- Rank (dim): 16–32. Tengo por defecto 16 para identidad, 32 para estilo.

- Alpha: coincide con dim (p. ej., 16/16). Un alpha más bajo hizo que los resultados fueran frágiles.

- Optimizer: AdamW con weight_decay 0.01.

- Tasa de aprendizaje: 5e-5 para identidad, 7e-5 a 1e-4 para estilo. WAN castiga la alta LR con piel de plástico y picos de pérdida.

- Scheduler: coseno con warmup. Warmup 5% de pasos totales.

- Tamaño de lote: 2–4 (A100/4090). Acumulación de gradiente para simular 8 si es necesario.

- Resolución: SDXL nativa 1024 en el lado largo con bucketing (p. ej., 1024×768, 1024×1024). No agrandres: solo memoriza ruido.

- Epochs/steps: Me detengo por pasos, no epochs.

- 12–20 imágenes: 1,200–2,000 pasos

- 30–50 imágenes: 2,000–3,500 pasos

- 60–80 imágenes: 3,500–5,000 pasos

Verificaciones de cordura que usé:

- Guarda cada 200–400 pasos y previsualiza con un prompt fijo + seed.

- Si las muestras se agudizaban demasiado rápido antes del paso 600, la LR es alta.

- Si la identidad no se bloquea alrededor de ~1,400 pasos en un conjunto de 20 imágenes, los títulos o la regularización están más apagados que la LR.

Estos números no ganarán una tabla de clasificación, pero resisten la tendencia de WAN a lijar todo suave.

Estrategia de Palabra Gatillo

Mantuve los gatillos mínimos. WAN ya tiene un prior fuerte: apilar tokens lindos solo agrega ruido.

Lo que hice:

- Un token de instancia + un token de clase. Ejemplo: “sora_person” como la instancia, “person” o “woman/man” como la clase en títulos.

- Pon el token de instancia al principio de cada título. Mantenlo en minúsculas, una palabra si puedes.

- Evita tokens de estilo en el mismo LoRA a menos que realmente quieras un LoRA de estilo. Mezclar identidad y estilo en WAN 2.2 se volvió confuso rápido.

En prompts, solo llamo al LoRA y al token de instancia, luego superpongo dirección suave:

- lora: nombre a 0.5–0.8

- token de instancia temprano en el prompt

- palabras de estilo tarde y ligero (“luz natural, color limpio, retoque mínimo”)

Intenté gatillos inventados de “estilo WAN” por curiosidad. No ayudaron. La base ya hace esa parte, el LoRA debe tallar lo que necesitas, no re-anunciar en lo que es bueno WAN 2.2.

Imágenes de Regularización

Este fue el héroe silencioso. Usé 1–3x imágenes de regularización por imagen de entrenamiento, coincididas con clase a títulos.

- Para LoRAs de identidad: 20–60 imágenes de reg etiquetadas como la misma clase (“persona”). Las generé de WAN 2.2 mismo con prompts simples: “foto de una persona, fondo neutral, primer plano medio, luz natural”.

- Para LoRAs de objeto: imágenes de reg por clase de producto (“zapato”, “botella”, “silla”). Mantenlas precisas: no mezcles clases.

Por qué importó: A WAN 2.2 le gusta imprimir su estética de retrato en todo. Las imágenes de reg le dieron permiso para mantener el rango de la base mientras dejaban que el LoRA mantenga la identidad. Sin ellas, mis LoRAs sobre-acentuaban el suavizado de piel y bokeh, luego se negaban a irse.

Las configuraciones que se sintieron correctas:

Las configuraciones que se sintieron correctas:

- Mantén imágenes de reg visualmente planas y bien expuestas.

- No subtitules imágenes de reg con tokens de instancia: solo la clase.

- Mezcla 10–20% de lotes de entrenamiento con imágenes de reg a lo largo (no solo al principio).

Si te falta tiempo, agrega imágenes de reg antes de ajustar el optimizer. Es la palanca más grande aquí.

Detección de Sobreajuste

No confié solo en la pérdida. WAN oculta el sobreajuste detrás de muestras bonitas. Estas fueron mis señales:

- Inercia del prompt: cambiar el prompt apenas cambia la salida. Todo se desplaza de vuelta hacia el mismo lente y fondo.

- Plasticidad de piel: los poros desaparecen uniformemente, especialmente alrededor de mejillas y frentes, incluso con prompts de iluminación áspera.

- Eco de poses: ángulos de hombros/cuello repetidos en seeds variadas.

- Bloqueo de color: un tinte cálido que se aferra en diferentes pistas de balance de blanco.

Verificaciones rápidas que ejecuté cada 200–400 pasos:

- Prompt adversarial: cambia a “luz dura de oficina arriba, fluorescente, desfavorable” y ve si la textura regresa.

- Flip de fondo: fuerza “calle concurrida, estantes desordenados” para probar flexibilidad de composición.

- Presión de prompt negativo: agrega “piel sobre-suave, textura de plástico, retoque pesado” y ve si escucha.

Si dos de esas pruebas fallaban en una fila, me remontaba al punto de control anterior y agregaba más imágenes de reg o bajaba la LR un nivel.

Arreglar Colapsos

Golpeé dos tipos de colapso: derretimiento de identidad y bloqueo de estilo.

Cuando la identidad se derritió (rostros derivados, ojos desalineados):

- Baja la LR un paso (p. ej., 7e-5 → 5e-5).

- Aumenta el rank de 16 a 32 solo si el conjunto de datos tiene suficientes ángulos: de lo contrario memoriza poses, no identidad.

- Aprieta títulos: corta adjetivos, mantén pistas de distancia focal, mantén token de instancia primero.

- Agrega 10–20 más imágenes de reg de la misma clase.

Cuando el estilo se bloqueó (todo se veía como el retrato de estudio predeterminado de WAN):

- Agrega shots no retrato al conjunto de datos (ambiental, manos, cuerpo parcial).

- Aumenta pasos por 400–800 con cronograma coseno: no aumentes la LR.

- Reduce el peso LoRA en inferencia (0.8 → 0.5) y empuja la orientación más baja (CFG 5–6 → 3.5–4.5). WAN responde bien a CFG más bajo.

- Si usas noise offset o aumento de color pesado, regréisalos. WAN ya estabiliza el color: aumento extra hizo que mis salidas fueran turbias.

Otros botones que ayudaron:

- Gradient clipping a 1.0 para evitar picos repentinos.

- EMA desactivado para ejecuciones pequeñas: con conjuntos de datos minúsculos, EMA hizo que la identidad se rezagara detrás de previsualizaciones.

- Disciplina de seed: previsualiza con un seed fijo cada vez. Los cambios pequeños son más fáciles de juzgar cuando todo lo demás está quieto.

Exportar y Reutilizar

Algunos hábitos me ahorraron tiempo después:

- Guarda puntos de control incrementales con nombres claros: modelo, rank, LR, pasos, y fecha. Ejemplo: wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors.

- Mantén el prompt de entrenamiento, prompt de validación, y seed en los metadatos LoRA si tu herramienta lo soporta. Yo futuro siempre agradece a yo pasado.

- Uso pegado a versión: LoRAs entrenados en WAN 2.2 funcionaron mejor en WAN 2.2 y hermanos cercanos. Eran usables en otras bases SDXL, pero el manejo de color y piel se desplazó. Los trato como “WAN-first”.

- Defaults de inferencia que se sintieron bien:

- Peso LoRA 0.5–0.8 (identidad), 0.3–0.6 (superposición de aspecto de color)

- CFG 3.5–5.5

- 30–40 pasos con un sampler estable (DPM++ 2M Karras funcionó bien)

- Mantén prompts cortos: WAN escucha nudges sutiles

Si quieres fusionar LoRAs: tuve mejor suerte apilando LoRAs pequeños y de propósito único (identidad a 0.6 + aspecto de color leve a 0.3) que entrenando un LoRA “todo” grande. WAN respeta la modularidad.

Para workflows y ejemplos más detallados de WAN 2.2, consulta la documentación oficial de ComfyUI.

Para el entrenamiento, todavía prefiero ejecutar las cosas localmente donde pueda ver cada botón. Pero cuando se trata de inferencia, enrutamiento de modelos, o cambiar entre modelos base sin malabarismo de APIs, puedes intentar nuestro WaveSpeed. Mantiene diferentes modelos detrás de un punto final consistente para que pueda enfocarme en prompts y salidas en lugar de infraestructura.

Para el entrenamiento, todavía prefiero ejecutar las cosas localmente donde pueda ver cada botón. Pero cuando se trata de inferencia, enrutamiento de modelos, o cambiar entre modelos base sin malabarismo de APIs, puedes intentar nuestro WaveSpeed. Mantiene diferentes modelos detrás de un punto final consistente para que pueda enfocarme en prompts y salidas en lugar de infraestructura.