Requisitos de VRAM de LTX-2: Verificación de Realidad 12GB vs 24GB (4K@50fps Probado)

Hola, soy el tipo que ha personificado la VRAM de su GPU como un casero gruñón que me desaloja en el momento en que organizo una fiesta un poco ambiciosa. Encantado de conocerte—estoy aquí para compartir las cicatrices de batalla de una semana de guerra OOM en enero de 2026.

La primera vez que LTX-2 se me colgó, no fue dramático. Solo una silenciosa caja de “memoria insuficiente” y el tipo de suspiro que guardas para un atasco de impresora. No estaba forzando nada salvaje, un clip corto, prompt básico, pero las matemáticas de VRAM no se importan de las intenciones. El casero gruñón no estaba por la labor. … créeme.

Durante la última semana (enero de 2026), fui tomando notas mientras ejecutaba LTX-2 en una GPU de portátil de 12GB, una tarjeta de escritorio de 16GB y una máquina prestada de 24GB. Nada científico. Solo ejecuciones, reinicios, y una pregunta simple: ¿hasta dónde puedo llegar antes de que VRAM me toque el hombro? Esto es lo que importaba consistentemente.

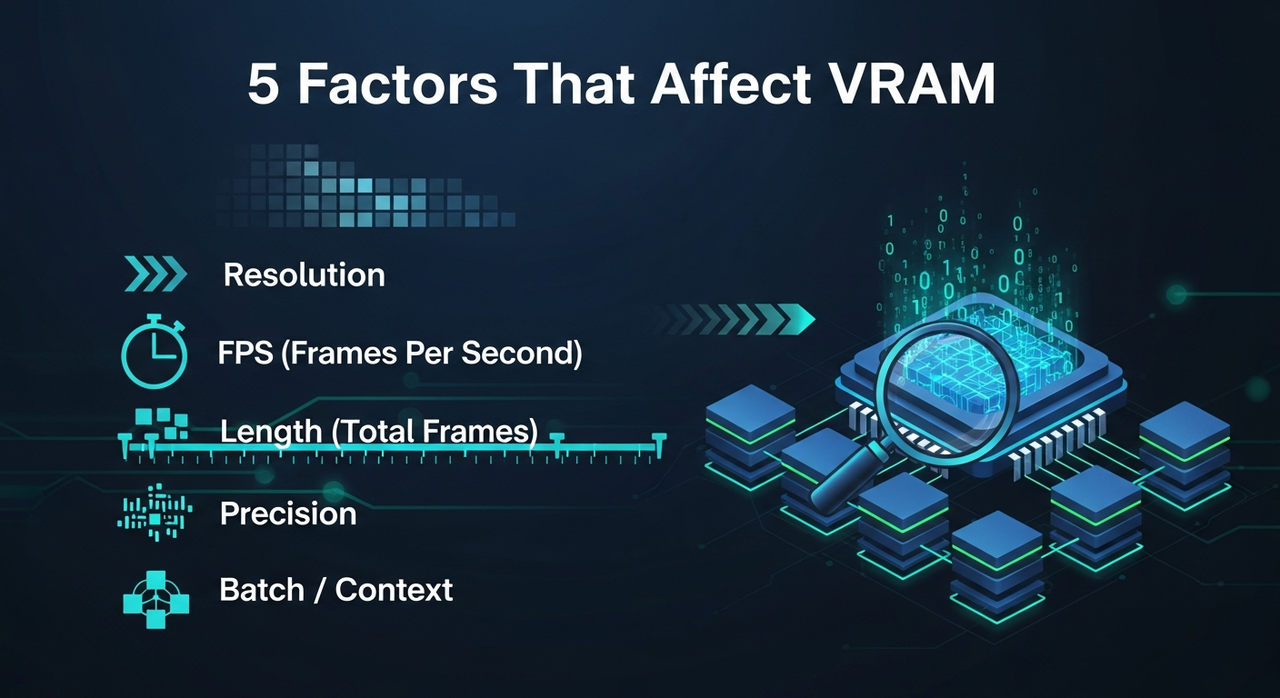

5 Factores Que Afectan la VRAM (resolución / fps / duración / precisión / lote)

Aquí está la lista corta que sentí en la práctica, no solo en los documentos.

Aquí está la lista corta que sentí en la práctica, no solo en los documentos.

1. Resolución

Duplicar el ancho y alto multiplica aproximadamente por cuatro los píxeles. Modelos como LTX-2 lo sienten inmediatamente. De 720p a 1080p es el paso que a menudo convierte una ejecución de bien a frágil. ¿4K sin trucos? Ahí es donde la casa de naipes se tambalea.

2. FPS

Más fotogramas por segundo significa más fotogramas mantenidos o preparados en memoria durante ciertas etapas. Si estás cerca del límite, bajar de 25 a 16 fps es un cambio pequeño que libera una cantidad sorprendente de VRAM y espacio para la consistencia. Déjame decirte, ha salvado más ejecuciones de las que puedo contar.

3. Duración (fotogramas totales)

La duración lo estira todo. Algunos pipelines dividen fotogramas, otros intentan mantener depósitos de contexto más grandes. De cualquier forma, 4–6 segundos es generalmente tranquilo, 10–12 segundos se pone ajustado, 20 segundos es donde empiezo a planificar, no a esperar.

4. Precisión

fp16 es el punto dulce predeterminado para mí. bf16 fue similar en la caja de 24GB, pero fp32 disparó el uso y se sintió inútil para generación. Si ves una ruta de 8-bit o cuantizada que sea estable, vale la pena intentarla en VRAM baja, pero la traté como experimental.

5. Lote / contexto

Cualquier forma de batching, muestreo multi-semilla, o contexto temporal largo actúa como multiplicador. Cuando olvidé restablecer el lote a 1, lo pagué al instante.

Pequeña nota: Habilita atención eficiente/backends si tu compilación los soporta. Vi ganancias modestas de atención eficiente en memoria e I/O con página bloqueada: no es de noche a día, pero es suficiente para evitar que una ejecución se volquee.

Configuraciones del Mundo Real: GPUs de 12GB / 16GB / 24GB

Estas son las configuraciones que pude repetir sin tener que estar pendiente. Las tuyas variarán según el controlador, compilación y lo que más esté haciendo tu sistema.

12GB (portátil clase 3060)

- Estable: 576p–720p, 5–8 segundos, 16–24 fps, fp16, lote=1.

- Marginal: 1080p en menos de 4–6 segundos a 12–16 fps con configuración conservadora.

- Notas: Los picos de VRAM durante los primeros pasos eran el punto de fallo habitual. Mantener las vistas previas apagadas y cerrar otras aplicaciones GPU ayudó.

16GB (escritorio clase 4080)

- Estable: 1080p, 6–10 segundos, 16–24 fps, fp16.

- Marginal: 1080p en 12–15 segundos si bajaba fps o usaba segmentación.

- Notas: Este es el primer nivel donde “simplemente funciona” comienza a aplicarse para 1080p. Aún evitaba batching.

24GB (clase 4090)

- Estable: 1080p, 12–20 segundos, 24 fps, fp16, espacio para ajustes de orientación leves.

- Marginal: 4K a través de tiling o pases segmentados: bien para clips cortos, pero sientes la sobrecarga.

- Notas: Si quieres espacio para experimentos (máscaras, ediciones, prompts más largos), 24GB se sintió tranquilo. No es exceso, solo tranquilo.

4K@50fps: ¿Es Lograble y A Qué Costo?

Respuesta corta: sí, pero no de la forma en que esperaba.

4K directo a 50 fps de LTX-2 es donde VRAM y tiempo ambos protestan. En 24GB, solo logré ráfagas cortas funcionando, y aún así, vi la calidad tambalearse y riesgo de OOM en el momento en que aumentaba la duración.

Lo que funcionó mejor

- Generar a 1080p, 12–16 fps, mantenlo limpio.

- Aumentar escala a 4K con un upscaler dedicado (variantes estilo Topaz o ESRGAN si vives en el lado abierto).

- Interpolar fotogramas a 50 fps con herramientas estilo RIFE/Flowframes.

Compensaciones que noté

- La consistencia temporal se mantuvo mejor cuando aumenté escala primero, luego interpol.

- La interpolación puede añadir una sensación suave de telenovela. Bájala o añade un poco de ruido después.

- Los clips “4K nativos” que se ejecutaron no se veían significativamente mejor que 1080p → aumento de escala para mi uso. Solo tomaron más tiempo y fallaron más.

Entonces: lograble, sí. Vale la pena localmente, generalmente no, a menos que tu clip sea menos de ~5 segundos o realmente necesites pureza de un solo paso.

Estrategias de VRAM Baja (tile / segment / fps más bajo)

Estas son las que seguí recordando.

- Tile inteligentemente: Si el pipeline soporta tiled diffusion/attention, úsalo. Superpón un poco para ocultar costuras. Agrega tiempo, ahorra VRAM, y te mete en territorio 4K en 16–24GB.

- Segmenta por tiempo: Renderiza fragmentos de 3–4 segundos, luego cose. Es molesto, sí, pero domestica picos de VRAM y te deja re-lanzar segmentos problemáticos.

- Baja fps primero, no resolución: Ir de 24 a 16 fps a menudo preservó el aspecto y liberó memoria. Los espectadores notan caídas de resolución más rápido que caídas de fotogramas en duraciones cortas.

- Mantén lote=1: Las ejecuciones multi-semilla son agradables: también duplican tus problemas.

- Apaga las vistas previas: Las vistas previas en vivo a veces mantienen buffers adicionales. Las ejecuciones sin interfaz fueron más estables para mí.

- Precisión mixta activada, precisión exótica desactivada: fp16 mantuvo equilibrio. Traté las rutas de 8-bit como último recurso.

- Offload cuando sea posible: Si tu stack soporta offload a CPU o disco para cachés KV, puede comprarte unos segundos extra al costo de velocidad.

Flujo de Solución de Problemas OOM

Mi reset rápido cuando el casero me desaloja:

- Reinicia el proceso para limpiar residuo de VRAM. No confíes en liberaciones parciales.

- Establece lote=1, desactiva vistas previas, cierra otras aplicaciones GPU.

- Baja fps a 16. Si aún falla, baja resolución un paso (1080p → 900p o 720p).

- Acorta duración por 2–3 segundos. Prueba de nuevo.

- Habilita renderizado tiled/segmentado si está disponible.

- Asegúrate de que fp16 esté activado. Evita bf16/fp32 a menos que sepas que los necesitas.

- Si sigue fallando al inicio, tu pico es demasiado alto (resolución/contexto). Si falla tarde, probablemente sea crecimiento de duración/contexto.

- Último recurso: cambia a una GPU en la nube con más VRAM, termina el renderizado, luego vuelve local.

Recomendaciones por Nivel de GPU

Si estás decidiendo qué comprar o pedir prestado:

- 12GB: Bien para borradores, 576p–720p, ideación rápida, y cortes sociales cortos. Segmentarás mucho.

- 16GB: Buen conductor diario para trabajo 1080p de menos de ~10 segundos. Menos hacks, más flujo.

- 24GB: Cómodo para 1080p más largo, experimentos 4K leves, e intentar opciones avanzadas sin estar pendiente.

- 24GB+ (o GPU multi en la nube): Úsalo cuando los plazos importan, o estás empujando cronogramas 4K con menos compromisos.

No compraría basándome en un solo modelo. LTX-2 evolucionará: tu tolerancia para tiling y costura no.

Cuándo Usar Nube (Comparación de costos WaveSpeed)

Mantengo una hoja simple de “WaveSpeed”, no un servicio, solo una forma rápida de comparar dólares por minuto terminado de video.

Cómo estimo (enero de 2026)

- Nota el objetivo del clip (ej., 4K@50 fps, 10 segundos).

- Cronometra una ejecución limpia local a 1080p, luego suma mi tiempo de upscale/interp.

- Precio una GPU en la nube comparable por hora.

Tasas spot típicas que he visto últimamente

(muy aproximado: verifica tu proveedor)

- Clase L4/A10G: $0.50–$1.20/hr

- A100 40/80GB: $1.50–$3.50/hr

- H100: $3–$7/hr

Ejemplo, mis números la semana pasada

- Caja local 24GB: un pipeline 4K@50 fps de 10 segundos (gen 1080p → upscale → interpolar) tomó ~14 minutos de inicio a fin. Potencia y desgaste es difícil de presupuestar, pero lo llamo $0.10–$0.20/ejecución.

- Nube A100 80GB: el mismo pipeline terminó en ~6–8 minutos. A ~$2.50/hr, eso es aproximadamente $0.25–$0.35 por ejecución.

Entonces mi línea “WaveSpeed” para ese caso:

- Local: más barato por ejecución, más lento, pero sin cola.

- Nube: un poco más por ejecución, más rápido, y menos complicado cuando golpeo OOM.

Cuándo cambio a nube

- Estoy en un plazo y no puedo cuidar arreglos OOM.

- Necesito un pase 1080p más largo o cualquier paso 4K serio.

- Quiero explorar configuraciones sin miedo a fallar.

Cuándo me quedo local

- Borradores cortos, pruebas de aspecto, y exploración de prompts.

- Estoy bien con 720p/1080p y 6–10 segundos.

Esto funcionó para mí, tus costos y tiempos diferirán. Si estás golpeando las mismas paredes que yo, vale la pena echarle un vistazo.

Si estás golpeando límites de VRAM o simplemente no quieres estar pendiente de arreglos OOM, WaveSpeed te permite ejecutar LTX-2 en GPUs en la nube más grandes sin cambiar tu flujo de trabajo. Mantienes tus prompts y configuraciones — el hardware simplemente deja de ser el cuello de botella.

La sorpresa silenciosa: una vez que presupuesté ejecuciones de esta forma, dejé de perseguir “4K@50 nativo” localmente. Solo me aseguré de que el aspecto fuera correcto a 1080p y dejé que el pipeline hiciera el levantamiento.

La sorpresa silenciosa: una vez que presupuesté ejecuciones de esta forma, dejé de perseguir “4K@50 nativo” localmente. Solo me aseguré de que el aspecto fuera correcto a 1080p y dejé que el pipeline hiciera el levantamiento.

Entonces, ¿y tú? ¿Cuál es el crash OOM más ridículo que has sobrevivido con LTX-2? Deja tus historias de guerra (o victorias) a continuación—leo cada comentario y me encanta intercambiar trucos.