LTX-2 ComfyUI Quickstart: Tu Primer Vídeo en 10 Minutos (Soporte Nativo Día-0)

Hola, soy Dora. No planeaba probar LTX-2 en ComfyUI el fin de semana pasado. Solo me encontré con un pequeño problema en un reel para un cliente: necesitaba dos tomas cortas con el mismo estilo, y mis herramientas habituales seguían desviándose. Vi una nota sobre “soporte day-0 de ltx-2 en comfyui,” respiré profundo, y dediqué una tarde a probarlo. Hice pruebas entre el 6 y el 8 de enero de 2026, en mi estación de trabajo principal y una laptop de viaje.

Lo que sigue no es una reseña, solo cómo se sintió realmente poner en marcha LTX-2 dentro de ComfyUI, dónde me ayudó, dónde me complicó las cosas, y qué configuración reutilizaría si tuviera que hacerlo de nuevo mañana.

Qué es el soporte nativo Day-0 (lanzamiento del 5-6 de enero de 2026)

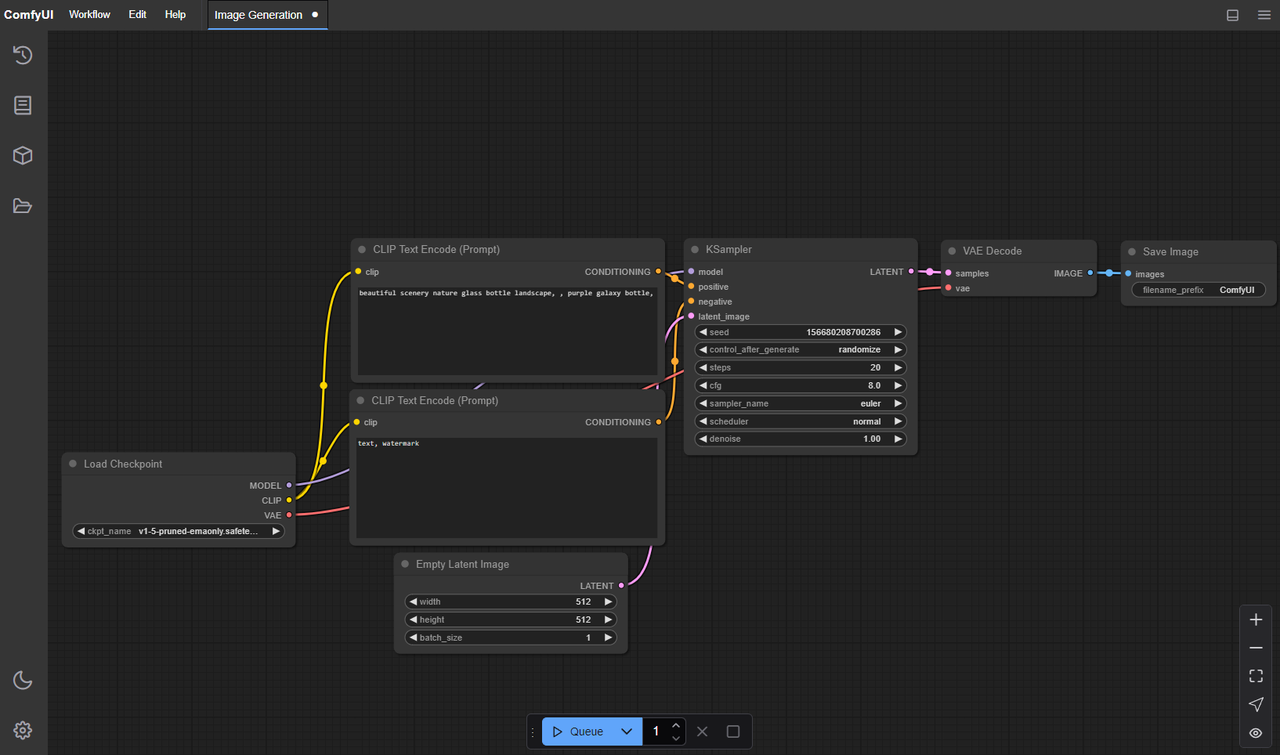

El soporte day-0 aquí significa que LTX-2 se lanza con nodos y un flujo de trabajo de referencia que funcionan dentro de ComfyUI la misma semana que llega el modelo. Sin scripts de compatibilidad, sin bifurcaciones misteriosas. Obtuve los cambios el 6 de enero y vi:

- Nodos integrados etiquetados para LTX-2 (cargador, sampler, y una ruta de vista previa simple).

- Un flujo de trabajo de ejemplo que realmente funciona de principio a fin sin conexiones manuales. No es bonito, pero funciona.

- Enlaces de descarga de modelos que apuntan a los pesos oficiales. Aún tuve que colocarlos en mi directorio de modelos, pero al menos los enlaces coincidían con la documentación.

No esperaba magia, y no la hay. El primer intento se sintió un poco básico: pocas preselecciones, un par de errores crípticos. Pero fue lo suficientemente estable para renderizar clips de 4-6 segundos, y la consistencia de color entre ejecuciones fue mejor de lo que estoy acostumbrada. Para un lanzamiento day-0 en ComfyUI, eso es raro.

Si te importa la reproducibilidad: las semillas funcionaban, y podía ajustar la fuerza del movimiento sin que la escena se colapsara. Esa fue la pequeña sorpresa que me mantuvo explorando.

Requisitos mínimos (GPU / VRAM / versión de ComfyUI)

Esto es de mis propias máquinas. Tu configuración puede variar.

- ComfyUI: una descarga reciente a partir del 6 de enero de 2026. Las bifurcaciones más antiguas me dieron errores de importación de nodos. Si mantienes un entorno de larga duración, considera un venv limpio solo para LTX-2. Sigue la documentación oficial de ComfyUI.

- GPU/VRAM:

- 12 GB VRAM: viable a 512×288 a 512×320, clips de 4-5 segundos, movimiento conservador.

- 16 GB VRAM: 512×512 a 4-6 segundos se sintió cómodo. Ocasionalmente falta de memoria con movimiento agresivo o muchos pasos.

- 24 GB+ VRAM: 768×432 a 768×768 a 5-8 segundos funcionó sin problemas. Buen margen para CFG más alto.

- CPU/RAM: nada inusual. Usé 32 GB de RAM del sistema: el uso se mantuvo modesto.

- Drivers/Runtime: CUDA 12.x, compilación de PyTorch que coincida con tu CUDA. xformers ayudó en la tarjeta de 12 GB pero no fue obligatorio en 24 GB.

Si estás en una GPU de laptop de 8 GB, te saltaría lo local y usaría un ejecutor en la nube por ahora.

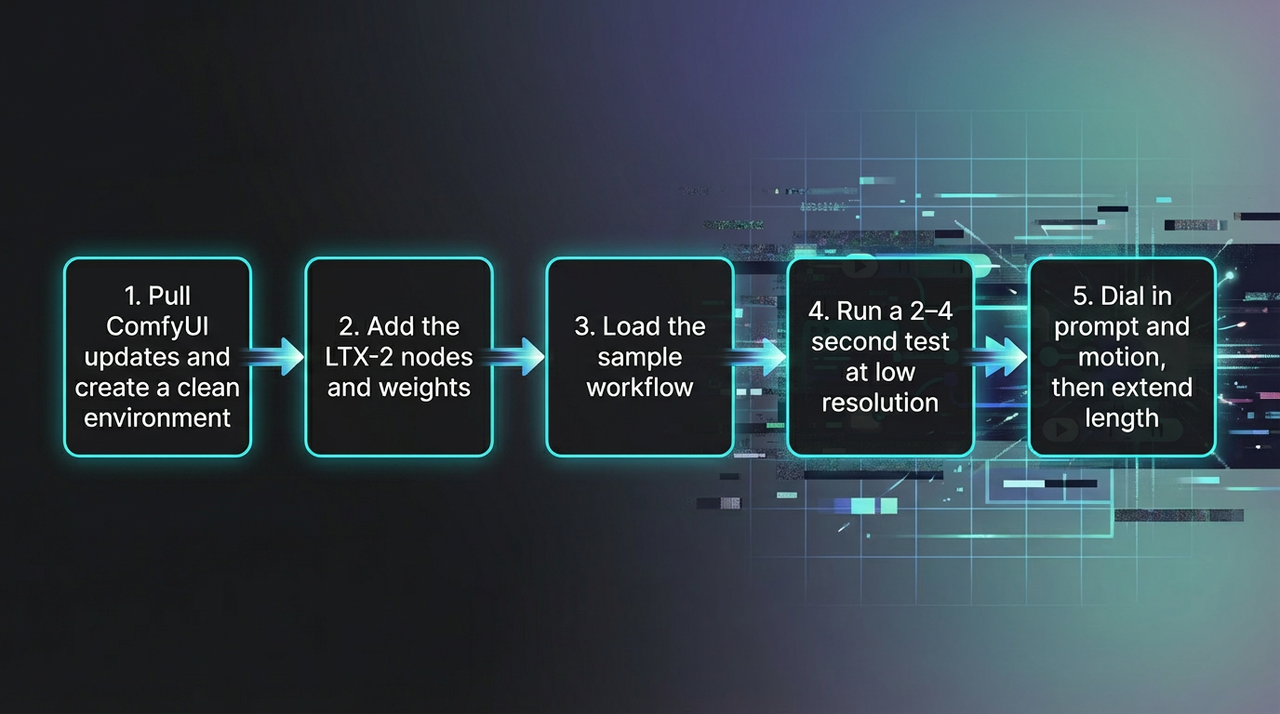

Flujo de trabajo de primer ejecutable en 5 pasos

Este es el camino exacto que tomé el 6 de enero. Sin adornos extras.

Este es el camino exacto que tomé el 6 de enero. Sin adornos extras.

-

Obtén las actualizaciones de ComfyUI y crea un entorno limpio Cloné una carpeta fresca de ComfyUI desde GitHub e instalé los requisitos del archivo incluido. Mezclar nodos antiguos con nuevos modelos de video generalmente causa fallos extraños y silenciosos. Comenzar de cero me ahorró una hora.

-

Añade los nodos y pesos de LTX-2 Usé los nodos LTX-2 agrupados que se lanzaron con la actualización del 5-6 de enero. Para los pesos, seguí los enlaces en la información del nodo y coloqué los archivos bajo

models/ltx(la ruta sugerida). Si tu nodo no puede encontrar pesos, te lo dirá, solo verifica los nombres exactos de los archivos. -

Carga el flujo de trabajo de ejemplo El ejemplo proporcionado me dio una línea base que funcionaba: entrada de indicación de texto, salida de vista previa de video. Cambié solo tres cosas: semilla, resolución y fuerza del movimiento. Mantenerlo simple hizo que los errores fueran obvios.

-

Ejecuta una prueba de 2-4 segundos a baja resolución Mi primer ejecutable fue 512×320, 4 segundos, 16 fotogramas, pasos del sampler en 20. Tomó ~50-70 segundos en una 4090 de 24 GB, ~2-3 minutos en una 3060 de 12 GB. El objetivo no era la velocidad: era verificar el pipeline.

-

Ajusta la indicación y el movimiento, luego extiende la duración Una vez que me gustó el aspecto base, ajusté CFG y la fuerza del movimiento, luego pasé a 6-8 segundos. Si la escena se desmoronaba, retrocedía: reducía el movimiento, fijaba la semilla y mantenía la misma resolución.

Pequeña nota: Guardé cada prueba con la semilla y la configuración en el nombre de archivo. Cuando los clips comienzan a borrarse juntos a la 1 de la mañana, esa pista de migajas es un regalo.

Configuración recomendada (resolución / fps / valores predeterminados de duración)

Estos son puntos de partida que se comportaron bien para mí. Ajusta según tu preferencia.

-

Resolución

- 512×320 o 512×512 para primeros aspectos. Estable, lo suficientemente rápido, fácil en VRAM.

- 768×432 cuando quieras más detalle sin comprometerte con cuadrado.

-

FPS

- 12-16 fps para pasadas de concepto. Verás arcos de movimiento sin tiempos de renderizado pesados.

- 24 fps solo cuando estés confiado en el aspecto: se compone en tiempo y memoria.

-

Duración

- 4-6 segundos es el punto óptimo para iteración. Después de 8 segundos, el modelo comienza a desviarse a menos que tu indicación esté muy anclada.

-

CFG / Pasos

- Comienza CFG en 3-5. Valores más altos añaden contraste pero pueden bloquear demasiado la escena.

- Pasos en 18-24 fueron suficientes en la mayoría de los casos. No vi grandes ganancias pasados los 28.

-

Movimiento

- Mantenlo conservador al principio. Si necesitas movimientos grandes, construye en pequeños ajustes y mantén la semilla fija mientras ajustas.

También mantuve una preselección de “valores sensatos”: 512×512, 16 fps, 6 s, CFG 4, pasos 22, movimiento 0.6. Es aburrido, pero lo aburrido es confiable.

3 indicaciones de copiar y pegar que funcionan

Estas no son palabras mágicas, solo indicaciones que produjeron clips estables y repetibles entre el 6 y el 8 de enero. Incluyo una breve nota de configuración para cada una.

-

Macro de producto con paralaje suave

- Indicación:

"una taza de cerámica simple sobre un escritorio de madera, luz suave de la ventana matutina, profundidad de campo reducida, paralaje lento de izquierda a derecha, colores naturales, grano mínimo" - Notas: Mantén los sustantivos de fondo simples. Si añades lenguaje de marca, tiende a alucinar logos.

- Indicación:

-

Escena callejera con movimiento moderado

- Indicación:

"una calle tranquila de la ciudad al atardecer, letreros de neón reflejándose en el pavimento mojado, llovizna ligera, cámara avanzando lentamente, destello de lente sutil, cinematográfico pero discreto" - Notas: Si tus luces comienzan a parpadear, baja el movimiento y reduce CFG en 1.

- Indicación:

-

Bucle de textura natural

- Indicación:

"primer plano de ondas en un lago, brisa suave, tonos cálidos del atardecer, cámara fija con pequeños micromovimientos, reflejos suaves, ambiente tranquilo" - Notas: Excelente para fondos. El bloqueo de semilla lo mantiene adyacente al bucle si recortas las colas.

- Indicación:

Consejo: Si deseas un control de estilo más ajustado, coloca palabras de tono al principio (“discreto, luz natural, composición limpia”) antes de objetos. Pareció anclar mejor la paleta.

Errores comunes del primer ejecutable + soluciones rápidas

Estos fueron mis baches reales y lo que los solucionó.

-

CUDA sin memoria al inicio

- Solución: baja primero la resolución, luego los pasos, luego el movimiento. Si estás en 12 GB, mantente en ancho 512 y clips de menos de 6 segundos. Cierra navegadores que consumen VRAM (en serio).

-

Nodo no encontrado / clase faltante

- Solución: actualiza ComfyUI a los commits del 5-6 de enero: elimina nodos personalizados más antiguos que agrupen cargadores de video heredados, luego relanza. Si el error apunta a un nombre de nodo específico, busca duplicados en tu carpeta

custom_nodes.

- Solución: actualiza ComfyUI a los commits del 5-6 de enero: elimina nodos personalizados más antiguos que agrupen cargadores de video heredados, luego relanza. Si el error apunta a un nombre de nodo específico, busca duplicados en tu carpeta

-

Archivo de pesos no detectado

- Solución: coincide con el nombre exacto de archivo que espera el nodo. Mantén rutas solo ASCII; evita enlaces simbólicos en Windows si es posible. Reinicia ComfyUI después de mover archivos.

-

Torch / CUDA no coinciden

- Solución: asegúrate de que tu compilación de PyTorch coincida con tu kit de herramientas CUDA. Si no te importa depurar, usa la rueda pip sugerida en el README de ComfyUI GitHub

para tu GPU.

para tu GPU.

- Solución: asegúrate de que tu compilación de PyTorch coincida con tu kit de herramientas CUDA. Si no te importa depurar, usa la rueda pip sugerida en el README de ComfyUI GitHub

-

FFmpeg no encontrado para exportar

- Solución: instala FFmpeg y añádelo a PATH. Como alternativa rápida, exporta fotogramas y ensambla con cualquier codificador en el que confíes.

-

Parpadeo o desviación de estilo a mitad del clip

- Solución: reduce el movimiento, baja CFG en 1-2, y mantén indicaciones limpias. Sobredescribir tiende a luchar contra la consistencia temporal.

Consejo profesional: Si nada funciona y estás en un plazo ajustado, renderiza a 12-16 fps y ralentízalo a 24 fps en postproducción con mezcla de fotogramas. No es elegante, pero es tranquilo en una tormenta.

Lo que me gustó

- Sin luchas de dependencias. Estaba probando una indicación en menos de cinco minutos.

- Valores predeterminados razonables. La primera salida no fue perfecta, pero no fue caos.

Lo que se interpuso en mi camino

- Menos control que un gráfico ComfyUI completo. Echaba de menos poder conectar pasos posteriores personalizados.

- Tiempo de cola. Mi espera más larga fue ~6 minutos durante las horas pico.

Para quién es útil

- Si estás explorando aspectos y no quieres tocar drivers, es fácil.

- Si necesitas un pipeline reproducible con versiones y semillas rastreadas en proyectos, ComfyUI local sigue ganando.

- Si solo necesitas ejecutar LTX-2 inmediatamente sin configuración, WaveSpeed te permite renderizar en un navegador y verificar indicaciones antes de comprometerte con un pipeline local.

Esto funcionó para mí; tu experiencia puede variar. Si estás viajando o en una GPU de 8 GB, vale la pena echarle un vistazo.

Un pequeño pensamiento para terminar: LTX-2 dentro de ComfyUI no me hizo más rápida de inmediato. Sí aclaró mis opciones: menos botones que importaban, más que no. Eso, más que la velocidad, es lo que noto una semana después.