Cómo usar DeepSeek V4: Guía rápida de inicio para API y chat

Hace tiempo que no nos vemos, amigos. Soy Dora. Me topé con un pequeño problema una mañana de martes: necesitaba convertir un conjunto desordenado de notas en algo listo para entregar, y mi modelo habitual seguía derivando hacia una verborrea alegre. Quería respuestas directas, menos empujones. Eso fue lo que me impulsó a probar DeepSeek V4. Lo probé en enero de 2026 en el chat web y la API. Lo que sigue no es un recorrido de características. Es cómo lo hice funcionar, dónde se sintió sólido, y dónde todavía vacilo.

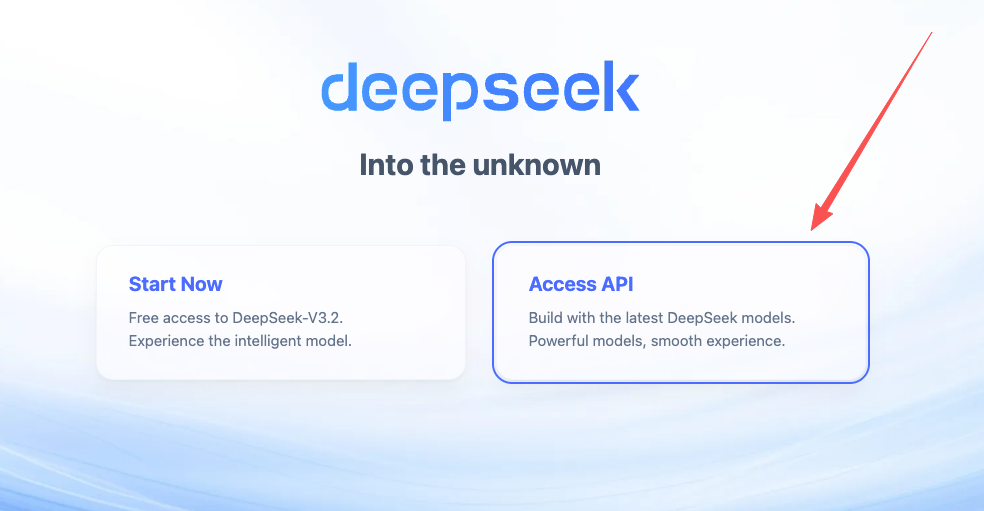

Opciones de acceso en el lanzamiento

Comencé simple: sin código, solo el chat web. Luego pasé a la API cuando necesitaba ejecuciones repetibles. Si prefieres jugar primero con prompts y conectar las cosas más tarde, este camino es constante y de bajo esfuerzo.

Interfaz de chat web

Inicié sesión a través del sitio principal y elegí V4 de la lista de modelos. Si has usado otras interfaces de chat, esto te resultará familiar: mensaje del sistema arriba, turnos de chat abajo, parámetros guardados.

Lo que ayudó:

- Escribí un mensaje del sistema breve que reflejaba cómo pienso: “Sé directo. Cita suposiciones. Si estás adivinando, dilo.” Eso evitó que el modelo sobre-explicara.

- Mantuve la temperatura baja (alrededor de 0.2) para redactar especificaciones o comentarios de código. Cuando quería alternativas de redacción o nombres, la aumentaba a 0.5.

- Usé un ritual simple antes de cada nuevo hilo: pegué un pequeño bloque de contexto. Dos líneas. “Proyecto: limpieza de documentos internos. Voz: clara, concisa, sin metáforas.” Evitó que V4 se desviara, y también me obligó a ser honesto sobre lo que realmente necesitaba.

Fricciones:

- Los chats largos a veces se volvían vagos. Reiniciar el hilo y pegar un contexto fresco funcionó más confiablemente que intentar controlar la situación a mitad de camino.

- La copia/pegado de formato era correcto, pero aún prefiero capturar salidas a través de la API para cualquier cosa que necesite ejecutar más de una vez.

Si solo necesitas ayuda ocasional, borradores más limpios, refactorización rápida, correos electrónicos más precisos, la interfaz web es suficiente. Pero si quieres consistencia en todas las tareas (mismo estilo, misma estructura, sin sorpresas), la API es donde se estabiliza.

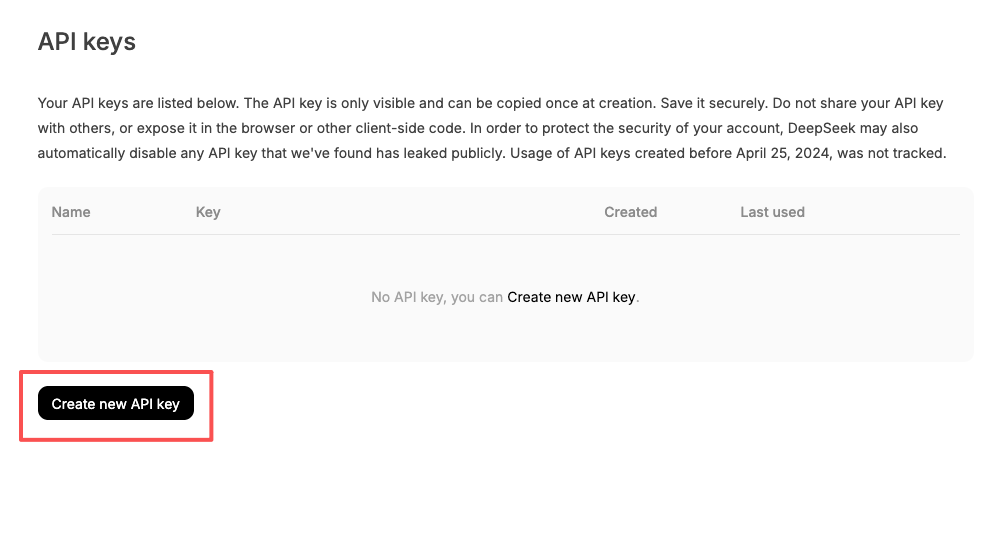

Acceso a la API

Creé una clave API desde el panel de mi cuenta y la metí en mi entorno. Nada elegante:

- macOS/Linux: export DEEPSEEK_API_KEY=”…” en tu perfil de shell.

- Windows PowerShell: setx DEEPSEEK_API_KEY ”…” y reinicia la terminal.

La API de DeepSeek sigue la forma de chat-completions ahora familiar. Si has usado clientes compatibles con OpenAI, es prácticamente plug-and-play. Lo principal a observar es el nombre del modelo; V4 está disponible, pero el identificador exacto puede cambiar. Verifiqué la cadena del modelo actual desde el panel antes de hacer llamadas.

Para la privacidad: evito enviar secretos o datos de clientes a menos que haya confirmado la política de retención. También enmascaro IDs y uso valores falsos en los prompts. Toma 30 segundos y previene futuras molestias.

Si quieres el punto de partida oficial, la puerta más segura es el enlace de documentos del sitio principal: DeepSeek. El área de cuenta generalmente tiene los endpoints actuales, nombres de modelos, y límites de velocidad.

Tu primera llamada API

Me gusta hacer una solicitud pequeña y aburrida primero. Me dice si la autenticación está conectada, el nombre del modelo es válido, y las respuestas se ven como espero. Después de eso, la incorporo a un script.

Autenticación

Usé un token Bearer en el encabezado de Autorización y mantuve la clave en una variable de entorno. Reduce la probabilidad de que la confirme accidentalmente o la deje caer en un fragmento compartido. Aquí está la forma que probé en enero de 2026:

- Encabezado: Authorization: Bearer $DEEPSEEK_API_KEY

- Endpoint: la ruta de chat-completions mostrada en la documentación de tu cuenta

- Modelo: verifica la cadena exacta para V4 en el panel (por ejemplo, “deepseek-v4”), ya que la nomenclatura puede cambiar

Una pequeña nota: si tu organización enruta solicitudes a través de un proxy, prueba primero con curl. Es más fácil ver qué realmente va por el cable.

Solicitud básica

Mi primera llamada pide al modelo que resuma un texto breve con un formato estricto. Si un modelo sigue el formato en el primer intento, confío más en él para tareas estructuradas después.

Curl (compacto, fácil de differenciar después):

curl -s https://api.your-deepseek-endpoint/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-d '{

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": "Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\nFormat:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"}

]

}'Python (usando un cliente genérico compatible con OpenAI):

from os import getenv

import requests

API_KEY = getenv("DEEPSEEK_API_KEY")

URL = "https://api.your-deepseek-endpoint/v1/chat/completions"

payload = {

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": (

"Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\n"

"Format:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"

)},

],

}

resp = requests.post(

URL,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json",

},

json=payload,

timeout=30,

)

resp.raise_for_status()

print(resp.json()["choices"][0]["message"]["content"])Lo que busco en la salida:

- ¿Mantuvo la estructura exacta (línea de Resumen, luego puntos de Riesgos)?

- ¿Hay coberturas o palabras de relleno que no pedí?

- Si ejecuto nuevamente con el mismo prompt a temperatura 0, ¿obtengo el mismo formato?

Mis ejecuciones fueron limpias: V4 siguió el formato sin desviarse y manejó bien las instrucciones tersas. Eso generalmente es una buena señal para tareas posteriores como redacción de registros de cambios o comentarios de código. El principal riesgo era el presupuesto de tokens; las respuestas que incluyen entrada larga citada pueden desbordarse. Lo arreglé trimando entradas y pidiendo primero salidas más cortas, luego expandiendo según fuera necesario.

Primera tarea de codificación para intentar

Me gustan las pequeñas automatizaciones que te pagan inmediatamente. Lo primero que probé fue un pequeño ayudante que renombra archivos de captura de pantalla en títulos legibles. No es glamoroso. Muy útil.

Configuración que usé (enero de 2026)

Configuración que usé (enero de 2026)

- Una carpeta llena de imágenes como Screenshot 2026-01-18 at 11.02.31.png

- Un archivo YAML con algunas reglas (nombre del proyecto, formato de fecha)

- Un prompt que pide a V4 que produzca un script y un plan de ejecución en seco antes de tocar archivos

Prompt que envié a través de la API

You are helping me write a safe file-renamer. Requirements:

- Input: directory of PNG/JPG screenshots.

- Output: dry-run first: then rename.

- Pattern: {project}-{short-title}-{YYYYMMDD}.{ext}

- Short titles: extract from on-screen window titles if present: otherwise infer 2–4 words from file metadata: avoid stop words.

- Constraints: no overwrites: lowercase: hyphens only: log actions.

Return:

1) Risks (3 bullets)

2) Plan (numbered steps)

3) Python script (<= 120 lines)

4) One test case (pytest-style) using a temp directory.Qué pasó:

Primer intento: el script se veía bien pero se saltó la bandera de ejecución en seco. Le pedí que insertara una opción CLI “—dry-run” con un predeterminado de verdadero. Cumplió y mantuvo el código bajo el límite de línea.

Segundo intento: adivinó en la análisis EXIF. La empujé a encerrar eso detrás de un try/except y continuar sin fallar. Después de eso, funcionó limpiamente.

Por qué esta es una buena primera tarea:

Obliga un formato cuidadoso y E/S simple. Puedes validar la corrección sin leer cada línea, solo ejecutar con una carpeta ficticia y ver el registro. Expone casos límite rápidamente (espacios, colisiones, nombres largos).

Lo que noté sobre V4 aquí:

Responde bien a restricciones en lenguaje simple. “Sin sobrescrituras: minúsculas: solo guiones” funcionó mejor que una plantilla larga. Se mantuvo con los pies en la tierra cuando le pedí un plan antes del código. Esa pequeña pausa nos ayudó a ambos. Podría detectar pasos faltantes antes de que produjera nada peligroso.

Límites y compromisos:

No es un sustituto para leer el código. Todavía reviso las operaciones de archivo inseguras e importaciones inesperadas. Para scripts más largos, divido la tarea: plan → funciones principales → envoltorio CLI → pruebas. V4 respetó la secuencia más que algunos modelos que he usado, pero aún puede mezclar pasos si soy vago.

Quién se beneficia:

Creadores que quieren utilidades rápidas y seguras. Equipos que prefieren estructura consistente en todos los prompts. Personas que valoran el formato predecible sobre la creatividad llamativa.

Quién podría frustrarse:

Cualquiera que espere que un modelo intuya reglas comerciales sin escribirlas. Personas que quieren salidas largas de un solo disparo. Los bucles más pequeños funcionan mejor aquí.

Por qué esto me importa:

Una vez que un modelo obtiene las cosas simples de manera confiable: formato, planes cortos, temperatura baja, el resto de mi flujo de trabajo se vuelve más ligero. Pienso en V4 como un par de manos confiable. No magia. Solo confiable.

Si tienes curiosidad, prueba el mismo patrón con una tarea diferente mañana: genera un registro de cambios a partir de mensajes de commit, o produce pasos de migración a partir de un diff de esquema. Mantén la restricción de plan primero, y ve si tu carga mental baja un nivel. La mía lo hizo.

Seguiré probando V4 con documentos más largos la próxima semana. Me pregunto cómo maneja resúmenes citados sin inflar la salida. Silenciosamente esperanzada, pero dejaré que las ejecuciones me lo digan.

Preguntas frecuentes

¿Cuál es la forma más rápida de comenzar con DeepSeek V4: chat web o API?

Comienza en el chat web para iterar en prompts con configuración mínima, luego pasa a la API para consistencia y ejecuciones repetibles. El chat funciona bien para borradores más limpios o refactorización rápida. Para estilo estable, formato estricto y automatización, la API proporciona salidas más constantes y predecibles.

¿Cómo uso DeepSeek V4 a través de la API?

Crea una clave API, almacénala en una variable de entorno, y envía una solicitud de chat-completions con Authorization: Bearer. Verifica el nombre exacto del modelo (por ejemplo, deepseek-v4) en tu panel. Comienza con un pequeño prompt de prueba estructurado a baja temperatura para confirmar autenticación, formato y comportamiento determinista.

¿Cómo usar DeepSeek V4 para mantener respuestas concisas y con formato?

Establece un mensaje del sistema breve que establezca reglas de estilo (por ejemplo, sé directo, establece suposiciones). Mantén la temperatura baja (alrededor de 0–0.2) para especificaciones y salidas estructuradas. Proporciona un pequeño bloque de contexto al inicio de cada hilo, y solicita un plan antes del código. Esto reduce la desviación y mejora la adherencia al formato.