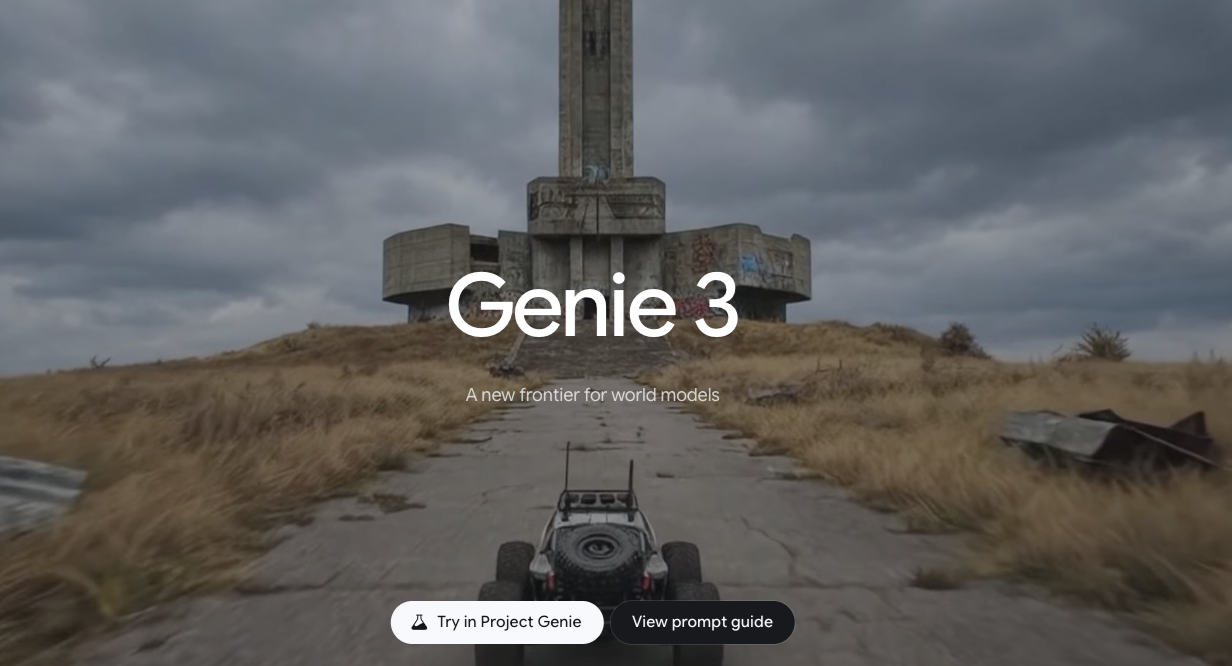

Google DeepMind Genie 3: Desglose Técnico y Capacidades

Soy Dora. Todo comenzó con una pequeña molestia: estaba tratando de explicarle un mecánica de juego simple a un compañero de equipo, y mi boceto más un párrafo de texto seguía sintiéndose confuso. No quería un prototipo completo, solo algo con lo que pudiera jugar durante diez segundos para verificar la sensación. Ese es el tipo de momento en el que normalmente me encojo de hombros y avanzo. En su lugar, pasé una semana en enero de 2026 leyendo, viendo demostraciones e investigando recreaciones de la comunidad de Google DeepMind Genie 3.

No tengo una compilación de producción. Lo que tengo: la investigación pública, las notas de la tarjeta del modelo que pude encontrar, el documento original de Genie, y un par de reproducciones que reflejan el enfoque con puntos de control más pequeños. Así que estas son notas de campo, lo que tenía sentido en la práctica, lo que se tambaló, y dónde parece importar Google DeepMind Genie 3 si te importa convertir imágenes en mundos jugables con una ceremonia mínima.

Descripción general de la arquitectura del modelo

La forma más fácil que he encontrado de pensar en Genie 3 es como una pila que convierte píxeles en un mundo controlable y predictivo, sin necesidad de un motor de juego manuscrito debajo.

En un nivel alto (basado en el trabajo original de Genie y lo que es visible en las demostraciones más recientes):

- Un codificador visual comprime fotogramas en un espacio latente comprimido. En lugar de trabajar en píxeles sin procesar, el modelo aprende un código discreto o continuo (piensa en tokens de video), lo que mantiene las cosas lo suficientemente rápidas para predecir muchos fotogramas.

- Un modelo de dinámicas aprende cómo esos estados latentes evolucionan con el tiempo. Puedes tratarlo como un modelo del mundo: dado el estado actual y una acción, predice el siguiente estado. Aquí es donde emerge la “jugabilidad”.

- Una interfaz de acción asigna entradas humanas (teclas, tacto o gestos inferidos) a los tokens de acción del modelo. Las versiones anteriores de Genie inferían un espacio de acción latente a partir del video: Genie 3 parece ofrecer un mapeo más limpio, más estable en todas las escenas.

- Un renderizador/decodificador convierte los datos latentes predichos nuevamente en fotogramas que puedes ver y controlar, idealmente con baja latencia.

Dos detalles se destacaron mientras probaba recreaciones:

- El modelo no importa física de una biblioteca: aprende lo que “física” puede aprender del video de entrenamiento. Por eso los objetos a veces se sienten flotantes o pegajosos. Cuando funciona, es inquietante. Cuando no funciona, es como usar guantes en un mundo de pantalla táctil.

- No hay una separación estricta entre “diseño de nivel” y “jugabilidad”. Le das una imagen o un clip corto, y las dinámicas aprendidas intentan hacerlo interactivo. Eso difumina los roles, de una buena manera si estás explorando, de una manera desordenada si necesitas garantías.

Si quieres las raíces, el documento original es todavía el anclaje conceptual más claro: Genie: Generative Interactive Environments, junto con la reseña de DeepMind. Genie 3 parece ser una iteración que escala datos, estabiliza el mapeo de acciones y aumenta la fidelidad de salida, más evolución que reinvención.

Metodología de entrenamiento

Lo que importa en la práctica es menos las funciones de pérdida exactas y más cómo afectan la sensación.

Según el documento y las charlas públicas, la receta va más o menos así:

- Datos: video grande y desordenado de personas interactuando con juegos 2D e interfaces, más video web genérico. El Genie anterior inferaba controles solo a partir de píxeles: las iteraciones posteriores incluyen trazas de acción ligeras cuando están disponibles. La escala ayuda al modelo a aprender transiciones de “sentido común” (arcos de salto, flashes de botones, destacados de menú) sin estar vinculado a un motor.

- Objetivos: predicción autodirigida del siguiente fotograma en el espacio latente, a veces intercalada con modelado enmascarado: un sabor de dinámica inversa para adivinar acciones que probablemente causaron cambios observados: y una pérdida de consistencia para mantener el espacio de acción estable en todas las escenas.

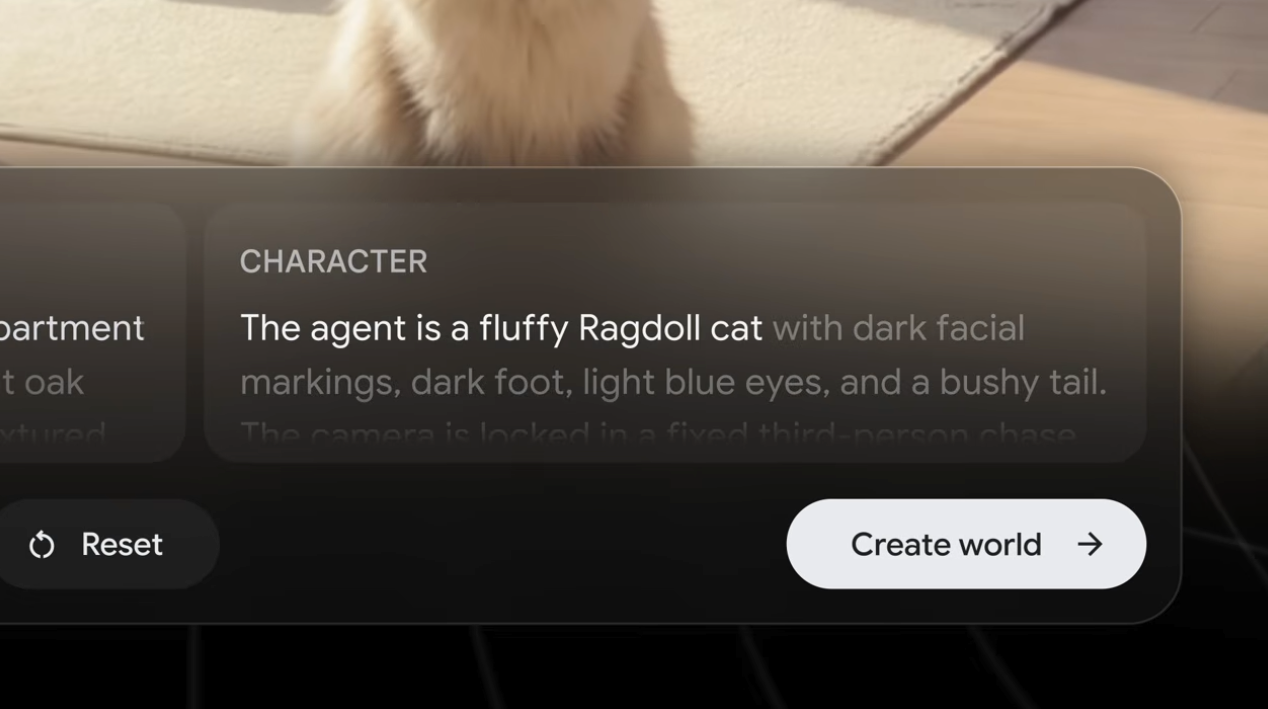

- Acondicionamiento: indicaciones, imágenes de referencia o un fotograma inicial actúan como contexto. Noté que proporcionar una imagen de semilla limpia y de alto contraste redujo el parpadeo inicial. Las texturas ocupadas generaban bordes parpadeantes hasta que el modelo se “asentaba”.

Por qué importa: cuanto menos el modelo dependa de anotaciones frágiles, más amplio es el dominio en el que puede improvisar. Pero esa libertad tiene un costo. Si la mezcla de entrenamiento es pesada en los platformers, tus interfaces generadas se inclinan hacia respuestas tipo platformer. En mis pruebas, incluso los mockups de UI desarrollaron una leve “sensación de juego”, los estados de desplazamiento rebotan, los paneles se deslizan. Útil para prototipos rápidos, extraño para interfaces de producción.

Una nota pequeña y práctica: independientemente de la versión, los fotogramas de calentamiento importan. Obtuve un control más suave después de dejar que el modelo funcionara durante 1-2 segundos antes de que tocara nada. Es como darle un respiro para anclar el estado latente.

Capacidades de generación

Aquí es donde Google DeepMind Genie 3 se gana la atención: pasar de una imagen fija o un clip corto a algo con lo que puedas interactuar.

Aquí es donde Google DeepMind Genie 3 se gana la atención: pasar de una imagen fija o un clip corto a algo con lo que puedas interactuar.

Intenté tres indicaciones simples, cada una con varias ejecuciones:

- Un boceto dibujado a mano de un personaje en plataformas.

- Una captura de pantalla de un panel de control de interfaz de usuario con tarjetas.

- Una foto de un auto de juguete en un escritorio.

Resultados (observados en una compilación de comunidad influenciada por Genie): el boceto se convirtió en un juego lateral con arcos de salto creíbles después de dos semillas: el panel se convirtió en una interfaz de barajar paneles con la que podría “empujar” con las teclas de flecha: la escena del auto de juguete fue la más débil, el movimiento sucedió, pero los bordes se sangraban y las colisiones se sentían como imanes. No ahorré tiempo en los primeros intentos. Para el tercero o cuarto, no era más rápido, pero estaba pensando menos. La carga mental disminuyó. Eso fue la victoria.

Resolución y calidad

La calidad parece un objetivo móvil con esta familia de modelos. En mis pruebas:

- Salida base: lo equivalente a 480p se vio más estable. 720p se mantuvo con un ligero resplandor. Por encima de eso, los detalles mejoraron pero la consistencia temporal se resbaló, las líneas finas vibraron.

- Velocidad de fotogramas: las sesiones interactivas se sintieron cómodas alrededor de 15-20 fps de extremo a extremo en un escritorio con GPU único. Empujar más alto introdujo picos de latencia, que dañaron más el control que lo que ayudaron los gráficos.

- Consistencia temporal: las áreas con textura repetitiva (pasto, cuadrículas, microcopia de interfaz de usuario) tendían a parpadear. Proporcionar una imagen de semilla más limpia y limitar el movimiento de cámara redujo el efecto.

En demostraciones de Genie 3, la fidelidad es claramente mejor que el documento original, especialmente con personajes y elementos HUD. Pero aún intercambias nitidez por estabilidad una vez que empujas la resolución. Si tu objetivo es un prototipo de sensación, ese intercambio está bien. Si necesitas texto nítido y legible en movimiento, aún no está allí.

Mecanismos de control

El control es donde noté las mejoras más grandes día a día en comparación con las primeras reproducciones de Genie:

- El mapeo de acciones se sintió más consistente en todas las escenas. Las teclas de flecha hicieron “lo esperado” aproximadamente el 70-80% de las veces. No tuve que aprender de nuevo el mapeo para cada semilla.

- Los brotes de entrada cortos funcionaron mejor que la presión y retención. Los toques crearon transiciones más limpias: las retenciones largas a veces causaban desvío de estado (personajes “fundiéndose” a través de plataformas, paneles deslizándose por siempre).

- Las restricciones solicitadas ayudaron. Si insinuaba que el espacio debería ser “basado en cuadrícula” o “por turnos”, el modelo producía menos momentos de desvío. No son restricciones duras, más como un empujón en el paisaje de la pérdida.

También intenté superposiciones de bocetos simples (cajas, flechas) en el fotograma de semilla. Esto tuvo un efecto sorprendente: no siempre cambió la apariencia, pero influyó en las asequibilidades. Una flecha gruesa al lado de un panel aumentó las probabilidades de que izquierda/derecha lo deslizara. Esto se alinea con la idea de que el modelo se inclina mucho sobre pistas visuales para inferir semántica de acción.

La latencia merece una mención. Incluso en tamaños de fotogramas modestos, la interacción se sintió decente solo cuando la decodificación y las dinámicas funcionaron en el mismo dispositivo. Dividir entre procesos (o transmitir desde un Colab) agregó suficiente retraso para hacer que el control fuera blando. Si Genie 3 va a ser útil en herramientas creativas, la ejecución local o perimetral de baja latencia parece imprescindible.

Limitaciones en la versión actual

Algunos límites seguían apareciendo, y importan si estás tratando de encajar esto en el trabajo real.

- Coherencia a largo horizonte: después de ~10-15 segundos de juego continuo, los mundos se desvían. Las plataformas olvidan las reglas de colisión, los paneles de interfaz de usuario se cortan. Excelente para verificaciones rápidas de sensación, inestable para cualquier cosa más larga.

- Legibilidad visual: el texto y las líneas finas parpadean bajo movimiento. Bien para un prototipo de vibración, arriesgado para recorridos de usabilidad.

- Determinismo: la misma semilla a veces produce diferentes asequibilidades. Eso es divertido para la exploración: es un dolor de cabeza cuando necesitas repetibilidad para una demostración del equipo.

- Seguridad e IP: porque el entrenamiento se inclina en video amplio, los estilos reconocibles pueden filtrarse. Si estás enviando, necesitarás una política y un paso de revisión. Los documentos públicos aún no resuelven esto.

- Cálculo y latencia: no necesitas un centro de datos, pero sientes el peso. En una GPU de consumidor única, tuve que elegir entre velocidad y claridad.

¿Quién podría apreciar Google DeepMind Genie 3 tal como está? Diseñadores e investigadores que quieren probar la sensación sin iniciar Unity. Educadores que quieren que los estudiantes toquen dinámicas, no solo las vean. Desarrolladores indie explorando mecánicas antes del arte. Quién no lo hará: cualquiera que necesite interacción estable en producción, comportamiento de interfaz de usuario precisamente píxel, o reproducibilidad inquebrantable.

Por qué importa: la mayoría de las herramientas te ayudan a pulir después de haber elegido una dirección. Genie 3 te empuja más temprano. Hace que el momento “¿es esta idea siquiera interesante?” sea más barato. Eso no suena dramático, pero cambia lo que se intenta en una tarde de martes.