Extensión ComfyUI-LTXVideo: Soporte LoRA, Flujos de Trabajo y Cuándo lo Necesitas

La primera vez que probé ComfyUI LTXVideo, no estaba buscando nuevas funciones. Solo quería una forma estable de convertir un guión gráfico tosco en movimiento sin estar pendiente de cada fotograma. Mi pequeña fricción: un error más de “nodo faltante” después de un día largo. Casi cierro la ventana. En su lugar, le di la semana (principios de enero de 2026) y lo pasé por algunos proyectos reales: un bucle de producto de 12 segundos, un fragmento educativo para un curso, y uno de esos experimentos de textura a movimiento que se ve o muy inteligente o muy extraño.

Lo que encontré no fue magia. Pero sí hizo que el trabajo se sintiera más ligero en algunos lugares tranquilos. Esa es generalmente la señal que busco.

Núcleo incorporado vs. Extensión: ¿Cuál es la diferencia?

Seguí viendo a gente hablar sobre “soporte de LTXVideo en ComfyUI”, pero no quedaba claro qué era nativo y qué necesitaba partes adicionales. Aquí está lo que noté en la práctica.

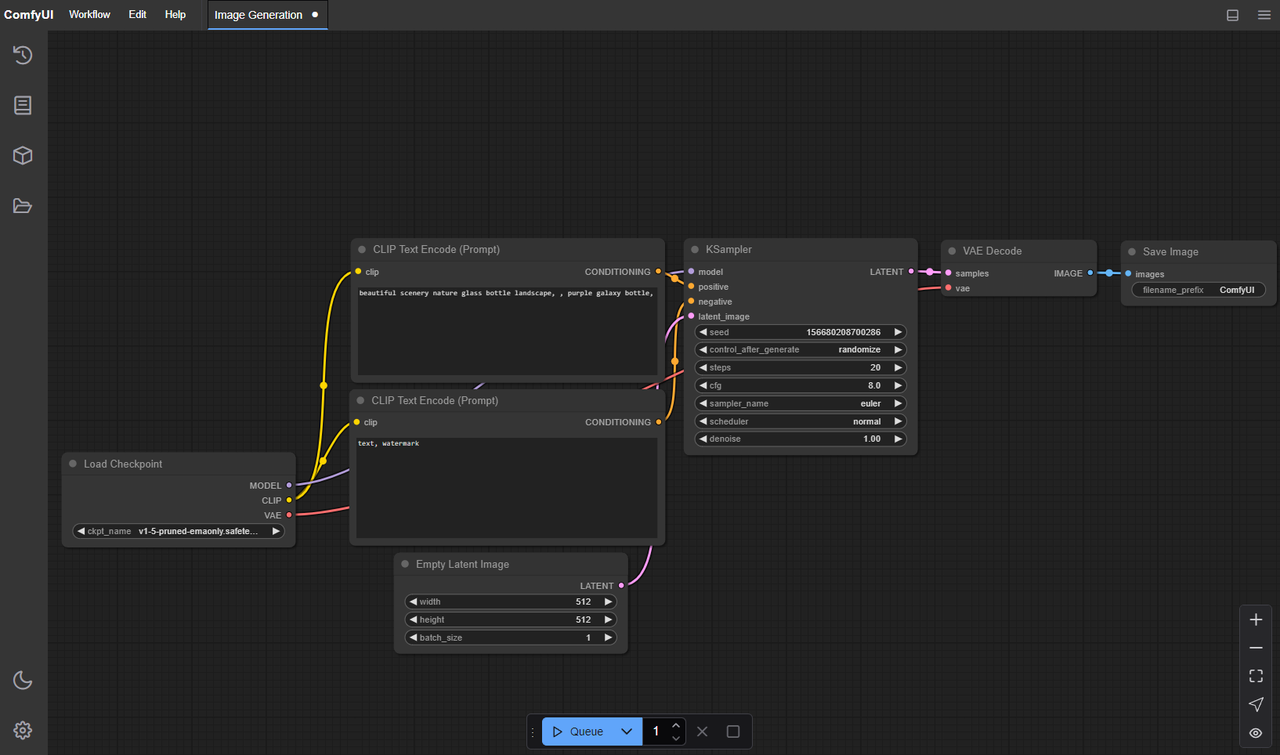

- Núcleo (base de ComfyUI): Puedes conectar flujos generales de texto a imagen/video, programar samplers y gestionar acondicionamiento. La aplicación base es muy sólida para enrutar datos, previsualizar fotogramas y mantener las ejecuciones reproducibles. Pero no incluye nodos especializados de LTX-Video por defecto.

- Extensión (nodos personalizados de LTXVideo): Esto agrega nodos conscientes del modelo (cargadores, samplers, bloques de acondicionamiento) construidos alrededor de la arquitectura de LTX-Video. La extensión entiende la longitud de movimiento del modelo, ventanas de contexto y las pequeñas restricciones que no se mapean limpiamente con nodos genéricos.

La diferencia aparece cuando intentas hacer menos pegamento manual. Con solo nodos base, estaba malabarismo con formas de tensor, adivinando valores predeterminados e incurriendo en desajustes de forma. Con la extensión instalada, el gráfico se hizo más corto y los errores bajaron. Aún tenía que pensar, solo no sobre plomería.

Un pequeño ejemplo: construí un bucle de 8 a 12 segundos con iluminación coherente con la escena. Solo con el núcleo me tomó ~45 minutos para estabilizarse: la versión de extensión se ejecutó limpia en el segundo intento (unos 15 minutos), porque el sampler precableado y el ensamblador de video manejaron la alineación de fotogramas sin que yo tuviera que ocuparme de ello.

Entonces, si estás evaluando: el núcleo es suficiente si te gusta el control total y no te importa conectar. La extensión es para cuando te importa más tener ejecuciones repetibles que tuberías personalizadas.

Lo que agrega la extensión (flujos de trabajo / nodos / LoRA)

No esperaba mucho cuando hice clic en los gráficos de ejemplo, he visto demasiados flujos de trabajo “iniciadores” que son básicamente capturas de pantalla. Estos fueron mejores que eso.

Lo que me ayudó:

- Nodos propósito-construidos: Cargador de modelo para LTX-Video, un selector de longitud de movimiento que evita recuentos de fotogramas impares, y un sampler que respeta los puntos dulces de tiempo del modelo. Eliminan algunos obstáculos que generalmente aparecen solo después de un renderizado fallido.

- Flujos de trabajo de ejemplo: Tres a los que seguí volviendo, base de texto a video, imagen a video con inyección de movimiento, y transferencia de estilo usando LoRA. Cada uno es lo suficientemente claro para comenzar, pero no tan rígido que no puedas intercambiar partes.

- Ganchos de LoRA: La extensión expone la fortaleza de LoRA y la combinación de manera limpia. Podría apilar un LoRA de estilo con un LoRA de identidad ligera y aún mantener el movimiento estable. Debo decir, eso es raro en configuraciones de video tempranas.

Una pequeña sorpresa: el manejo de color predeterminado se sintió más tranquilo que la mayoría de los modelos de video abiertos que he probado. Los azules no explotaron. La piel se mantuvo dentro de un rango creíble. Aún tuve que ajustar la exposición, pero no estaba apagando fuegos de saturación.

Límites que encontré:

- Las secuencias largas (más de ~12–16 segundos) se desviaban a menos que introdujera fotogramas clave de anclaje o dividiera la ejecución. Eso es normal en esta etapa, pero vale la pena señalar.

- El apilamiento pesado de LoRA puede tambalear el movimiento. Dos está bien, tres es arriesgado a menos que reduzcas las fortalezas.

Pasos de instalación y actualización

Preparación

- Actualiza ComfyUI a una compilación reciente. Usé la compilación nocturna de enero de 2026 en ambas máquinas.

- Python 3.10–3.11 funcionó mejor. Mantuve un venv fresco por máquina.

Instala la extensión LTXVideo

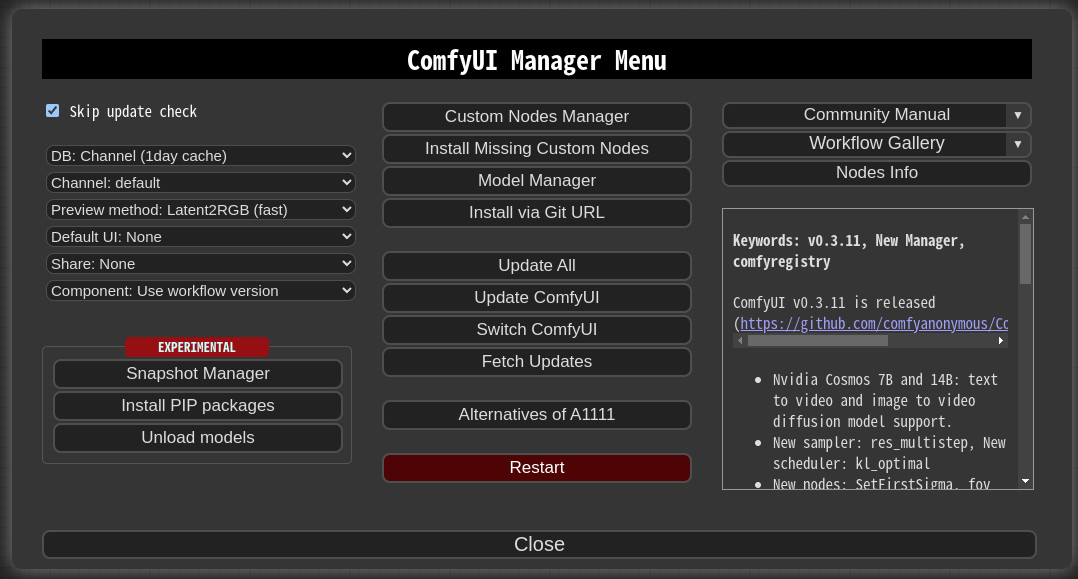

- Usa ComfyUI-Manager si lo tienes: Busca “LTXVideo” o “ComfyUI-LTXVideo” e instala.

- Ruta manual: clona el repositorio en ComfyUI/custom_nodes. Luego instala los requisitos (

pip install -r requirements.txt) dentro de tu entorno.

Modelos

- Coloca el punto de control de LTX-Video donde la extensión lo espera. La mayoría de las versiones buscan en

models/ltxvideoomodels/checkpoints: el nodo generalmente te dice la ruta exacta al pasar el cursor. - Si estás usando LoRA, colócalos en

models/loras(o lo que el nodo enumere como predeterminado).

CUDA y tiempos de ejecución

- Linux con CUDA 12.x y PyTorch 2.3+ funcionó sin problemas. En macOS, Metal funcionó, pero mantuve tamaños de lote pequeños.

- Si ves picos de memoria en la primera ejecución, reduce la longitud de movimiento o establece una precisión de decodificación más baja si el nodo la expone.

Actualizaciones

- Extrae lo último del repositorio de extensión. Reinstala los requisitos cuando los commits principales lleguen (me encontré con un desajuste de torch-vision y un bump de protobuf: ambos se arreglaron con una reinstalación limpia).

- Borra la caché de ComfyUI si los nodos no aparecen después de una actualización. Un reinicio rápido a menudo resuelve las importaciones obsoletas.

Costo de tiempo: La primera instalación me tomó ~20 minutos en una caja Linux limpia, ~30 minutos en macOS porque tuve que re-vincular algunas compilaciones de metal. Las actualizaciones fueron de minutos a menos que las dependencias cambiaran.

Recorrido de flujos de trabajo de ejemplo

Ejecuté tres flujos de trabajo varias veces cada uno, ajustando lo suficiente para ver qué tan estables son.

Ejecuté tres flujos de trabajo varias veces cada uno, ajustando lo suficiente para ver qué tan estables son.

1. Texto a video (línea de base)

- Configuración: Prompt, prompt negativo, el cargador de LTX-Video, el sampler del modelo, y un escritor de video a 512–768 en el borde corto. Mantuve la longitud de movimiento a 8–12 segundos.

- Observaciones: El primer paso rara vez acertaba el ritmo exacto, pero me dio una “toma base” estable. El segundo paso con ediciones menores de prompt arregló la mayoría de los problemas. Cada renderizado fue de 2–4 minutos en el A6000, ~6–8 en el M3 Max.

- Pequeño consejo: Si el movimiento se ve flotante, aprieta la guía temporal o reduce CFG un poco. Para mí, 4.5–6.5 fue la banda utilizable.

2. Imagen a video con inyección de movimiento

- Configuración: Una única imagen de referencia, más un LoRA de estilo de baja fortaleza para mantener la textura consistente. Usé el nodo de movimiento de la extensión para empujar la deriva de cámara en lugar de dejar que invente movimiento.

- Observaciones: Esto no ahorró tiempo en el primer intento, sobre-ajusté. En la tercera ejecución, me di cuenta de que redujo la carga mental: menos artefactos para clasificar, menos sorpresas de “¿qué es eso en la esquina?”

- Nota práctica: Si el sujeto se deforma alrededor del fotograma 3–5, agrega una imagen de pista de secuencia media o fotograma de anclaje. Usé dos anclajes para un clip de 10 segundos y se sintió bloqueado.

3. Estilo con LoRA (más identidad ligera)

- Configuración: Prompt base, un LoRA de estilo a 0.6–0.8, LoRA de identidad a 0.2–0.3, y movimiento conservador.

- Observaciones: La combinación se mantuvo mejor de lo que esperaba. Más fuerte que 0.8 en estilo comenzó a “brillar” las texturas, bien para carteles, extraño para movimiento. Mantener la identidad baja evitó cambios inquietantes.

- Exportación: Escribí a ProRes para calificación. H.264 está bien para controles rápidos, pero los colores se veían mejor cuando hice un pase ligero en Resolve.

En todas las ejecuciones, ahorré quizás 15–20 minutos por clip comparado con coser nodos genéricos. La ganancia más grande fue menos reinicios. Menos ajustes, más decisiones.

LoRA e IC-LoRA Conceptos básicos

Suelo recurrir a LoRA solo cuando lo necesito. Con LTXVideo, vale la pena el paso extra, especialmente para la consistencia.

Suelo recurrir a LoRA solo cuando lo necesito. Con LTXVideo, vale la pena el paso extra, especialmente para la consistencia.

- LoRA: Piénsalo como una huella digital estilística ligera. En video, empuja suavemente. Las fortalezas superiores a ~0.8 se ven frágiles conforme el movimiento se acumula.

- LoRA de identidad: Útil para mantener un personaje o producto estable en todos los fotogramas. Me gustaron los valores en el rango de 0.15–0.35.

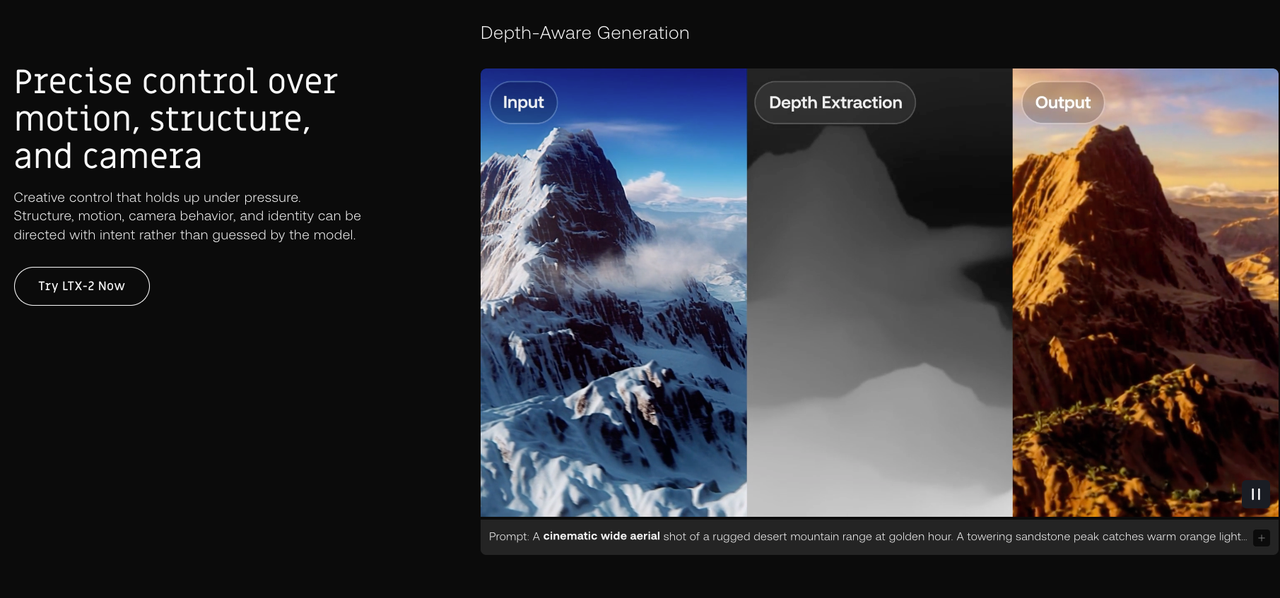

- IC-LoRA (LoRA condicionado por imagen): Aquí encontré el valor práctico más grande. Alimentar una imagen de referencia limpia en IC-LoRA estabilizó detalles (logos, caras) sin congelar la escena. Usé una imagen clara de frente y a veces un ángulo lateral como señal secundaria.

Lo que importa en la práctica:

- Las referencias limpias vencen a los prompts inteligentes. Basura adentro, basura afuera, y se muestra más en movimiento.

- Mezcla menos, ajusta más ligero. Dos LoRAs aplicadas ligeramente funcionaron mejor que tres peleándose entre sí.

- Re-semilla si aparece micro-parpadeo. Una nueva semilla más los mismos anclajes a menudo resolvieron pequeños parpadeos faciales.

Correcciones de “nodo faltante”

Encontré tres tipos de “nodo faltante” mientras probaba. Ninguno fue dramático, pero sí rompen el flujo.

- Extensión no cargada: Asegúrate de que la carpeta LTXVideo esté en

ComfyUI/custom_nodesy que tenga un__init__.py. Reinicia ComfyUI. Si el registro muestra errores de importación, reinstala los requisitos para ese nodo. - Cambio de dependencia: Los desajustes de Torch/CUDA se manifiestan como errores de importación. Alinea las versiones de PyTorch y CUDA listadas en el README de la extensión. Un venv fresco es más rápido que depurar uno enredado.

- Flujos de trabajo antiguos, nodos nuevos: Algunos gráficos hacen referencia a nodos renombrados. Abre el JSON, busca la clase del nodo y mapearlo al nombre nuevo. Los CHANGELOGs de extensión generalmente anotan estos.

Comprobaciones rápidas de cordura:

- Actualiza ComfyUI-Manager, luego “escanea las actualizaciones”.

- Borra la caché de ComfyUI y reinicia.

- Confirma las rutas de modelo en el nodo de carga, un punto de control faltante se ve igual a un nodo faltante desde el punto de vista de la interfaz.

Aplica estos flujos de trabajo en WaveSpeed

Probé una ejecución en la nube para ver cómo esto se traduce lejos de mi escritorio. En WaveSpeed, giré un espacio de trabajo de ComfyUI con una GPU de clase RTX e introduje la extensión LTXVideo de la misma manera.

Dos notas si sigues esta ruta:

Dos notas si sigues esta ruta:

- Mantén tus modelos organizados: Sincronicé puntos de control de LTX-Video y LoRAs en las carpetas esperadas (

models/ltxvideo,models/loras) primero, luego abrí los gráficos de ejemplo. Créeme, sin sorpresas una vez que las rutas coincidieron. - Longitudes de ejecución: Una GPU en la nube me permitió probar clips de 12–16 segundos a mayor resolución sin preocuparme por VRAM. No arregló la deriva por sí solo, pero hizo la iteración más rápida, podría renderizar tres tomas en paralelo y elegir el ganador.

Si estás trabajando en una laptop, esta es una forma de bajo estrés para probar ideas antes de comprometerse con instalaciones locales. Los resultados pueden variar, pero me ahorró algunos bucles de compilación a altas horas de la noche.

El pequeño pensamiento persistente: LTXVideo dentro de ComfyUI no intenta deslumbrarte de frente. Solo reduce la cantidad de cosas que tienes que mantener en tu mente a la vez. En días ocupados, eso es suficiente.