Batch-Generierung auf WaveSpeed: Führen Sie täglich 1.000+ Bildanfragen mit Sicherheit aus

Hallo, Leute! Ich bin Dora. Das Ganze begann mit einer kleinen Unannehmlichkeit: Ich brauchte einige hundert Varianten von Bildern für einen Test, und meine übliche Schleife mit einzelnen Anfragen fühlte sich an wie das Schieben eines Einkaufswagens mit einem blockierten Rad. Immer wieder hörte ich, dass Batch-Generierung auf WaveSpeed große Volumen bewältigen kann. Ich brauchte kein großes Tamtam. Ich wollte einfach, dass sich die Arbeit leichter anfühlt.

Also über ein paar Sessions im späten Dezember und wieder diese Woche habe ich eine einfache Batch-Pipeline auf WaveSpeed eingerichtet und sie gebeten, mehr als 1.000 Bildanfragen zu verarbeiten. Keine Kunststücke, nur stetiger Durchsatz, klare Zustände und saubere Wiederholungen. Unten ist die Form, die für mich funktionierte, die Teile, die im Weg standen, und die kleinen Entscheidungen, die Kosten und Fehler unter Kontrolle hielten, während meine Aufmerksamkeit woanders war.

Übersicht der Batch-Architektur

Producer / Queue / Worker / Storage

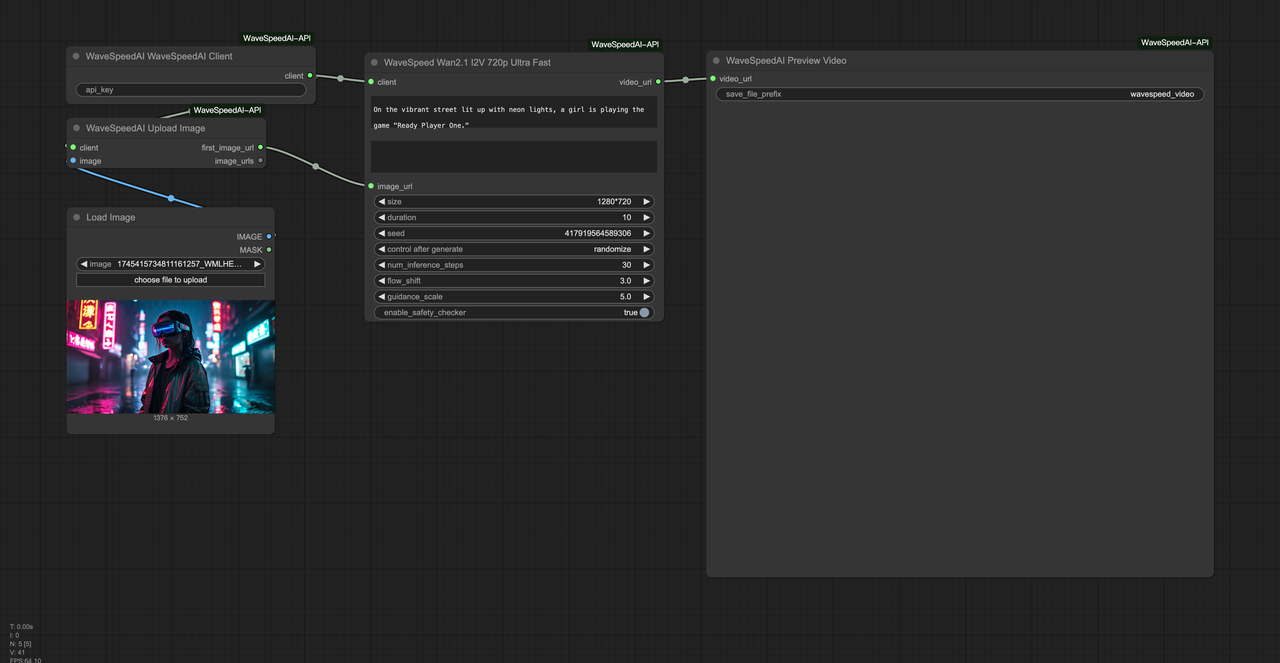

Ich hielt die Teile absichtlich einfach. Ein kleines Producer-Skript sammelt Prompts und Metadaten, eine Queue hält Jobs, zustandslose Worker rufen die WaveSpeed-Bild-API auf, und Storage speichert die Ergebnisse. Jeder Teil kann fehlschlagen, ohne das ganze System zum Einsturz zu bringen.

- Producer: Liest eine CSV-Datei von Prompts und Pro-Bild-Einstellungen (Modell, Größe, Seed). Es schreibt einen Job pro Zeile in die Queue mit einem Idempotency-Schlüssel und einer soft deadline.

- Queue: Ich habe Redis Streams und RabbitMQ jeweils einmal verwendet. Beide funktionieren. Wenn Sie noch nicht mit einem von ihnen arbeiten, ist Redis leichter zu beginnen.

- Workers: Containerisierte Prozesse, die Jobs abrufen, WaveSpeed aufrufen, Ergebnisse in den Objektspeicher schreiben (ich habe S3 verwendet) und Status aktualisieren. Sie sind zustandslos, daher ist Skalierung ein Schieberegler, keine Neuerstellung.

- Storage: Ein Bucket für Bilder, einer für JSON-Metadaten. Einfache Ordner nach Datum und Batch-ID halten alles übersichtlich.

Was mich überraschte, war, wie wenig Code sich änderte, als ich von 100 auf 1.200 Bilder skalierte; die meisten Probleme waren um Pacing und Schutz vor Duplikaten, nicht um Durchsatz.

Einfaches Architektur-Diagramm

Hier ist das Bild, das ich im Kopf behielt:

Producer → Queue → Workers → WaveSpeed API → Storage

↓ ↑

State DB ←────────→ Metrics/Alerts- Die State DB kann die gleiche Redis oder eine leichte Postgres-Tabelle sein.

- Metrics senden Warnungen, wenn Fehlerraten oder Kosten seltsam werden.

Es ist nicht clever. Das ist der Punkt. Wenn die API intermittente 429/5xx zurückgibt, puffert die Queue es auf. Wenn ein Worker während der Ausführung abstürzt, wird er ein anderer nach Sichtbarkeitszeitüberschreitung abgeholt.

Concurrency-Strategie

Sichere Parallelismusebenen

In meinen Durchläufen startete ich mit 5 Workern, jeder mit 2 parallelen Anfragen. Das gab mir einen stetigen Durchsatz von 8–10 Bildern/Minute ohne Limits zu überschreiten. Das Erhöhen auf 20 gleichzeitige Anfragen funktionierte kurz, dann sah ich, dass Wiederholungen spikten. Die beste Einstellung war nicht die schnellste Spitze, sondern der flachste Durchschnitt.

Wenn Sie das versuchen: Finden Sie die kleinste Anzahl von Workern, die Ihre Queue vor dem Wachsen bewahrt. Dann gehen Sie schrittweise vor. Beobachten Sie p95-Latenz und Fehlerraten für 10–15 Minuten, bevor Sie etwas ändern.

Bewusstsein für Ratenlimits

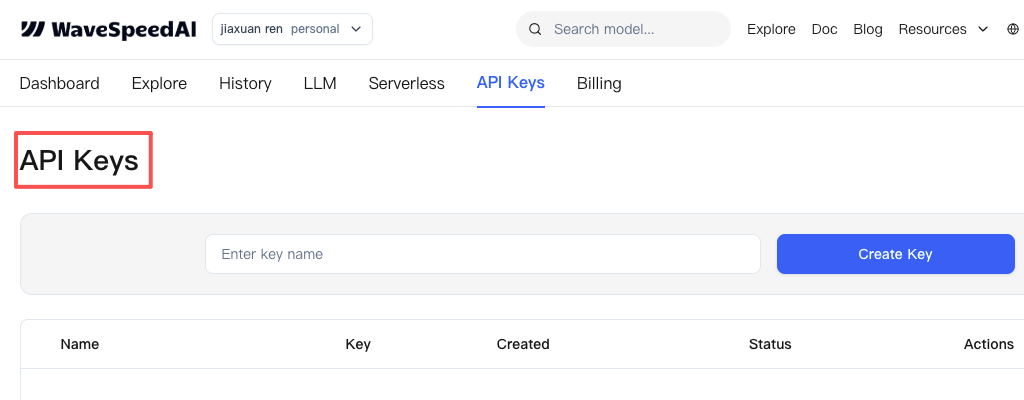

WaveSpeed veröffentlicht Rate-Limit-Anleitungen in der Dokumentation, aber Limits variieren dennoch mit Modell und Konto. Ich habe zwei Schutzvorrichtungen hinzugefügt:

- Client-seitiger Token-Bucket: Jeder Worker erwirbt einen Token vor dem Aufrufen der API. Tokens werden mit dem effektiven RPS des Plans wieder aufgefüllt. Als ich Modelle änderte, passte ich die Nachfüllung an.

- Backoff-Disziplin: 429 und 5xx werden durch exponentielles Backoff mit Jitter ausgelöst, begrenzt auf 30 Sekunden. Dies verhinderte Stampeden nach kurzen Ausfällen.

Ich habe auch jeden Job mit Modell + Größe markiert, damit ich separate Parallelisierungsgrenzen pro Modell bei Bedarf setzen konnte. Es ist nicht raffiniert, nur ein kleiner switch-Anweisung, aber es half, lokale Hot Spots zu vermeiden.

Retry & Idempotenz

Vermeidung von Duplikat-Bildern

Mein erstes Batch hatte einen stillen Bug: Ein Worker stürzte nach dem API-Aufruf ab, bevor er in den Storage schrieb. Die Queue wiederholte den Job und ich endete damit, zwei identische Generierungen zu bezahlen. Nicht schön.

Um dies zu stoppen, habe ich den Storage-Pfad deterministisch vom Idempotency-Schlüssel und Input-Hash gemacht. Wenn eine Wiederholung das bereits geschriebene Bild findet, wird es kurzgeschlossen und markiert den Job einfach als Erfolg. Billige Reparatur, große Erleichterung.

Implementierung des Idempotency-Schlüssels

Ich verwendete einen SHA-256 des normalisierten Prompts + Modell + Seed + Größe + Guidance. Dieser Hash wird zu:

- dem API-Idempotency-Schlüssel (gesendet in einem Header oder Payload-Feld, je nach SDK)

- dem Storage-Dateinamenpräfix

- dem Primärschlüssel der Datenbank für den Job

Wenn die API von WaveSpeed Idempotency-Schlüssel respektiert (überprüfen Sie die Dokumentation für Ihren Endpunkt), geben wiederholte Aufrufe mit dem gleichen Schlüssel das gleiche Ergebnis ohne zusätzliche Gebühren zurück. Falls nicht, verhindert die Storage-First-Überprüfung immer noch Duplikate, die Sie zweimal bezahlen würden.

Wiederherstellung fehlgeschlagener Jobs

Nicht jeder Fehler verdient einen weiteren Versuch. Meine Faustregel:

- Wiederholen: 429, 5xx, Netzwerk-Timeouts, “Modell beschäftigt” oder vorübergehende Storage-Fehler

- Nicht wiederholen: 4xx mit Validierungsfehlern, fehlenden Parametern oder offensichtlich schlechten Eingaben

Ich begrenzte Wiederholungen auf 5 mit exponentiellem Backoff. Danach landet der Job in einer Dead-Letter-Queue mit der Fehler-Payload. Einmal täglich sortiere ich DLQ-Jobs: Einige erhalten korrigierte Eingaben und werden erneut eingeplant, andere werden mit einer Notiz archiviert. Dies hielt meine Gesamtfehlerrate unter 1,5% für einen 1.200-Bild-Durchlauf.

Job-Zustandsverwaltung

Status: pending/running/success/failed

Ich habe ein paar Zustandsformen ausprobiert. Die einfachste blieb hängen:

- pending: in der Queue, noch nicht von einem Worker geleast

- running: vom Worker geleast mit Lease-Ablauf

- success: Bild und Metadaten geschrieben, Überprüfungen bestanden

- failed: terminal, mit Fehlercode und letztem Versuchszeitstempel

Ich habe zwei optionale Felder hinzugefügt, die sich auszahlten: attempt_count und last_response_code. Sie machten Dashboards lesbarer und Debugging weniger ratend.

Umgang mit Job-Timeouts

Zwei Timeouts sind wichtig:

- Lease-Timeout: Wenn ein Worker während der Ausführung abstürzt, sollte der Job nach N Sekunden zu pending zurückkehren. Ich habe 120s verwendet.

- API-Timeout: Wenn WaveSpeed nicht innerhalb von N Sekunden antwortet, brechen Sie ab und wiederholen Sie mit Backoff. Ich habe 60s pro Aufruf verwendet.

Wenn die API langsam ist, können diese beiden kämpfen. Um doppelte Arbeit zu vermeiden, markiere ich nur running → pending nach Ablauf des Leases und wenn der Herzschlag eines Workers stoppt. Heartbeats waren nur eine Redis-Hash-Aktualisierung alle 10 Sekunden. Wenn der Herzschlag aktuell ist, verlängere ich das Lease.

Überwachung & Benachrichtigungen

Fehlerraten-Tracking

Ich beobachtete während der Durchläufe drei Zahlen:

error_rate_5m: rollender 5-Minuten-Anteil fehlgeschlagener Versuchep95_latency: pro Modell, pro Größeretry_depth: wie viele Jobs beim Versuch ≥ 2 sind

Wenn error_rate_5m > 5% für 10 Minuten, halbiere ich die Parallelität automatisch und sende mir selbst eine Notiz. Die meisten Spitzen stabilisierten sich innerhalb von fünf Minuten ohne manuelle Eingriffe.

Kostenspitzen-Warnungen

Kosten können schleichend steigen. Ich habe folgende Daten aufgezeichnet:

- cost_per_image: von WaveSpeed mitgeteilt, falls verfügbar, sonst geschätzt aus Plan

- duplicate_prevented: Anzahl der Storage-Kurzschlüsse

- total_estimated_cost: kumulativ

Wenn cost_per_image um mehr als 30% gegen den Durchschnitt der letzten Stunde sprang, hielt ich neue Job-Aufnahme an und ließ die Queue ablaufen. Zweimal half dies dabei, unbeabsichtigte Parameteränderungen (größere Größen, anderes Modell) zu erkennen, bevor die Rechnung abwich. Stille Schutzvorrichtungen wie diese sind ihre wenigen Codezeilen wert.

Referenzimplementierung

Python Pseudo-Code

Unten ist die Form, die ich verwendete. Es ist kein vollständiger Code, nur die Grundlagen:

# producer.py

for row in csv_rows:

key = hash_inputs(row)

job = { "id": key, "inputs": row, "deadline": now+6*3600 }

queue.push(job)

# worker.py

while True:

job = queue.lease(timeout=120)

if not job:

sleep(1)

continue

try:

record_heartbeat(job.id)

resp = wavespeed.generate_image(inputs=job.inputs, idempotency_key=job.id, timeout=60)

path = storage_path(job.id, job.inputs)

if not storage.exists(path):

storage.write(path, resp.image)

storage.write(path+'.json', resp.metadata)

mark_success(job.id)

except Retryable as e:

mark_retry(job.id, e)

backoff_sleep(job.attempt)

except Fatal as e:

mark_failed(job.id, e)

finally:

queue.release(job)Node.js Pseudo-Code

// producer.mjs

for (const row of rows) {

const key = hashInputs(row);

queue.push({ id: key, inputs: row, deadline: Date.now() + 6 * 3600e3 }); // 6 hours

}

// worker.mjs

while (true) {

const job = await queue.lease(120); // lease timeout in seconds

if (!job) { // 原来的 ".job" 改为 "!job"

await delay(1000);

continue;

}

try {

await heartbeat(job.id);

const resp = await wavespeed.generateImage(

{ ...job.inputs, idempotencyKey: job.id },

{ timeout: 60000 } // 60 seconds

);

const path = makePath(job.id, job.inputs);

if (!(await storage.exists(path))) { // 原来的 ".(await ...)" 修正

await storage.write(path, resp.image);

await storage.write(path + '.json', resp.metadata);

}

await markSuccess(job.id);

} catch (e) {

if (isRetryable(e)) {

await markRetry(job.id, e);

} else {

await markFailed(job.id, e);

}

} finally {

await queue.release(job);

}

}Konfigurationsempfehlungen

- Klein anfangen: 5–10 gleichzeitige Anfragen, dann schleichend erhöhen. Beobachten Sie

p95underror_rate_5m, nicht nur Durchsatz. - Separate Configs pro Modell: Parallelität, Timeout und Kostenerwartungen ändern sich mit Modell und Größe.

- Idempotenz überall: Schlüssel in der Anfrage, deterministischer Storage-Pfad und eine Job-Tabelle mit dem gleichen Wert als Schlüssel.

- Heartbeats und Leases: Sie klingen pingelig, aber sie bewahren Sie vor Phantom-Duplikaten.

- Einfache Dashboards: 6–8 Panels reichen aus — Queue-Länge, Erfolge/min, Fehler/min, p95, Retry-Tiefe und Kosten.

Wenn Sie bereits Batch-Jobs woanders ausführen, wird sich das vertraut anfühlen. WaveSpeed erforderte kein Umdenken, nur ein paar sorgfältige Schutzvorrichtungen. Das war es, was ich wollte.

Eine letzte Anmerkung aus meinen Durchläufen: Die glattest laufenden Batches waren diejenigen, die ich kaum beobachtete. Nicht weil es “einmal einstellen und vergessen” war, sondern weil das System mir sagte, wenn es Aufmerksamkeit brauchte und still war, wenn es nicht nötig war. Das fühlt sich wie die richtige Art von Geschwindigkeit an.

Und bei dir? Hast du in letzter Zeit Bilder mit WaveSpeed im Batch verarbeitet? Wie ist deine Sweet Spot für Parallelität (ich bin derzeit konstant um 8–10)? Oder bist du auf irgendwelche heimtückischen Bugs gestoßen (wie doppelte Gebühren)? Teile gerne dein Setup, Fallstricke oder Tipps in den Kommentaren!